岭回归(英文名:ridge regression, Tikhonov regularization)是一种专用于共线性数据分析的有偏估计回归方法,实质上是一种改良的最小二乘估计法,通过放弃最小二乘法的无偏性,以损失部分信息、降低精度为代价获得回归系数更为符合实际、更可靠的回归方法,对病态数据的拟合要强于最小二乘法。

岭回归,又称脊回归、吉洪诺夫正则化(Tikhonov regularization),是对不适定问题(ill-posed problem)进行回归分析时最经常使用的一种正则化方法。

特点

编辑

通常岭回归方程的R平方值会稍低于普通回归分析,但回归系数的显著性往往明显高于普通回归,在存在共线性问题和病态数据偏多的研究中有较大的实用价值。

多重共线性是指线性回归模型中的解释变量之间由于存在精确相关关系或高度相关关系而使模型估计失真或难以估计准确。

一般来说,由于经济数据的限制使得模型设计不当,导致设计矩阵中解释变量间存在普遍的相关关系。

完全共线性的情况并不多见,一般出现的是在一定程度上的共线性,即近似共线性。

~~~~~~~~~~~~~~~~~~~~~参考资料

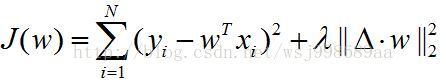

如果我们对一个线性回归模型加上拉普拉斯惩罚,模型就会变为如下形式:

拉普拉斯惩罚使得模型更加平滑,比简单的2范数(岭回归)要好,因为它考虑了空间结构信息。

常被用于PCA,LDA,LPP,NPE等子空间学习算法的改造上面,一般会使算法性能得到提升。

再谈拉普拉斯惩罚~

上一篇博客,我介绍了《拉普拉斯平滑及其在正则化方向上的应用》,但是事后读一读,发现拉普拉斯惩罚这部分,自己说的太快了,想说的东西没有全部并有条理的说出来,于是决定再写写这块的东西,有什么错误,希望大家不吝批评指正,感激万分!

在说之前,我们先把如下几个问题想清楚:

1. 究竟什么是图像的空间结构信息?

2. 为什么在参数向量w(M*N维)上施加平滑约束,就代表着对图像空间结构信息的利用?

3. 对于参数向量w,什么叫做平滑?怎么度量呢?

这也是我最初很迷惑的地方,后来通过阅读相关文献,可能是想明白了,下面是我给出的答案。

1. 我们想想看一副图像,所谓空间信息,我的理解,图像一点的像素和它周围的像素的值之间的“大小关系”,就是空间结构信息,如果在低维空间中这种“大小关系”也能够保持,那么就相当于保持了图像的空间结构信息。

2. 再说说对参数向量w的平滑约束,说白了,也就是让相邻的分量尽可能的相等罢了。这样的话,w与一个图像(肯定是拉成向量之后的图像)相乘,图像像素与周围像素的大小关系得以保持,也就使得图像的空间结构信息得到保持!当然,也就代表对空间结构信息的利用了。

3. 关于这个问题,一般采用”最狠的“度量手段,就是相邻分量之差的平方和,如果这个平方和尽量小,那么相邻分量也就越接近,向量也就越平滑。

OK!回答完了这三个问题,下面就要回归题目了,拉普拉斯惩罚如下所示:

这个模型就是一个加了正则化项的线性回归模型,这个特定的正则化项就被称作拉普拉斯惩罚!

其具体形式如下:

其中,D1和D2均为拉普拉斯算子,而I1,I2就是单位矩阵,乘法是Kronecke积。

这样的话,假设图像x为M*N矩阵,那么对应的参数向量w就为M*N维的列向量,当算子采用修正的Neuman算子时(如下图所示),公式第一项起到的作用就是保持图像的列方向的空间结构(列方向上,相邻像素的大小关系保持不变),第二项起到的作用就是提取行方向的空间结构(列方向上,相邻像素的大小关系保持不变),两项加在一起,保持的自然就是图像整体的空间结构了。

我们再来看看拉普拉斯惩罚项,其具体可以展开成为如下形式:

上面的公式,实际上就代表了问题3所说的度量方式:相邻变量之差的平方和。让这个平方和越小,相邻的分量值也就越接近,参数向量w也就越平滑喽!这l时,还得再说说正则化的作用,最小化上述模型,通过正则化因子的”平衡作用“,如果参数因子变大,意味着参数向量w更加平滑,也就使得图像的空间结构信息得以越好的保持。

难道空间结构信息得以越好的保持,模型就越好吗?我认为答案是否定的,要看你的目的是什么,你觉得呢?

原文链接: https://blog.csdn.net/wsj998689aa/article/details/40378547

208

208

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?