---------Support Vector Machines(SVM) :支持向量机,large margin classifier大间距分类器

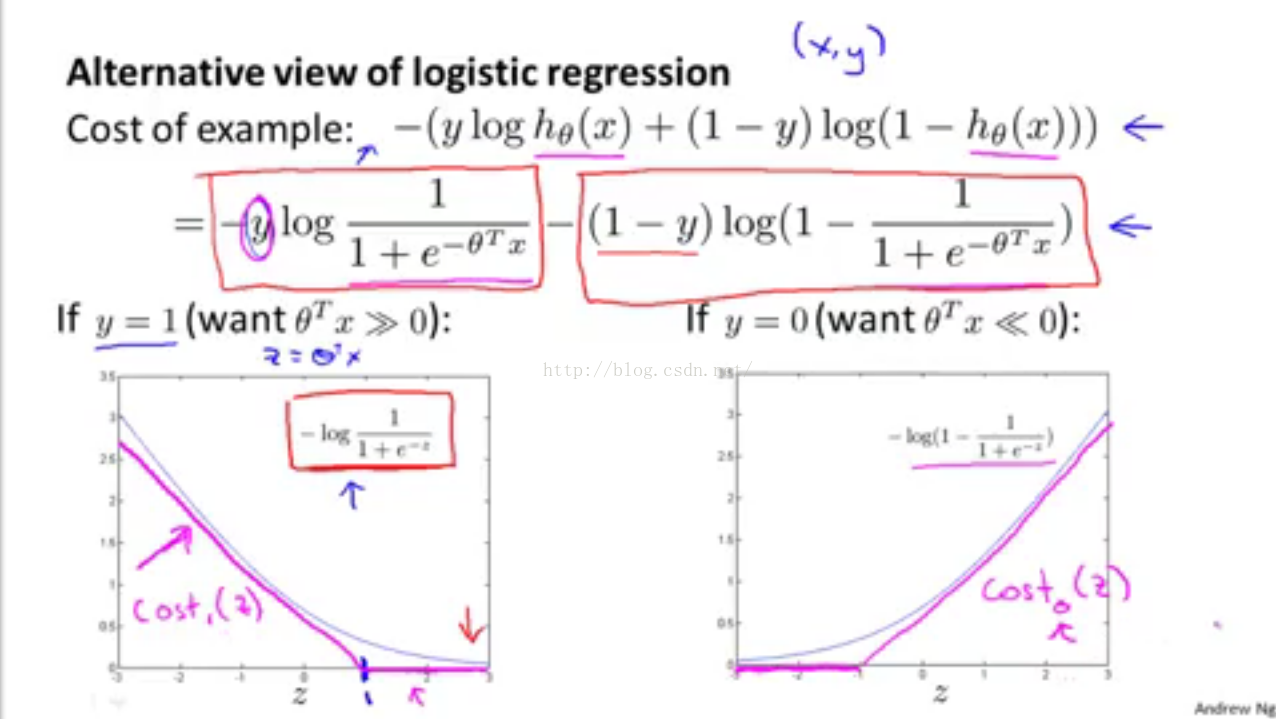

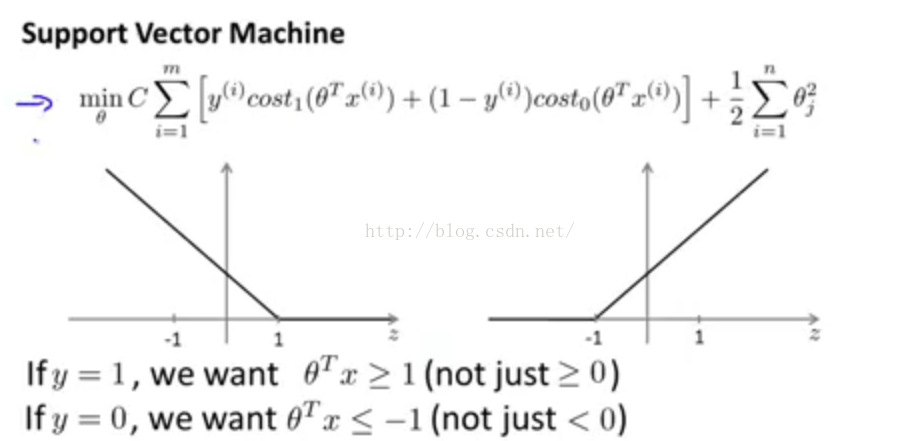

--------怎么从逻辑回归一点点修改成SVM:

分别当y=0和1的时候画出cost曲线,然后用直线逼近。

-------cost function的1/m只是习惯,它是常数不影响Theta的优化。

-------SVM的hypothesis:

-------SVM和逻辑回归的区别:1/m、Theta,物理意义区别 SVM具有大安全间距

------范数:向量的长度,为实数

------SVM的机理:把每个特征值看作一个维度,这样学习的过程便可以看作向量运算,Theta的转置*x=p*||Theta||,p:是实数,X向量投影到Theta向量的值,||Theta||是范数,也就是Thet向量的长度。至于为什么SVM能够找到大间距的决策边界,是因为我们的目的是把Theta的值变得很小,而这时候P的值就要变得很大 这样决策空间也就变得很大,而Theta向量和决策边界是垂直的,只有让X和Theta的夹角变得很小,才能使P的值变大,所以SVM会选择右图的决策边界而不是左图的。

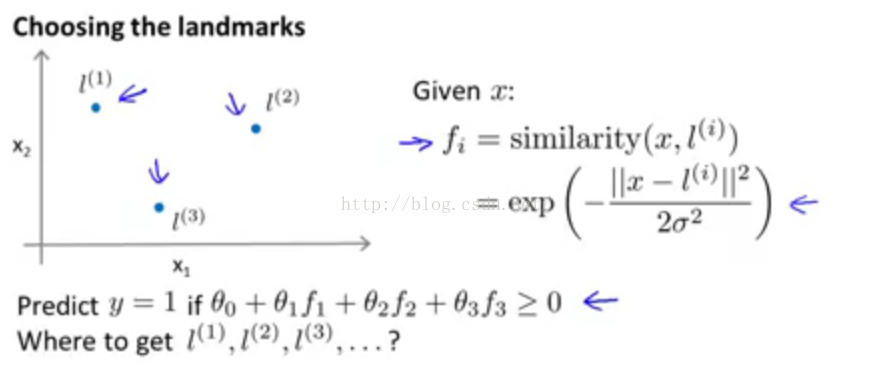

------kernels(核函数):通过标记点到核心(即为X)距离的远近来预测H的值。

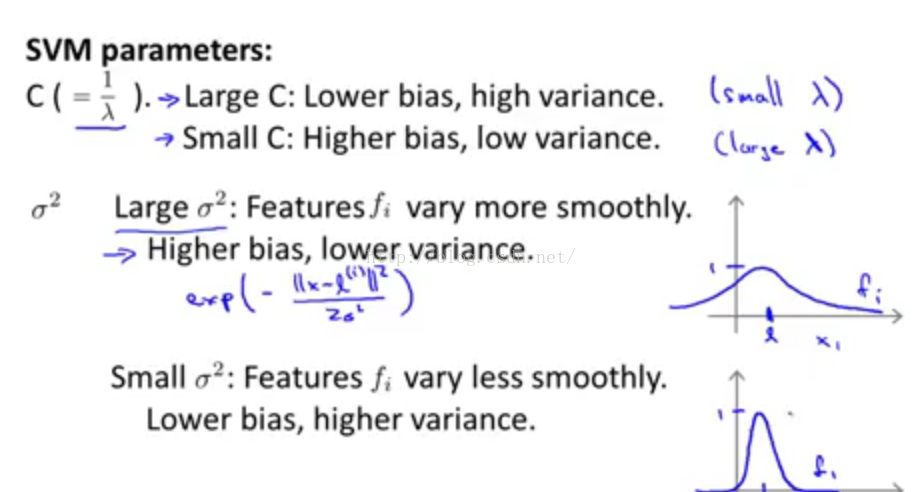

-----SVM with kernels:用核函数的支持向量机

------SVM 的系数和logical regresion的系数比较:

-----------逻辑回归的系数:

388

388

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?