本文发表于TMI-2016-May的深度学习专刊,提出用CNN回归医学图像的变换参数,报告了2D X光-3D CT医学图像的高精度、大捕捉范围、强实时性的配准方法。个人没做过X光配准,但是对CNN回归做变换参数估计非常感兴趣,目前医学领域可参考的文献实在太少,不得不硬着头皮读一下,欢迎交流。

几乎是同一时间,MIAR会议也发表了US-CT的CNN配准方案《Registration of CT and Ultrasound Images of the Spine with Neural Network and Orientation Code Mutual Information》,它用CNN(也自称第一次用CNN做配准)将输入图像分类为几个预标定的标准切面,继承预标定切面的空间参数作为粗配准,之后再使用互信息局部优化方法调优。该文需要术前预标定,离自动配准还有点距离,但术中配准就是自动化且具有较强实时性的,不需要电标测数据。该文献思路简单明了很有意思,对读者可谓大有启发。但因为思路太简单了也没有追求非常好的粗配准效果,精细调整完全指望后续的互信息方法,故不在这里细讲。

回到本文。

本文指出,X光与CT的配准有其特殊性。麻烦之处在于,每次空间变换参数更新时,都需要做DRR重渲染,即根据空间参数透射三维CT数据场来产生一张模拟的X光成像,再同实际X光成像做比对计算相似性测度——作者指出每次重渲染用时1秒左右,这样比起常规的图像变换就慢得多了;好处则是,CT和X光图像对物理量的理解是一样的即亨氏衰减,成像质量也不会有太大的差别,容易提取出共同的结构信息,这点比超声-CT配准要强。

相似性测度的局部优化需要大量的DRR重渲染,实时配准基本是不可能的,只有放弃常规workflow进行直接回归计算才可能实现实时目标。因此比起MIAR一文,本文对局部优化方法的摒弃倾向更加明显。

本方法因为X光的特殊性而使用了大量局部化手段,不懂X光所以感到workflow比较难懂。此处随着我的理解逐渐更新。

它提出了三个概念:

Parameter Space Partitioning:

因此,本文将Talpha,Tbeta每隔20度划分为一个zone,即18*18个zone的空间grid,在这些zone中进行图片内对平面内变换参数分别训练回归器做平面参数估计。这样就能实现仅对delta t敏感,对t本身不敏感的特征提取。

Local Image Residual:

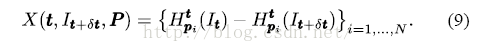

本文提取一系列3D点P={p1,p2,...pk}及t,产生一系列对应的ROI Ht,p(It)。则在zone内所求的X为

该定义能满足zone内对t的近似不变性。

3D特征点提取方法还没看懂

Hierachical Parameter:

比起直接回归6个空间参数,本文将参数分成三个组分别回归:

平面内参数delta tx,ty, t theta;

平面外参数delta t alpha,t beta;

最后是z轴变换tz

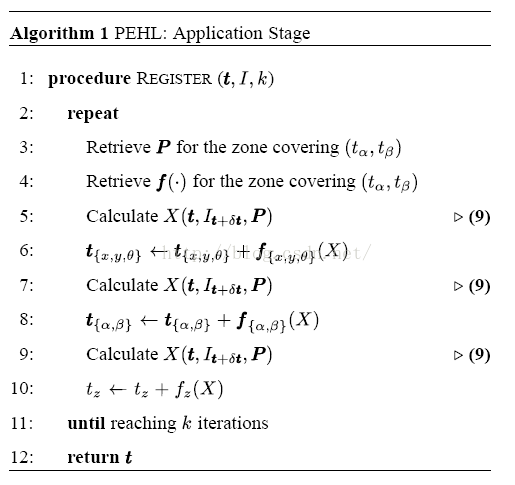

流程如下:

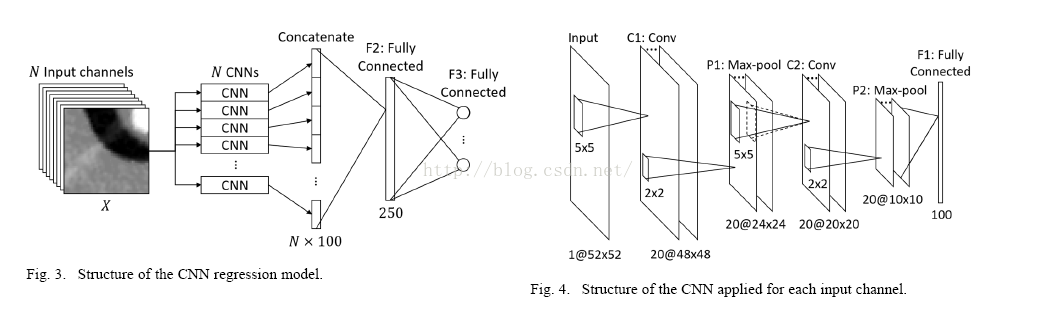

CNN的模型与训练:

将固定数量k的ROI patch分别输入CNN产生特征向量,然后将这些向量首尾相连,后面接两层FC层,最后输入回归器。

1715

1715

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?