NLTK是Python很强大的第三方库,可以很方便的完成很多自然语言处理(NLP)的任务,包括分词、词性标注、命名实体识别(NER)及句法分析

NLTK下载器

输入import nltk了,然后输入nltk.download(),这样就可以打开一个NLTK Downloader(NLTK下载器)

显示nltk的搜索路径

nltk.data.find(".")

NLTK进行分词

使用的函数:

nltk.sent_tokenize(text) #对文本按照句子进行分割

nltk.word_tokenize(sent) #对句子进行分词

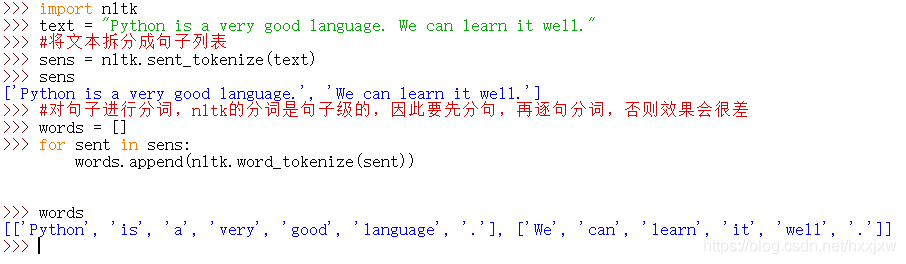

import nltk text = "Python is a very good language. We can learn it well." #将文本拆分成句子列表 sens = nltk.sent_tokenize(text) #对句子进行分词,nltk的分词是句子级的,因此要先分句,再逐句分词,否则效果会很差 words = [] or sent in sens: words.append(nltk.word_tokenize(sent))

待更——————————————————

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?