依然以从bin中抽取球为例子,以下是有噪声时数据集中可能得到的结果

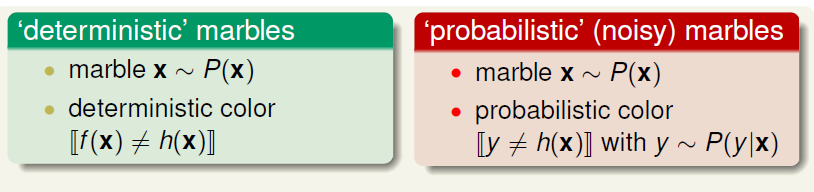

在hypothesis和x确定的时候,理想映射和h(x)的关系是确定的,而我们数据集中样本的y和h(x)是根据f(x)和noise强度得到的一个概率结果。

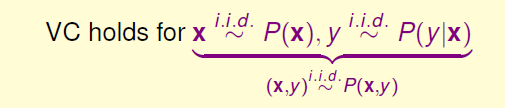

当我们使用的数据集从总体中抽取是独立同分布,且y对于任意x的概率也为独立同分布时,VC-bound依然成立(证明略),即如下:

对于有噪声的情况,我们可以结果y将其视为f(x)+noise

在这种情况下,我们将learning flow重新描绘如下:

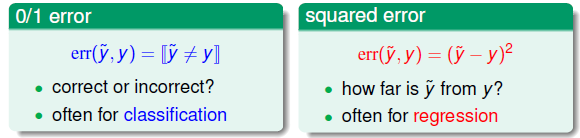

在此前使用Ein和Eout的时候,直接使用的是否相等作为error函数。

在实际中常用的error函数有以下:

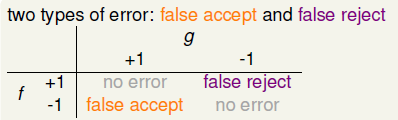

二元分类的结果可以根据正确/错误与系统判定positive/negative划分成true positive, false positive(即实际应该判断negative,但是误判),false negative(实际上应该判断为positive)和true negative。这个课程中使用指纹锁作为案例,将结果这样划分:

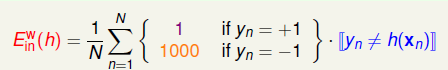

在考虑到不同的结果影响后果不同,有时候需要在计算error的时候给不同的错误赋予不同的权重,如下:

==============================================================================

P.S.拾遗

由于存在一些不平衡的样本集(即训练集中某种结果远远多于另一种结果),有时我们需要使用precison和recall作为error measure

其中

precision=true positive/all positive

recall=true positive/all true

其中all ture=ture positive + false negative

对于总体的错误情况,还可以使用F1 score

F1=2*(precison*recall)/(precison+recall)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?