课程介绍,机器学习整体分为3章

- SVM:Support Vector Machine

- AdaBoost:Adaptive Boosting

- Deep Learning

还没有上过机器学习基石,不管怎样一点一点看一点一点积累

为了让margin最大,需要选择各个exampe到Hyperplane最短的那个距离

distance(x,b,w)=1∥w∥∣∣wTx+b∣∣

距离公式得到,用条件(1)

yn(wTxn+b)>0

用上述条件(1)脱绝对值号,变成

maxb,wsubject to everymargin(b,w)yn(wTxn+b)>0margin(b,w)=minn=1,...,N1∥w∥yn(wTxn+b)

然后又用下面的条件(2),把条件(1)免掉秒杀掉,同时最大的margin由 max 1∥w∥ 变成 min12wTw

minn=1,...,Nyn(wTxn+b)=1

距离中存在最小距离为1,那么其他所有距离必然大于0,条件(1)省掉!

然后把条件(2)进一步放松,成为条件(3),其实就是 =1 改成 ≥1

minn=1,...,Nyn(wTxn+b)≥1

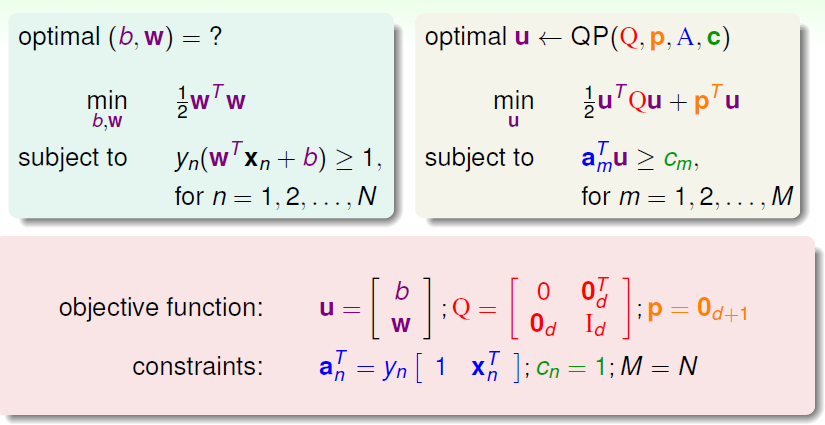

SVM标准形式:(Solving General SVM)

minb,(w)subject to12wTwyn(wTxn+b)≥1 for all n

最后,boundary example(离边界最近的点) 是支撑向量(候选)

support vector machine (SVM)在支撑向量的帮助下求得“最肥”的超平面

用二次规划(Quadratic Programming)求解SVM

对比公式,可以对应地得到二次规划的参数

Q=[00d0TdId]; p=0d+1; aTn=yn[1xTn]; cn=1

以上参数,将SVM转换成二次规划,然后调用已有的二次规划程序去解决,最后,求出 b,w ,就得到SVM

VC demension 不懂是啥?

SVM:smaller ‘VC dim’->better generalization

338

338

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?