在本章节主要讲解了

神经网络的基本架构,

初次谈到异或问题的解决;

并涉及几种activation function的TensorFlow实现;

讲解了正向传播过程中常用的loss function(classification is cross-entropy and regression is MSE)及根据实际问题自定义损失函数(例如本文中的对相应部分进行加权处理);

神经网络的优化算法(Gradient descent and BP算法),在此提出注意初始点的选择和随机梯度下降(SGD)算法;

神经网络的进一步优化,包括学习率(learning rate)的设置,如何防止过拟合(Overfitting),以及滑动平均模型的使用方法。

一.Activation function 的实现

import tensorflow as tf

#Ex01 三种激活函数(RELU,Sigmoid,tanh)的实现

a=tf.nn.relu(tf.matmul(x,w1)+bases1)

a=tf.sigmoid(tf.matmul(x,w1)+bases1)

a=tf.tanh(tf.matmul(x,w1)+bases1) #此处如要实现,须先定义相应的变量x,w1,bases1二.loss function的实现

#EX02 损失函数的实现

#1.cross-entropy loss functin

cross_entropy=-tf.reduce_mean(y_*tf.log(tf.clip_by_value(y,1e-10,1.0)))#y为预测值,y_为真实值

#在上述的损失函数中,tf.clip_by_value(y,1e-10,1.0)将y的值限制在1e-10到1.0之间;tf.log()为取对数函数

#并且注意上述中的*运算为元素对应乘法,而tf.matmul()为矩阵乘法。

#2.实现使用了softmax回归之后的交叉熵损失函数

cross_entropy=tf.nn.softmax_cross_entropy_with_logits(y,y_)#y为预测值,y_为真实值

#3.MSE

mse=tf.reduce_mean(tf.square(y_-y))#y为预测值,y_为真实值在此对交叉熵损失函数中的相应函数进行剖分实践

v=tf.constant([[1.0,2.0,3.0],[4.0,5.0,6.0]])

sess=tf.Session()

print(tf.clip_by_value(v,2.5,4.5).eval(session=sess))#对函数tf.clip_by_value(v,2.5,4.5)进行实例分析[[2.5 2.5 3. ]

[4. 4.5 4.5]]sess=tf.Session()

v1=tf.constant([[1.0,2.0],[3.0,4.0]])

v2=tf.constant([[5.0,6.0],[7.0,8.0]])

print((v1*v2).eval(session=sess))

print(tf.matmul(v1,v2).eval(session=sess))#对矩阵乘法和元素乘法进行实例分析结果:

[[ 5. 12.]

[21. 32.]]

[[19. 22.]

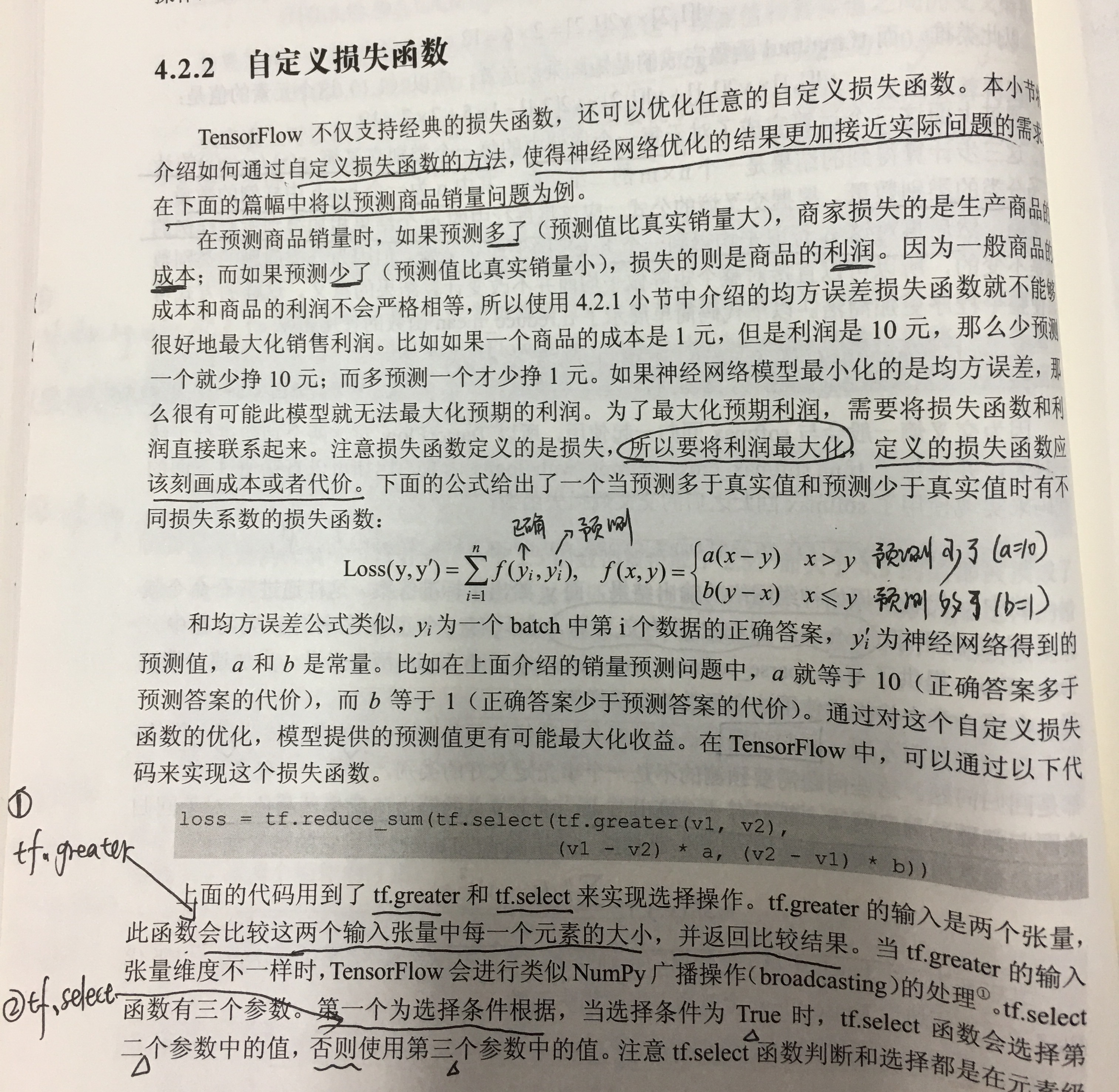

[43. 50.]]以下为自定义的损失函数的实现,实质上就是对相应部分进行加权处理

loss=tf.reduce-sum(tf.select(tf.greater(v1,v2),(v1-v2)*a,(v2-v1)*b))对于函数tf.select()和tf.grester()的实例分析

import tensorflow as tf

v1=tf.constant([1.0,2.0,3.0,4.0])

v2=tf.constant([4.0,3.0,2.0,1.0])

sess=tf.InteractiveSession()

print(tf.greater(v1,v2).eval(session=sess))

print(tf.where(tf.greater(v1,v2),v1,v2).eval(session=sess))[False False True True]以下是关于以上自定义的损失函数的一个完整code

#以下是完整的code

import tensorflow as tf

from numpy.random import RandomState

batch_size=8

x=tf.placeholder(tf.float32,shape=(None,2),name='x_input')#两个输入节点

y_=tf.placeholder(tf.float32,shape=(None,1),name='y_input')#回归问题只有一个输出节点

w1=tf.Variable(tf.random_normal([2,1],stddev=1,seed=1))

y=tf.matmul(x,w1)#前向传播过程,简单的加权求和

#以下定义预测多了和预测少了的成本

loss_less=10

loss_more=1

loss=tf.reduce_sum(tf.where(tf.greater(y,y_),(y-y_)*loss_more,(y_-y)*loss_less)) #最新版的tensorflow中将tf.select()换成了tf.where()

train_step=tf.train.AdamOptimizer(0.001).minimize(loss)

#以下通过随机数生成一个模拟数据

rdm=RandomState(1)

dataset_size=128

X=rdm.rand(dataset_size,2) #给出真实输入值X

#给真实的数据加入均值为零的高斯噪声(-0.05——0.05的随机数)

Y=[[x1+x2+rdm.rand()/10.0-0.05] for (x1,x2) in X]

#训练神经网络

with tf.Session() as sess:

init_op=tf.initialize_all_variables()

sess.run(init_op)

STEPS=5000

for i in range(STEPS):

start=(i*batch_size) % dataset_size

end=min(start+batch_size,dataset_size)

sess.run(train_step,feed_dict={x:X[start:end],y_:Y[start:end]})

print(sess.run(w1))

结果为:[[1.019347 ]

[1.0428089]]三.反向传播的实现中相关

3.1学习率的设置:

#EX04 学习率的设置

global_step=tf.Variable(0)

#通过exponential_decay函数生成学习率

learning_rate=tf.train.exponential_deacy(0.1,global_step,100,0.96,staircase=True)#利用指数衰减率来更新学习率。

#使用指数衰减的学习率。在minimize函数中传入global_step将自动更新global_step参数,从而使得学习率也得到相应更新。

learning_step=tf.train.GradientDescentOptimizer(learning_rate).minimize(mse,global_step=global_step)#在此利用梯度下降法进行更新参数。在以上代码中,初始学习率为0.1,因为staircase=True,则将会每一百次训练过后学习率将在现有的基础上乘以0.96,呈现阶梯状衰减率,因此通过这样就可以实现刚开始训练的时候,学习率很大,随着轮次的增加,学习率会变得越来越小。

3.2 过拟合问题

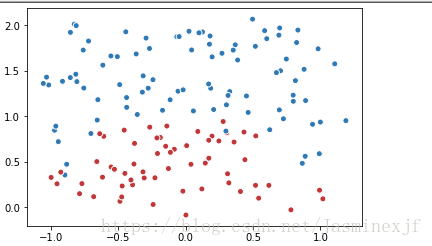

#step1:生成模拟数据

import tensorflow as tf

import matplotlib.pyplot as plt

import numpy as np

data = []

label = []

np.random.seed(0) # 设置随机数生成时所用算法开始的整数值

# 以原点为圆心,半径为1的圆把散点划分成红蓝两部分,并加入随机噪音。

for i in range(150):

x1 = np.random.uniform(-1,1) # 随机生成下一个实数,它在 [-1,1) 范围内。

x2 = np.random.uniform(0,2)

if x1**2 + x2**2 <= 1:

data.append([np.random.normal(x1, 0.1),np.random.normal(x2,0.1)])

label.append(0)

else:

data.append([np.random.normal(x1, 0.1), np.random.normal(x2, 0.1)])

label.append(1)

data = np.hstack(data).reshape(-1,2) # 把数据转换成n行2列

label = np.hstack(label).reshape(-1, 1) # 把数据转换为n行1列

plt.scatter(data[:,0], data[:,1], c=label,cmap="RdBu", vmin=-.2, vmax=1.2, edgecolor="white")

plt.show()#step2 通过集合计算一个5层神经网络带L2正则化的损失函数计算方法

#2. 定义一个获取权重,并自动加入正则项到损失的函数。

def get_weight(shape, lambda1):

var = tf.Variable(tf.random_normal(shape), dtype=tf.float32) # 生成一个变量

tf.add_to_collection('losses', tf.contrib.layers.l2_regularizer(lambda1)(var)) # add_to_collection()函数将新生成变量的L2正则化损失加入集合losses

return var # 返回生成的变量

#3. 定义神经网络。

x = tf.placeholder(tf.float32, shape=(None, 2))

y_ = tf.placeholder(tf.float32, shape=(None, 1))

sample_size = len(data)

# 每层节点的个数

layer_dimension = [2,10,5,3,1]

# 神经网络的层数

n_layers = len(layer_dimension)

# 这个变量维护前向传播时最深层的节点,开始的时候就是输入层

cur_layer = x

# 当前层的节点个数

in_dimension = layer_dimension[0]

# 循环生成网络结构

for i in range(1, n_layers):

out_dimension = layer_dimension[i] # layer_dimension[i]为下一层的节点个数

# 生成当前层中权重的变量,并将这个变量的L2正则化损失加入计算图上的集合

weight = get_weight([in_dimension, out_dimension], 0.003)

bias = tf.Variable(tf.constant(0.1, shape=[out_dimension])) # 偏置

cur_layer = tf.nn.relu(tf.matmul(cur_layer, weight) + bias) # 使用Relu激活函数

in_dimension = layer_dimension[i] # 进入下一层之前将下一层的节点个数更新为当前节点个数

y= cur_layer

# 在定义神经网络前向传播的同时已经将所有的L2正则化损失加入了图上的集合,这里是损失函数的定义。

mse_loss = tf.reduce_mean(tf.square(y_ - y)) # 也可以写成:tf.reduce_sum(tf.pow(y_ - y, 2)) / sample_size

tf.add_to_collection('losses', mse_loss) # 将均方误差损失函数加入损失集合

# get_collection()返回一个列表,这个列表是所有这个集合中的元素,在本样例中这些元素就是损失函数的不同部分,将他们加起来就是最终的损失函数

loss = tf.add_n(tf.get_collection('losses'))结果:

After 0 steps, mse_loss: 0.614814

After 2000 steps, mse_loss: 0.560077

After 4000 steps, mse_loss: 0.560000

After 6000 steps, mse_loss: 0.560000

After 8000 steps, mse_loss: 0.560000

After 10000 steps, mse_loss: 0.560000

After 12000 steps, mse_loss: 0.560000

After 14000 steps, mse_loss: 0.560000

After 16000 steps, mse_loss: 0.560000

After 18000 steps, mse_loss: 0.560000

After 20000 steps, mse_loss: 0.560000

After 22000 steps, mse_loss: 0.560000

After 24000 steps, mse_loss: 0.560000

After 26000 steps, mse_loss: 0.560000

After 28000 steps, mse_loss: 0.560000

After 30000 steps, mse_loss: 0.560000

After 32000 steps, mse_loss: 0.560000

After 34000 steps, mse_loss: 0.560000

After 36000 steps, mse_loss: 0.560000

After 38000 steps, mse_loss: 0.560000

#step4 训练带有正则化项的神经网络(对比)

#5. 训练带正则项的损失函数loss。

# 定义训练的目标函数loss,训练次数及训练模型

train_op= tf.train.AdamOptimizer(0.001).minimize(loss)

TRAINING_STEPS = 40000

with tf.Session() as sess:

tf.global_variables_initializer().run()

for i in range(TRAINING_STEPS):

sess.run(train_op,feed_dict={x: data, y_: label})

if i % 2000 == 0:

print("After %d steps, loss: %f" % (i, sess.run(loss, feed_dict={x: data})))

# 画出训练后的分割曲线

xx, yy = np.mgrid[-1:1:.01, 0:2:.01]

grid = np.c_[xx.ravel(), yy.ravel()]

probs = sess.run(y, feed_dict={x:grid})

probs = probs.reshape(xx.shape)

plt.scatter(data[:,0], data[:,1], c=label,cmap="RdBu", vmin=-.2, vmax=1.2, edgecolor="white")

plt.contour(xx, yy, probs, levels=[.5], cmap="Greys", vmin=0, vmax=.1)

plt.show()

#运行时提示占位符被占用,即当前GPU已经被占用 InvalidArgumentError (see above for traceback): You must feed a value for placeholder tensor 'Placeholder_1' with dtype float and shape [?,1]

# [[Node: Placeholder_1 = Placeholder[dtype=DT_FLOAT, shape=[?,1], _device="/job:localhost/replica:0/task:0/device:CPU:0"]()]]

688

688

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?