全球 AI 开发者们热议“MCP”(Model Context Protocol)。尽管这一协议在2024年由Anthropic发布时并未引起广泛关注,但2025年初,Cursor宣布集成MCP迅速将其带入开发者的视野,3月Manus的爆发更是加速了MCP的普及。而就在3月27日,OpenAI正式宣布其Agent SDK全面支持MCP协议,这一举措标志着MCP将会成为该领域的实施标准,必将重塑AI应用的开发与交互方式。

目前,社区的MCP Server大多采用本地STDIO模式部署,尽管这种模式能支持基本模型服务和工具的数据交互,简单测试尚可,但在涉及具体的开发,调试,由于IO重定向带来不同程度的开发复杂度;同时随着AI场景的日益丰富,一方面数据访问不再仅限于本地,另一方面业务对于架构可靠性要求,基于本地部署的 MCP Server 势必无法满足复杂的生产需求。因此,云上托管的MCP Server将成为未来的主流趋势。*函数计算(FC)目前已支持一键托管开源的MCP Server,欢迎大家前来体验。*

为什么云上托管 MCP Server 是趋势?

- 吸引更多开发者参与MCP生态建设

MCP协议成为事实标准后,开发者无需为每个Function编写复杂的JSON Schema参数说明,这大大降低了重复开发的工作量。通过开源或第三方的MCP Server,开发者能够迅速共享和复用资源。例如,Blender-MCP项目允许用户通过MCP协议将自然语言指令转化为三维建模操作,项目开源一周便获得了5.4k stars。

- SaaS服务商拥抱MCP Server

随着MCP的普及,SaaS服务商可以通过集成MCP Server触达新的市场和行业机会,而MCP协议的Stdio和SSE标准要求服务和数据供应商提供API访问,而云上托管将是最优选择。

- 企业级 MCP Server 要求安全合规和弹性伸缩

MCP Server 将服务/数据对接给大模型,如果不限制大模型的数据权限范围和敏感数据过滤,将对企业产生安全合规风险,云上托管提供权限管控、操作审计、用户隐私保护等内置安全工具,大幅减少安全风险暴露面,合规成本低。同时 MCP Server 的爆火,对服务商是巨大的机会,服务商将面临着用户量和模型调用量的突增,云上托管如函数计算具备免运维、自动弹性、自动容灾的优势,确保服务体验的同时实现降本增效。

云上托管 MCP Server 核心痛点

- *传统托管效率低*

从 MCP 架构的描述中可以看到,MCP Server 作为 AI 大模型和企业服务的中间层,通过购买传统云资源部署效率低下,其代码通常相对轻量,开发者需要快速部署,快速测试仅仅可能是一条NPX命令。 “MCP Servers: Lightweight programs that each expose specific capabilities through the standardized Model Context Protocol”。

- *业务规模不确定*

作为原有 Function Calling 的替代者,工具调用请求规模具有显著的不确定性,传统云资源托管需要长期持有资源,资源供给无法实现按业务流量进行灵活的动态适配。

- *定制扩展流程复杂*

MCP Server 作为AI和企业服务能力的中间层,其逻辑覆盖简单路由到复杂计算,随着业务场景的丰富会变得越发复杂,务必在选择云上托管的时候,也要考虑后续业务的开发和维护效率。 务必要求开发层面需要更灵活的定制能力,实现快速变更,快速上线,灵活的版本和流量管理。

- *数据访问网络配置复杂*

传统MCP Server依赖于本地化部署实现数据安全,随着云端部署的普遍化,云端 MCP Server 不仅需要能够实时安全的访问企业私有数据,也需要适配复杂的业务环境,在Internet和Intranet网络之间进行互通,这就要求能够快速的互联网公共服务和企业云上 VPC 快速打通,提供安全灵活的执行环境。

函数计算成为云上托管 MCP Server 的最简方式

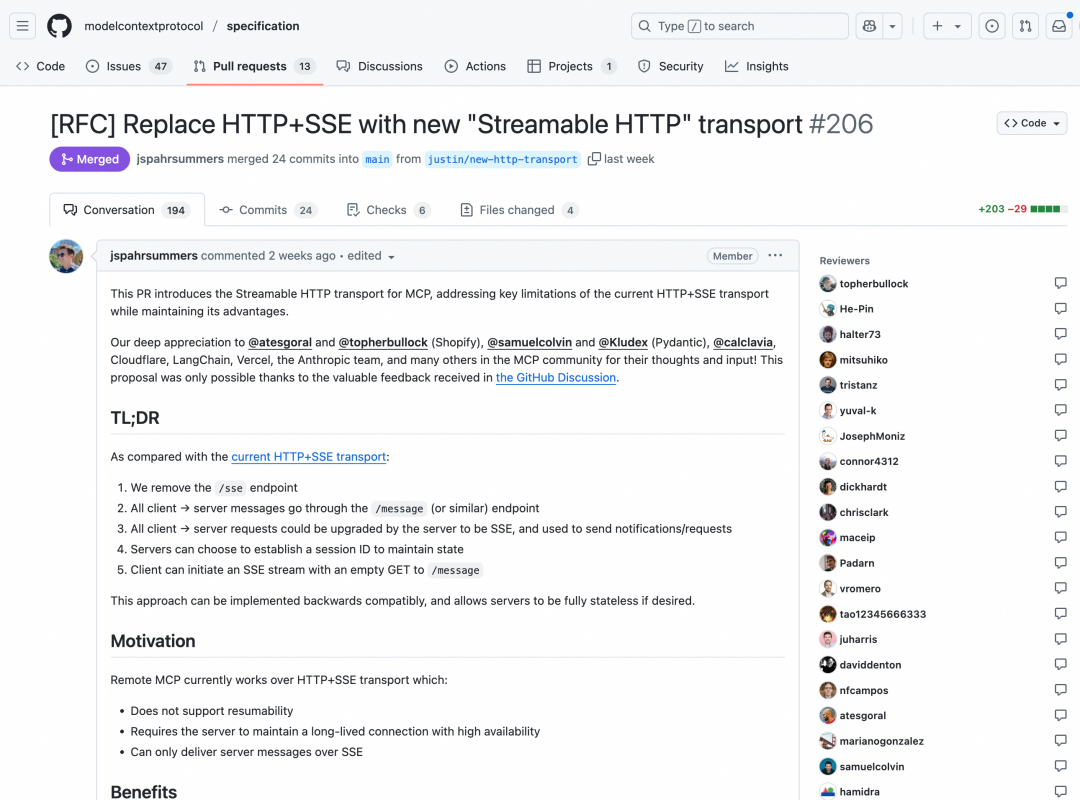

社区积极的推动 MCP 协议演进,推动 Steamable HTTP transport 技术代替原有 HTTP+SSE 的通信方式,原有的 MCP 传输方式就像是你和客服通话时必须一直保持在线(SSE 需要长连接),而新的方式更像是你随时可以发消息,然后等回复(普通 HTTP 请求,但可以流式传输)。这种形式与 Serverless 算力无状态模式更加契合,协议层演进将更有利于云上Serverless算力的价值放大,随着AI模型复杂度和数据规模持续增长,Serverless与MCP Server的结合将成为趋势。

https://github.com/modelcontextprotocol/specification/pull/206

函数计算作为云上Serverless 算力的典型代表,其凭借在开发效率,按需付费,极致弹性等产品能力直击云上 MCP Server 托管的核心痛点,为企业MCP Server 提供高效,灵活,匹配业务规模的托管能力。

*1. 成本效益最大化*

-

-

按需付费,避免资源浪费

**:**Serverless按实际计算资源消耗计费,而非固定服务器租赁费用,尤其适合AI训练和推理任务中常见的波动性负载。

-

消除闲置成本

**:**AI模型训练通常需要突发性算力,Serverless能自动分配资源,避免传统模式下预留资源导致的服务器空置问题。

-

*2. 弹性扩展与资源优化*

-

-

动态资源分配

**:**将MCP Server 托管在函数计算上,基于Serverless架构,可实时响应AI任务需求,自动扩展CPU/GPU,确保算力高并发处理能力。

-

多模型协作支持

**:**支持多个AI项目并行运行,资源按优先级动态调度,提升整体算力利用率。

-

*3. 简化运维与加速开发*

-

-

无服务器管理

**:**开发者无需关注服务器配置、补丁更新或集群管理,专注算法优化和迭代MCP Server 内部逻辑和工具丰富度。

-

开箱即用的工具链

**:**函数计算提供了完善的工具链能力,基于开源 Serverless Devs开源工具实现本地快速部署。

-

*4. 更灵活的MCP协议适配*

-

- 当前函数计算提供单实例多并发能力,扩展对存量SSE协议的适配,基于社区提供的MCP Proxy方案能够快速将存量本地MCP Server托管到云端,方便业务平台的测试开发。

- 提供基于WebSocket 的MCP协议适配参考实现,支持单实例单并发和单实例多并发能力支持,提升协议适配和场景适配;同时团队紧跟社区 Streamable HTTP 方案,敬请期待!

体验:一键部署热门 MCP Server

依赖 Serverless 应用开发平台 CAP,我们能够快速实现开源 MCP Server 一键托管,假如您搭建的 AI Agent 中需要加入导航服务,您可能会需要高德社区提供的 MCP Server ,接下来我们将以开源项目 amap-maps-mcp-server 为例演示如何一键部署 MCP Server 到函数计算FC上。

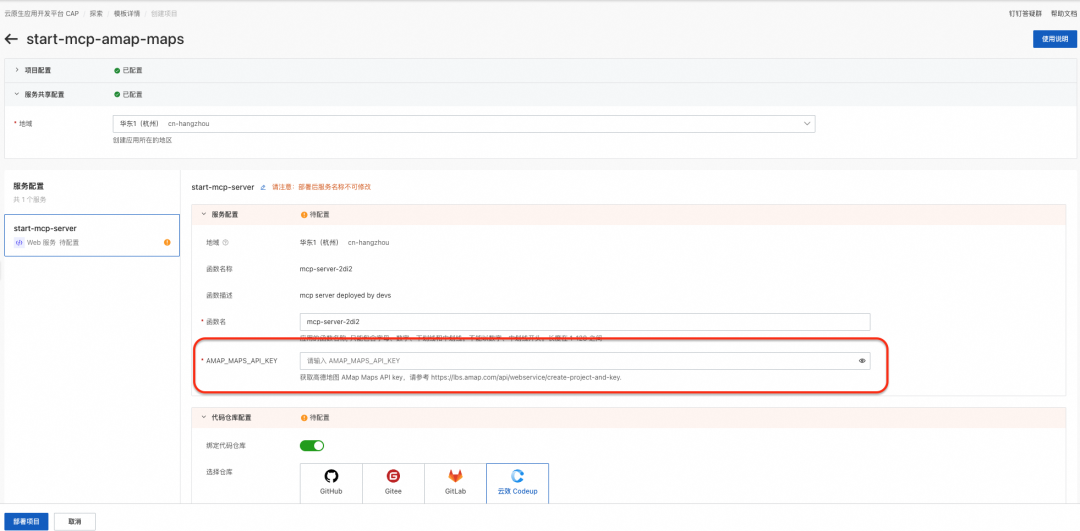

第一步: 模版部署

点击 https://cap.console.aliyun.com/create-project?template=start-mcp-amap-maps 进入CAP控制台。填入从高德开发者申请的 Token(立刻申请完成),可以在这里申请(https://lbs.amap.com/api/webservice/create-project-and-key)。

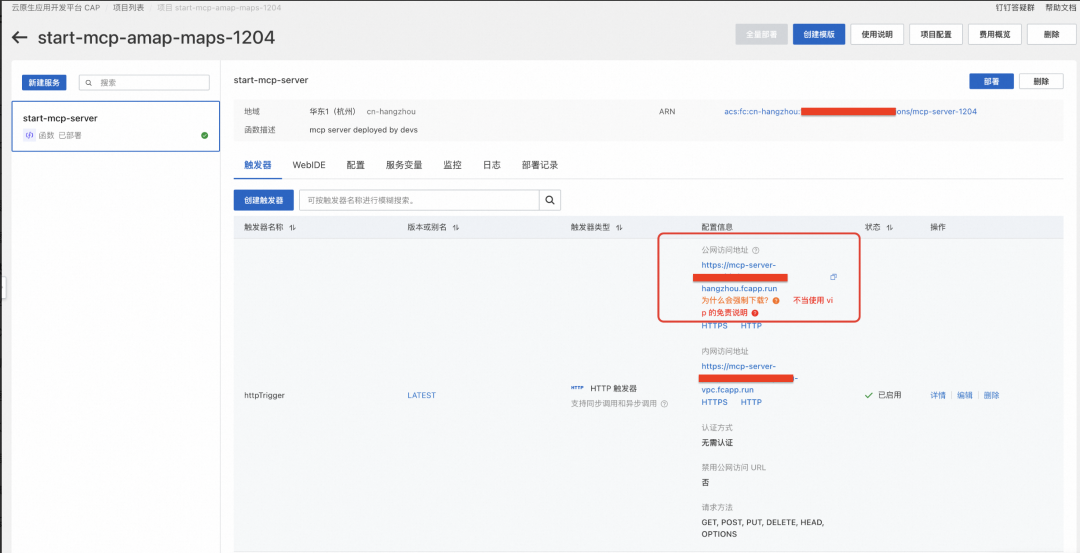

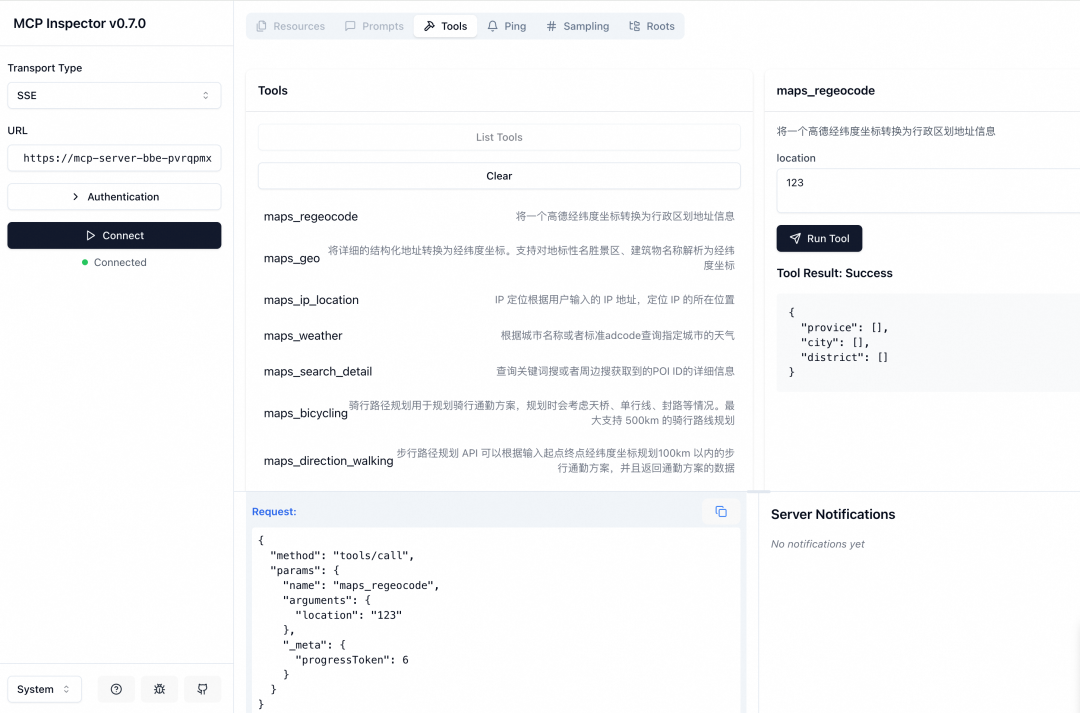

第二步: 测试 MCP Server 提供的工具能力

部署成功之后,通过触发器页面,拿到测试URL可对当前MCP Server进行测试。如果希望将部署的MCP Server 用于生产,建议使用自定义域名代替测试URL。

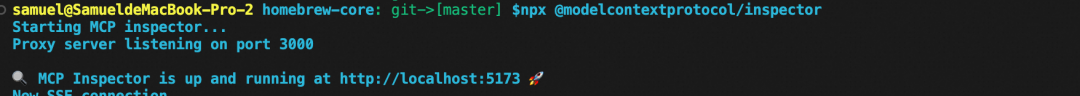

测试步骤一:本地终端运行命令: npx @modelcontextprotocol/inspector

测试步骤二:浏览器中打开本地提供的测试地址“http://localhost:5173/#tools”进行测试,在URL表单中填入上面获取的URL,添加/sse 后缀填入URL表单中,点击Connect会看到开源 MCP Server提供的Tools列表,可以点击置顶Tool进行交互验证。

如果您对于产品有更多建议或者对 MCP server 云端托管有更多想法可以加入钉钉群(群号:64970014484)与我们取得联系。

更多开源 MCP Server一键部署

| MCP 开源地址 | 编程语言 | 一键部署 | Server 类型 |

|---|---|---|---|

| https://github.com/baidu-maps/mcp/tree/main/src/baidu-map/node | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-nodejs-baidu-map | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/github | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-github | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/everart | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-ever-art | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/fetch | Python | https://cap.console.aliyun.com/create-project?template=start-mcp-fetch | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/brave-search | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-brave-search | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/time | Python | https://cap.console.aliyun.com/create-project?template=start-mcp-time | mcp-proxy |

| https://github.com/devsapp/amap-maps-mcp-server | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-amap-maps | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/everything | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-everything | sse |

| https://github.com/modelcontextprotocol/servers/tree/main/src/aws-kb-retrieval-server | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-aws-kb-retrieval-server | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/gitlab | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-gitlab | mcp-proxy |

| https://github.com/modelcontextprotocol/servers/tree/main/src/puppeteer | Node | https://cap.console.aliyun.com/template-detail?template=start-mcp-puppeteer | sse |

| /src/puppeteer | Node | https://cap.console.aliyun.com/template-detail?template=start-mcp-puppeteer | sse |

| https://github.com/modelcontextprotocol/servers/tree/main/src/sequentialthinking | Node | https://cap.console.aliyun.com/create-project?template=start-mcp-sequentialthinking | mcp-proxy |

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

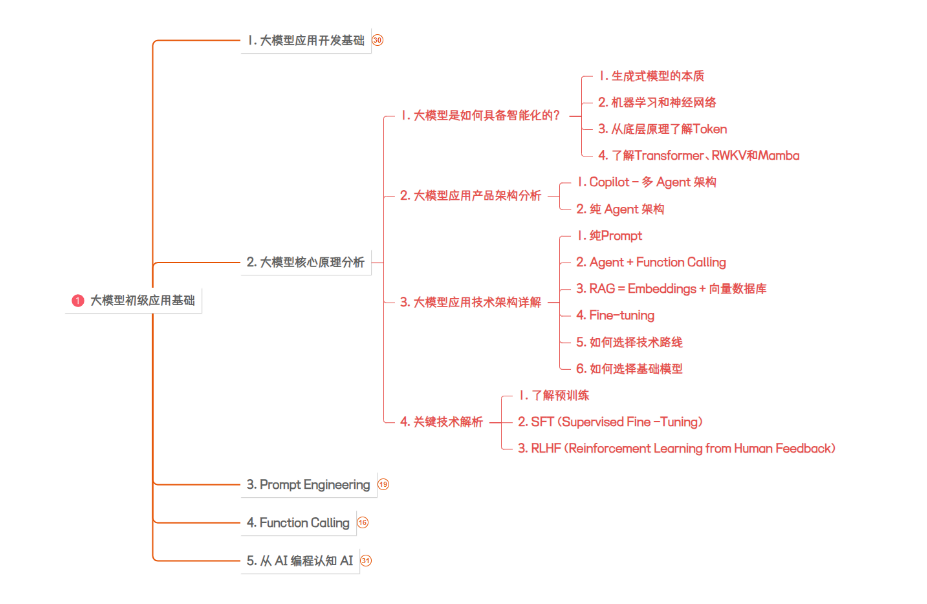

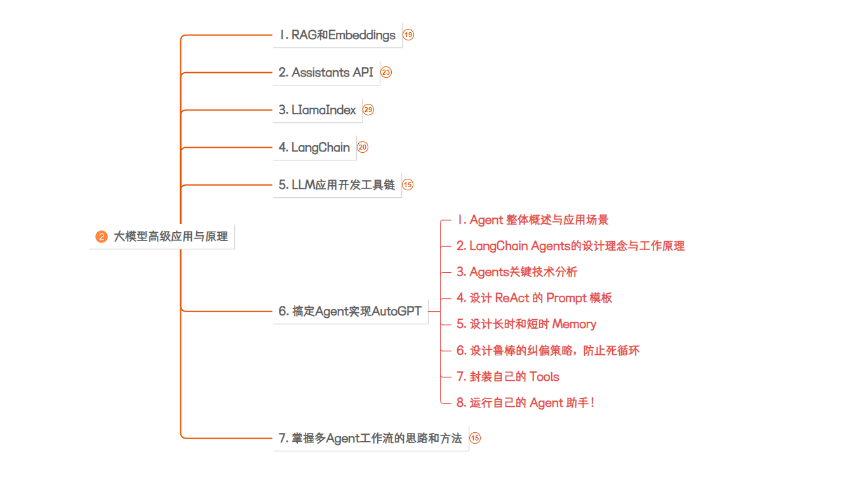

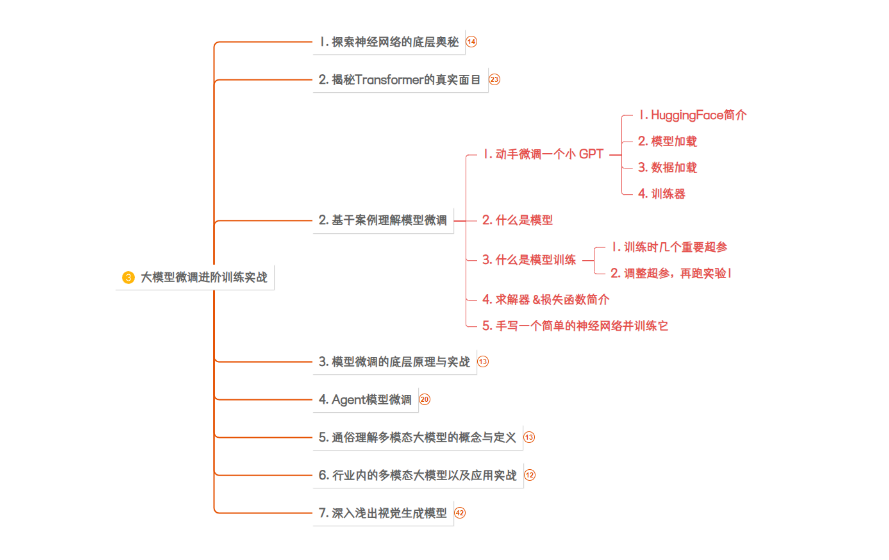

零基础入门AI大模型

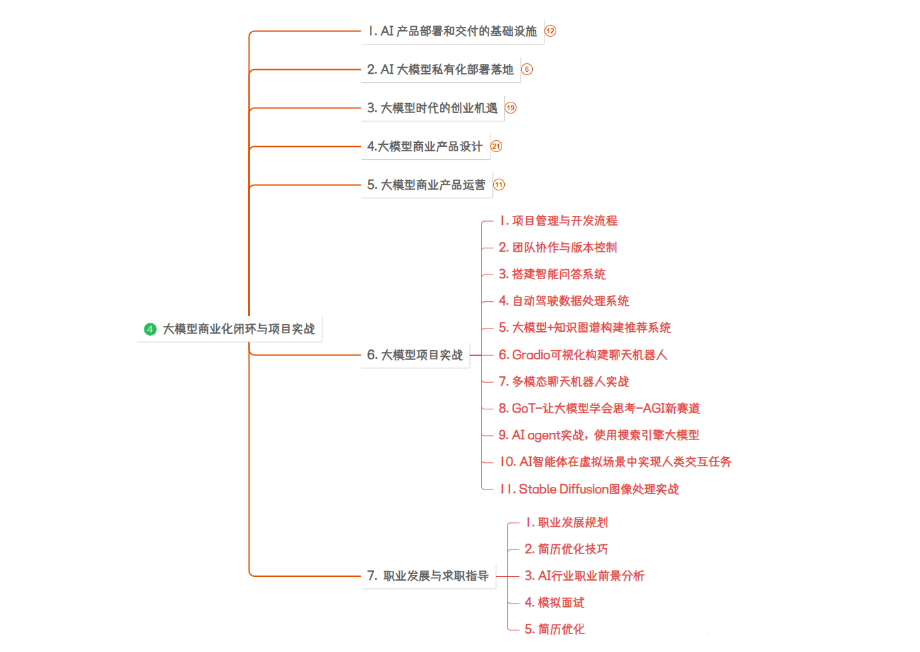

今天贴心为大家准备好了一系列AI大模型资源,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

1.学习路线图

如果大家想领取完整的学习路线及大模型学习资料包,可以扫下方二维码获取

👉2.大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。(篇幅有限,仅展示部分)

大模型教程

👉3.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(篇幅有限,仅展示部分,公众号内领取)

电子书

👉4.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(篇幅有限,仅展示部分,公众号内领取)

大模型面试

**因篇幅有限,仅展示部分资料,**有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

**或扫描下方二维码领取 **

433

433

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?