第三章 神经网络 第三 四节

3.1和3.2讲的是矩阵非常基础的知识,这里就不复习了,线代学习的时候老师讲过。

神经网络内积

用numpy矩阵来实现神经网络,暂时忽略偏置和激活函数。如下示意图。

3层网络的实现

先定义符号,符号书上有一张图一看就会让读者很清楚。

加上偏置和权重,示意图是这样子的。

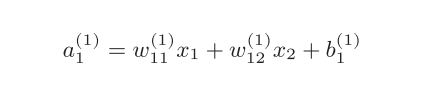

下一个神经元的表达式为:

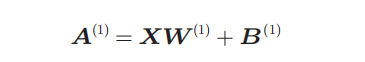

如果使用矩阵乘法来表示:

python代码实现

import numpy as np

X = np.array([1.0,0.5])

W1 = np.array([[0.1,0.3,0.5],[0.2,0.4,0.6]])

B1 = np.array([0.1,0.2,0.3])

print(W1.shape)

print(X.shape)

A1 = np.dot(X,W1)+B1

python实现前两层

import numpy as np

from activeFunction import sigmoid#我自己写的sigmoid函数

#ONE LAYER

X = np.array([1.0,0.5])

W1 = np.array([[0.1,0.3,0.5],[0.2,0.4,0.6]])

B1 = np.array([0.1,0.2,0.3])

print(W1.shape)

print(X.shape)

A1 = np.dot(X,W1)+B1

Z1 = sigmoid(A1)

print(A1)

print(Z1)

#TWO LAYER

W2 = np.array([[0.1, 0.4], [0.2, 0.5], [0.3, 0.6]])

B2 = np.array([0.1, 0.2])

print(Z1.shape) # (3,)

print(W2.shape) # (3, 2)

print(B2.shape) # (2,)

A2 = np.dot(Z1, W2) + B2

Z2 = sigmoid(A2)

print(A2)

print(Z2)

最后的输出层,只是激活函数不一样而已,其他步骤都是一样的。

def identity_function(x):

return x #激活函数

W3 = np.array([[0.1, 0.3], [0.2, 0.4]])

B3 = np.array([0.1, 0.2])

A3 = np.dot(Z2, W3) + B3

Y = identity_function(A3) # 或者Y = A3

print(Y)

输出层的激活函数用σ()表示,藏层的激活函数用h()(σ读作sigma)。

总结的代码

import numpy as np

import activeFunction as myfunctions #引入sigmoid等激活函数,函数是按照书上写的

def init_network():

network = {}

network['W1'] = np.array([[0.1, 0.3, 0.5], [0.2, 0.4, 0.6]])

network['b1'] = np.array([0.1, 0.2, 0.3])

network['W2'] = np.array([[0.1, 0.4], [0.2, 0.5], [0.3, 0.6]])

network['b2'] = np.array([0.1, 0.2])

network['W3'] = np.array([[0.1, 0.3], [0.2, 0.4]])

network['b3'] = np.array([0.1, 0.2])

return network

def forward(network, x):

W1, W2, W3 = network['W1'], network['W2'], network['W3']

b1, b2, b3 = network['b1'], network['b2'], network['b3']

a1 = np.dot(x, W1) + b1

z1 = myfunctions.sigmoid(a1)

a2 = np.dot(z1, W2) + b2

z2 = myfunctions.sigmoid(a2)

a3 = np.dot(z2, W3) + b3

y = myfunctions.identity_function(a3)

return y

network = init_network()

x = np.array([1.0, 0.5])

y = forward(network,x)

print(y)

嗯,加油看第5节。坚持坚持坚持,相信自己是最棒的。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?