logistic回归

目录

-

二元分类

所谓的二元分类就是区分是与不是,如下图这张图片是不是猫,是记为标签1,反之记为标签0

-

图像数据形式

如上图:图像分为三通道,分别是红、绿、蓝。一张图像在计算机上就是被保存为矩阵,矩阵的形状是n*n*3,

n*n是凸显的像素,每个矩阵的元素表示该点的像素值。

当图像输入神经网络时,一张图像的矩阵被重置为一个长度为n*n*3的列向量,即形状为(n*n*3,1),记作x。

-

logistic回归

logistic回归是一种二元分类,解决对输入进行预测,得出相对应的标签0或1,达到预测分类的目的。

具体地,我们将图片x经过二元分类模型,结果y是输出标签为1的概率,y的取值范围是0<=y<=1。

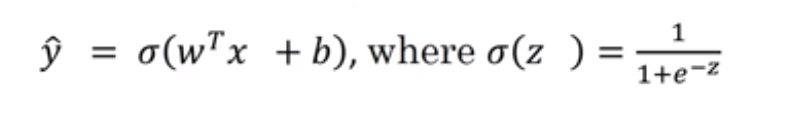

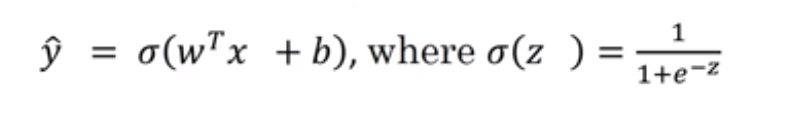

logisti回归函数有参数w和b,类似地线性回归函数z=wT*x+b,但是线性回归函数输出值不满足要求,因此线性回归

不是好的二元分类 算法

logistic回归实是在线性回归基础上进行修改,其函数为y=sigmod(z),z为=wT*x+b,sigmod(z)=1/(1+e^(-z)

sigmod(z)= 。函数图像为:

当x=0时,函数在为0.5;

当x无穷小时,函数值趋于0;

当x无穷大时,函数值趋于1;

因此该函数比较合适于二元分类。

-

logistic回归损失函数

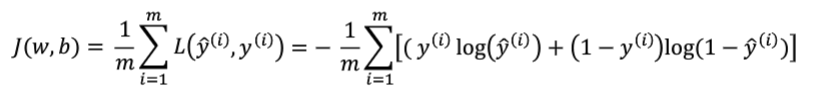

为了训练网络模型,我们需要定义一个损失函数,来计算预测值与实际值之间的差距,从而推进预测值的准确性。

logistic回归函数:

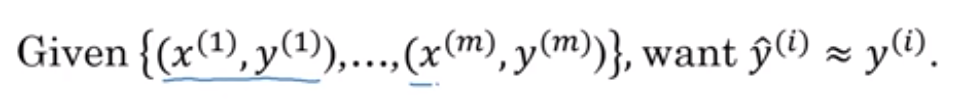

训练集:

其中上标表示样本,一共有m个样本,对应m个标签y。大括号表示有m个样本:

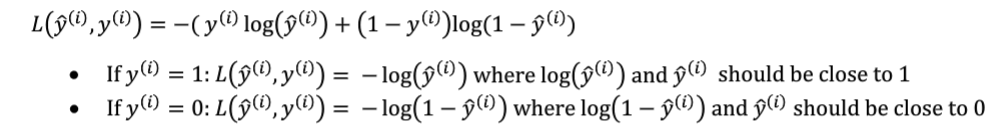

损失函数:

单个样本:

如果标签y=1时,通过该损失函数的特点得知,要使loss最小,预测值要越接近1;

如果标签y=0时,通过该损失函数的特点得知,要使loss最小,预测值要越接近0;

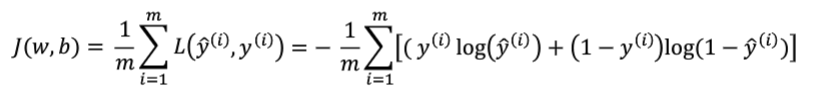

m个样本:

该成本函数公式表示:对每个样本求损失函数累加,再求平均值。

-

梯度下降法

解释:成本函数J(w,b)的图像如上图,是个凸函数,我们通过调整参数使得成本函数达到最小,

通过梯度下降法来找到下降最快的方向,从而能够更新参数,这里通过数学的求偏导数方法,即

对每个参数求J函数的偏导数,偏导数用于更新参数w,b:

每次更新完参数,参数变化导致成本函数值改变,并且越接近最小值,最后成本函数达到最优时,

训练就结束,参数也就不再改变。

-

总结

以上就是一个logistic回归的神经网络模型,将训练集(x,y)作为logistic回归函数的输入值,输入

二元分类的logistic回归函数,预测出概率,这是前向传播过程;通过预测值与标签的对比,即通过

成本函数,计算出成本函数值,在通过梯度下降法优化成本函数。这就是一个简单的logistic回归网

络模型。

-

logistic回归的几个重要公式

![]()

386

386

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?