1. 回归问题训练的基本步骤

ps: 也可以推广到其他问题的基本步骤

①选定合适的函数模型 ②对函数模型进行评估 ③梯度下降优化模型

1.1 选定函数模型

本例(宝可梦的进化后pc值的估计)选用的是线性模型,要待定的参数是w和b

1.2 对函数模型的评估

定义损失函数L,虽然形式会有不同,但描述的都正相关于真实值和估计值的差距

L是一个和w b相关的函数,本例中定义的是差值的平方和

1.3 梯度下降优化函数

随机梯度下降,随机选择初始值,确定初始值位置的斜率。斜率为正,初始值增加;斜率为负,初始值减小。因此,学习率之前为负号。所谓学习率指的是对于斜率的学习。进阶之后的算法,学习的未必只有该点处的斜率,可能还有全局或者局部的情况。

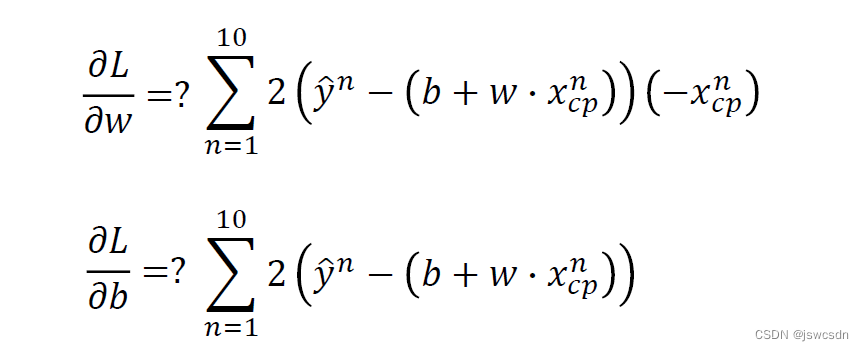

如果有两个参数,则是对偏导的学习。

以最简单的线性回归为例,线性回归是不会出现局部最优解的,只有全局最优解,偏导的结果就如同上式所示。

ps: 一些符号规定

代表真实值 或者标签

代表最优的函数f

右上标n代表object 右下标代表属性

2. 不同模型的预测结果

(overfitting and regularization)

2个问题

未必模型越复杂,效果就越好。虽然在训练集上,模型越复杂,错误率越低,但是测试集却未必是这样。 ——overfitting

哪些因素是必须要考虑到模型之内的因素

对于第二个问题,可以直接考虑所有的因素,加特征,常常导致式子复杂,容易overfitting

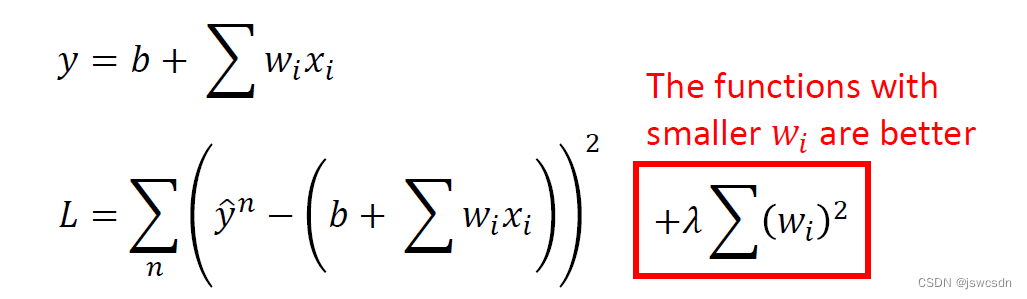

解决方法,正则化,regularization

正则化增加了λ项,考虑的影响,使得

尽可能得小,那么即考虑了各种因素,又使得各种因素的影响尽可能的小。一个平滑的曲线是更有可能正确的曲线。也未必λ要一味地大,过大了,各个w系数都会接近0,导致真正的特征没有考虑进去,模型欠拟合。λ有一个最佳值。

303

303

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?