本地部署Ollama

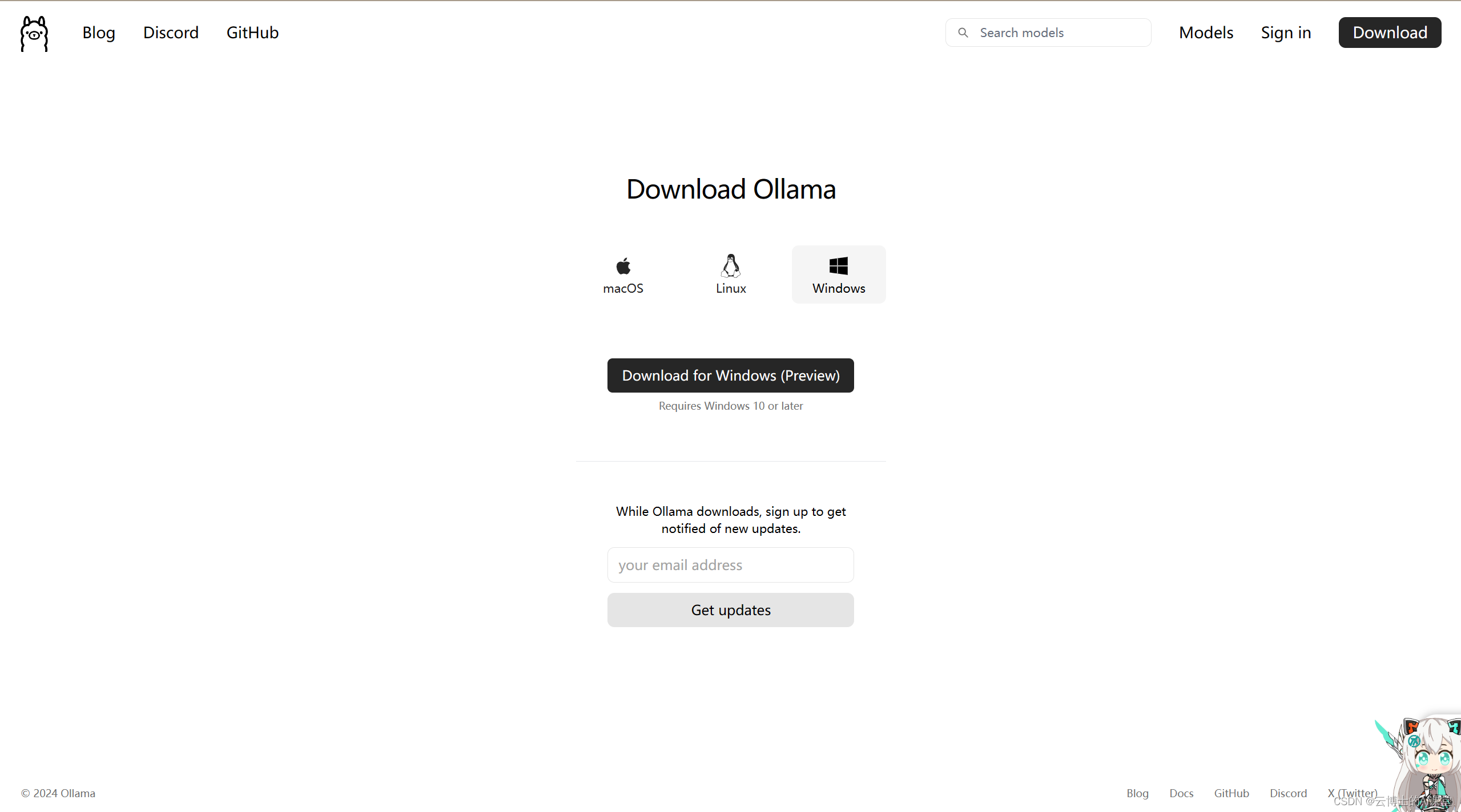

- Ollama是一个开源的大型语言模型服务工具,它帮助用户快速在本地运行大模型,通过简单的安装指令,可以让用户执行一条命令就在本地运行开源大型语言模型。软件地址:Download Ollama on Windows。

- 本地部署:

- 打开上述安装网址,选择windows,点击download for windows(preview)安装

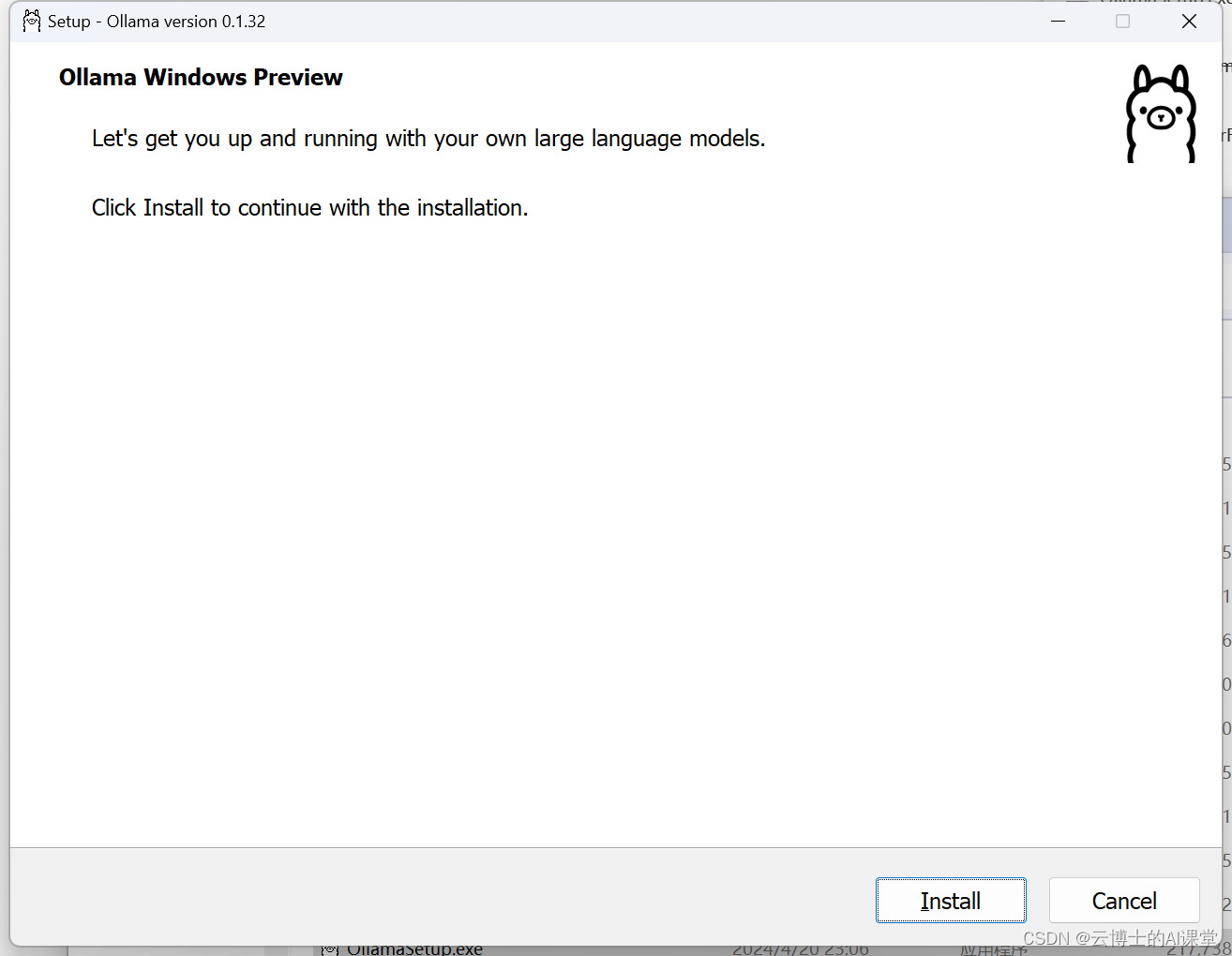

- 下载完成后双击进行安装,按提示安装即可,无需额外操作。

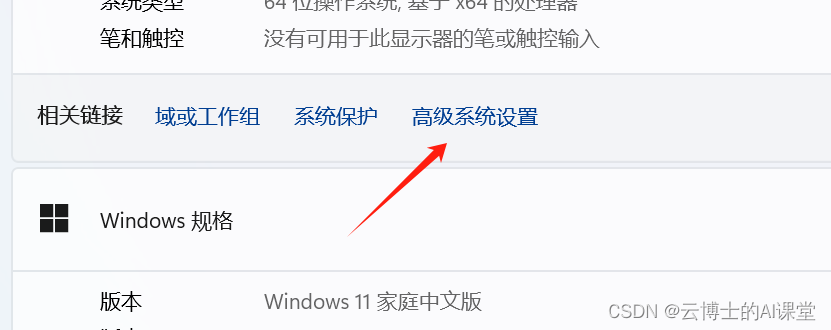

- 修改环境变量(默认模型下载至C盘)右键此电脑选择属性->高级系统设置->环境变量->用户变量->新建

设置完成后重启电脑生效修改

- 使用Ollama

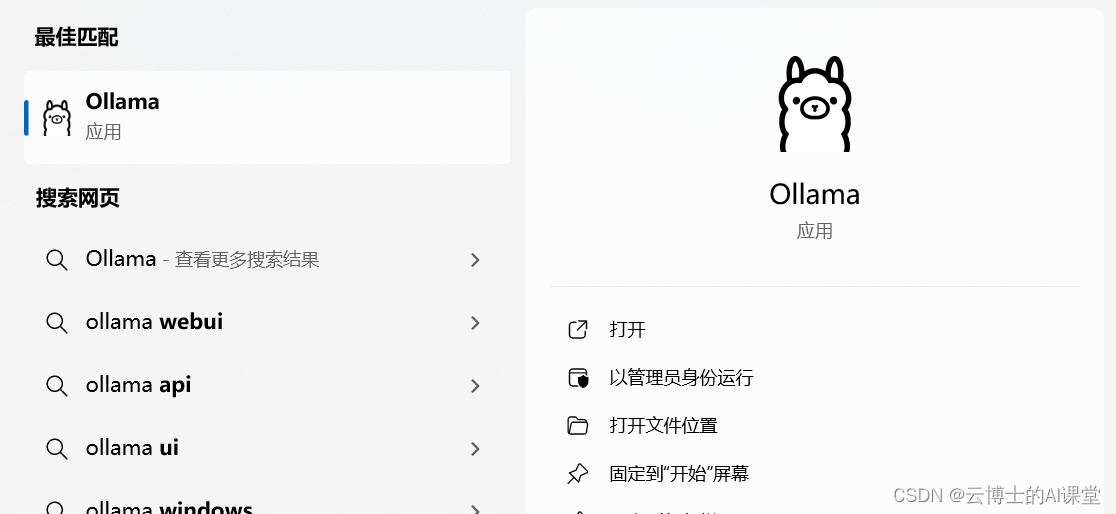

- 搜索栏搜索打开,确保Ollama在任务栏

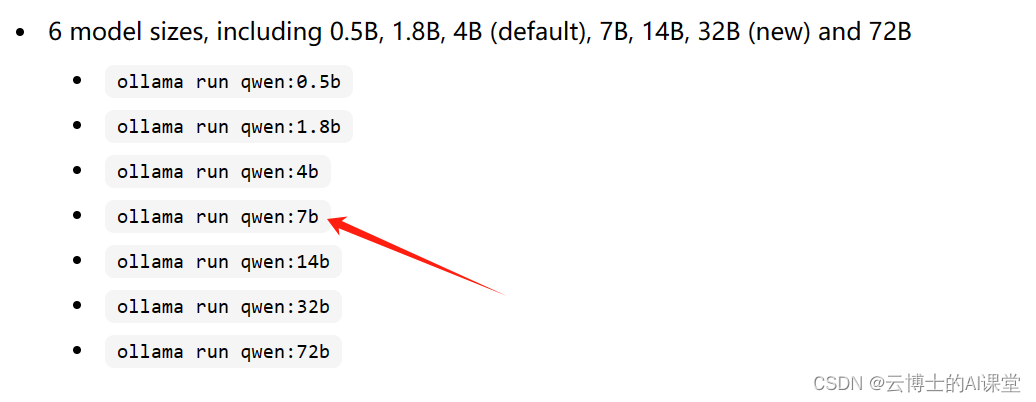

- 访问library (ollama.com),以 qwen-7b 为例,搜索qwen,选择运行 7b 的模型

- 打开cmd,将7b模型的下载命令键入并等待下载

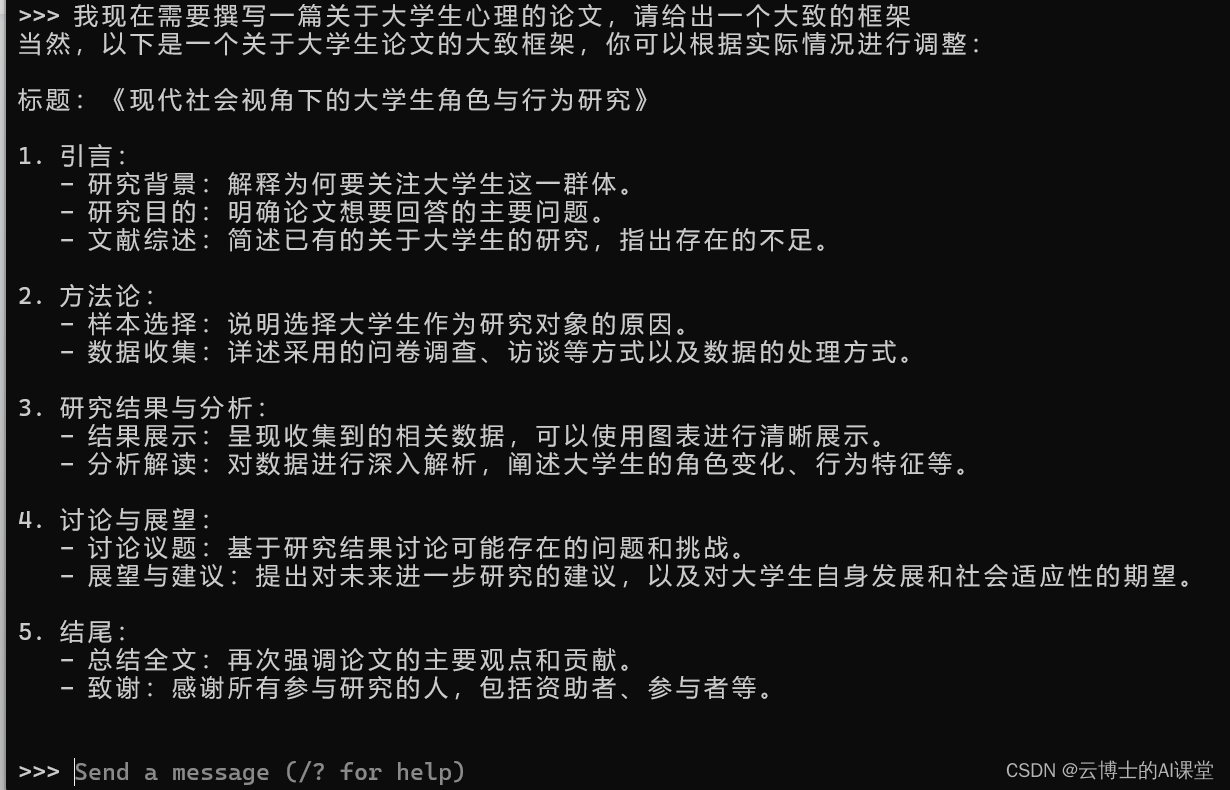

- 前95%下载速度快,99%到100%速度较慢。当出现 Send a nessage 即可开始模型的使用

- 使用,如图

- 再次使用

在cmd输入运行代码(如ollama run qwen:7b)即可免下载安装直接使用(该模型在之前已安装成功)

9994

9994

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?