第13节 伯努利分布:是或否的随机抉择

在概率论的丰富世界中,伯努利分布以其简洁而强大的特性,成为描述二元随机事件的基石。它专注于“是”或“否”、“成功”或“失败”等两种可能结果的随机过程,为理解和建模复杂决策提供了基础。本节将深入探讨伯努利分布的定义、性质及其在人工智能(AI)中的实际应用,通过五个具体案例,展示伯努利分布在现代AI技术中的关键作用。

13.1 伯努利分布概述

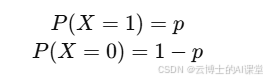

伯努利分布是一种离散概率分布,用于描述在单次试验中仅有两种可能结果的随机变量。设随机变量X表示一次伯努利试验的结果,其中:

- X=1 表示“成功”;

- X=0 表示“失败”。

伯努利分布由参数p定义,表示“成功”发生的概率。其概率质量函数(PMF)为:

示例: 掷一枚公平的硬币,定义“正面”为成功,“反面”为失败,则p=0.5。

伯努利分布是许多更复杂分布的基础,如二项分布和几何分布,广泛应用于统计学和机器学习中的各种场景。

13.2 伯努利分布的性质

- 二元性: 伯努利分布只涉及两个可能结果,适用于所有需要二元决策的场景。

- 独立性: 多次独立的伯努利试验组成的随机变量序列服从二项分布。

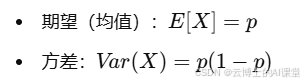

- 期望与方差:

- 无记忆性: 每次伯努利试验的结果仅依赖于当前试验,不受之前结果的影响。

13.3 伯努利分布在AI中的五大应用案例

伯努利分布在AI的多个领域中发挥着关键作用,以下通过五个具体案例,探讨其实际应用。

案例一:二元分类模型中的输出

在机器学习中,二元分类问题要求模型将输入数据分类为两个类别之一,如垃圾邮件识别(“垃圾”或“非垃圾”)。

应用解析: 模型的输出通常采用伯努利分布来表示预测结果。比如,逻辑回归模型输出一个概率pp,表示输入属于正类的概率。最终分类决策可以通过比较p与阈值(如0.5)来确定是“正类”还是“负类”。

计算例子: 若模型输出p=0.7,则预测结果为“正类”(1);若p=0.3,则为“负类”(0)。

案例二:强化学习中的动作选择

在强化学习中,智能体需要在多个动作中选择最优策略。对于某些问题,动作选择可以简化为二元决策。

应用解析: 使用伯努利分布来建模智能体选择某一动作的概率。例如,在探索与利用的权衡中,智能体以概率p选择“探索”(随机动作),以概率1−p选择“利用”(最佳已知动作)。

计算例子: 设p=0.1,智能体有10%的概率进行探索,90%的概率利用当前最优策略。

案例三:神经网络的Dropout机制

在深度学习中,Dropout是一种正则化技术,用于防止过拟合,通过随机忽略部分神经元的激活。

应用解析: Dropout操作使用伯努利分布决定每个神经元是否被“丢弃”。具体而言,每个神经元以概率p被保留,以概率1−p被忽略。

计算例子: 若设定p=0.8,则每个神经元有80%的概率在训练过程中保持激活状态,20%的概率被暂时忽略。

案例四:生成模型中的噪声生成

在生成对抗网络(GAN)和变分自编码器(VAE)等生成模型中,噪声向量的生成是关键步骤之一。

应用解析: 伯努利分布可用于生成二值噪声,作为模型的输入。例如,在生成离散数据(如文本、图像二值化)时,使用伯努利分布生成随机噪声以增强生成样本的多样性。

计算例子: 对于一个长度为10的二值向量,每个位置的值由伯努利分布Bernoulli(p=0.5),独立生成,如[1, 0, 1, 1, 0, 0, 1, 0, 1, 0]。

案例五:A/B测试中的决策分析

在产品开发和优化中,A/B测试用于比较不同版本的效果,通过统计分析决策最优方案。

应用解析: 每个用户被随机分配到A组或B组,分配过程可用伯努利分布建模。成功与否(如是否点击)也可用伯努利分布描述,从而评估不同版本的效果差异。

计算例子: 若用户被分配到A组的概率为0.5,B组亦为0.5,则可以通过对比两组的点击率(和

)来判断哪一版本更优。

13.4 伯努利分布的优势与局限

优势:

- 简单直观: 伯努利分布模型简单,易于理解和实现。

- 高效计算: 由于只有两个可能结果,计算期望和方差等统计量非常高效。

- 广泛适用: 适用于所有需要二元决策和建模的场景。

局限:

- 二元限制: 仅适用于两种可能结果,无法直接处理多类别或连续结果。

- 独立性假设: 多次伯努利试验通常假设独立性,现实中许多决策可能存在依赖关系。

- 概率设定: 需要准确估计成功概率pp,在动态环境中可能需要频繁调整。

13.5 结语

伯努利分布作为概率论中最基本的分布之一,以其简洁性和二元性,在AI的多个领域中扮演着重要角色。从二元分类模型到强化学习的动作选择,从神经网络的正则化到生成模型的噪声生成,再到A/B测试的决策分析,伯努利分布无处不在。然而,理解其优势与局限,有助于在实际应用中更有效地利用这一工具,推动AI技术的持续发展与创新。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?