Alex Krizhevsky在ImageNet大赛中获胜的代码的说明文章

1. 整体架构

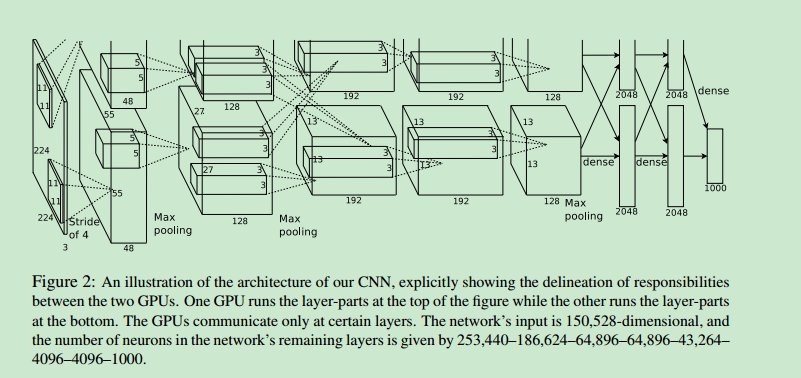

Overall Architecture

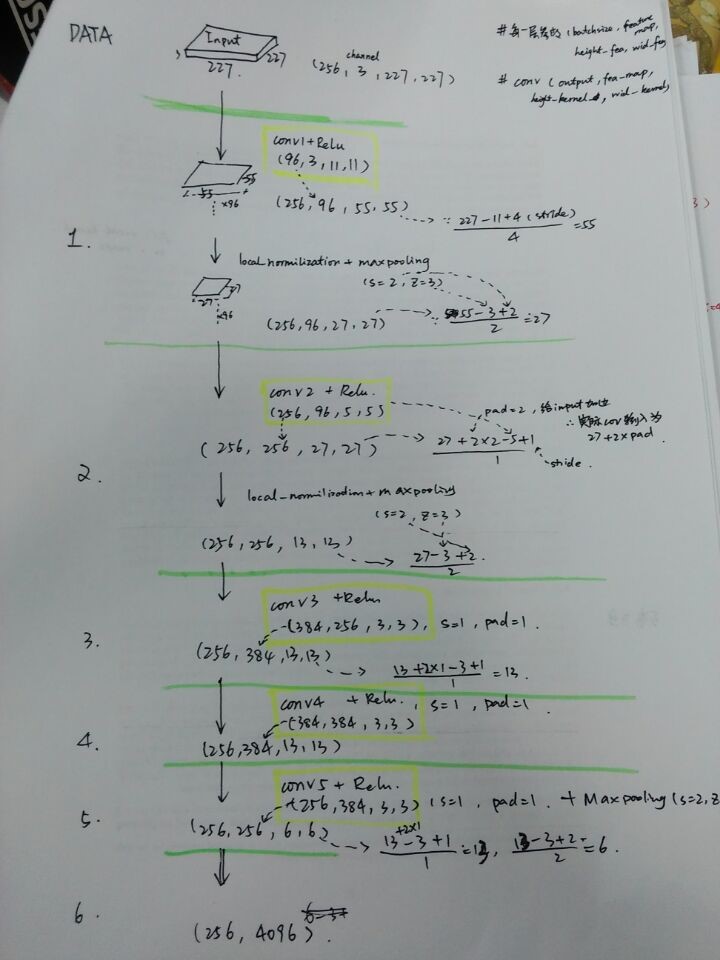

//概括:5个卷积层+3个全连接层+1个softmax层。在第1,2,5个卷积层后加了一个LRN和Max Pooling。

每层的尺寸演算

2. 创新点

2.1 ReLU

//概括:不用simgoid和tanh作为激活函数,而用ReLU作为激活函数的原因是:加速收敛。

因为sigmoid和tanh都是饱和(saturating)的(他们的导数都是倒过来的碗状,i.e.,越接近目标,对应的导数越小)。而ReLu的导数对于大于0的部分恒为1。于是ReLU确实可以在BP的时候能够将梯度很好地传到较前面的网络。

2.2 Local Responce Normalization

//概括:本质上,这个层也是为了防止激活函数的饱和的。

个人理解原理是通过正则化让激活函数的输入靠近“碗”的中间,从而获得比较大的导数值。

所以从功能上说,跟ReLU是重复的。

不过作者说,从试验结果看,LRN操作可以提高网络的泛化能力,将错误率降低了大约1个百分点。

2.3 Reducing Overfitting

本文是关于Alex Krizhevsky使用深度卷积神经网络在ImageNet大赛中获胜的论文笔记,介绍了网络架构,包括5个卷积层、3个全连接层和1个softmax层。关键创新点包括ReLU激活函数、局部响应归一化(LRN)、数据增强(如随机crop和PCA扰动)以及重叠池化和dropout技术,这些都有助于防止过拟合。尽管网络庞大,但经过精细调整,模型在ILSVRC-2012上的表现为top1错误率40.7%,top5错误率18.2%。

本文是关于Alex Krizhevsky使用深度卷积神经网络在ImageNet大赛中获胜的论文笔记,介绍了网络架构,包括5个卷积层、3个全连接层和1个softmax层。关键创新点包括ReLU激活函数、局部响应归一化(LRN)、数据增强(如随机crop和PCA扰动)以及重叠池化和dropout技术,这些都有助于防止过拟合。尽管网络庞大,但经过精细调整,模型在ILSVRC-2012上的表现为top1错误率40.7%,top5错误率18.2%。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

195

195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?