#写在最前,deeplearning.ai系列课程相较于之前的Andrew Ng在coursera上2014发布的机器学习课程内容更加丰富。

重要的是此次课程示例代码都是用python来实现,不需要去熟悉octave,对大部分需要用python来学习机器学习的同学来说是个福音!

原课程视频请移步网易云课堂或者coursea上学习。

#本文内容部分来自网络,只为自己学习以及分享供更多的人学习使用

1、深层神经网络

第 l 层神经网络,单个样本其各个参数的矩阵维度为:

- W[l] : (n[l],n[l−1])

- b[l] : (n[l],1)

- dW[l] : (n[l],n[l−1])

- db[l] : (n[l],1)

- Z[l] : (n[l],1)

- A[l]=Z[l] : (n[l],1)

- 用 L 表示层数,该神经网络 L=4

-

n[l]

表示第

l

层的神经元的数量,例如

n[1]=n[2]=5,n[3]=3,n[4]=1

- a[l] 表示第 l 层中的激活函数, a[l]=g[l](z[l])

2、前向传播和反向传播

- L:DNN的总层数;

- n[l] :表示第 l 层的包含的单元个数;

- a[l] :表示第 l 层激活函数的输出;

- W[l] :表示第 l 层的权重;

- 输入 x 记为 a[0] ,输出 ŷ 记为 a[L] 。

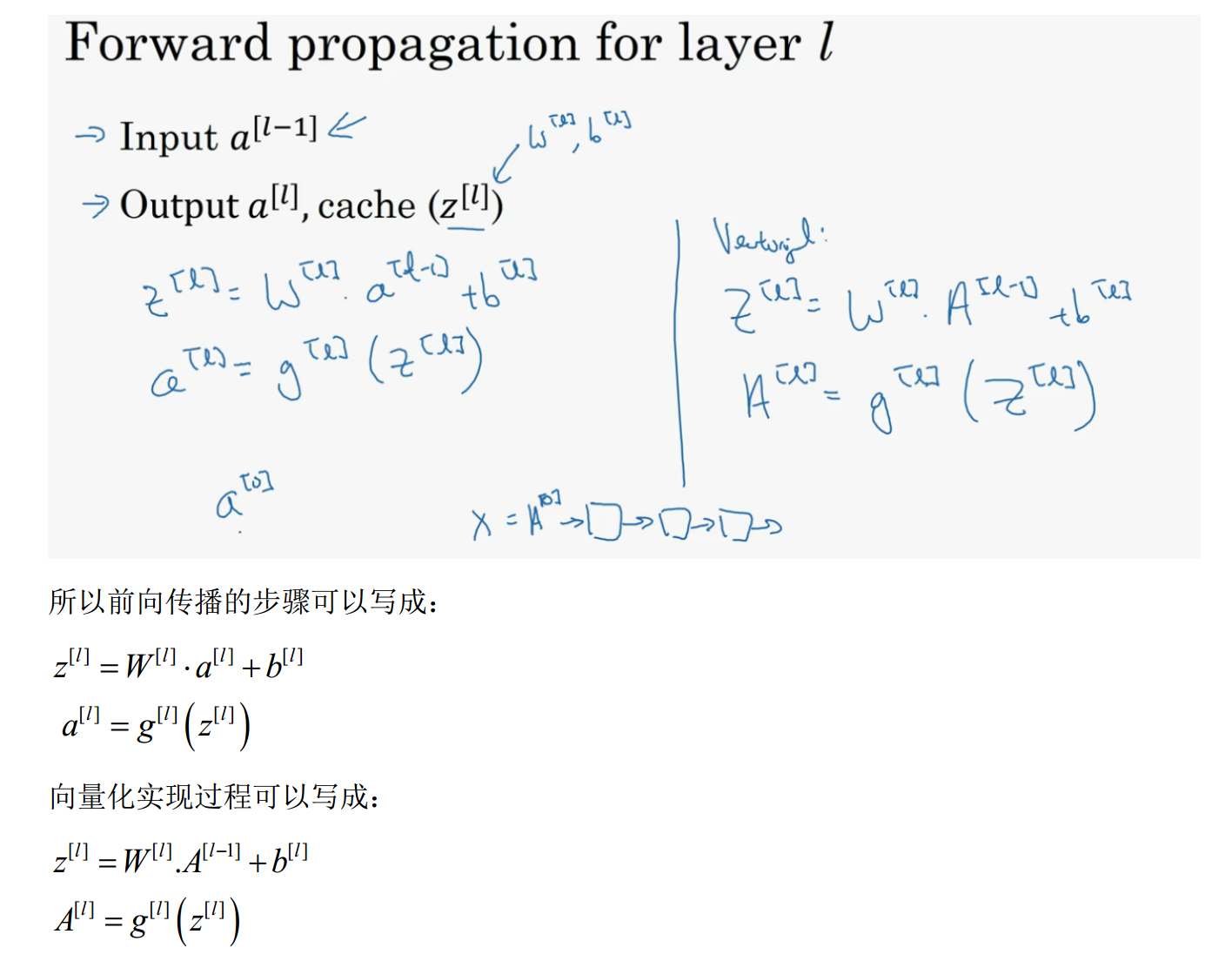

对于前向传播(Forward propagation)

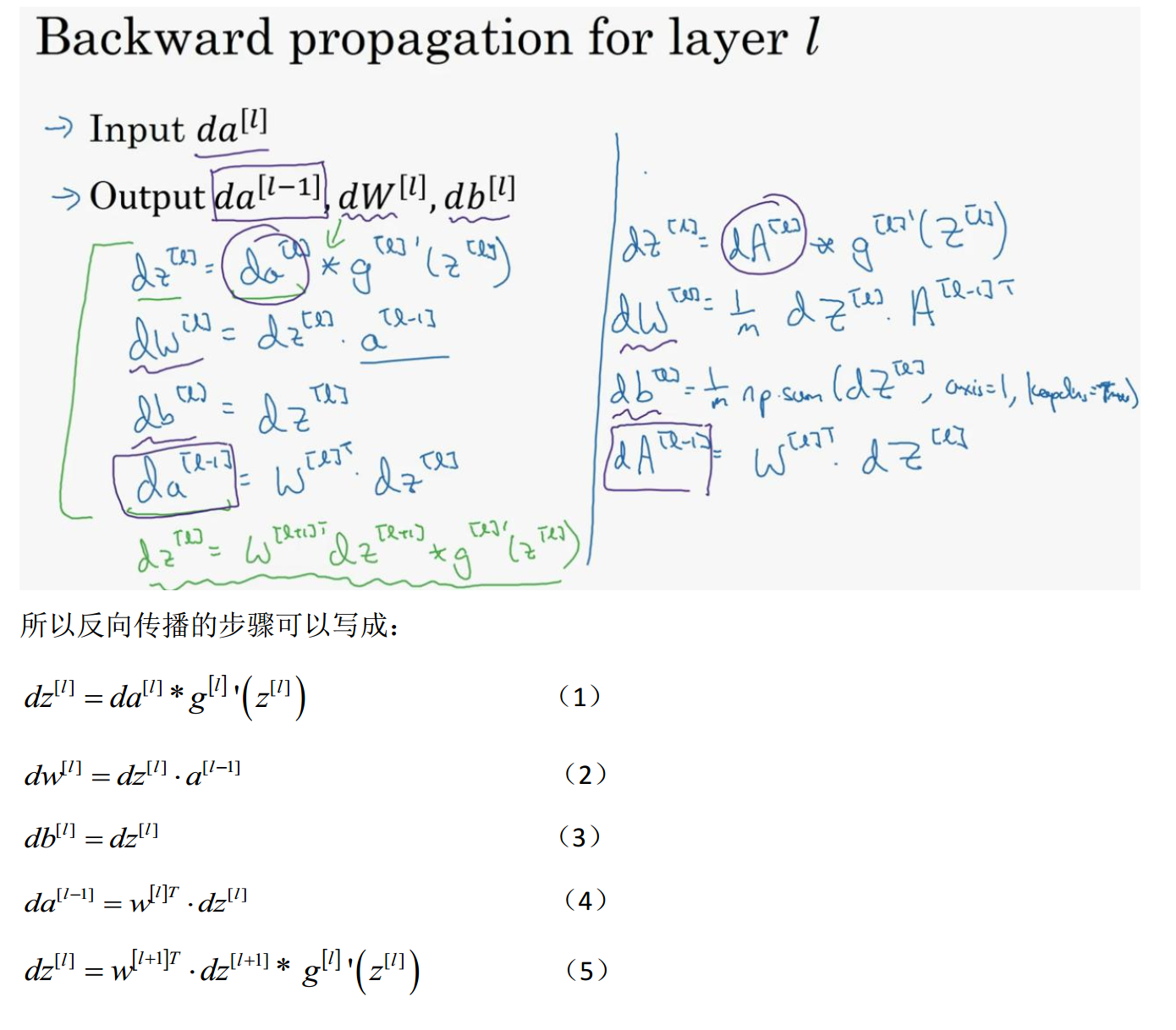

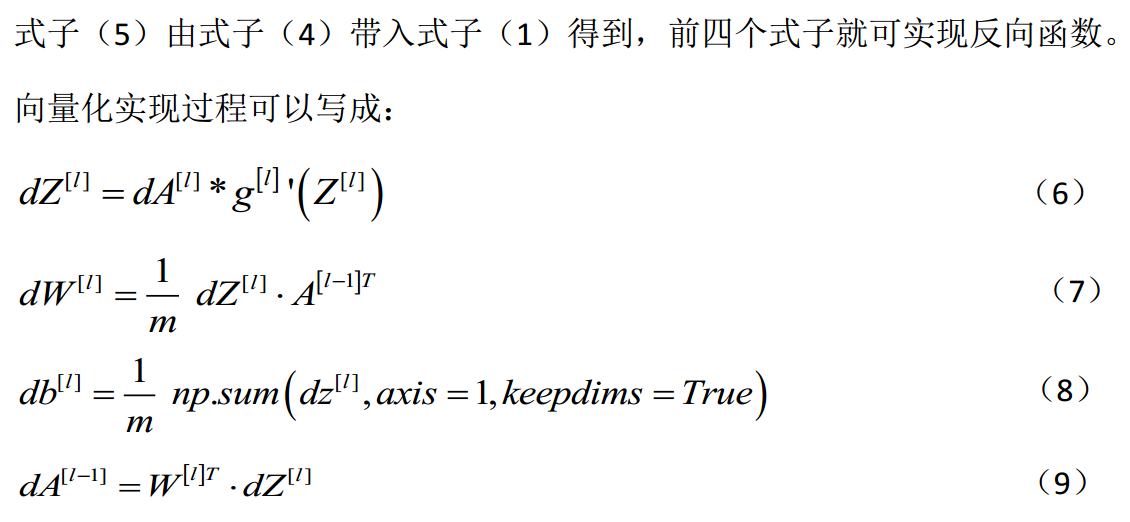

而对于反向传播(Backward propagation)

用图形简单表示为:

3、超参数

参数:

参数即是我们在过程中想要模型学习到的信息, W[l],b[l] 。

超参数:

超参数即为控制参数的输出值的一些网络信息,也就是超参数的改变会导致最终得到的参数 W[l],b[l] 的改变。

例如:

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?