项目地址:AGG: Amortized Generative 3D Gaussians for Single Image to 3D

摘要

目前基于优化的3D生成需要许多计算成本高的分数蒸馏步骤。

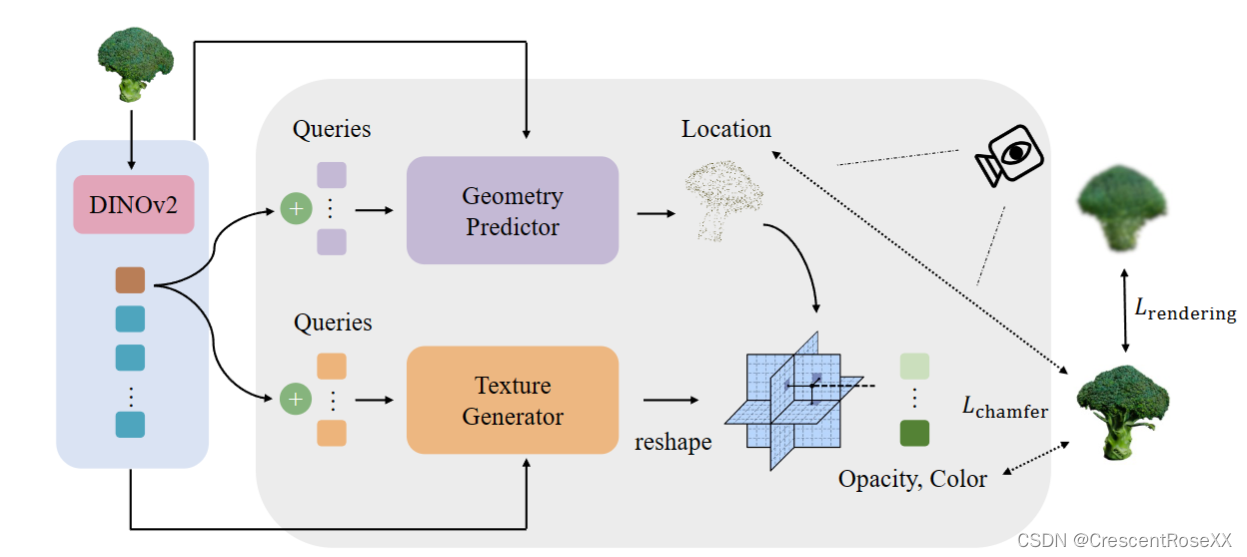

利用中间混合表示,AGG分解三维高斯位置的生成和其他外观属性进行联合优化。

此外,我们提出了一个级联管道,它首先生成 3D 数据的粗表示,然后使用 3D 高斯超分辨率模块对其进行上采样。

介绍

虽然 3D 高斯可以通过自适应密度控制进行优化以表示某些几何形状,但初始化对于复杂的对象结构仍然至关重要。

高度希望摊销 amortized 管道一次性生成 3D 高斯。但是有两个挑战。

- 原3D高斯用的density control,这导致动态数量的 3D 高斯,因此很难在摊销的训练设置中预测它们。

- 其次,3D 高斯需要经过策划的初始化 [8, 59]。在摊销amortized设置中,神经网络预测 3D 高斯,这导致需要很好地初始化网络。

- 此外,优化过程通常倾向于更新 3D 高斯的外观,而不是直接将它们的位置移动到所需的 3D 位置。

我们的方法两阶段,由粗到细。

在第一阶段,我们采用混合生成器,以粗分辨率生成 3D 高斯。在这个阶段,我们将几何和纹理生成任务分解为两个不同的网络。几何transformer 解码从预先训练的图像特征提取器中提取的图像特征,并预测3D高斯的位置。另一个纹理转换器类似地生成一个纹理字段,稍后由高斯位置查询以获得其他点属性。

在第二阶段,我们利用点体素卷积网络来有效地提取局部特征,并从前一阶段对粗3D高斯进行超分辨。

贡献:

- 我们对平摊单幅图像到三维高斯设置的任务进行了初步研究。与在单个对象上运行的现有工作不同,我们构建了一个新颖的级联生成框架,该框架立即一次性呈现 3D 高斯。

- 我们的AGG网络首先通过分解几何和纹理的混合表示生成粗略的高斯预测。通过两个独立的transformer预测几何和纹理信息,可以联合优化三维高斯属性。

- 第二阶段介绍了一种基于unet的具有点体素层的架构,有效地超分辨率了3D高斯。

- 实验牛。

方法

目标:使用神经网络从单个图像生成 3D 高斯 in one shot。

我们的级联方法首先构建一个混合生成器,它将输入图像特征映射到一组简洁的 3D 高斯属性。随后,使用具有点体素层的 UNet 架构来超分辨率 3D 高斯表示。

3.1 高斯背景

遵循三维高斯溅射中的惯例,但是也有改动。首先降低球谐系数的程度,只允许3D高斯漫反射颜色,此外,我们为 3D 高斯设置了规范各向同性尺度和旋转,因为我们发现这些属性在摊销优化过程中非常不稳定。

3.2 Coarse Hybrid Generator

使用vision Transformer对输入图像编码,随后,构造一个几何和纹理生成器,将可学习的查询分别映射到位置序列和纹理场。然后将这种混合表示解码为显式的3D高斯,从而实现高效的高分辨率渲染,并通过多视图图像促进监督。

通过多视图图像上定义的渲染损失进行训练,并使用 3D 高斯伪标签以倒角距离损失预热。

Encoding Input RGB Information. 以前的方法用CLIP,但是这毕竟不是用来提特征的,所以用预训练的DINOV2。

Geometry Predictor. location信息是通过3D均值向量来的,3维向量。采用了一个基于Transformer的网络。Transformer输入是一组可学习的查询,由一组可学习的位置嵌入实现。在输入到变压器网络之前,位置嵌入与从DINOv2模型中提取的全局标记[CLS]相加。

Transformer架构遵循DINOV2, 还用了cross attention.

Texture Field Generator. 预测纹理一个主要的挑战是在 3D 空间中缺乏对纹理的直接基本事实监督。相反,纹理信息是通过2D中的渲染损失来推断的。

为了解决这个问题,使用不同的Transformer来生成纹理场。我们的纹理场是使用三平面[5]实现的,辅以共享解码MLP头。三平面接受几何分支的3D位置查询,输出纹理。利用该纹理场有助于分解几何和纹理信息的优化,并且不正确的几何预测不影响纹理分支的优化过程。

Supervision Through 2D Renderings. 我们利用LPIPS[63]和L1损失来最小化它们的差异.

![]()

3.3. Gaussian Super Resolution

主要关注于细化局部细节。为简单起见,我们使用具有有效点体素层的轻量级 UNet 架构 。

Latent Space Super-Resolution. 我们执行特征扩展作为直接扩展点数的代理。通过点体素卷积编码器,我们首先将阶段一个粗糙的3D高斯转换为紧凑的潜在特征

Incorporating RGB information. 由于振荡点位置和粗糙几何形状,纹理场可能会收敛到模糊的结果。我们将 RGB 特征引入 UNet 架构的瓶颈。具体来说,我们在特征扩展操作之前和之后采用交叉注意力层。

图 2. 我们粗混合生成器的架构。我们首先使用预训练的DINOv2图像编码器提取基本特征,然后采用两个变压器,分别将可学习的查询标记映射到高斯位置和纹理场。纹理字段接受来自几何分支的位置查询,解码 MLP 进一步将插值平面特征转换为高斯属性。

2434

2434

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?