Garment modeling from a single image

导师给的第一篇论文文件名是PG13,这名字还真是..是不是以后还会有R什么的..

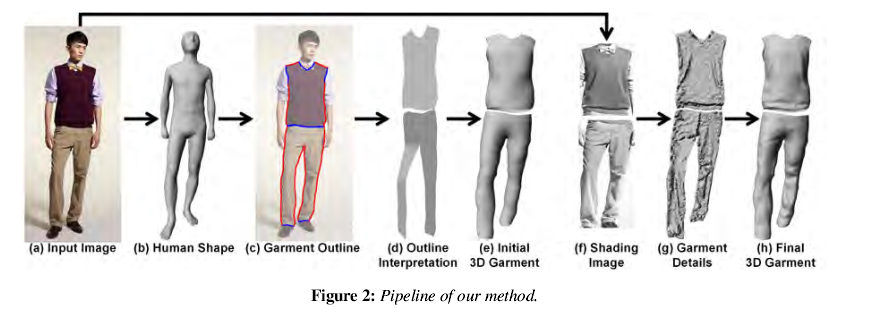

整个论文的意思就是从单张图片中提取衣服的3d模型,支持各种姿势(pose-aware)其中衣服的褶皱通过Shading Based Garment Detail Recovery技术(这部分没看懂),这个算法世界一流

- 输入单张图片

- 提取人体模型,这里用了前人的技术

- 从单张图片提取衣服的轮廓,分为穿越身体的和不穿越身体的,分别用蓝线和红线表示

- 先是用1里面得到的3d关节点,投影到2d关节点,再把outline投影到2d关节点上,就有了裤子穿在腿上的形状,不过还是2d的

- 用某种技术把2d升级到3d,如图e

- 从图片中获取衣服的阴影

- 获取深度信息贴在3d模型上

- tada~ 精致的图片就出现了

大概就是这个意思,shading那一段有一些矩阵的计算,没看懂

文章后面跟别的算法比较了一下,表明了自己是最好的,并且是通过单张图片,别人都是视频,或者或者多张图片,我只要一张哦~ 而且我的细节跟更丰富哦~

最后说了一下不足

- 是因为从单张图片提取,所以该算法假设衣服前后对称,所以对于前后不一样的衣服,这个算法就不能完美实现了。不过这是基于单张图片的硬伤,没办法。我想是不是可以做个两张图片的,或者四张,前后左右,这样衣服还原性更高

- 如果图片中有东西遮挡了衣服,outline看不到也不行了,硬伤+1。。。

- 作者假设衣服表面满足Lambertian assumption(把shading贴到3d时候用到的),作者也说这个假设只对棉毛什么的比较合适,对丝绸一类的实现不好。

1304

1304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?