1.关于deep learning(主要指cnn)调参的经验?

解析:深度学习整体上是越来越成熟的,不管是框架还是卷积神经网络,关于每个网络初始化参数和超参数的配置虽然有区别,但相似点似乎更多。

1)激活函数,首选Relu。

2)dropout 。这个从AlexNet延续至今,理由很简单可有效防止过拟合。不宜设置过大,太大的话容易造成网络的不收敛。一般设置0.5。

3)数据预处理,做shuffle 和augmentation。shuffle的最大作用我认为是打乱样本顺序,绕开局部最优解,随机化了梯度下降。augmentation基于数据,可以的话还是有必要扩大数据集的(opencv就可以的,如果数据实在很棒可以上GAN试试)

4)降学习率。fine-tuning的时候也要根据网络设置合适的学习率。一般学习率越小越好。

5)看日志。TensorFlow可以通过查看tensorboard(端口默认6006),caffe可以解析log日志,画图查看学习率\迭代次数、loss的关系。至于Pytorch可以用Visdom 。

6)batchsize。batchsize的话看机器设定,通常设置为2的n次幂。机器允许的情况设置值尽量大。

7)减mean。

8)batchnormalize。批规范化,BN本质上解决的是反向传播过程中的梯度问题,为了防止梯度弥散。可尝试用来解决梯度爆炸问题。

2.LSTM为什么比RNN好?

解析:因为LSTM有进有出且当前的cell informaton是通过input gate控制之后叠加的,RNN是叠乘,因此LSTM可以防止梯度消失或者爆炸。

3.关于CNN中激活函数?

解析:主要使用的Relu,Tanh,sigmoid。巴拉巴拉看链接。

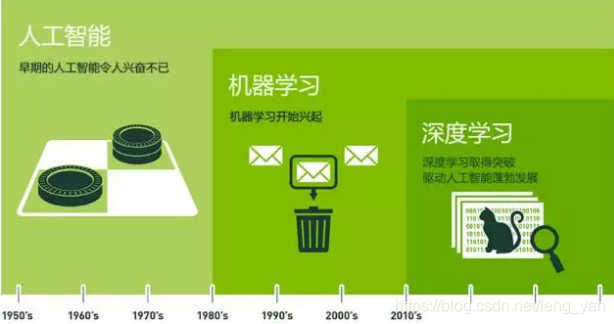

4.人工智能、机器学习与深度学习的联系?

解析:人工智能(AI):机器被赋予的人的智能;机器学习(ML):一种实现人工智能的方法;深度学习(DL):一种实现机器学习的技术。我认为三句话就概括了三者的关系。

我认为就是包含关系,但是开题的时候涉及到这却被学校的老师狠狠的怼了。到现在我感觉对这一块的看法还是停留在三年前,欢迎留言指教。

人工智能的概念太大了,不发表意见。

机器学习算法主要包括:分类、回归、聚类、推荐等等。这里面又有很多经典的算法,比如贝叶斯算法,SVM,决策树,随机森林等等。

深度学习目前主要应用比较成功的领域主要有:图像识别、语音识别和自然语言处理(NLP)。我主要做图像这块,这块目前主要涉及图像目标检测、目标识别、图像语义分割。图像目标检测主要分为one-step(SSD\YOLO系列)和two-step(Faster-RCNN)。图像语义分割主要算法有Mask-RCNN、DeepLab系列。建议以上涉及算法详细看看(强化学习和迁移学习并列与深度学习,也可了解一下)。

5.什么情况下不建议使用深度学习?

1)数据集太小,数据集太小的话,深度学习相对其它机器学习算法,没有明显优势。

2)数据集没有局部相关特性。如图像的数据格式和语音的数据格式就不一样。

关于深度学习的几个问题(一)

最新推荐文章于 2022-03-14 22:21:52 发布

45万+

45万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?