1、什么时候用集成学习?

集成学习有利于减少模型方差,因此当模型复杂度复杂度太高时可以用集成学习方法

参加kaggle等比赛的时候

2、bagging和boosting的基学习器有一样的特点?

bagging的基学习器更强一些,它们学习的对象都是目标任务,最终的预测模型是直接拿子模型的决策结果投票或者做平均;boosting的基学习器更弱一些,可以说是非常弱,它们学习的都只是目标任务的一部分(可以这么理解),即使自己的任务学习的很好,看起来也很弱,所以这种弱是相对整体学习任务而言的。

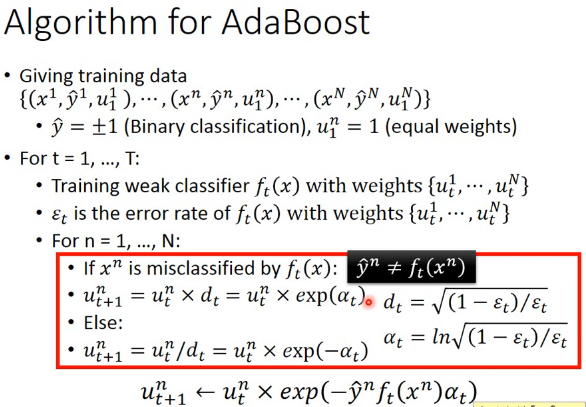

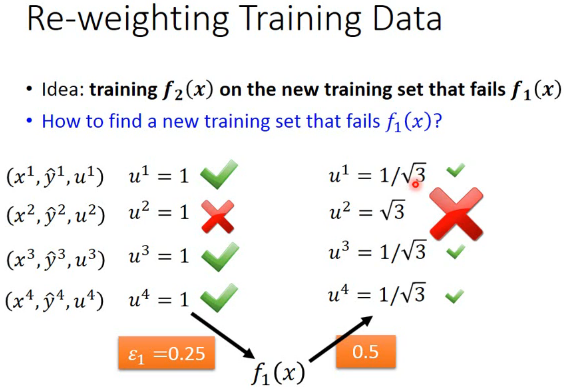

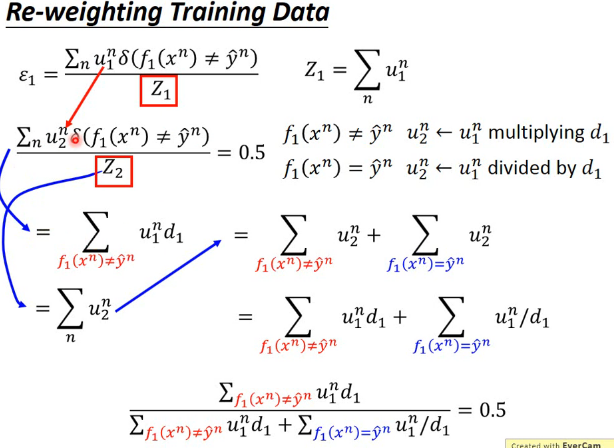

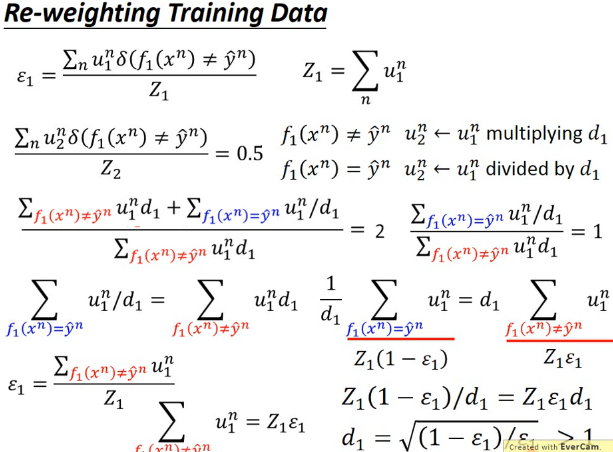

3、Adaboost算法

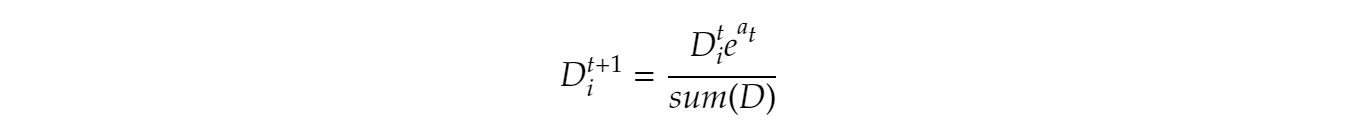

为了把样本权重更新公式简化成一个,用at替换掉dt。

dt的推导:

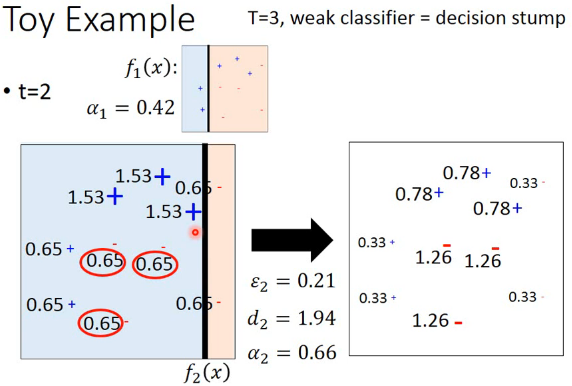

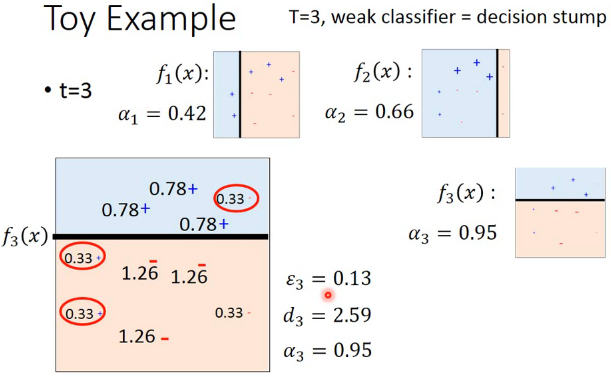

一个小例子:

按照前面所述,这里的d貌似没有必要计算;而且,这里貌似用a同时作为样本和子模型的权重更新乘子。应该用a作为子模型的权重更新乘子,同时,对某个样本而言,其权重

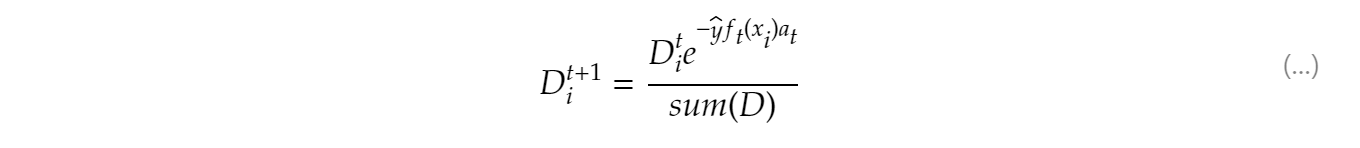

更新公式为:

当样本被正确分类时

当样本被误分类时

或者合并为

D表示所有样本的权重构成的向量。

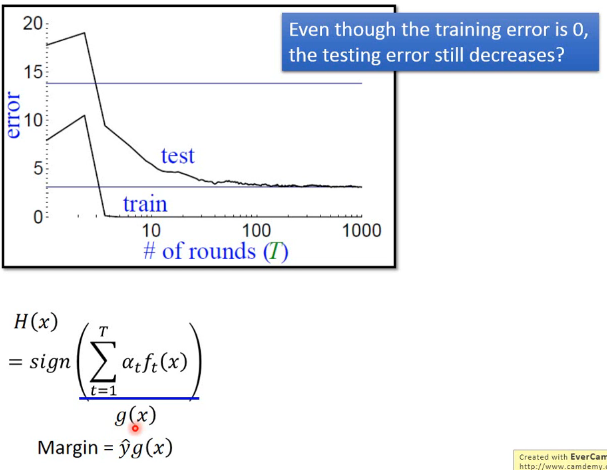

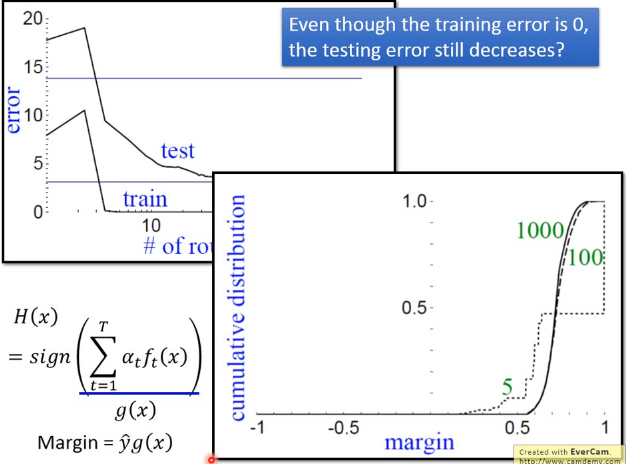

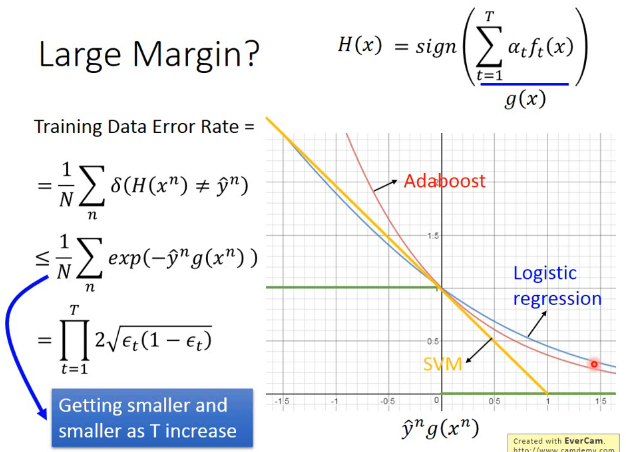

4、为啥训练错误率已经为0了测试错误率还在下降?

因为margin在增大,这使得模型越来越鲁棒

484

484

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?