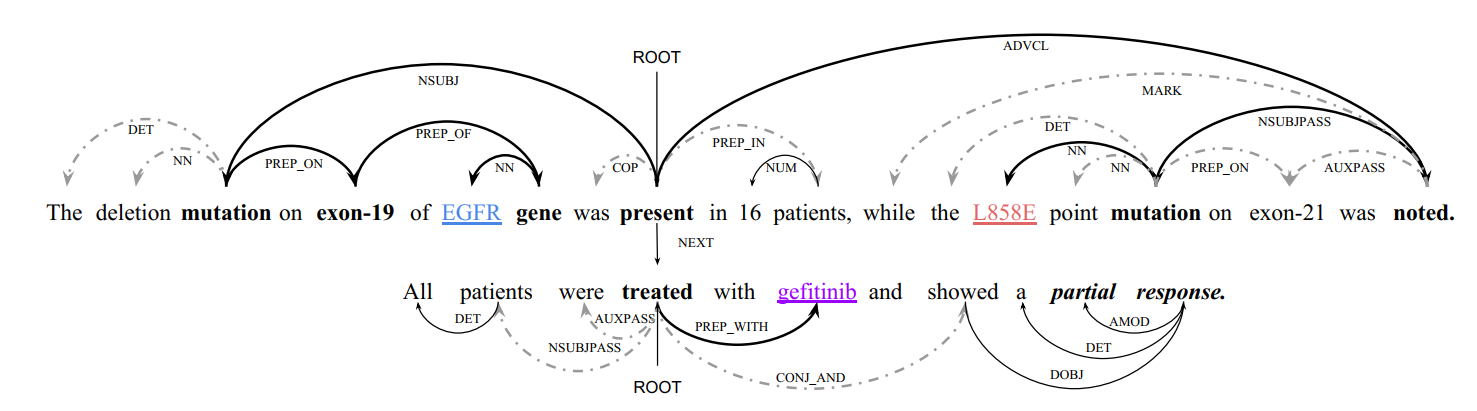

把句法依存树当成输入

在n元关系抽取,大规模句子级别关系抽取都能充分利用依存树的信息

https://github.com/Cartus/AGGCN_TACRED

创新:

提出soft pruning策略,把一颗完整的依存树送到全连通边加权图里。

这里的权重就通过attention学习得到

GCN

给定一个图,有n个节点,我们可以用 n ∗ n n*n n∗n的邻接矩阵表达这个图结构。

可以把边的方向性扩展到模型中,用来编码依存树

每个结点都添加一个自环

如果依存树里节点i到节点j有边,那在邻接矩阵里 A i j = 1 A_{ij}=1 Aij=1, A j i = 1 A_{ji}=1 Aji=1。否则就都是0

第 l l l层节点 i i i卷积的运算,把输入特征的表示 h l − 1

把句法依存树当成输入在n元关系抽取,大规模句子级别关系抽取都能充分利用依存树的信息https://github.com/Cartus/AGGCN_TACRED文章目录创新:GCN注意力引导层密连接层线性组合层关系抽取层创新:提出soft pruning策略,把一颗完整的依存树送到全连通边加权图里。这里的权重就通过attention学习得到GCN给定一个图,有n个节点,我们可以用n∗nn*nn∗n的邻接矩阵表达这个图结构。可以把边的方向性扩展到模型中,用来编码依存树每个结点都添加一个.

把句法依存树当成输入在n元关系抽取,大规模句子级别关系抽取都能充分利用依存树的信息https://github.com/Cartus/AGGCN_TACRED文章目录创新:GCN注意力引导层密连接层线性组合层关系抽取层创新:提出soft pruning策略,把一颗完整的依存树送到全连通边加权图里。这里的权重就通过attention学习得到GCN给定一个图,有n个节点,我们可以用n∗nn*nn∗n的邻接矩阵表达这个图结构。可以把边的方向性扩展到模型中,用来编码依存树每个结点都添加一个.

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

604

604

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?