贝叶斯学习方法的特性:

- 观察到的每个训练样例可以增量地降低或升高某假设的估计概率

- 先验知识可以与观察数据一起决定假设的最终概率

- 每个候选假设的先验概率

- 每个可能假设在可观察数据上的概率分布

- 贝叶斯方法可允许假设做出不确定性的预测

- 新的实例分类可由多个假设一起做出预测,用它们的概率来加权

一致学习器定义:如果某个学习器输出的假设在训练样例上为0错误率

一致学习器输出一个MAP假设的条件:

1、H上有均匀的先验概率

2、训练数据是确定性和无噪声的

在特定前提下,任一学习算法如果使输出的假设预测和训练数据之间的误差平方和最小化,它将输出一极大似然假设。

误差平方最小化的法则寻找到极大似然假设的前提是:训练数据可以由目标函数值加上正态分布噪声来模拟。

使交叉熵最小化的法则寻找极大似然假设基于的前提是:观察到的布尔值为输入实例的概率函数。

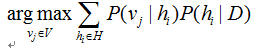

贝叶斯最优分类器的定义:

特点:

1、它所做的分类可以对应于H中不存在的假设。

2、在给定可用数据、假设空间及这些假设的先验概率下使新实例被正确分类的可能性达到最大。

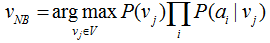

朴素贝叶斯分类器的定义:

只要条件独立性得到满足,朴素贝叶斯分类vNB等于MAP分类,否则是近似。

区别:没有明确地搜索可能假设空间的过程(假设的形成不需要搜索,只是简单地计算训练样例中不同数据组合的出现频率)。

1185

1185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?