我又转到ISP来看论文啦,鉴于之前博客经常被抄,我要先写个原创声明:本文为是暮涯啊在CSDN创作,认准原创地址https://blog.csdn.net/longshaonihaoa/article/details/124102256 未经允许,请勿转载。

ISP包含将raw图像处理得到RGB图的一系列处理算法,典型的如白平衡(white balance)、去码(demosaic)、去噪(denoise)、锐化(Sharpen)、颜色空间转换(color space conversion)、伽马矫正(gamma correction)等。具体介绍可以看知乎专题。随着DNN的发展,很多研究希望能够使用DNN直接替代ISP的主要处理流程,端到端的将raw图像转换为RGB图。这样一个好处是可以设备无关(independent of any particular mobile ISP implementation),也就是说AI ISP算法可以应用到任意移动设备中,但传统的流程跟厂商单独的硬件参数,各种矩阵转换,传感器先验相关。

从我的感觉来说这个领域目前在业界应该是做的挺多的,但是在学术界好像论文还挺少。接下来就是这系列论文的介绍,如果论文有比较好的讲解我会贴链接,避免重复造轮子。

ISP论文整理1 会记录顶会订刊的论文

ISP论文整理2 记录一些workshop或者arxiv等的论文。

1、Learning to See in the Dark(CVPR18)

论文、代码、数据集、视频全都可以看这篇知乎文章 。 被引590+

讲解一 讲解二

先说说作者思路。在拍照时曝光时间短,图像太暗,曝光时间长,图像又太模糊。所以一般可以用曝光时间长+去模糊、去噪等算法解决,但这些算法在极端条件下受到限制,比如暗光情况下。所以本文就是解决暗光环境下的成像问题。作者的想法是直接用DNN代替整个ISP流程,因此自己制作了一个数据集,并在此基础上提出并测试了全卷积网络,结果发现在暗光条件中,比传统ISP、降噪、手机ISP都效果好。具体内容可以看上面链接,然后单独谈谈两点想法。

1)作者将X-Trans数据处理时通过像素交换转为9通道。作者这么做的原因有说,是X-Trans作为6*6的CMOS块,如果转为36通道效果相比9通道会变差很多,所以这个做法更多是经验尝试的结果。想想也正常如果间隔6取一个像素点,那么得到的特征相邻像素间信息丢失太多。

2)作者说用GAN loss指标会下降。这个在我做SR时候也会遇到,但我训练好的GAN loss情况下,PSNR可能会降低,但是VMAF反而会提升,也就是说引入GAN loss会生成更符合人眼质量的细节信息。不知道作者引入GAN loss后时候也是这种情况,还是PSNR指标和感官效果都降低。

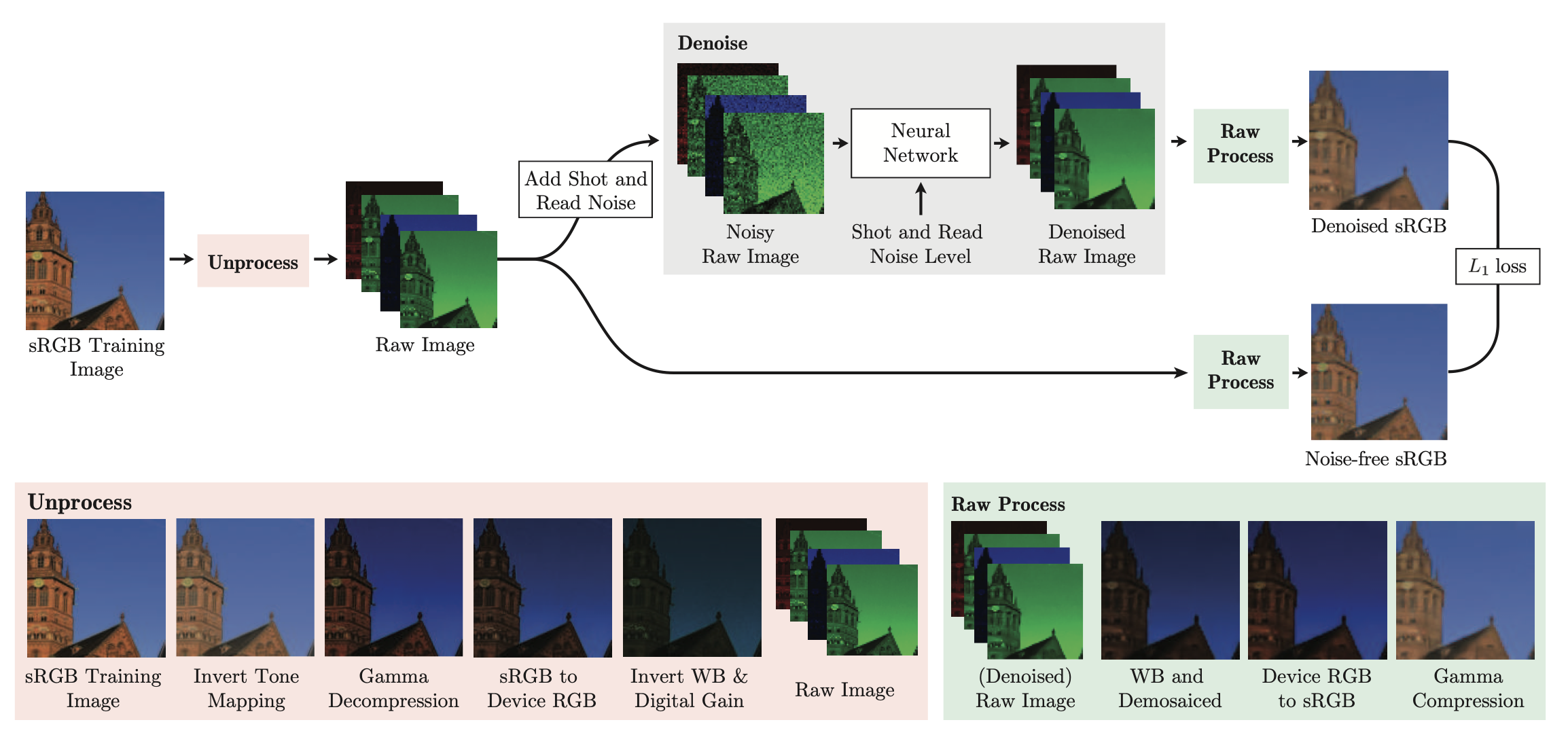

2、Unprocessing Images for Learned Raw Denoising(CVPR19)

论文 被引186

翻译

按照我的理解,作者做了这么件事。他觉得DNN在仿真图像上训练的去噪模型只有测试数据与仿真数据分布一致时效果才好,在真实去噪场景中的效果变差。这个符合我们的认知,一般的做法是想办法生成更逼近真实的仿真噪声或者想办法生成真实场景的训练对,这也确实是大多数去噪论文做的。但是作者不这么想,他觉得既然RGB域去噪太假,那就在RAW域做去噪,然后通过Unprocessing将RGB域转为RAW域,然后添加噪声并训练去噪,将去噪后的结果通过ISP再次转回RGB域。但是去噪反而没让本文出名,Unprocessing成了本文亮点,这部分作者也确实花了大手笔去写,所以有空可以自己看看这些公式推理过程。

3、Towards real scene super-resolution with raw images(CVPR19)

论文 被引72

讲解

作者认为现存SR方法在真实场景效果不好,是因为1)缺乏真实训练数据2)模型输入的信息丢失。为了解决第一个问题,通过仿真数码相机的图像处理功能生成真实训练数据。为了解决第二个问题,设计了一个双卷积神经网络来利用raw图中最初捕获的射线(radiance)信息。此外还提出了空间可变的颜色转换(spatially-variant color transformation)来更有效的颜色校正。实验证明对raw图SR可以恢复更好的细节和更清晰的结构。

看图还蛮有意思的,就跟pansharpening一样。raw包含信息,对它超分保存细节信息,彩图用颜色校正恢复颜色信息。作者说的缺点二应该就是指彩图丢失掉一些细节信息。本篇建议读原文哈。

4、CycleISP: Real Image Restoration via Improved Data Synthesis(CVPR20 oral)

论文 被引93

讲解一 讲解二

同样建议看论文哈,毕竟oral。和Unprocessing类似,同样是处理去噪中真实数据难以获得的问题。并在上篇基础上将ISP流程NN化,这样可以在raw和RGB域都生成任意数量的真实图像对。在此基础上作者使用网络训练,发现效果在真实的camera数据集上确实好。且参数比之前raw denoise的最优网络少5倍。

5、DeepISP: Toward Learning an End-to-End Image Processing Pipeline(TIP19)

论文 被引121

这篇是目的直接的用DNN替代ISP流程的论文,学习从raw、低亮(low-light)、马赛克(mosaiced)的图映射到好的视觉感官图。这个过程包含low level的denoise、demosaic和high level的颜色矫正、图像调整。训练在私有的包含low-light和亮度充足(well-lit)的图像对上进行。结果显示比制造商(manufacturer)ISP效果好。

鉴于这篇论文讲解较少,先码住等我之后认真读读再补充。

鉴于这篇论文讲解较少,先码住等我之后认真读读再补充。

6、CameraNet: A Two-Stage Framework for Effective Camera ISP Learning(TIP2021)

论文 被引21

说啊这个分成多个子任务的传统ISP在处理具有挑战性场景(challenging scenes)的时候重建质量有线,因此提出CameraNet。他用两个CNN处理ISP的两个子任务重建和增强(restoration and enhancement)用两个GT渐进式训练网络,获得了始终如一的令人信服的(consistently compelling)重建质量,且超过传统ISP。

可以看出重建和增强子网络都使用相同的Unet结构。区别在于重建block使用Conv+LReLU,增强block使用Dialted Conv+ABN+LReLU。

可以看出重建和增强子网络都使用相同的Unet结构。区别在于重建block使用Conv+LReLU,增强block使用Dialted Conv+ABN+LReLU。

7、Learning RAW-to-sRGB Mappings with Inaccurately Aligned Supervision(ICCV2021)

论文 被引1

代码

本文是解决AI ISP中raw-rgb数据对不匹配的问题。超级绕口令一样的摘要如下,看不懂可以直接看下一段-_-

由于不对齐会导致像素偏移,产生模糊,作者使用全局颜色转换(global color mapping ,GCM) 在给定输入原始图像的情况下生成Initial sRGB图,该模块可以保证像素的空间位置不变,并利用Target sRGB图向Initial sRGB图转换颜色。然后部署一个经过预训练的光流估计网络(例如,PWC-Net),以扭曲Target sRGB图,使其与GCM输出(即Initial sRGB图)对齐。为了减轻不精确对齐监督的影响,利用warped Target sRGB图像来学习RAW-to-sRGB的映射。训练完成后,GCM和光流估计网络都可以删除,不增加推理的计算量。通过联合学习训练,可以用一个轻量级模型获得更好的定性定量效果。

简单来说是这样的。

y

~

\widetilde{y}

y

就是Initial sRGB图,它经过GCM后跟raw图的空间位置是匹配的。

y

y

y就是Target sRGB图,他同样会作为GCM的输入,用来给

y

~

\widetilde{y}

y

转换颜色。PWC-Net学习

y

~

\widetilde{y}

y

和

y

y

y之间的warp,对y进行扭曲,得到

y

w

y^w

yw。最后再用x和

y

w

y^w

yw联合训练 GCM和LiteISPNet得到预测结果

y

^

\hat{y}

y^。推理时候GCM和PWC-Net就都可以删了。图中T是坐标map。

如图(a)所示,联合训练时采用

L

G

C

M

L_{GCM}

LGCM和

L

I

S

P

L_{ISP}

LISP。其中前者损失函数如下

![]()

m是01矩阵,用来指示光流中有效的位置,由下式获得

W表示warp操作,1为全1矩阵。代码中应该是直接对PWC-Net得到的光流进行判断,大于0.999的置1,反之为0。

L

I

S

P

L_{ISP}

LISP 采用L1 loss + Perceptual loss + GAN loss,但前两者也都乘以上面光流处理得到的mask。公式如下

欢迎多多评论交流,点赞支持。

9660

9660

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?