专用模型:针对特定任务,一个模型解决一个问题

通用模型:一个模型应对多种任务,多种模态

一、简介

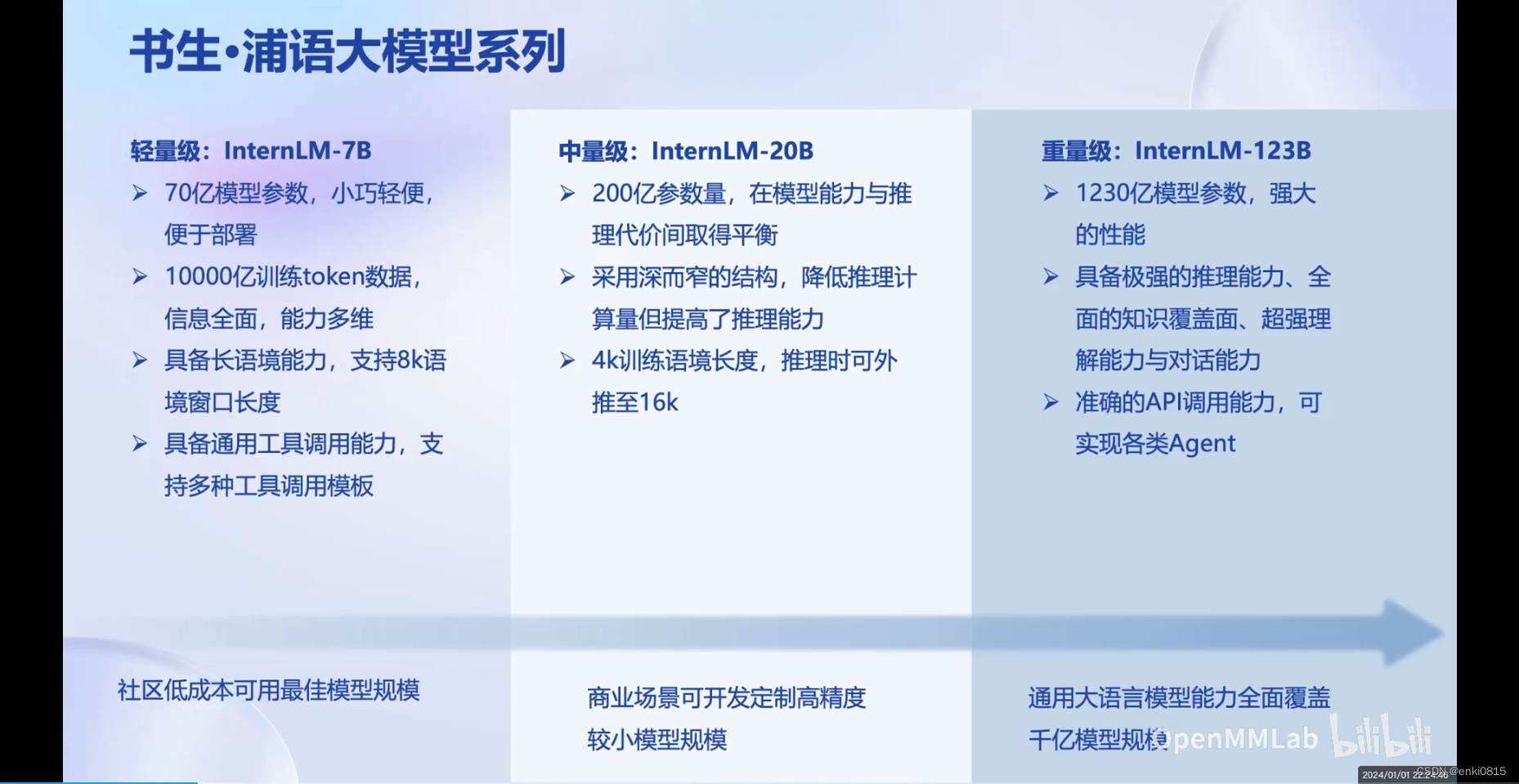

InternLM 是在过万亿 token 数据上训练的多语千亿参数基座模型。通过多阶段的渐进式训练,InternLM 基座模型具有较高的知识水平,在中英文阅读理解、推理任务等需要较强思维能力的场景下性能优秀,在多种面向人类设计的综合性考试中表现突出。在此基础上,通过高质量的人类标注对话数据结合 RLHF 等技术,使得 InternLM 可以在与人类对话时响应复杂指令,并且表现出符合人类道德与价值观的回复

二、性能

三、体系

四、数据

文本数据:50亿个文档;数据量超1TB

图像-文本数据集:超2200万个文件,数据量超140GB

视频数据:超1000个文件,数据量超900GB

五、微调

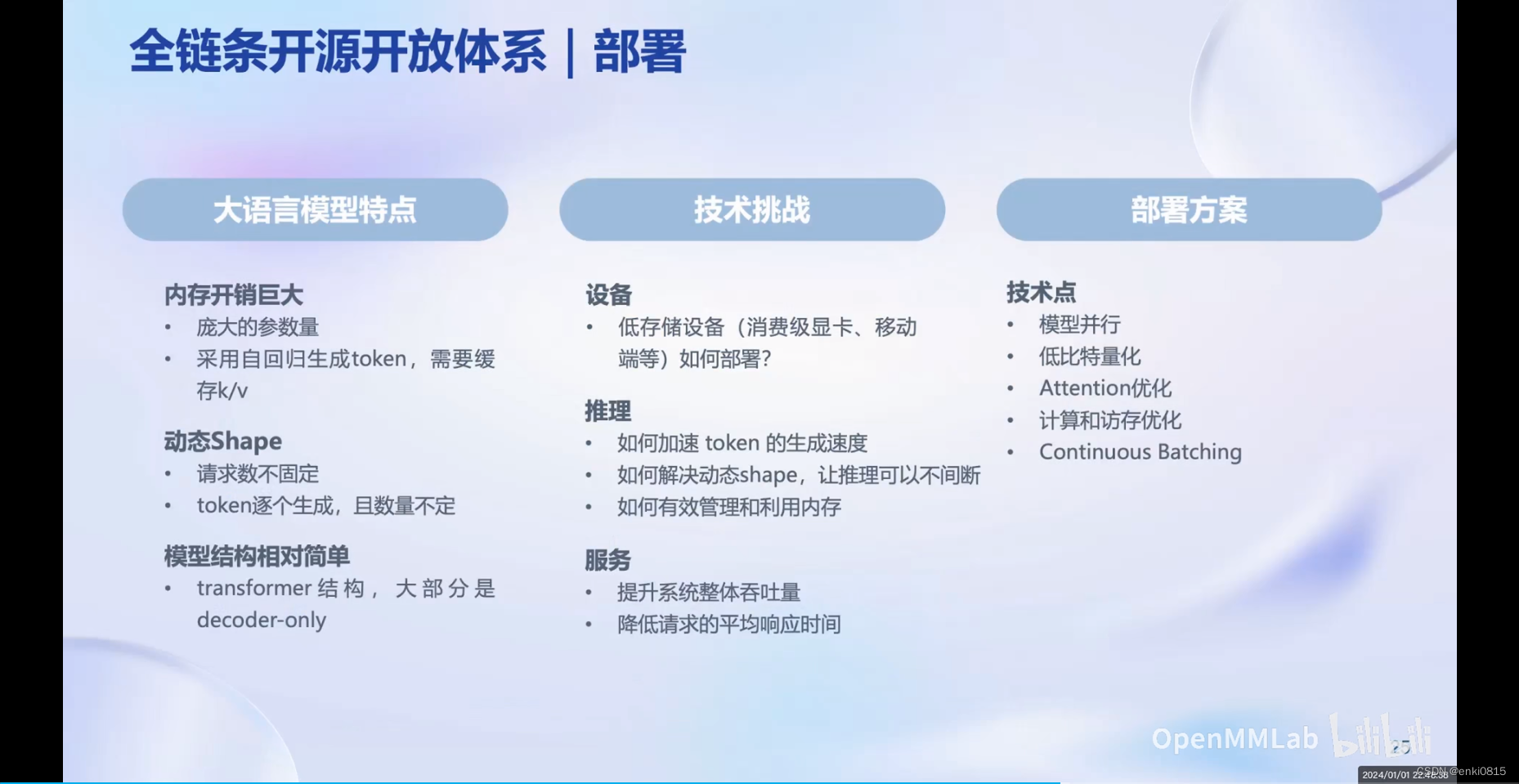

六、部署

七、智能体

374

374

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?