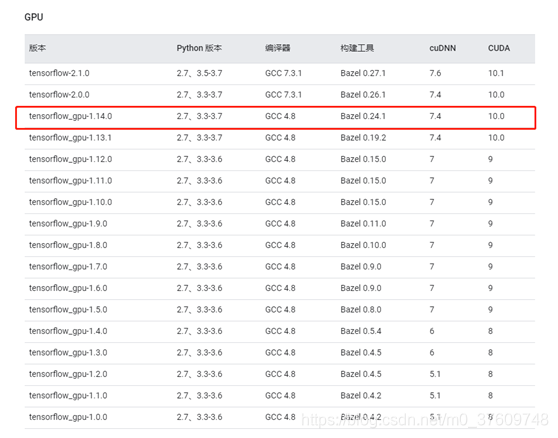

tensorflow—gpu版本的安装需要cuda与cudnn,根据tensorflow官网https://tensorflow.google.cn/install/source_windows,查看tensorflow的版本与所匹配对应的cuDNN及CUDA,本次安装选的第三个版本,tensorflow_gpu—1.14.0。

1、安装tensorflow之前,首先从https://developer.nvidia.com/cuda-toolkit-archive与https://developer.nvidia.com/rdp/cudnn-archive,下载CUDA 10.0版本和cuDNN 7.4版本。

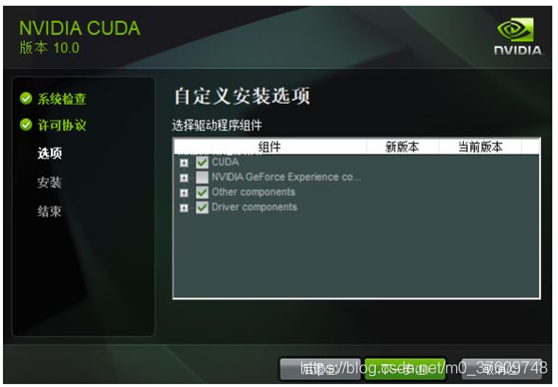

(1)CUDA 10.0安装步骤:

取勾GeForce Experience

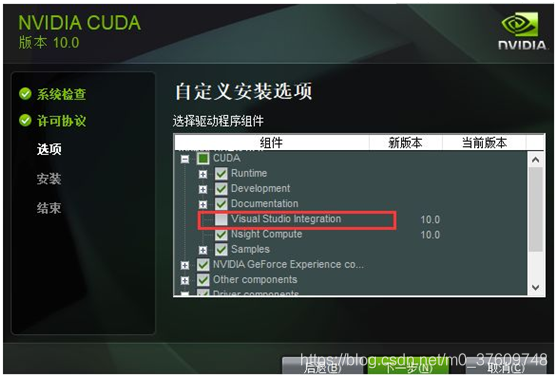

如果电脑上本身就有Visual Studio Integration,要将这个取消勾选,避免冲突了。

点开Driver comonents,Display Driver这一行,前面显示的是Cuda本身包含的驱动版本是411.31。

如果你电脑目前安装的驱动版本号新于Cuda本身自带的驱动版本号,那一定要把这个勾去掉。否则会安装失败(相同的话,就不用去取勾了)

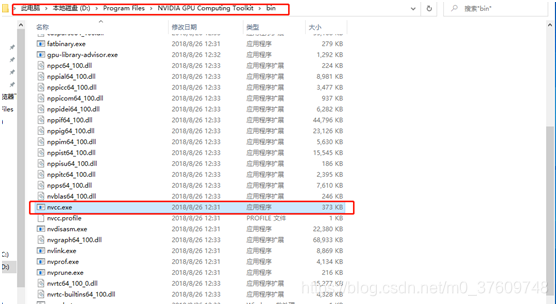

打开此路径,查看nvcc.exe。

有这个nvcc.exe就说明CUDA安装已成功

打开此文件夹,查看有没有cuti64_100.dll,有这个cuti64_100.dll就说明CUPT1已成功。

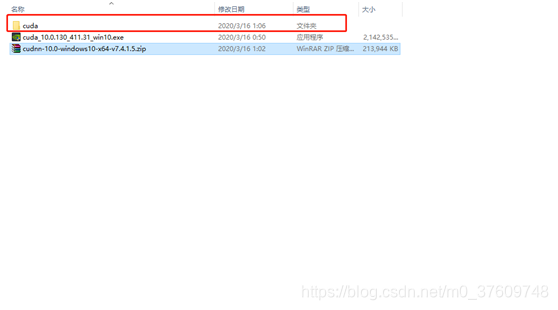

(2)cuDNN安装

解压cuDNN

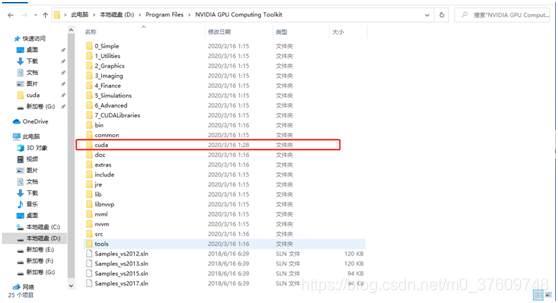

将解压后文件复制到CUDA文件夹下。

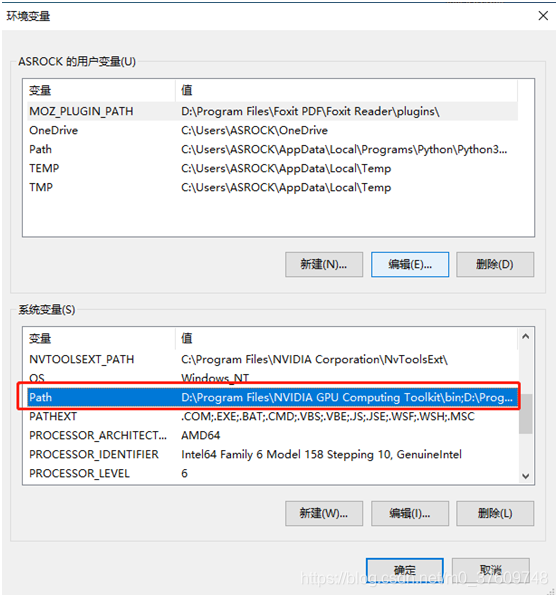

(3)PATH配置

查看CUDA环境路径

我的电脑——>属性——>高级系统设置——>环境变量

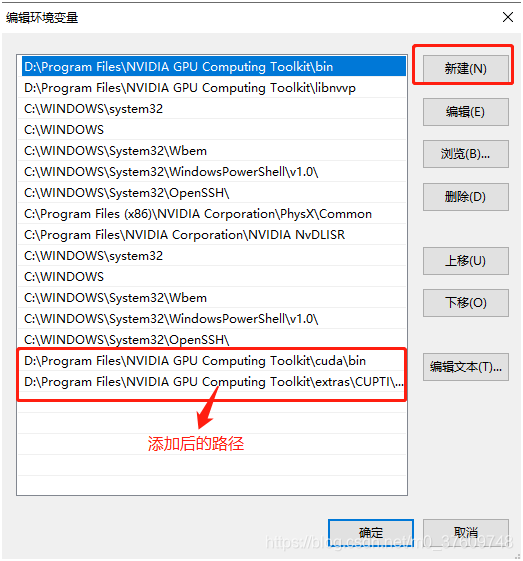

查看CUDA路径,当你安装完CUDA后,它会将这两个目录加进来, CUPTA和cuDNN还没有加进来,所以必须将它们添加到路径,这样使用Tensorflow的时候才不会报错。

添加CUPTA和cuDNN路径:

编辑–>新建(cuDNN路径,CUPTA路径缺一不可!)

较新版本的CUDA11.0和cuDNN8.0版本添加路径(修改了默认路径):D:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.0\extras\CUPTI\lib64

D:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.0\cuda\bin

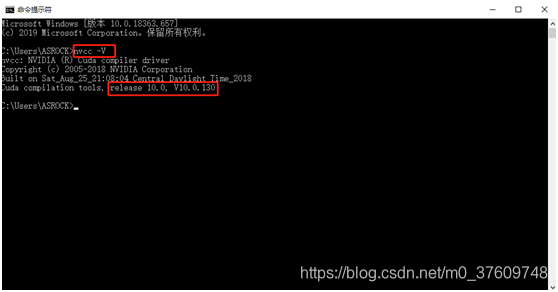

测试CUDA:

cmd-> nvcc –V

下面的显示说明我们CUDA的版本是10.0

2、tensorflow安装

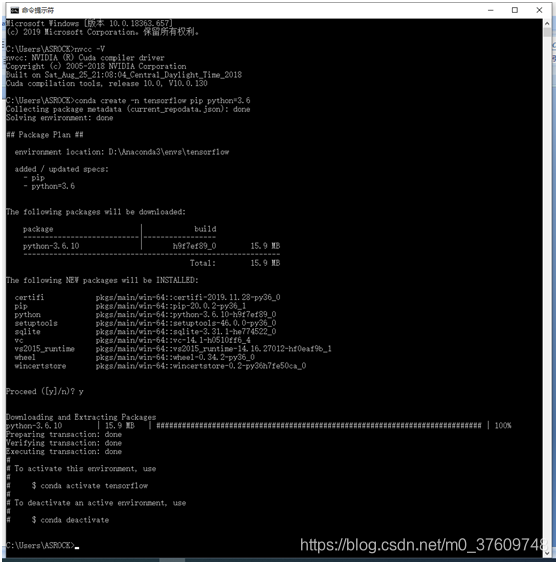

开始用ANACONDA安装tensorflow

1) 在ANACONDA里创建名为tensorflow的环境(你可以叫他任何名字,这里我叫这个环境为tensorflow。

conda create -n tensorflow pip python=3.6

2) 用以下命令以激活 conda 环境:

Activate tensorflow

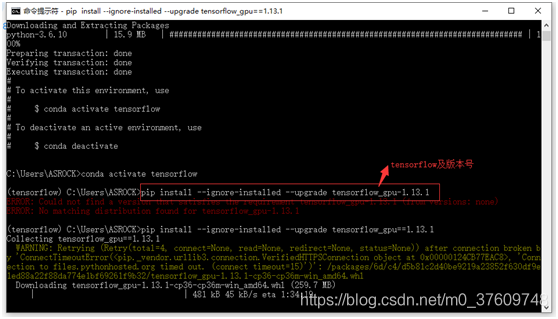

3) 用相关命令在 conda 环境中安装 TensorFlow。请输入以下命令:

(tensorflow)C:> pip install --ignore-installed --upgrade tensorflow-gpu

假如你想安装某个特定版本的tensorflow,可以输入如下命令,根据自己的喜好,替代那个1.14.0即可。(注:直接安装可能网速很慢,会安装失败,可以离线安装,http://mirrors.aliyun.com/pypi/simple/tensorflow-gpu/)

pip install --ignore-installed --upgrade tensorflow_gpu==1.14.0

4) 测试是否安装成功

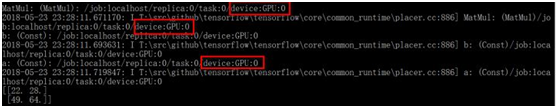

在ANACONDA窗口的tensorflow的环境中,跑一个test.py,检测tensorflow的确用gpu来做运算了。

test.py脚本内容:

import tensorflow as tf

# Creates a graph.

a = tf.constant([1.0, 2.0, 3.0, 4.0, 5.0, 6.0], shape=[2, 3], name='a')

b = tf.constant([1.0, 2.0, 3.0, 4.0, 5.0, 6.0], shape=[3, 2], name='b')

c = tf.matmul(a, b)

# Creates a session with log_device_placement set to True.

sess = tf.Session(config=tf.ConfigProto(log_device_placement=True))

# Runs the op.

print(sess.run(c))

print(sess.run©)

测试结果如下图:

图中device:GPU:0的意思就是说该运算用到了GPU。

740

740

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?