1. 安装相应的包

pip install pytorch_pretrained_bert==0.6.2 -i https://pypi.tuna.tsinghua.edu.cn/simple

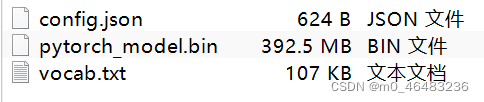

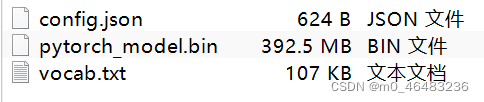

2. 下载相应的预训练模型 bert-base-chinese。

3. 代码示例:

import torch

from pytorch_pretrained_bert import BertTokenizer, BertModel

tokenizer = BertTokenizer.from_pretrained('./bert-base-chinese', do_lower_case=True)

bert = BertModel.from_pretrained('./bert-base-chinese')

bert.eval()

text = '我爱北京天安门。'

text = tokenizer.tokenize(text)

print(text) # ['我', '爱', '北', '京', '天', '安', '门', '。']

text_id = tokenizer.convert_tokens_to_ids(text)

print(text_id) # [2769, 4263, 1266, 776, 1921, 2128, 7305, 511]

text_id = torch.tensor(text_id,dtype = torch.long)

text_id = text_id.unsqueeze(dim=0)

print(text_id) # tensor([[2769, 4263, 1266, 776, 1921, 2128, 7305, 511]])

output = bert(text_id)[0]

print(len(output)) # 12层

text_embedding = bert(text_id)[0][0] # 取第1层,也可以取别的层。

text_embedding = text_embedding.detach() # 切断反向传播。

print(text_embedding.shape) # torch.Size([1, 8, 768])

这篇博客介绍了如何在PyTorch中安装并使用`pytorch_pretrained_bert`库来加载预训练的BERT模型,特别是BERT的中文版。首先通过pip安装指定版本的库,然后下载对应的预训练模型。接着,展示了代码示例,包括分词、转换为ID、输入模型获取输出,并提取文本嵌入向量。整个过程清晰地演示了BERT模型在处理中文文本时的用法。

这篇博客介绍了如何在PyTorch中安装并使用`pytorch_pretrained_bert`库来加载预训练的BERT模型,特别是BERT的中文版。首先通过pip安装指定版本的库,然后下载对应的预训练模型。接着,展示了代码示例,包括分词、转换为ID、输入模型获取输出,并提取文本嵌入向量。整个过程清晰地演示了BERT模型在处理中文文本时的用法。

277

277

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?