1 摘要

提出了一种双时间图像转换器(BIT)用来高效并有效地在空间-时间域内对上下文进行建模。

2 介绍

基于高分辨率遥感图像的变化检测(CD)在两个方面仍然具有挑战:

- (1)场景中对象的复杂性

- (2)不同的成像条件

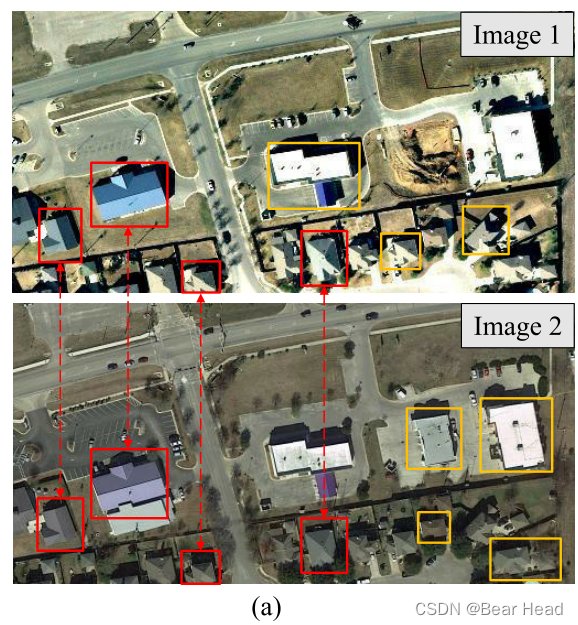

这两者都促使同一语义概念的对象在不同的时间、不同的空间位置表现出不同的光谱特征。例如一张图像中不同位置的建筑物具有不同的形状和外观,如下图Image1和Image2中的黄框所示;同一个建筑物在不同的光照下或不同的时间具有不同的颜色,如Image1和Image2两图红框对比所示。

为了识别这些复杂场景中感兴趣目标的变化,一个强大的变化检测模型需要做到一下两点:

- (1)识别场景中感兴趣目标变化的高级语义信息

- (2)从复杂的不相关的变化中区分出真正的变化

现在的大多数方法仍然难以在时空上建立相关的长程概念,它们要么iang注意力单独地应用于每个时间图像来强化特征,要么简单地使用注意力在通道或空间维度中重新加权已融合的双时间特征/图像。

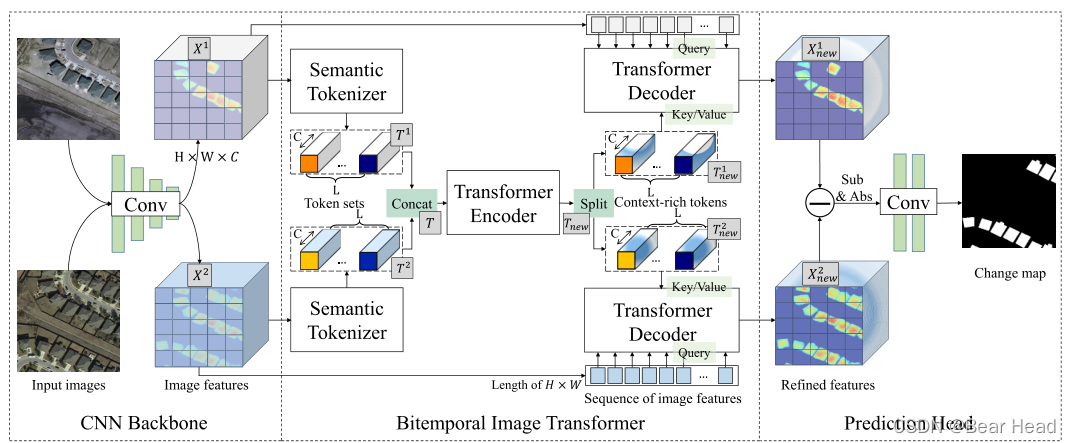

为了应对上述挑战,本文引入了双时间图像转换器(BIT)以高效和有效的方式对双时间图像内的长范围上下文进行建模。我们将BIT合并到一个基于深度特征差异的变化检测框架中。基于BIT的模型的整个过程如图所示:

一个CNN骨干网络(ResNet)从输入图像对中提取高层语义特征,我们使用空间注意力将每个时间特征图转换成一组紧凑的语义tokens。然后使用一个transformer编码器在两个tokens集中建模上下文,得到了富有上下文的tokens被一个连体transformer解码器重新投影到像素级空间,以增强原始像素级特征。最终,我们从两个细化的特征图计算特征差异图像(FDIs),然后将它们送到浅层CNN以产生像素级变化预测。

1957

1957

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?