还记得CNN+Transformer这个热门组合吗?最近发现它在遥感图像领域有不少高质量成果。比如顶刊Nat. Commun.上的GlaViTU 模型,一区IEEE TGRS上的SparseFormer(用于稀疏点标注遥感语义分割)、 LGCNet 模型等。

其实这也是遥感图像领域的发展趋势,这类混合架构通过轻量化设计(如Lite-Mono参数减少80%)和高效注意力机制(如LeWin模块),显著提升任务性能,完美契合工业界需求,研究前景很广阔(论文er可试)。

这方向现下仍处于快速发展期,结合领域特性的创新模型(如针对遥感多模态、高分辨率等特点)比较容易产出高水平论文,感兴趣的同学不妨从架构轻量化、多模态融合、动态计算等方向着手研究。

本文整理了11篇CNN+Transformer+遥感相关的新论文,方便论文er找参考,尽量找的开源的,大家有什么问题欢迎评论区友好交流~

全部论文+开源代码需要的同学看文末

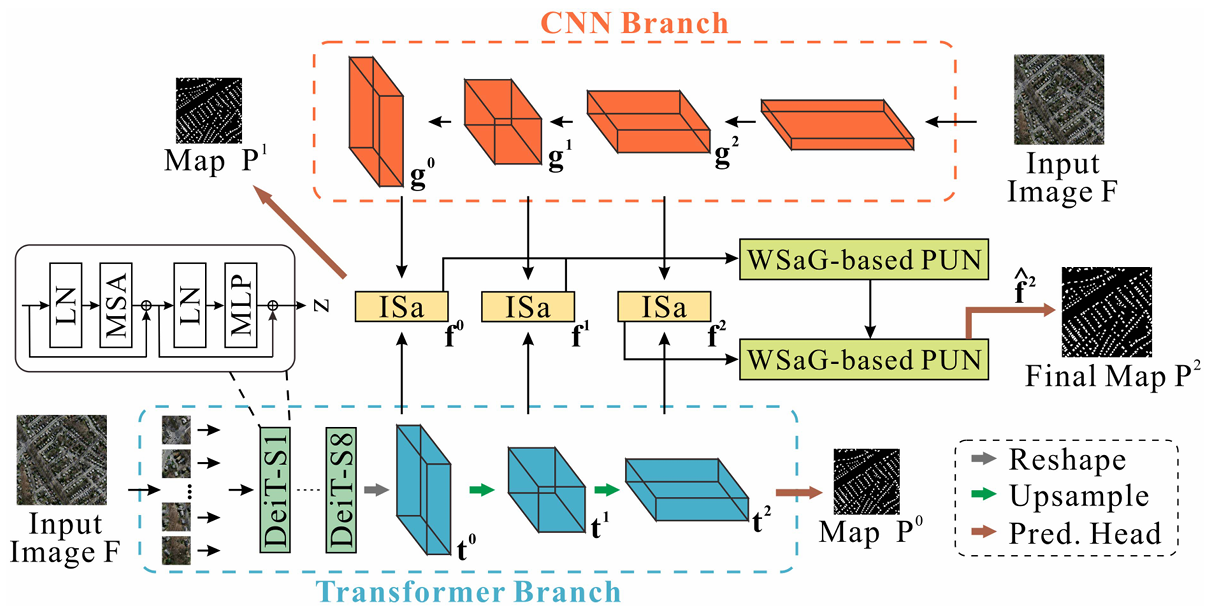

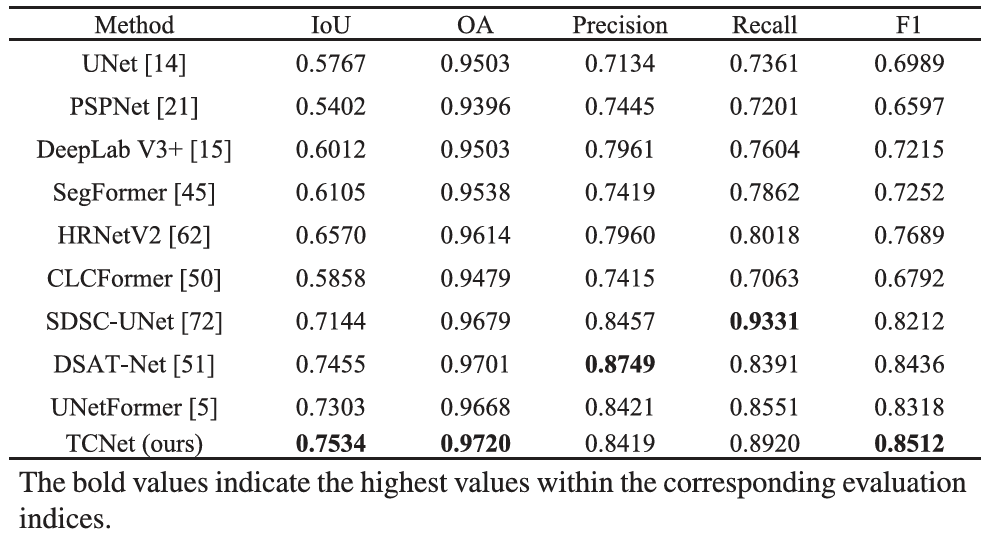

TCNet: Multiscale Fusion of Transformer and CNNfor Semantic Segmentation of Remote Sensing Images

方法:论文提出的 TCNet 是一种将 CNN 和 Transformer 结合用于遥感图像语义分割的创新方法。通过充分利用局部和全局信息,TCNet 在多个数据集上展示了优越的性能,证明了其在遥感图像分割任务中的有效性。

创新点:

-

介绍了一种名为TCNet的网络,采用并行分支架构,其中Transformer分支用于获取全局上下文,而CNN分支则用于捕获低级空间细节。

-

提出了一种新颖的融合技术,称为交互自注意力(ISa),用于融合从两个分支中提取的多层次特征。

-

开发并应用了一种名为窗口自注意力门控(WSaG)的跳跃连接模块,集成到渐进上采样网络(PUN)中。

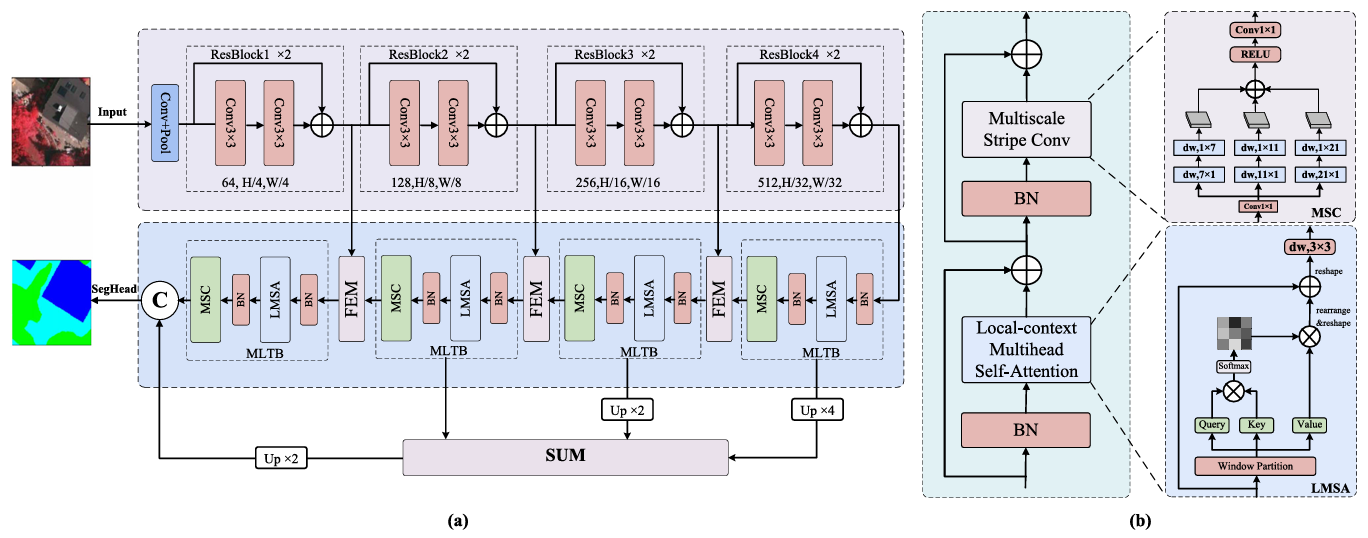

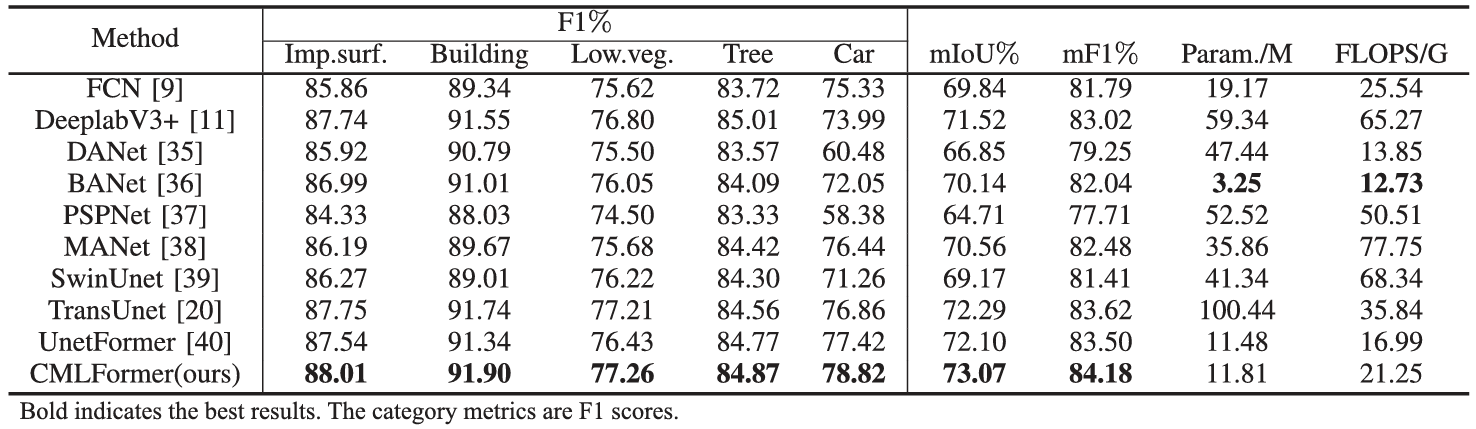

CMLFormer: CNN and Multiscale Local-Context Transformer Network for Remote Sensing Images Semantic Segmentation

方法:论文提出了一种新颖的CMLFormer网络架构,结合轻量级CNN和多尺度局部上下文Transformer,用于遥感图像的语义分割,以解决现有方法在全局和局部信息整合上的不足,通过设计多尺度局部上下文变换块(MLTB)和特征增强模块(FEM)来提升分割性能。

创新点:

-

MLTB模块通过结合注意力机制和多尺度策略,在不增加复杂度的情况下有效捕捉局部和全局特征信息。

-

提出了一种特征增强模块,能够在通道和空间维度上实现全局与局部信息的综合融合。

-

CMLFormer采用了轻量级的ResNet-18作为编码器,并结合了CNN和Transformer的优势。

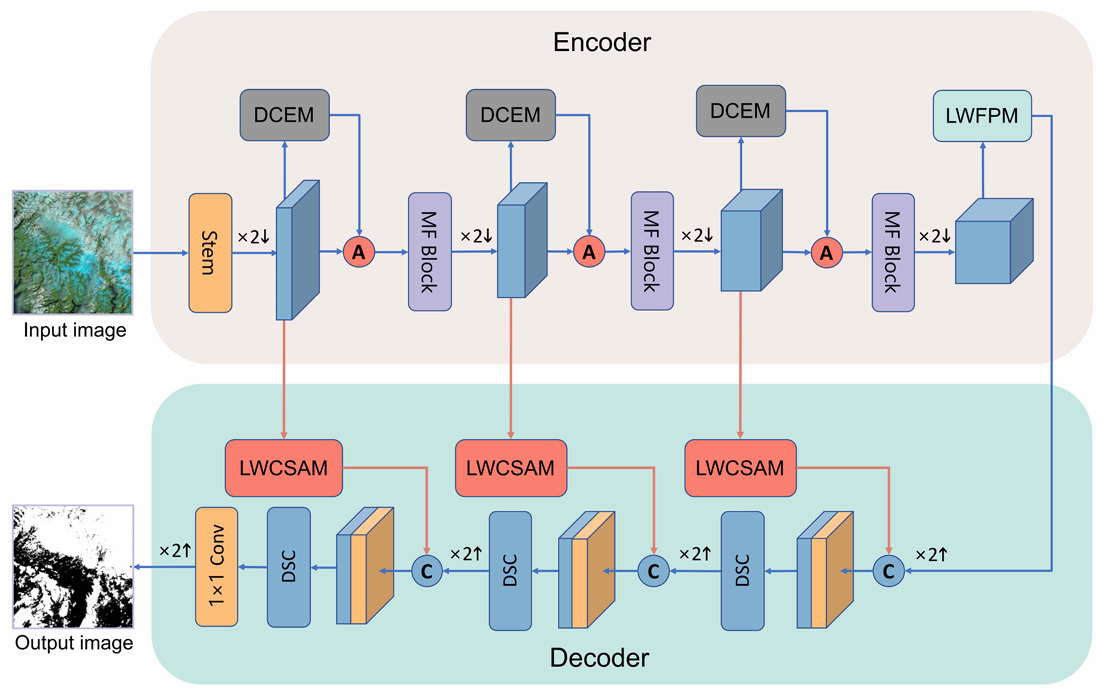

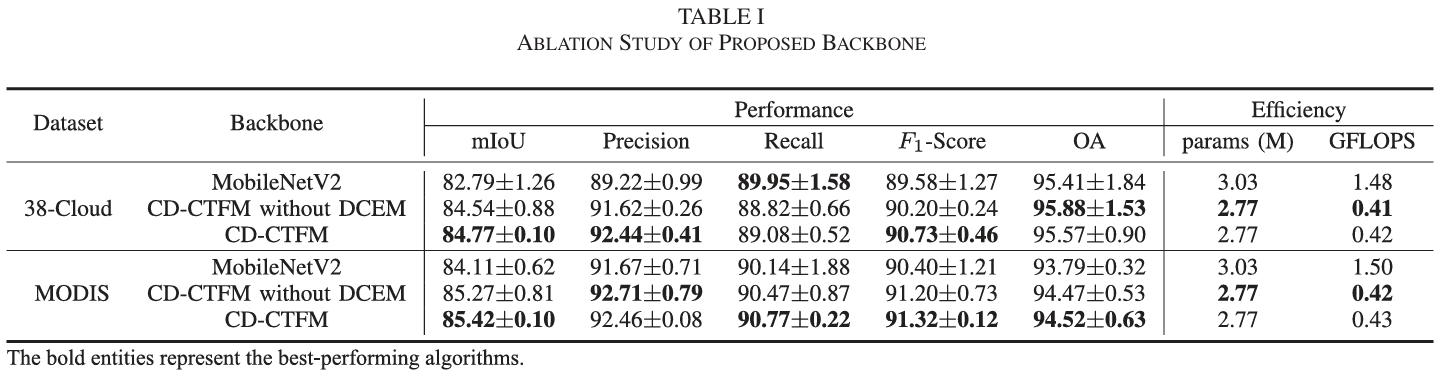

CD-CTFM: ALightweight CNN-Transformer Network for Remote Sensing Cloud Detection Fusing Multiscale Features

方法:论文提出了一种轻量级卷积神经网络-Transformer网络(CD-CTFM),用于改进遥感图像中的云检测,其基于编码器-解码器架构,结合注意力机制,能够在保留准确性的同时提升效率。

创新点:

-

结合CNN和Transformer的轻量级网络骨干,用于同时提取局部和全局特征。

-

在编码器和解码器之间的每个跳步连接中集成LWCSAM,以提取低级特征同时抑制无关信息。

-

引入无参数HFF技术解决栅格效应,使用SD块代替常规DC,低成本下提升准确度。

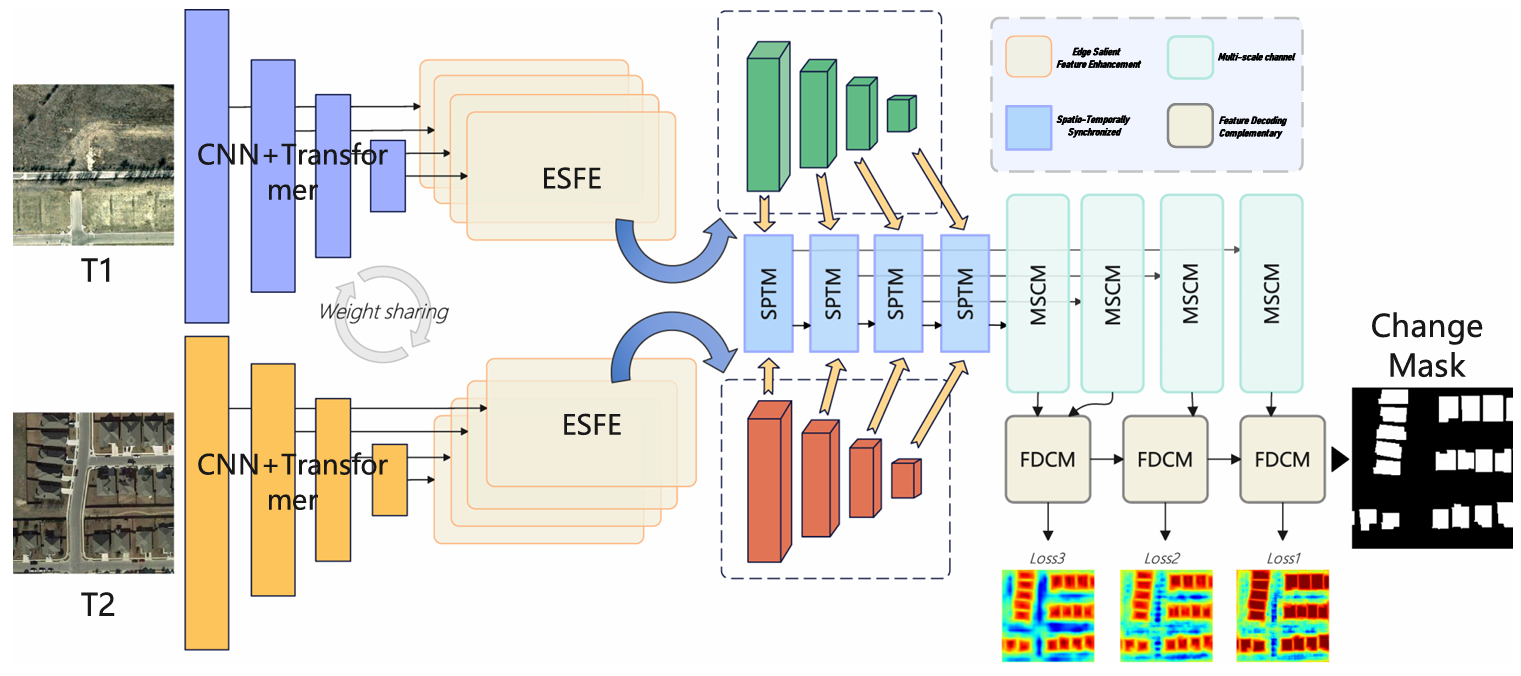

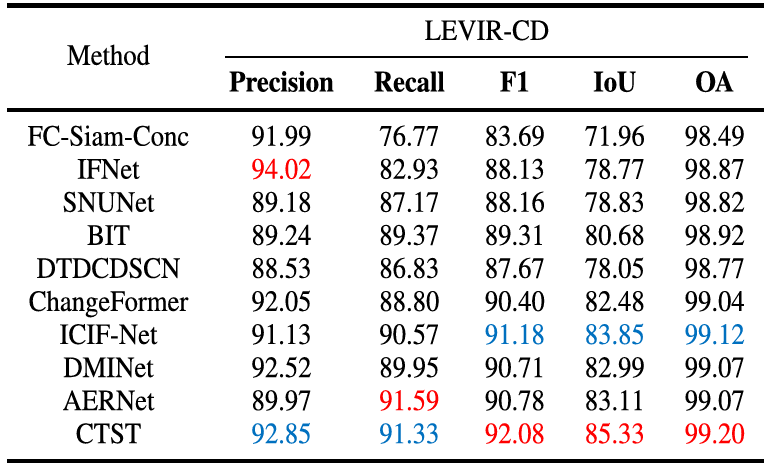

CTST: CNNand Transformer-Based Spatio-Temporally Synchronized Network for Remote Sensing Change Detection

方法:该论文提出了一种结合CNN和Transformer的时空同步遥感变化检测网络(CTST),旨在通过动态权重分配方法增强模型对全球依赖性的理解和局部特征的提取效果,采用边缘增强和时间同步模块来提升对复杂地表变化的检测精度和效率。

创新点:

-

通过多尺度卷积和通道注意力结合的方式,有效捕获特征中的有效信息并抑制无关信息。

-

通过改进的双流交互注意模块 (DSIAM),设计相关性映射分布算法,优化双时特征之间的相互作用和信息提取质量。

-

提出一种创新的双流结构用于多场景特征信息处理,通过特征拼接和求和运算,确保解码阶段的跨尺度信息融合和特征互补。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“结合遥感”获取全部方案+开源代码

码字不易,欢迎大家点赞评论收藏

1991

1991

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?