不良光线下的语义分割论文调研

文章目录

- 不良光线下的语义分割论文调研

- Multitask AET with Orthogonal Tangent Regularity for Dark Object Detection

- See Clearer at Night: Towards Robust Nighttime Semantic Segmentation through Day-Night Image Conversion

- DANNet: A One-Stage Domain Adaptation Network for Unsupervised Nighttime Semantic Segmentation

- HeatNet: Bridging the Day-Night Domain Gap in Semantic Segmentation with Thermal Images

- Guided curriculum model adaptation and uncertainty-aware evaluation for semantic nighttime image segmentation

- Dark Model Adaptation: Semantic Image Segmentation from Daytime to Nighttime

- Bi-Mix: Bidirectional Mixing for Domain Adaptive Nighttime Semantic Segmentation

- CDAda: A Curriculum Domain Adaptation for Nighttime Semantic Segmentation

- Bridging the Day and Night Domain Gap for Semantic Segmentation

- SEMANTIC NIGHTTIME IMAGE SEGMENTATION VIA ILLUMINATION AND POSITION AWARE DOMAIN ADAPTATION

Multitask AET with Orthogonal Tangent Regularity for Dark Object Detection

2021 ICCV

飞步科技

代码:https://github.com/cuiziteng/maet

解决问题

- 如何在CNN中有效利用不同语义的特征进行车道线检测;

- 如何提高车道线的定位精度

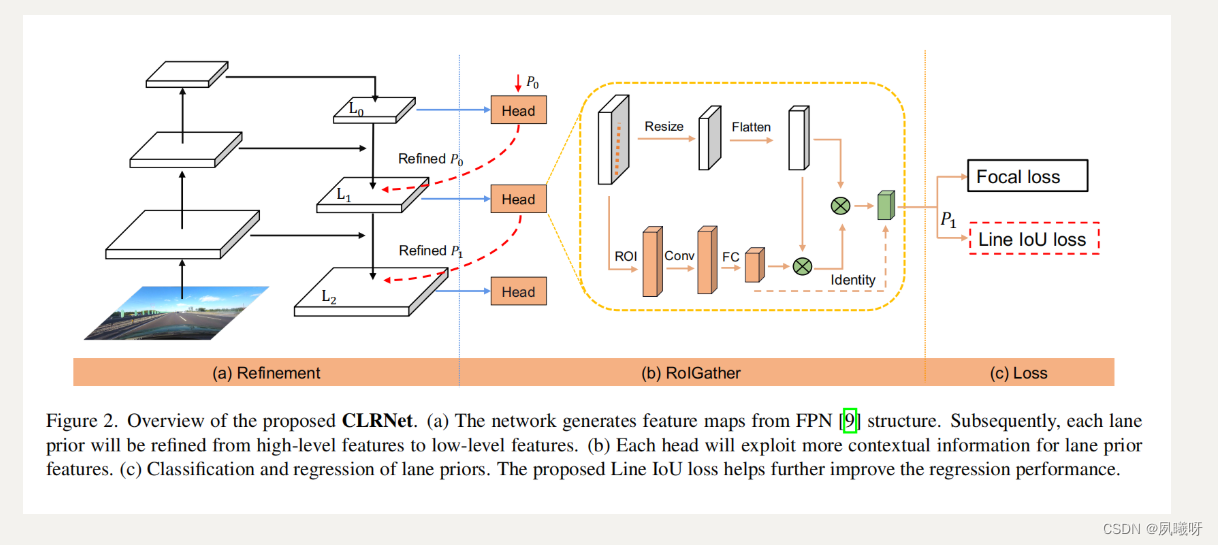

思路

首先对高语义特征进行检测粗略地定位车道,然后基于细节特征进行细化,以获得更精确的位置。逐步细化车道的位置和特征提取,得到高精度的检测结果。

- 提出了跨层细化网络(CLRNet),充分利用了低级和高级特征进行车道检测。

- 提出了ROIGather通过聚集全局上下文来进一步增强车道特征的表示,且可以插入其他网络。

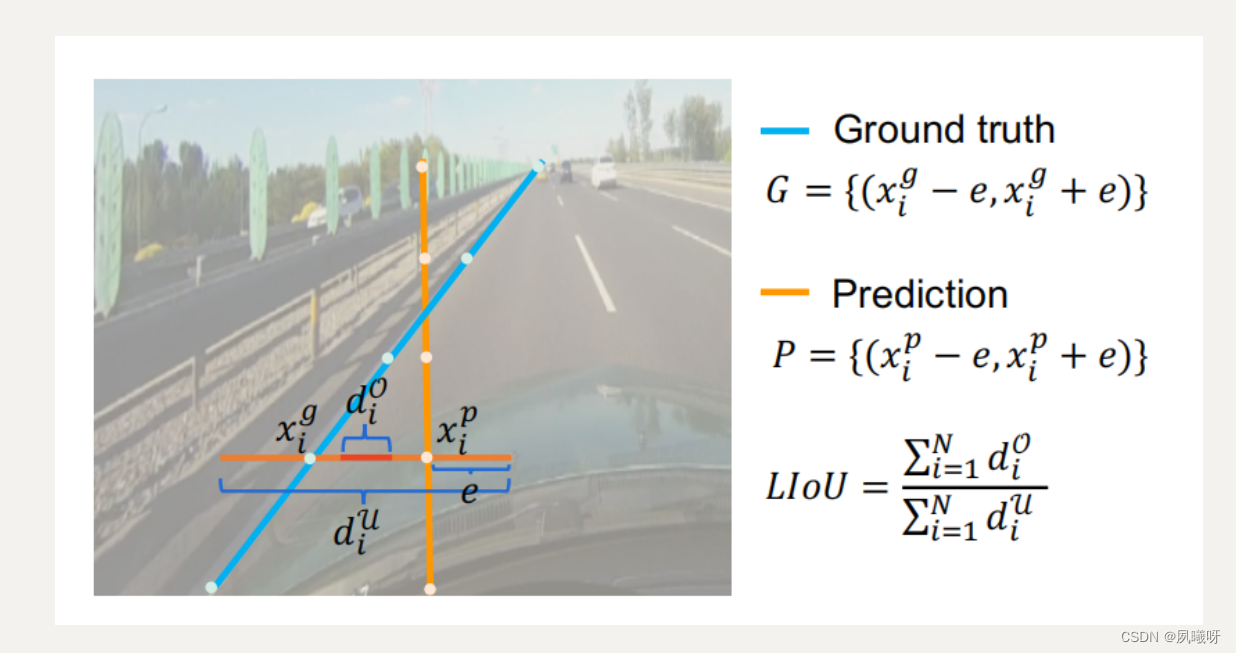

- 提出了Line IoU Loss(LIoU),将车道作为整个单元进行回归。

- 为了更好地比较不同检测器的定位精度,还采用了新的mF1指标。

See Clearer at Night: Towards Robust Nighttime Semantic Segmentation through Day-Night Image Conversion

2019 arXiv

浙江大学

解决问题

通过将GAN和SOAT分割框架结合,实现对夜间图像也具有鲁

棒的分割效果。

思路

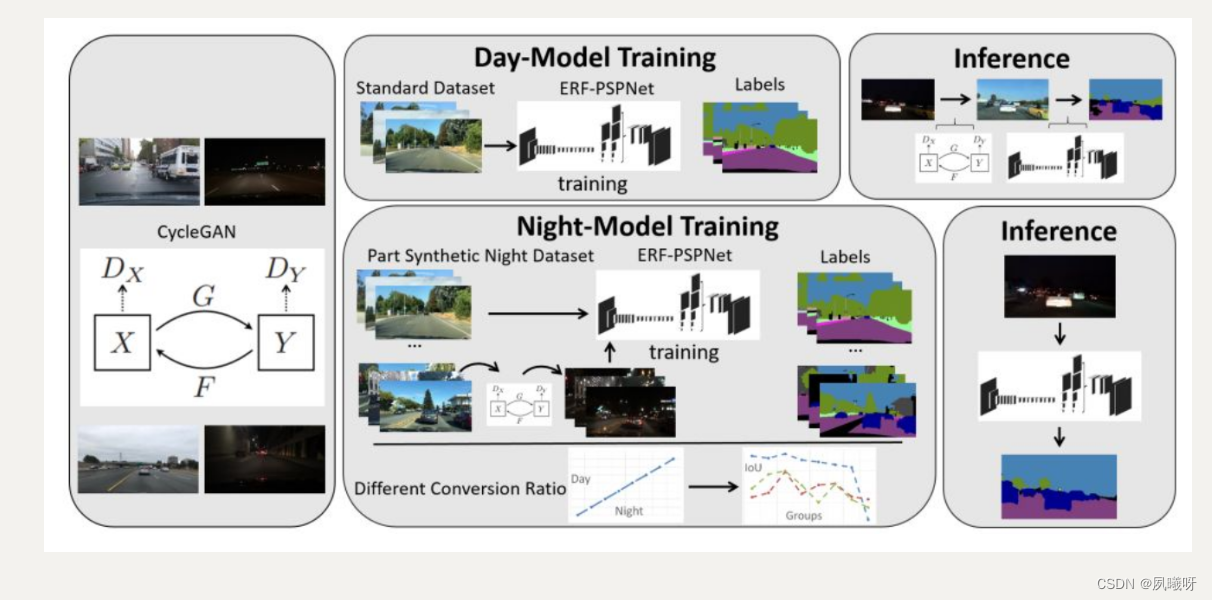

- 训练一个CycleGAN来执行跨域转换,将夜间图像转换为白天图像,然后在白天图像上训练ERF-PSPNet等算法;CycleGAN将训练集的部分白天图像转换为夜间图像,以扩展数据集的域覆盖范围。

- 推理过程将夜间图像即时转换为白天图像,作为预处理步骤。

- 将带有语义分割标签的BBD训练集中的部分白天图像转换为夜间图像。

DANNet: A One-Stage Domain Adaptation Network for Unsupervised Nighttime Semantic Segmentation

2021 CVPR

University of South Carolina

https://github.com/W-zx-Y/DANNet

解决问题

夜间图像的语义分割

思路

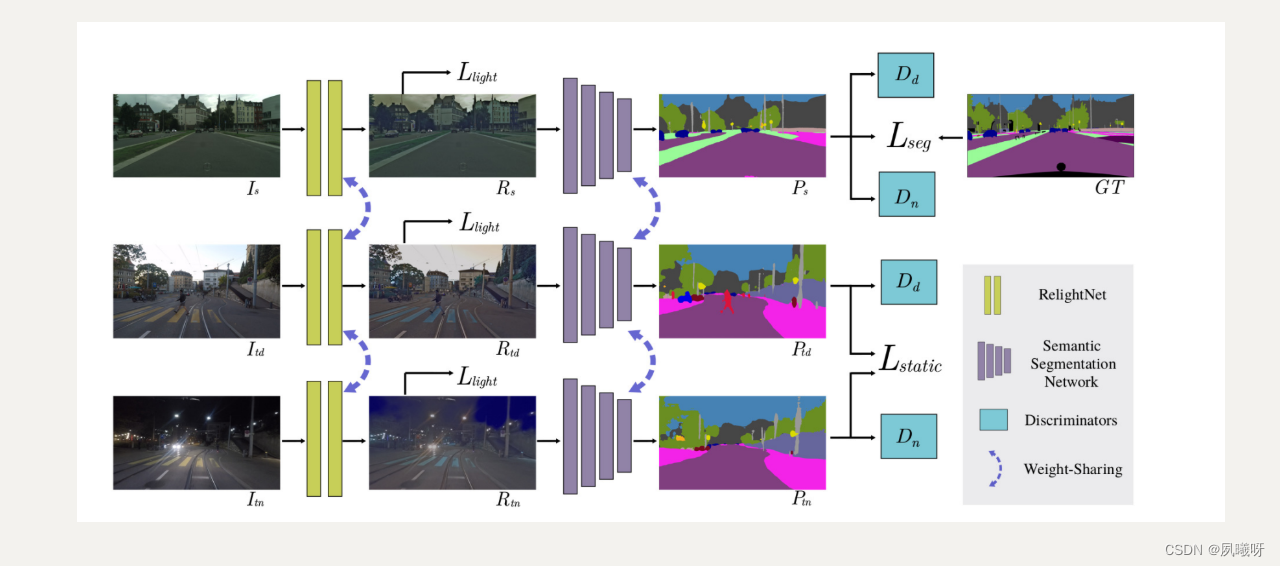

提出了一种新的基于对抗学习的单阶段域自适应网络 (DANNet) 用于夜间语义

分割。

- 所提出的DANNet 同时进行从 S 到Td 和从 S到 Tn的域适应训练。S为源域,Td白天目标域,Tn夜间目标域。它由三个不同的模块组成: 图像重光照网络、语义分割网络和两个鉴别器。

- 设计了一种图像重光照网络,使不同区域的图像强度分布更接近,从而使后续的语义分割网络对光照变化的敏感性降低。鉴别器的作用是区分分割预测来说源域还是目标域。

- 为了解决不同对象类别的像素数量在源域中不平衡的问题,提出了对预测的类别似然图重新加权的策略。

HeatNet: Bridging the Day-Night Domain Gap in Semantic Segmentation with Thermal Images

2021 IROS

the University of Freiburg

https://github.com/JohanVer/heatnet

解决方法

解决夜间照明和眩光下的语义分割,提高网络的健壮性。

思路

同时利用热图像和RGB提出了一种新的日间和夜间图像分割的多模态方法。

- 利用现有的日间rgb数据集,避免了昂贵的夜间图像注释,并提出了一种师-生训练方法,将数据集的知识转移到夜间领域。

- 进一步采用领域自适应方法将学习到的特征空间对齐,并提出了一种新的两阶段训练方案。

- 提出的新数据集 Freiburg Thermal数据集包含超过20,000个在白天和夜间记录在城市和农村环境中的时间同步RGB和热图像,还提供激光雷达点云、精确的GPS数据和IMU读数。

- 一种新型的无目标热敏摄像机校准方法。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-YalLVTuS-1651646998951)(images/image-20220425193906488.png)]](https://img-blog.csdnimg.cn/a14b2bee74c34682adea2af830d108ca.png)

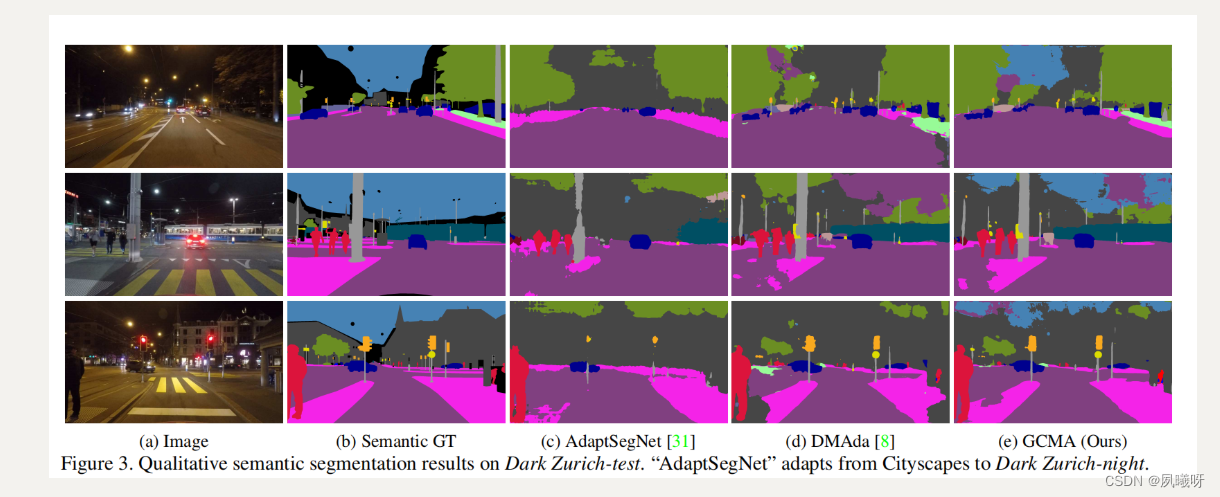

Guided curriculum model adaptation and uncertainty-aware evaluation for semantic nighttime image segmentation

2019 ICCV

ETH Z¨urich(苏黎世联邦理工)

解决问题

解决了夜间图像的语义分割问题,并改进了最先进的技术,通过适应夜间的白天模型,而不使用夜间注释。

思路

设计了一个新的评估框架来解决夜间图像中语义的大量不确定性。

- 提出了新数据集Dark Zurich。

- 提出一种新的不确定性感知注释和评价框架和语义分割的度量,为不利条件设计并以原则的方式包括超出人类识别能力的图像区域进行评估。

- 我们设计了一个通用的不确定性感知注释和评估框架,用于不利条件下的语义分割,明确区分输入图像的无效区域和有效区域,并将其应用于夜间。

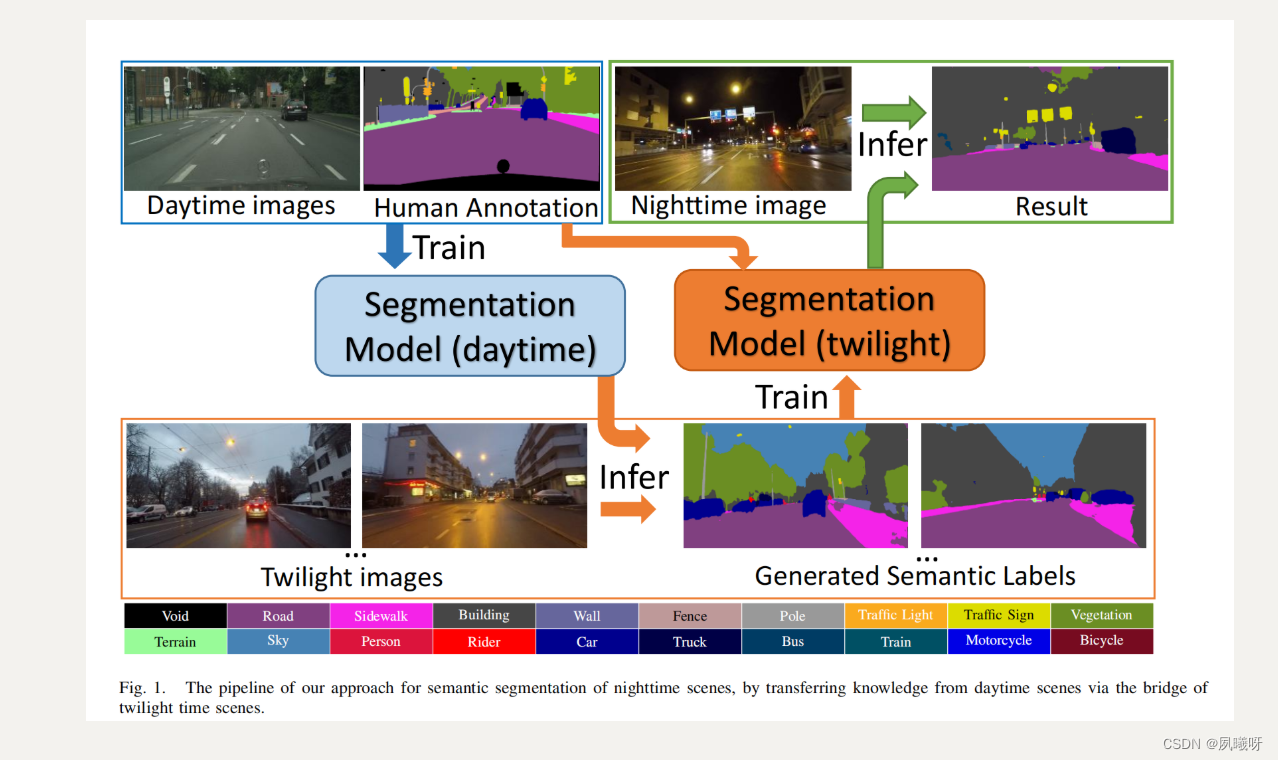

Dark Model Adaptation: Semantic Image Segmentation from Daytime to Nighttime

2018 IEEE International Conference on Intelligent Transportation Systems

http://people.ee.ethz.ch/~daid/NightDriving/

解决问题

夜间场景的语义图像分割。

思路

通过黄昏时间的桥梁,即黎明与日出、日落与黄昏之间的语义模型和大规模标注,逐步适应夜间场景。

- 在黄昏时间拍摄的图像可以很好地达到我们的目的——将知识从白天转移到夜间。也就是说,黄昏时间是知识从白天的源域转移到目标域的桥梁。使用标准的监督学习范式对日间图像训练一个语义分割模型,并将该模型应用于在民用黄昏时间记录的大数据集,以生成类响应。

- 一个新的数据集,称为Nighttime Driving,由夜间和黄昏时间的真实驾驶场景图像组成,包括35000张未标记图像和50张密集标注的图像。这些贡献将有助于学习和评价夜间驾驶场景的语义分割方法。

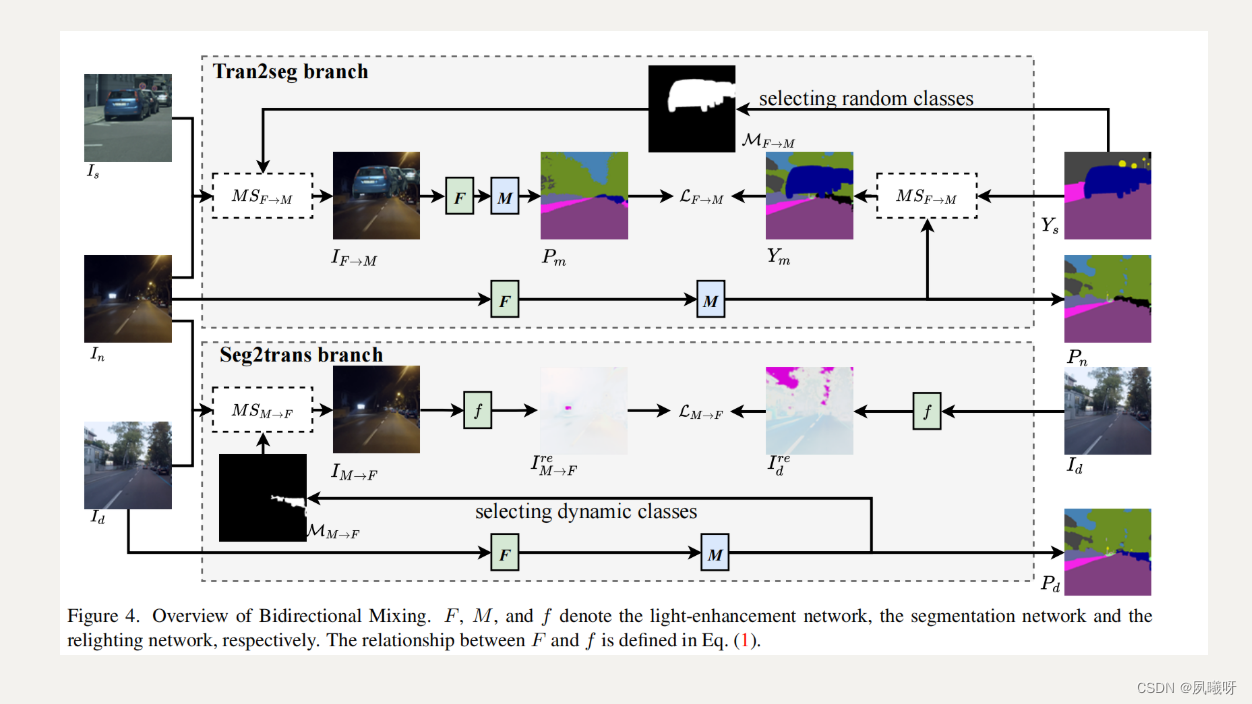

Bi-Mix: Bidirectional Mixing for Domain Adaptive Nighttime Semantic Segmentation

2021 arxiv.org

https://github.com/ygjwd12345/BiMix

解决问题

使语义分割模型适应夜间环境

思路

在一个具有标记的白天数据集和一个未标记数据集下,学习区分性夜间模型,包括粗对齐的昼夜图像对。

- 提出了一种新的双向混合(Bi-Mix)框架,促进图像的翻译和分割的自适应过程。具体来说,在图像转换阶段,Bi-Mix利用昼夜图像对的知识来提高夜间图像重构的质量。另一方面,在分割自适应阶段,Bi-Mix有效地弥补了昼夜域之间的分布差距,使模型适应于夜域。

- 提出了一种新的样本混合策略,使我们能够利用粗对齐的昼夜图像对之间的信息来改进翻译自适应模型。

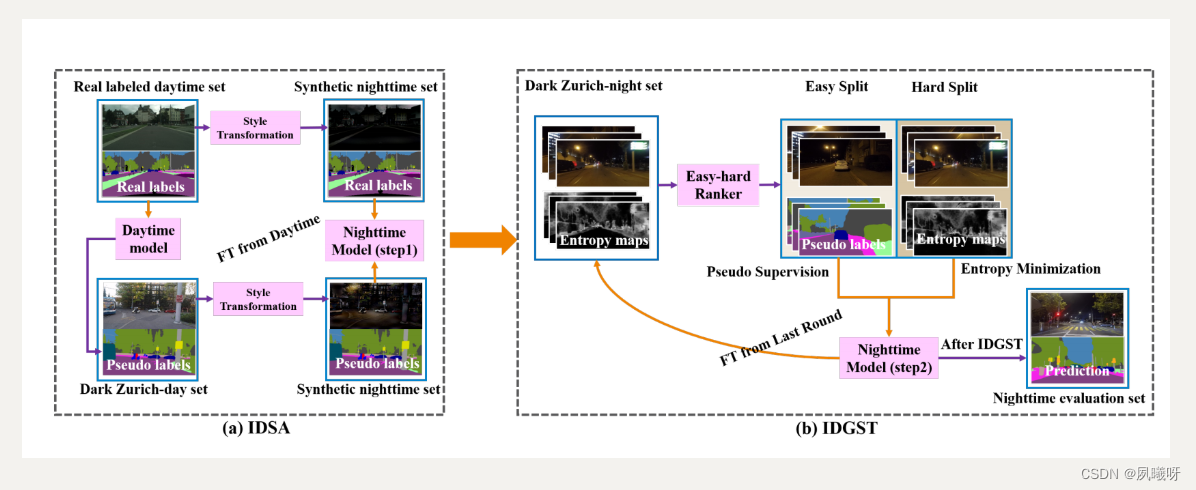

CDAda: A Curriculum Domain Adaptation for Nighttime Semantic Segmentation

2021 ICCV

解决问题

图像语义知识从白天到夜间的转移

思路

提出了一种新的课程领域自适应方法(CDAda)来实现图像语义知识从白天到夜间的平滑转移。

提出了一种遵循模型适应顺序的两步课程模型适应方法,实现更平滑的语义知识传递。具体来说,它包括两个步骤:1)域间风格适应:通过所提出的基于频率的风格转换方法(将白天图像的低频分量替换为夜间图像的低频分量),在被标记的夜间图像上调整白天的训练模型;2)域内逐步自我训练:根据“熵+照明”排序原则,将夜间域划分为容易分裂的夜间域和难分裂的夜间域,然后通过对容易分割数据的伪监督和对难分割数据的熵最小化,逐步使模型逐渐适应这两个子域。将域内适应的概念扩展到自我训练,并证明了两方面的不同处理可以减少夜间域本身的分布差异。

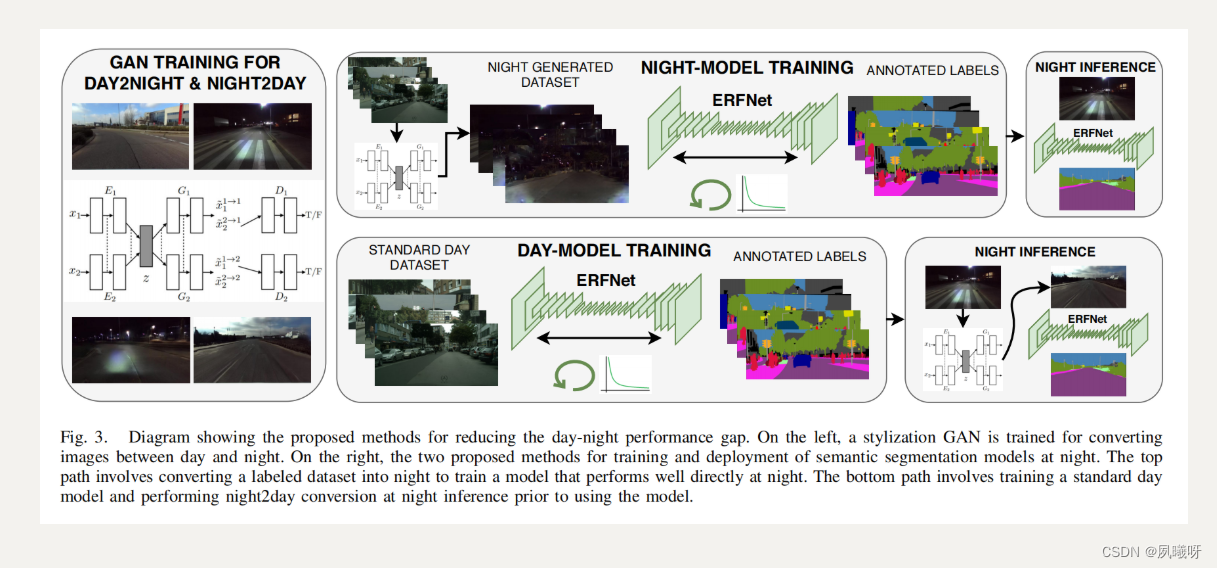

Bridging the Day and Night Domain Gap for Semantic Segmentation

2019 IEEE Intelligent Vehicles Symposium (IV)

University of Alcal´a (UAH)

解决问题

通过使用最近的技术,如生成对抗网络(GANs)来缓解白天和夜间语义分割精度差距。

思路

探索了不同的选择,如在无监督训练中扩大数据集以覆盖这些领域,或在推理过程中动态调整图像到一个舒适的领域,如在预处理步骤中的日光。

- 作者提出了一种基于Coupled GANs的图像到图像转换框架,该框架能够学习训练图像集之间的共享潜在空间,框架通过使用GANs和变分自动编码器(VAEs)对域中的每个图像进行建模。对抗性训练目标与一个权重共享约束交互,强制共享一个潜在空间,在两个领域生成相应的图像,而变分自动编码器将翻译后的图像与各自领域的输入图像联系起来。

- 使用训练过的GAN将像Cityscapes这样的数据集上的全天图像转换为夜间图像,将这些数据集集作为输入与分割标签一起输入到ERFNet,以像往常一样使用交叉熵损失进行端到端训练。

- 在模型推理前将夜间图像转换为白天图像,不需要重新训练分割模型,但是增加了推理的计算成本。

SEMANTIC NIGHTTIME IMAGE SEGMENTATION VIA ILLUMINATION AND POSITION AWARE DOMAIN ADAPTATION

2021 ICIP

首都师范大学

解决问题

一般图像分割模型在夜间场景中表现不佳

思路

提出了一种端到端夜间分割网络。

- 利用昼夜不同光照条件下的光照自适应,缩小特征图水平上的分布差距。

- 利用各物体在户外场景中位置的先验信息,结合自注意力机制可以纠正一些分类误差。

MINATION AND POSITION AWARE DOMAIN ADAPTATION

2021 ICIP

首都师范大学

解决问题

一般图像分割模型在夜间场景中表现不佳

思路

提出了一种端到端夜间分割网络。

- 利用昼夜不同光照条件下的光照自适应,缩小特征图水平上的分布差距。

- 利用各物体在户外场景中位置的先验信息,结合自注意力机制可以纠正一些分类误差。

374

374

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?