文章目录

前言

以下适用于无法通过在线命令拉取的

curl -fsSL https://ollama.com/install.sh | sh

一.官网下载 0.3.13版本

二.将文件包上传至ubuntu服务器

三.下载安装脚本

curl -fsSL https://ollama.com/install.sh

修改远程拉取ollama代码为本地解压

源需要修改的脚本代码如下

if curl -I --silent --fail --location "https://ollama.com/download/ollama-linux-${ARCH}.tgz${VER_PARAM}" >/dev/null ; then

status "Downloading Linux ${ARCH} bundle"

curl --fail --show-error --location --progress-bar \

"https://ollama.com/download/ollama-linux-${ARCH}.tgz${VER_PARAM}" | \

$SUDO tar -xzf - -C "$OLLAMA_INSTALL_DIR"

BUNDLE=1

if [ "$OLLAMA_INSTALL_DIR/bin/ollama" != "$BINDIR/ollama" ] ; then

status "Making ollama accessible in the PATH in $BINDIR"

$SUDO ln -sf "$OLLAMA_INSTALL_DIR/ollama" "$BINDIR/ollama"

fi

else

status "Downloading Linux ${ARCH} CLI"

curl --fail --show-error --location --progress-bar -o "$TEMP_DIR/ollama"\

"https://ollama.com/download/ollama-linux-${ARCH}${VER_PARAM}"

$SUDO install -o0 -g0 -m755 $TEMP_DIR/ollama $OLLAMA_INSTALL_DIR/ollama

BUNDLE=0

if [ "$OLLAMA_INSTALL_DIR/ollama" != "$BINDIR/ollama" ] ; then

status "Making ollama accessible in the PATH in $BINDIR"

$SUDO ln -sf "$OLLAMA_INSTALL_DIR/ollama" "$BINDIR/ollama"

fi

fi

新改后代码

status "Downloading Linux ${ARCH} bundle"

# curl --fail --show-error --location --progress-bar \

# "https://ollama.com/download/ollama-linux-${ARCH}.tgz${VER_PARAM}" | \

$SUDO tar -xzf ./ollama-linux-amd64.tgz -C "$OLLAMA_INSTALL_DIR"

BUNDLE=1

if [ "$OLLAMA_INSTALL_DIR/bin/ollama" != "$BINDIR/ollama" ] ; then

status "Making ollama accessible in the PATH in $BINDIR"

$SUDO ln -sf "$OLLAMA_INSTALL_DIR/ollama" "$BINDIR/ollama"

fi

四.剔除GPU相关下载ROCM等,纯CPU运行脚本

在题目3的基础上,又剔除了GPU部分,即从wls2注释将下面全部删除

完整版 离线基于CPU的运行脚本

#!/bin/sh

# This script installs Ollama on Linux.

# It detects the current operating system architecture and installs the appropriate version of Ollama.

set -eu

status() { echo ">>> $*" >&2; }

error() { echo "ERROR $*"; exit 1; }

warning() { echo "WARNING: $*"; }

TEMP_DIR=$(mktemp -d)

cleanup() { rm -rf $TEMP_DIR; }

trap cleanup EXIT

available() { command -v $1 >/dev/null; }

require() {

local MISSING=''

for TOOL in $*; do

if ! available $TOOL; then

MISSING="$MISSING $TOOL"

fi

done

echo $MISSING

}

[ "$(uname -s)" = "Linux" ] || error 'This script is intended to run on Linux only.'

ARCH=$(uname -m)

case "$ARCH" in

x86_64) ARCH="amd64" ;;

aarch64|arm64) ARCH="arm64" ;;

*) error "Unsupported architecture: $ARCH" ;;

esac

IS_WSL2=false

KERN=$(uname -r)

case "$KERN" in

*icrosoft*WSL2 | *icrosoft*wsl2) IS_WSL2=true;;

*icrosoft) error "Microsoft WSL1 is not currently supported. Please use WSL2 with 'wsl --set-version <distro> 2'" ;;

*) ;;

esac

VER_PARAM="${OLLAMA_VERSION:+?version=$OLLAMA_VERSION}"

SUDO=

if [ "$(id -u)" -ne 0 ]; then

# Running as root, no need for sudo

if ! available sudo; then

error "This script requires superuser permissions. Please re-run as root."

fi

SUDO="sudo"

fi

NEEDS=$(require curl awk grep sed tee xargs)

if [ -n "$NEEDS" ]; then

status "ERROR: The following tools are required but missing:"

for NEED in $NEEDS; do

echo " - $NEED"

done

exit 1

fi

for BINDIR in /usr/local/bin /usr/bin /bin; do

echo $PATH | grep -q $BINDIR && break || continue

done

OLLAMA_INSTALL_DIR=$(dirname ${BINDIR})

status "Installing ollama to $OLLAMA_INSTALL_DIR"

$SUDO install -o0 -g0 -m755 -d $BINDIR

$SUDO install -o0 -g0 -m755 -d "$OLLAMA_INSTALL_DIR"

status "Downloading Linux ${ARCH} bundle"

# curl --fail --show-error --location --progress-bar \

# "https://ollama.com/download/ollama-linux-${ARCH}.tgz${VER_PARAM}" | \

$SUDO tar -xzf ./ollama-linux-amd64.tgz -C "$OLLAMA_INSTALL_DIR"

BUNDLE=1

if [ "$OLLAMA_INSTALL_DIR/bin/ollama" != "$BINDIR/ollama" ] ; then

status "Making ollama accessible in the PATH in $BINDIR"

$SUDO ln -sf "$OLLAMA_INSTALL_DIR/ollama" "$BINDIR/ollama"

fi

install_success() {

status 'The Ollama API is now available at 127.0.0.1:11434.'

status 'Install complete. Run "ollama" from the command line.'

}

trap install_success EXIT

# Everything from this point onwards is optional.

configure_systemd() {

if ! id ollama >/dev/null 2>&1; then

status "Creating ollama user..."

$SUDO useradd -r -s /bin/false -U -m -d /usr/share/ollama ollama

fi

if getent group render >/dev/null 2>&1; then

status "Adding ollama user to render group..."

$SUDO usermod -a -G render ollama

fi

if getent group video >/dev/null 2>&1; then

status "Adding ollama user to video group..."

$SUDO usermod -a -G video ollama

fi

status "Adding current user to ollama group..."

$SUDO usermod -a -G ollama $(whoami)

status "Creating ollama systemd service..."

cat <<EOF | $SUDO tee /etc/systemd/system/ollama.service >/dev/null

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=$BINDIR/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

Environment="PATH=$PATH"

[Install]

WantedBy=default.target

EOF

SYSTEMCTL_RUNNING="$(systemctl is-system-running || true)"

case $SYSTEMCTL_RUNNING in

running|degraded)

status "Enabling and starting ollama service..."

$SUDO systemctl daemon-reload

$SUDO systemctl enable ollama

start_service() { $SUDO systemctl restart ollama; }

trap start_service EXIT

;;

esac

}

if available systemctl; then

configure_systemd

fi

install_success

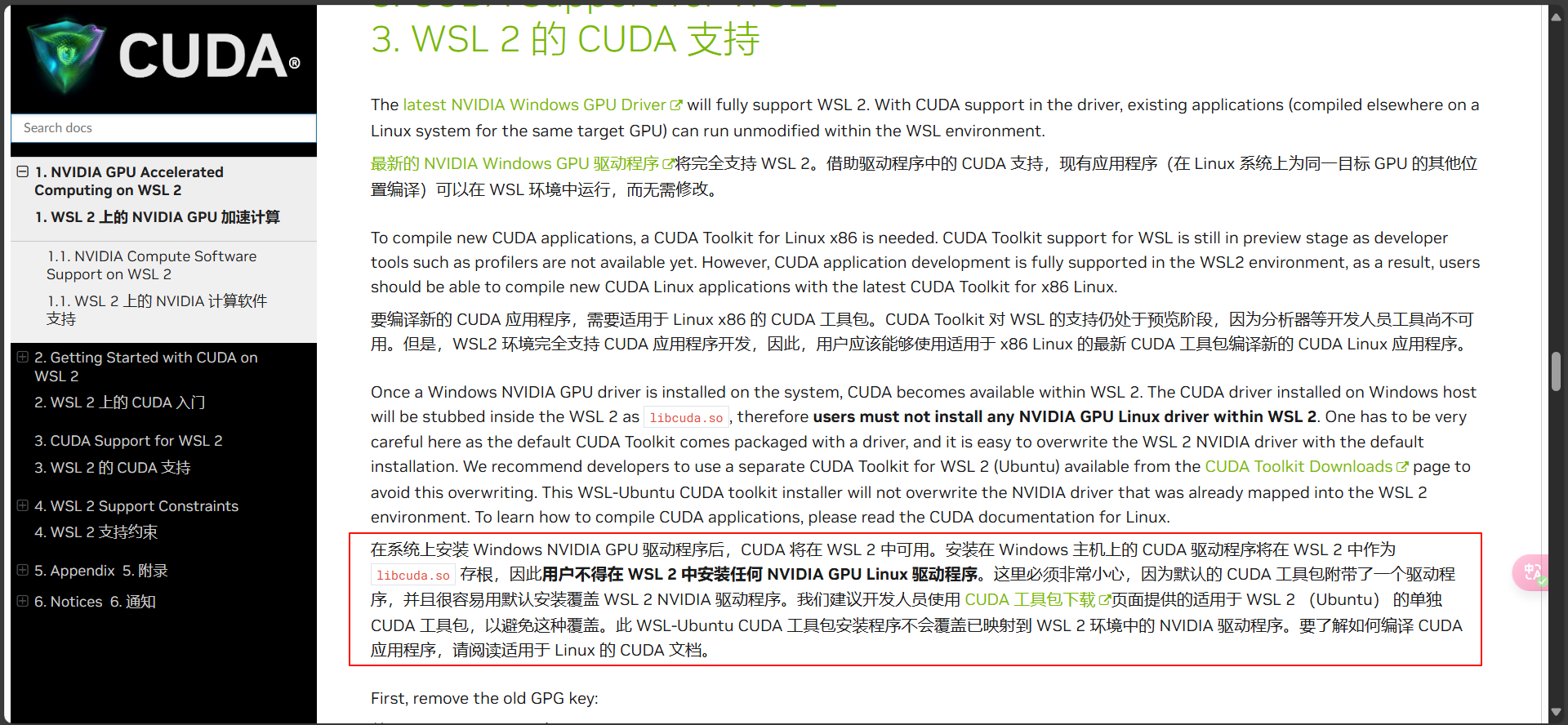

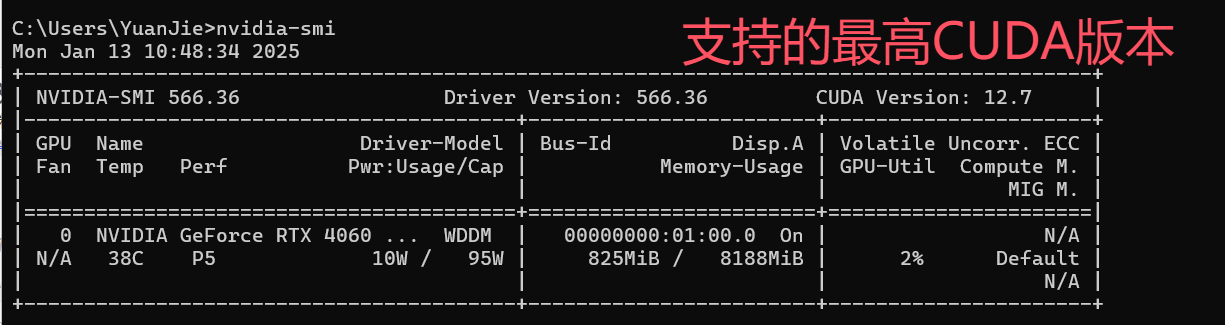

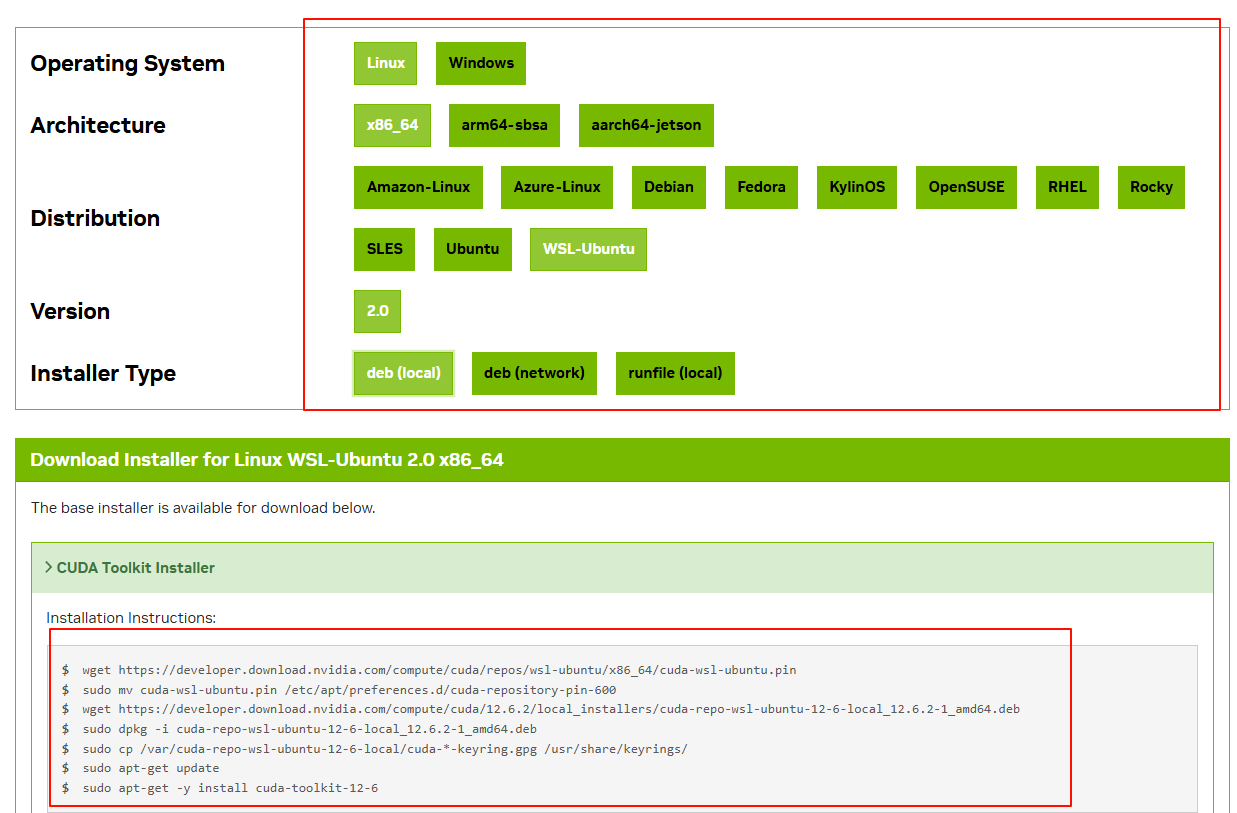

五.GPU CUDA版本

5.1 cuda版本检测

cmd运行

nvidia-smi

5.2 cuda ubuntu-wsl驱动下载

CUDA驱动官网

进入wsl执行安装命令

5.3 cuda全局变量配置

vim ~/.bashrc

#=======start ==============

#config cuda

export CUDA_HOME=/usr/local/cuda-12.6

export PATH=$PATH:$CUDA_HOME/bin

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:$CUDA_HOME/lib64

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:$CUDA_HOME/extras/CUPTI/lib64

#===========end =============

source ~/.bashrc

nvcc --version

5.4 安装ollama

curl -fsSL https://ollama.com/install.sh | sh

若拉取不下来ollama,请参照剔除cpu版修改本地安装

六.ollama常用命令

# 关闭ollama服务

service ollama stop

#ollama serve # 启动ollama

sudo systemctl start ollama # 启动ollama

ollama create # 从模型文件创建模型

ollama show # 显示模型信息

ollama run qwen3:4b # 运行模型,会先自动下载模型

ollama pull # 从注册仓库中拉取模型

ollama push # 将模型推送到注册仓库

ollama list # 列出已下载模型

ollama ps # 列出正在运行的模型

ollama cp # 复制模型

ollama rm # 删除模型

七. 远程测试

建议生产不开启,因为没有token等限制,必须注意接口调用安全

7.1 停止ollama服务

systemctl stop ollama

7.2修改ollama的service文件

vim /etc/systemd/system/ollama.service

7.3 ollama基本配置

OLLAMA_DEBUG: 显示额外的调试信息(例如:OLLAMA_DEBUG=1)。

OLLAMA_HOST: Ollama 服务器的 IP 地址(默认值:127.0.0.1:11434),如果你想要在局域网内的其他设备上访问它可以设置为0.0.0.0。

OLLAMA_PORT: 如果默认的 11434 端口被占用了,可以用它设置一个新的,比如 4567

OLLAMA_KEEP_ALIVE: 模型在内存中保持加载的时长(默认值:“5m”),防止睡眠,如果对外提供服务,可以设置类似24h这样的值,这样24小时内它就不会睡眠了,但同样的它也会一直加载在内存中。

OLLAMA_MAX_LOADED_MODELS: 每个 GPU 上最大加载模型数量。

OLLAMA_MAX_QUEUE: 请求队列的最大长度。

OLLAMA_MODELS: 模型目录的路径,默认`.ollama/models`,如果你的系统盘空间不够,或者想把模型放在更大的硬盘上可以配置指定路径。

OLLAMA_NUM_PARALLEL: 最大并行请求数。

OLLAMA_NOPRUNE: 启动时不修剪模型 blob。

OLLAMA_ORIGINS: 允许的源列表,使用逗号分隔。

OLLAMA_SCHED_SPREAD: 始终跨所有 GPU 调度模型。

OLLAMA_TMPDIR: 临时文件的位置。

OLLAMA_FLASH_ATTENTION: 启用 Flash Attention。

OLLAMA_LLM_LIBRARY: 设置 LLM 库以绕过自动检测。

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/local/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin"

Environment="OLLAMA_HOST=0.0.0.0:11434"

Environment="OLLAMA_NUM_PARALLEL=4" #并行处理请求的数量

Environment="OLLAMA_MAX_LOADED_MODELS=4" #同时加载的模型数量

[Install]

WantedBy=default.target

7.4 启动ollama

sudo systemctl daemon-reload

sudo systemctl start ollama

# 若启动失败可以使用 ollama serve测试

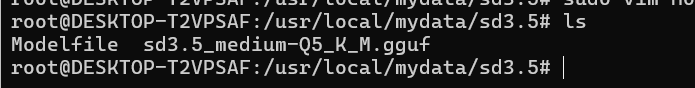

八. ollama集成自定义模型

尝试过Stable Diffusion集成ollama,但是sd在ollama上无法良好运行。故此作罢。

ollama自定义模型导入文档

创建一个名为 Modelfile 的文件,并在其中包含一个 FROM 指令,该指令指向你想要导入的模型的本地文件路径

sudo vim Modelfile

#==================

FROM ./sd3.5_medium-Q5_K_M.gguf

#==================

ollama create sd3.5_medium-Q5_K_M.gguf -f Modelfile

九.安装Dify

Dify是集成AI引擎的大作,同时具备ai门户功能。可以作为对接ai的认证授权,限流处理。同时对接多个AI引擎。类似于360纳米AI助手。360就是强!

Dify官网 到github下载源码包

官方教程

访问http://localhost/install

八.对接spring AI

<dependencyManagement>

<dependencies>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-bom</artifactId>

<version>1.0.0-SNAPSHOT</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- https://mvnrepository.com/artifact/org.springframework.ai/spring-ai-ollama -->

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-ollama</artifactId>

<!--<version>1.0.0-M5</version>-->

</dependency>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-ollama-spring-boot-starter</artifactId>

</dependency>

</dependencies>

<repositories>

<repository>

<id>spring-milestones</id>

<name>Spring Milestones</name>

<url>https://repo.spring.io/milestone</url>

<snapshots>

<enabled>false</enabled>

</snapshots>

</repository>

<repository>

<id>spring-snapshots</id>

<name>Spring Snapshots</name>

<url>https://repo.spring.io/snapshot</url>

<releases>

<enabled>false</enabled>

</releases>

</repository>

</repositories>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

若以上代码无法拉取,可能被setting.xml全局拦截到镜像站。 以上spring ai还未发布到maven中央仓库请参考maven多仓库私库模板配置

spring:

application:

name: spring-ai-ollama

ai:

ollama:

base-url: http://192.168.200.94:11434

chat:

# 为了使模型输入内容拥有更多的多样性或随机性,应当增加temperature。

#在 temperature 非零的情况下,从 0.95 左右的 top-p(或 250 左右的 top-k )开始,根据需要降低 temperature。

# 如果有太多无意义的内容、垃圾内容或产生幻觉,应当降低 temperature 和 降低top-p/top-k。

# 如果 temperature 很高而模型输出内容的多样性却很低,应当增加top-p/top-k。

# 为了获得更多样化的主题,应当增加存在惩罚值。

# 为了获得更多样化且更少重复内容的模型输出,应当增加频率惩罚。

options:

# 配置文件指定时,现在程序中指定的模型,程序没有指定模型在对应查找配置中的模型

# model: qwen3:4b

model: qwen3:4b

# 支持的最大字符数

max_tokens: 2048

# 温度值越高,准确率下降,温度值越低,准确率上升

# 对于每个提示语只需要单个答案:零。

#对于每个提示语需要多个答案:非零。

temperature: 0.4

# 随机采样 值越大,随机性越高

# 在 temperature 为零的情况下:输出不受影响。

# 在 temperature 不为零的情况下:非零。

top_p: 0.2

# 贪心解码 值越大,随机性越高

top-k: 40

# 频率惩罚 让token每次在文本中出现都受到惩罚。这可以阻止重复使用相同的token/单词/短语,同时也会使模型讨论的主题更加多样化,更频繁地更换主题

# 当问题仅存在一个正确答案时:零。

# 当问题存在多个正确答案时:可自由选择。

frequency-penalty: 0

# 存在惩罚 如果一个token已经在文本中出现过,就会受到惩罚 使其讨论的主题更加多样化,话题变化更加频繁,而不会明显抑制常用词的重复

presence-penalty: 0

@RestController

public class QianWenController {

@Resource

private OllamaChatModel ollamaChatModel;

@RequestMapping(value = "/ollama")

public Map<String, Object> ollama2(@RequestParam(value = "msg",defaultValue = "hello") String msg) {

Map<String, Object> map = new HashMap<String, Object>();

long start = System.currentTimeMillis();

ChatResponse chatResponse = ollamaChatModel.call(new Prompt(msg, OllamaOptions.builder()

.model(OllamaModel.QWEN_3_4B)//使用哪个大模型

.temperature(0.4)

.build()));//温度,温度值越高,准确率下降,温度值越低,准确率上升

String content = chatResponse.getResult().getOutput().getText();

long end = System.currentTimeMillis();

map.put("content", content);

map.put("time", (end - start) / 1000);

return map;

}

@RequestMapping(value = "/stream", produces = MediaType.TEXT_EVENT_STREAM_VALUE + ";charset=UTF-8")

public Flux<String> stream(@RequestParam(value = "msg",defaultValue = "hello") String msg) {

return ollamaChatModel

.stream(new Prompt(msg))

.flatMapSequential(chunk -> Flux.just(chunk.getResult().getOutput().getText()));

}

}

4260

4260

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?