作者:Zihan Cheng, Jintao Guo, Jian Zhang, Lei Qi, Luping Zhou, Yinghuan Shi*, Yang Gao

📜 代码地址:https://github.com/orange-czh/Mamba-Sea

✨ 摘要

- 背景:医疗图像分割在存在分布差异(domain shift)时面临挑战。

- 问题:现有DG方法多基于CNN或ViT,存在局限。

- 方法:提出 Mamba-Sea,引入 Global-to-Local Sequence Augmentation (GLA)。

- 亮点:

- GVA:全局模拟外观变化

- LSA:局部连续子序列风格扰动

- 成果:首次在Prostate数据集Dice超过90%,刷新SOTA。

1. 🚀 引言

- 传统模型基于 i.i.d 假设,但实际存在大规模分布漂移。

- CNN局限:仅能学习局部纹理。

- ViT局限:全局感受野,计算量大。

- Mamba优势:长程依赖建模 + 线性复杂度。

2. 📚 相关工作

2.1 🌍 医疗图像分割中的Domain Generalization

- Meta-learning方法(如MASF、FedDG)

- 数据增强方法(如BigAug、DoFE)

- 特征对齐方法(如RAM-DSIR、DCAC)

2.2 🛠 Mamba在医学图像分割中的应用

- Mamba-UNet、SegMamba、VM-UNetV2

- 现有方法未考虑 Domain Shift

3. 🏗 方法

3.1 🔥 总览

Mamba-Sea总体流程:

- GVA全局外观增强

- 送入带有LSA模块的VM-UNet

- 语义一致性训练

3.2 🛡 关键模块

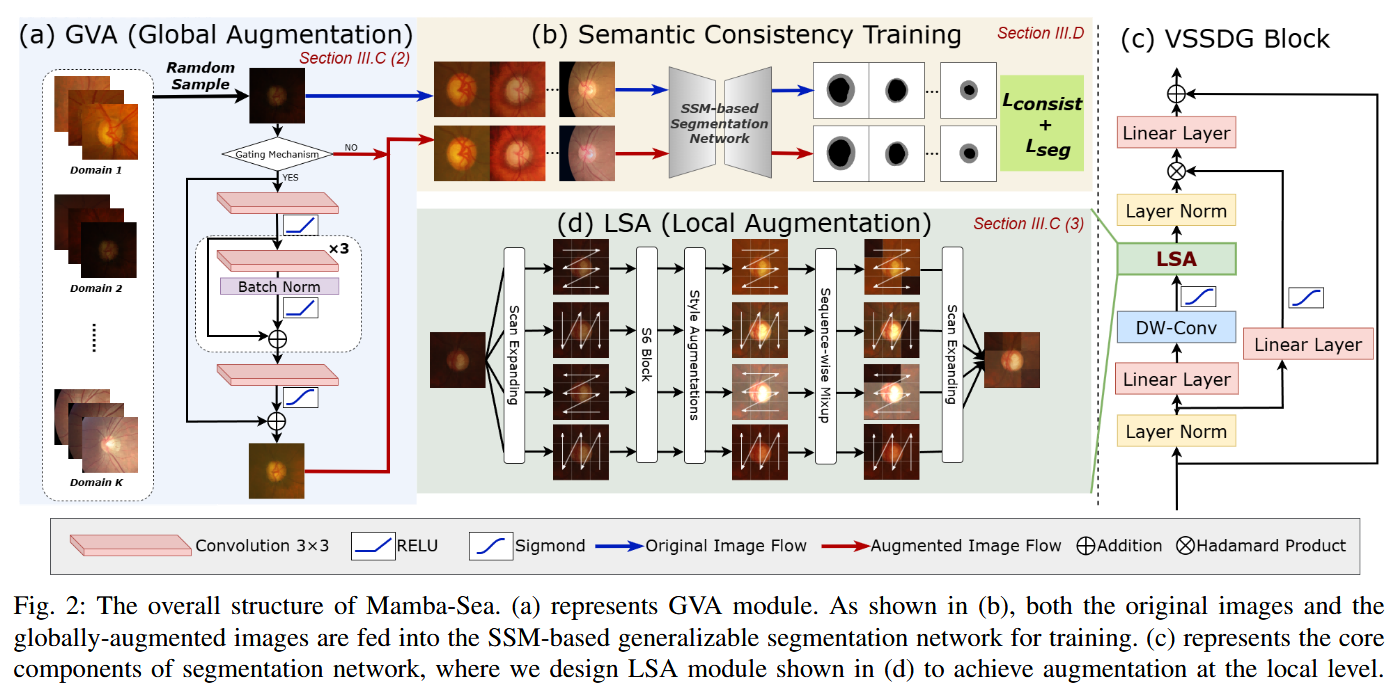

🖼 图2:Mamba-Sea整体框架示意图解释

这张图分为四大模块,分别是:(a) GVA模块、(b) 语义一致性训练、© VSSDG模块、(d) LSA局部增强模块。

(a) GVA模块 - Global Variation Augmentation 🌍

- 输入:从多个不同来源(Domain 1, Domain 2, …, Domain K)的原始图像。

- 流程:

- 经过 Gating机制:判断是否需要进行增强(比如亮度过低则增强)。

- 若需要增强,进入一个由卷积层+BatchNorm+激活(Sigmoid)组成的小网络。

- 输出:生成增强后的图像(整体外观有变化,比如亮度、对比度改变)。

- 目的:在全局级别模拟不同医院/设备造成的图像外观变化,提升泛化能力。

(b) 语义一致性训练 - Semantic Consistency Training 🎯

- 输入:

- 原始图像

- GVA增强后的图像

- 流程:

- 两种图像同时送入 SSM-based分割网络(基于VM-UNet)。

- 得到两个分割预测结果。

- 损失函数:

- L_seg:分割任务的基本损失(比如Dice loss, Cross-Entropy loss)。

- L_consist:一致性损失,鼓励增强前后预测保持一致。

- 目的:使模型输出对输入扰动更鲁棒,从而进一步提升跨域泛化能力。

© VSSDG模块 - Selective Scanning with Local Augmentation ⚙️

- 这是 网络内部的特征处理模块。

- 原本是Selective State Space Block (SS Block),这里被改进:

- 加入了**LSA(Local Style Augmentation)**模块,作为新的路径。

- 结构细节:

- 多个Linear Layer + Depthwise-Conv(DW-Conv)

- 多次LayerNorm标准化

- 通过Hadamard乘积和加法整合不同特征

- 目的:在局部token建模时,引入风格扰动,打破过拟合,增强域内变化的适应性。

(d) LSA模块 - Local Sequence-wise Style Transformation 🧩

- 位置:插入到VSSDG模块内部。

- 流程:

- Scan Expanding:把图像特征展开成序列。

- Style Augmentations:对每个序列进行风格统计扰动(均值、方差加噪声)。

- Sequence-wise Mixup:连续地混合原始序列和增强序列(而不是随机单点扰动)。

- Scan Merging:重新组合成图像特征。

- 目的:在局部级别模拟风格变化,帮助模型学到更稳定、更有语义的特征。

🔥 总结一张话

| 模块 | 作用 | 目标 |

|---|---|---|

| (a) GVA | 整体外观增强 | 模拟不同医院采集条件 |

| (b) 语义一致性训练 | 保持增强前后输出一致 | 抗扰动泛化 |

| © VSSDG | 改良版SSM模块 | 融合局部增强 |

| (d) LSA | 局部子序列风格扰动 | 对局部变化更鲁棒 |

4. 🧪 实验

4.1 🗂 数据集

- Fundus(眼底)数据集

- Prostate(前列腺MRI)数据集

- Skin Lesion(大规模皮肤病变分割)

4.2 🏆 主要结果

| 方法 | Fundus Dice ↑ | Prostate Dice ↑ | Skin Lesion Dice ↑ |

|---|---|---|---|

| Baseline (VM-UNet) | 86.90% | 87.56% | 90.78% |

| Mamba-Sea (Ours) | 89.68% | 90.02% | 93.11% |

- 在所有任务上,Mamba-Sea大幅提升,尤其是在Skin Lesion任务上取得了新SOTA。

4.3 🧩 消融实验

| 模块组合 | Fundus Dice ↑ | Prostate Dice ↑ |

|---|---|---|

| 去除GVA | 87.84% | 87.72% |

| 去除LSA | 88.65% | 88.79% |

| 全部保留(Mamba-Sea) | 89.68% | 90.02% |

- GVA和LSA模块均带来明显提升。

4.4 📈 进一步分析

- t-SNE分析显示,Mamba-Sea能极大缩小不同域之间的特征分布距离。

- Hyperparameter分析表明模型对参数变化不敏感,稳定性好。

- 统计显著性测试(paired t-test)确认性能提升有效(p < 0.05)。

5. 🧠 讨论与结论

- 总结:首次探索Mamba在Domain Generalization中的潜力,提出有效的全局到局部序列增强策略。

- 未来方向:结合更复杂的序列建模机制、进一步提升Mamba在医学领域的普适性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?