Hive是一个数据仓库基础工具在Hadoop中用来处理结构化数据。它架构在Hadoop之上,总归为大数据,并使得查询和分析方便。并提供简单的sql查询功能,可以将sql语句转换为MapReduce任务进行运行。

术语“大数据”是大型数据集,其中包括体积庞大,高速,以及各种由与日俱增的数据的集合。使用传统的数据管理系统,它是难以加工大型数据。因此,Apache软件基金会推出了一款名为Hadoop的解决大数据管理和处理难题的框架。

1、什么是hive

最初,Hive是由Facebook开发,后来由Apache软件基金会开发,并作为进一步将它作为名义下Apache Hive为一个开源项目。它用在好多不同的公司。例如,亚马逊使用它在 Amazon Elastic

1.1、hive

- 一个关系数据库

- 一个设计用于联机事务处理(OLTP)

- 实时查询和行级更新的语言

1.2、hive特点

- 它存储架构在一个数据库中并处理数据到HDFS。

- 它是专为OLAP设计。

- 它提供SQL类型语言查询叫HiveQL或HQL。

- 它是熟知,快速,可扩展和可扩展的。

- 本质上是将Hive SQL 转化成 Map Reduce 程序

1.3、hive适合做什么

hive是基于Hadoop的一个数据仓库,可以将结构化的数据映射成一张表,下面是它和其他数据库的区别

| hive | RDBMS | |

| 查询语言 | HQL(和SQL类似) | SQL |

| 数据储存 | HDFS | Raw Device 或者 Local FS |

| 执行器 | MapReduce | Executor(Java的一种框架) |

| 处理数据规模 | 相对较大 | 相对较小 |

| 适用场景 | 大数据查询 | 实时查询 |

| 执行延迟 | 相对较高 | 相对较低 |

| 索引 | 0.8版本后支持简单索引 | 支持复杂索引 |

| 扩展性 | 好 | 相对较差 |

| 加载模式 | 读时模式 | 写时模式 |

| 数据操作 | 覆盖追加 | 行级更新删除 |

| 分区 | 支持 | 支持 |

hive比较适合做数据仓库,用于海量的离线数据统计分析。

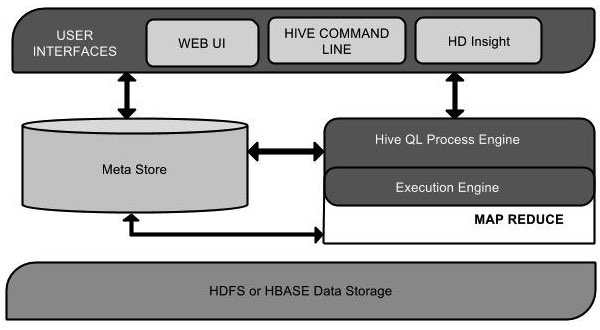

1.4、hive架构

Hive的结构:

该组件图包含不同的单元。下表描述每个单元:

| 单元名称 | 操作 |

|---|---|

| 用户接口/界面 | Hive是一个数据仓库基础工具软件,可以创建用户和HDFS之间互动。用户界面,Hive支持是Hive的Web UI,Hive命令行,HiveHD洞察(在Windows服务器)。 |

| 元存储 | Hive选择各自的数据库服务器,用以储存表,数据库,列模式或元数据表,它们的数据类型和HDFS映射。 |

| HiveQL处理引擎 | HiveQL类似于SQL的查询上Metastore模式信息。这是传统的方式进行MapReduce程序的替代品之一。相反,使用Java编写的MapReduce程序,可以编写为MapReduce工作,并处理它的查询。 |

| 执行引擎 | HiveQL处理引擎和MapReduce的结合部分是由Hive执行引擎。执行引擎处理查询并产生结果和MapReduce的结果一样。它采用MapReduce方法。 |

| HDFS 或 HBASE | Hadoop的分布式文件系统或者HBASE数据存储技术是用于将数据存储到文件系统。 |

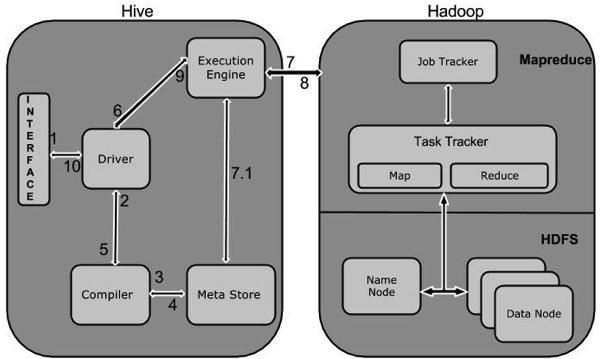

1.5、Hive工作原理

Hive 和Hadoop之间的工作流程。

Hive和Hadoop框架的交互方式:

| Step No. | 操作 |

|---|---|

| 1 | Execute Query Hive接口,如命令行或Web UI发送查询驱动程序(任何数据库驱动程序,如JDBC,ODBC等)来执行。 |

| 2 | Get Plan 在驱动程序帮助下查询编译器,分析查询检查语法和查询计划或查询的要求。 |

| 3 | Get Metadata 编译器发送元数据请求到Metastore(任何数据库)。 |

| 4 | Send Metadata Metastore发送元数据,以编译器的响应。 |

| 5 | Send Plan 编译器检查要求,并重新发送计划给驱动程序。到此为止,查询解析和编译完成。 |

| 6 | Execute Plan 驱动程序发送的执行计划到执行引擎。 |

| 7 | Execute Job 在内部,执行作业的过程是一个MapReduce工作。执行引擎发送作业给JobTracker,在名称节点并把它分配作业到TaskTracker,这是在数据节点。在这里,查询执行MapReduce工作。 |

| 7.1 | Metadata Ops 与此同时,在执行时,执行引擎可以通过Metastore执行元数据操作。 |

| 8 | Fetch Result 执行引擎接收来自数据节点的结果。 |

| 9 | Send Results 执行引擎发送这些结果值给驱动程序。 |

| 10 | Send Results 驱动程序将结果发送给Hive接口。 |

2、安装部署hive数据仓库

- 提前安装好MySQL 服务和Hadoop集群。

- 下载hive安装包https://hive.apache.org/找到对应的版本。

- 更具个人习惯将hive安装到指定目录

- 修改配置文件在 hive/conf 中

- hive-env.sh(将hive-env.sh.template 重名为 hive-env.sh 或者直接用命令 mv hive-env.sh.template hive-env.sh )

#配置HADOOP_HOME路径 这里的路径是更具自己实际路径来的

export HADOOP_HOME=/opt/program/hadoop

#配置HIVE_CONF_DIR路径 同理

export HIVE_CONF_DIR=/opt/program/hive/conf- 修改 hive-site.xml (这里的配置文件主要是配置了用户名和密码还有一些必要的驱动)

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://node1:3306/hive?createDatabaseIfNotExist=true&useSSL=false&useUnicode=true&characterEncoding=UTF-8</value>

<description>JDBC connect string for a JDBC metastore</description>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description>Driver class name for a JDBC metastore</description>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>username to use against metastore database</description>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>root</value>

<description>password to use against metastore database</description>

</property>

</configuration>

- 当然这里的驱动要放到对应的位置MySQL的驱动应该放到 hive/lib 下

https://dev.mysql.com/downloads/connector/j/ 到该网站就是下载对应版本的MySQL驱动

3、hive交互方式

3.1、shell

cd /opt/program/hive (将目录改到对应的位置) bin/hive 启动hive

3.2、hive JDBC 服务

····前台启动

bin/hive --service hiveserver2

····后台启动

nohup bin/hive --service hiveserver2 &

····beeline连接hiveserver2

bin/beeline beeline> !connect jdbc:hive2://node1:10000

3.3、hive的命令

- hive -e sql语句

- 使用 –e 参数来直接执行hql的语句

- cd /opt/bigdata/hive

- bin/hive -e "show databases"

- 显示数据库等等。。。。

3032

3032

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?