# 《动手学深度学习》——李沐

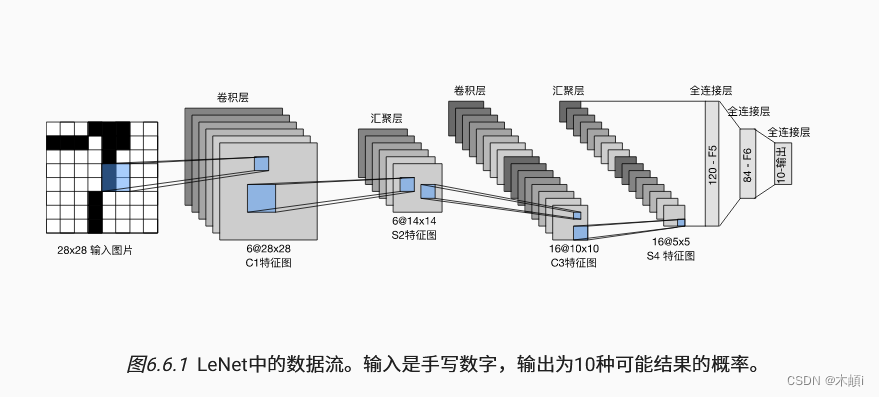

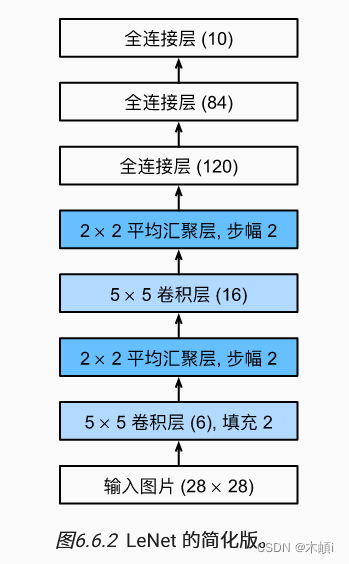

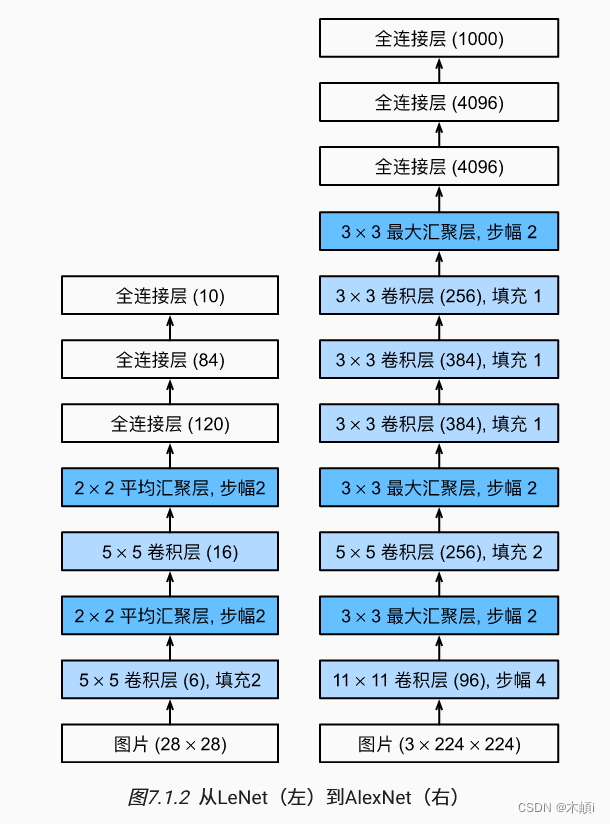

LeNet

两层卷积+三个全连接层。

AlexNet

与LeNet的设计理念类似,但仍存在这许多差异。

- AlexNet深度更深,五个卷积层+三个全连接层

- 使用ReLu作为激活函数,相比sigmoid更加简单。并且缓解梯度消失的问题。

- Maxpooling

VGG(使用块的网络)

经典卷积神经网络的基本组成部分是下面的这个序列:

- 带填充以保持分辨率的卷积层;

- 非线性激活函数,如ReLU;

- 汇聚层,如最大汇聚层

VGG 网络可以分为两部分:

- 第一部分主要由卷积层和汇聚层组成

- 第二部分由全连接层组成

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1617

1617

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?