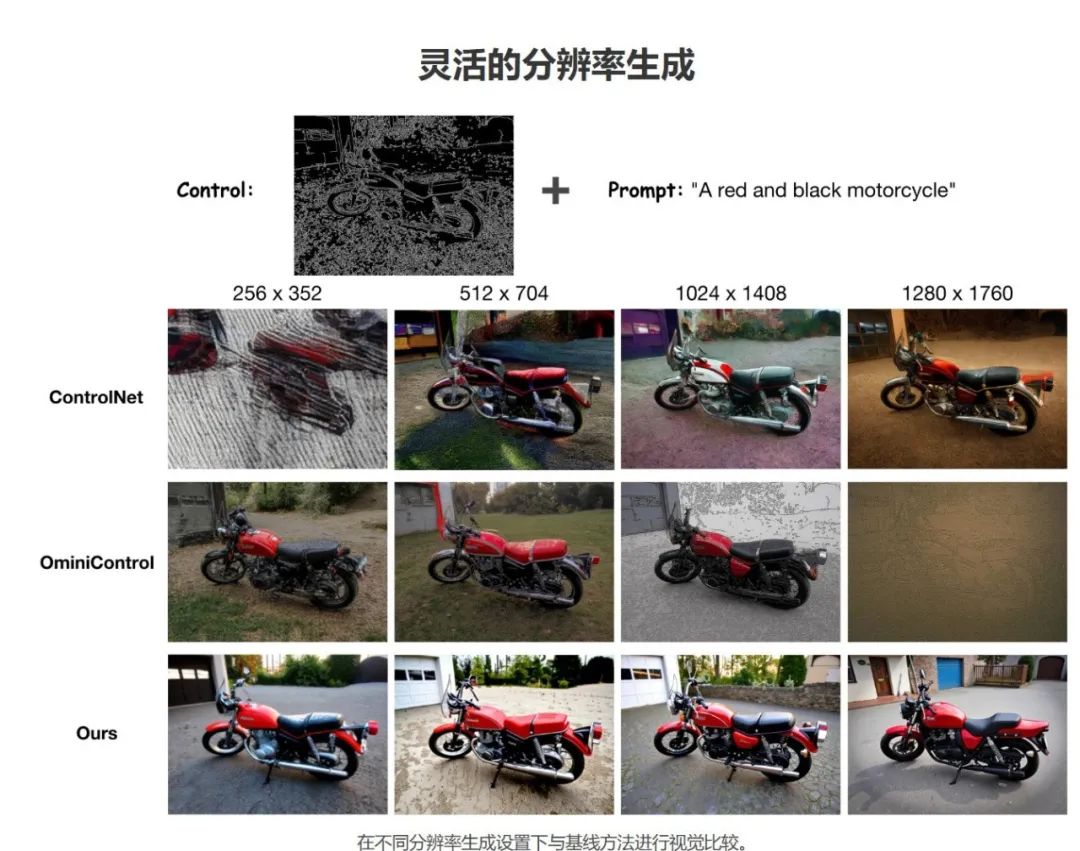

我怎么记得,Midjourney V7才发布2天,还在用MJ素材炼丹的时候,大家竟然还不知道怎么用(白嫖)MJ V7?请看VCR用上了白嫖GPT4O!!!选择AI绘画,自动选择V7版本,言归正传,Flux的Controlnet生态感觉有点子慢,不过目前SDXL的Controlnet都没凑齐,慢就靠大佬的社区力量了,EasyControl 是一个基于 Diffusion Transformer 的创新框架,通过轻量级的条件注入模块、位置感知训练范式和因果注意力机制,实现高效灵活的多条件受控图像生成。,盘点一下已经有的Flux的Controlnet生态。

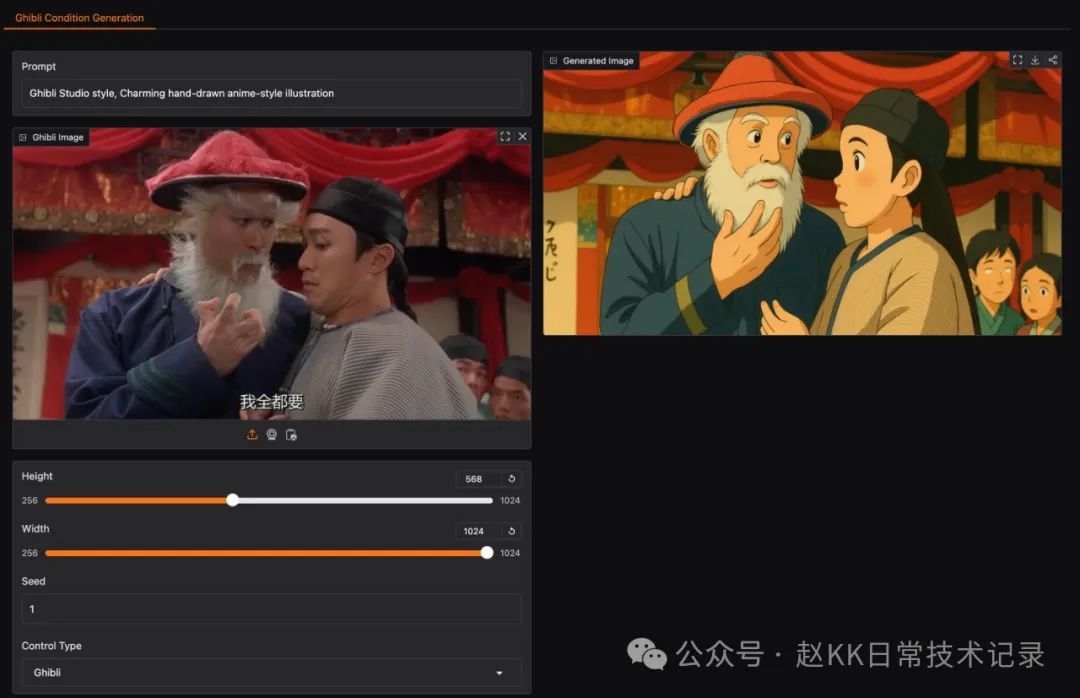

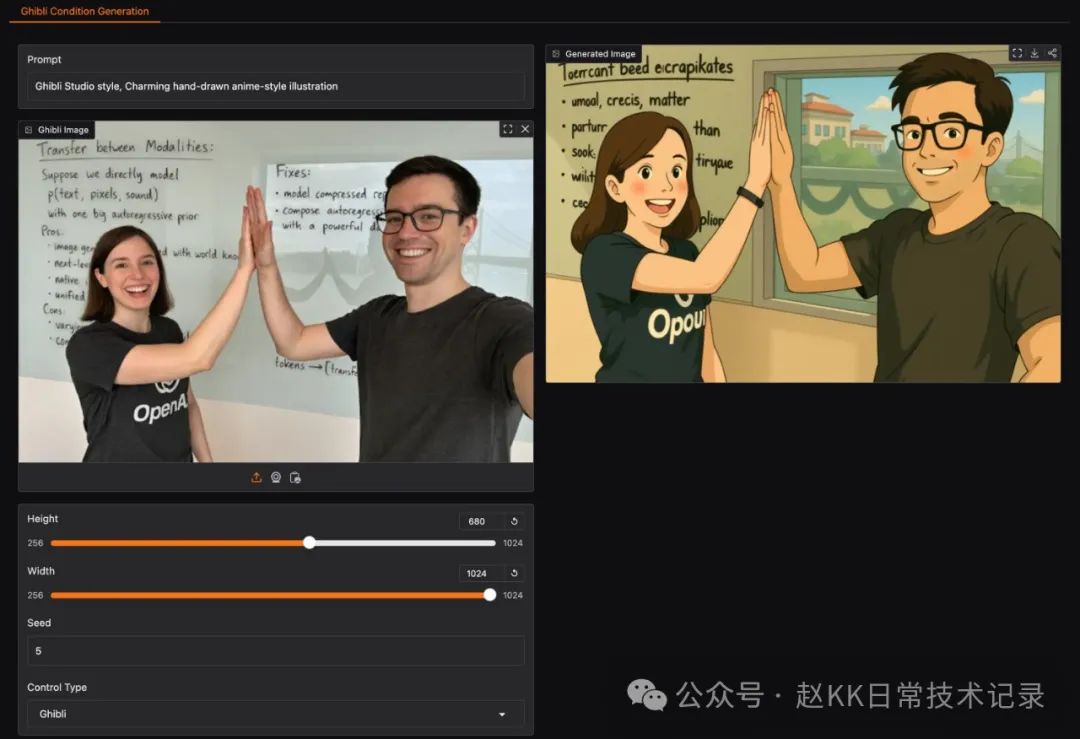

吉卜力Flux版本Lora发布

这份完整版的AI新手入门资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

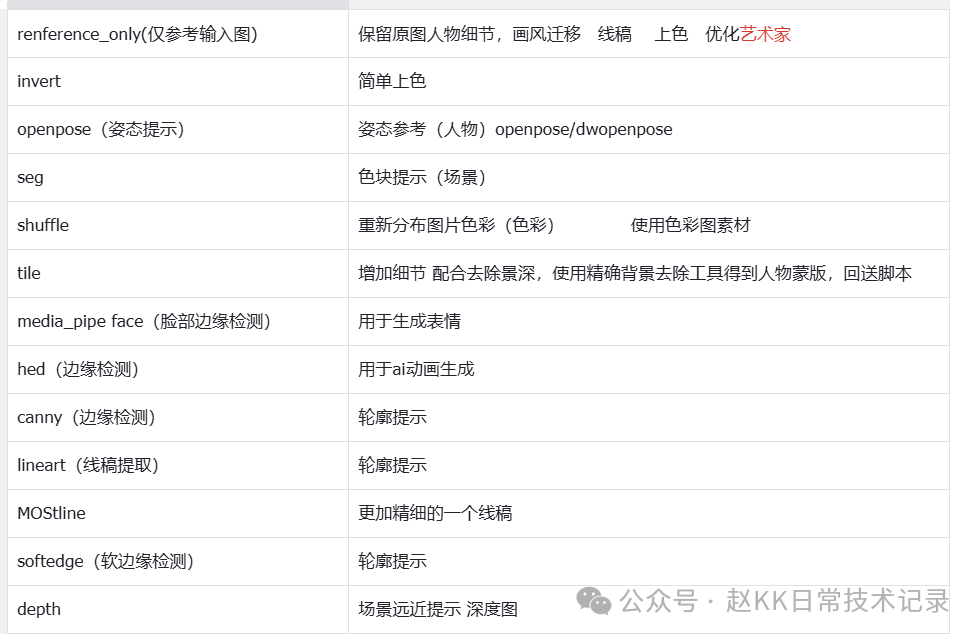

Flux的****Controlnet生态

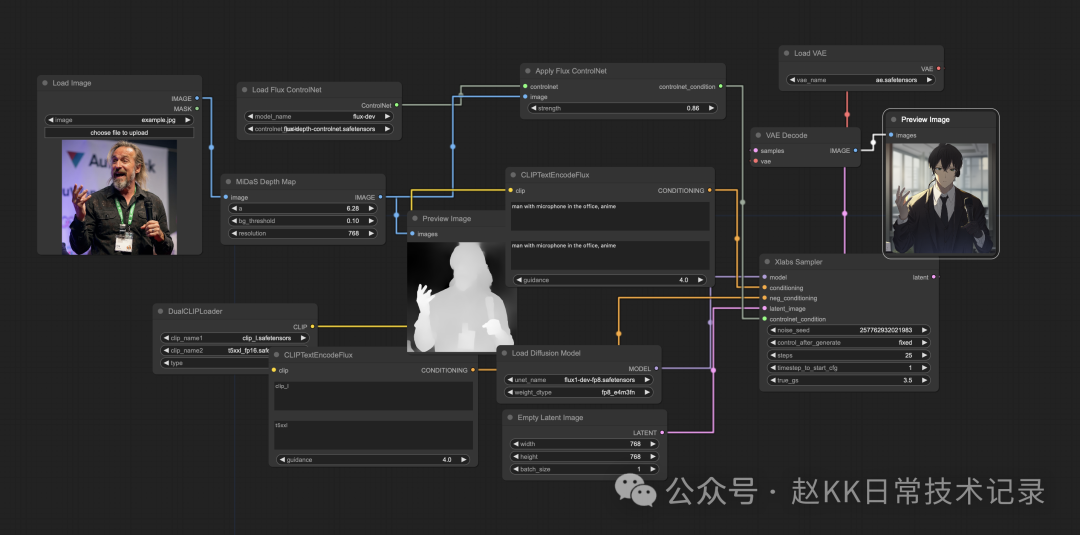

XLabs-AI/flux-controlnet-collections:为FLUX.1-dev模型提供的ControlNet检查点集合,支持Canny(边缘检测)、HED(边缘检测)、Depth(深度图,基于Midas)三种模型,所有模型都在1024x1024分辨率上训练,适用于生成1024x1024分辨率的图像,提供v3版本,可在ComfyUI中使用,还提供ComfyUI的自定义节点和工作流程

flux-RealismLora:可以增强FLUX模型照片级真实感

InstantX Flux Union ControlNet:多功能的ControlNet模型,专为FLUX.1开发版设计,整合了多种控制模式,包括Canny边缘检测、Tile(图块)、深度图、模糊、姿势控制等,支持同时使用多个控制模式,与FLUX.1开发版基础模型完全兼容

FLUX.1-dev-Controlnet-Union-alpha:融合了Canny、Depth、Pose、Tile等多种控制条件的模型,目前模型开源可用,但有一些小bugs官方正在修复

JasperAI的模型

- Flux.1-dev-Controlnet-Depth:专注于深度图的ControlNet模型

- Flux.1-dev-Controlnet-Surface-Normals:专注于表面法线的ControlNet模型

- Flux.1-dev-Controlnet-Upscaler:用于图像上采样的ControlNet模型

Mistoline的模型

Flux.1-dev-Mistoline:专注于线条艺术风格的ControlNet模型

Shakker-Labs的模型

-

FLUX.1-dev-ControlNet-Union-Pro:支持7种控制模式,包括canny、tile、深度、模糊、姿势、灰色、低质量等

https://huggingface.co/Shakker-Labs/FLUX.1-dev-ControlNet-Union-Pro/tree/main所需要的插件

https://github.com/EeroHeikkinen/ComfyUI-eesahesNodes

目前大多数模型与FLUX.1开发版基础模型完全兼容,可以轻松集成到现有的FLUX工作流程中,但是大家发现没,这么多版本,咋就没有个像我SD1.5这么全的生态?

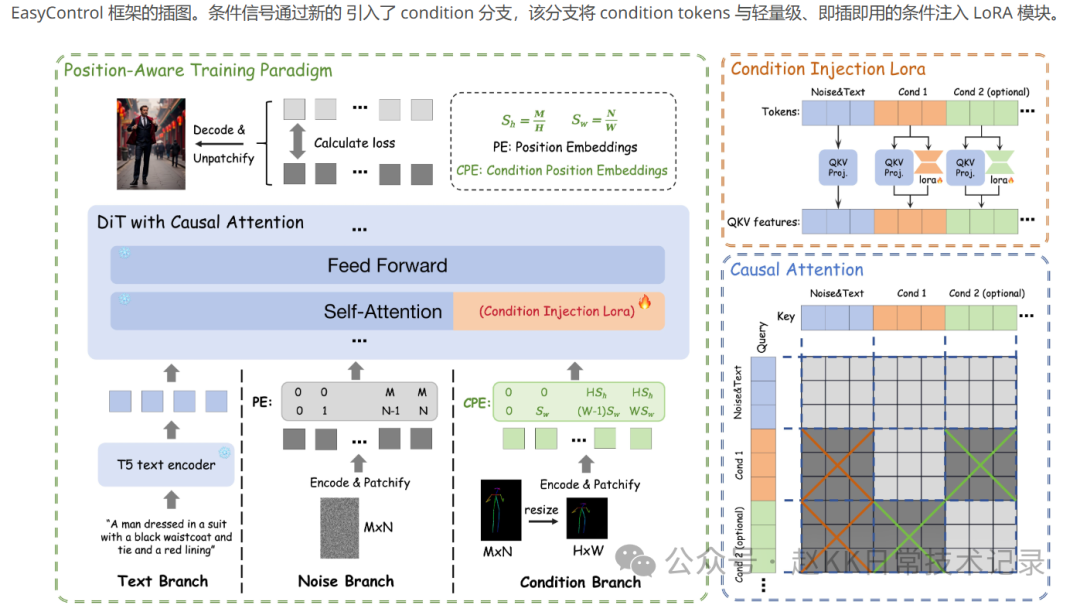

EasyControl

- 论文:https://arxiv.org/pdf/2503.07027

- 主页:https://easycontrolproj.github.io/

- 代码:https://github.com/Xiaojiu-z/EasyControl

- 模型:https://huggingface.co/Xiaojiu-Z/EasyControl/

- 试用:https://huggingface.co/spaces/jamesliu1217/EasyControl/

既然是易于控制的,想必是很全面的

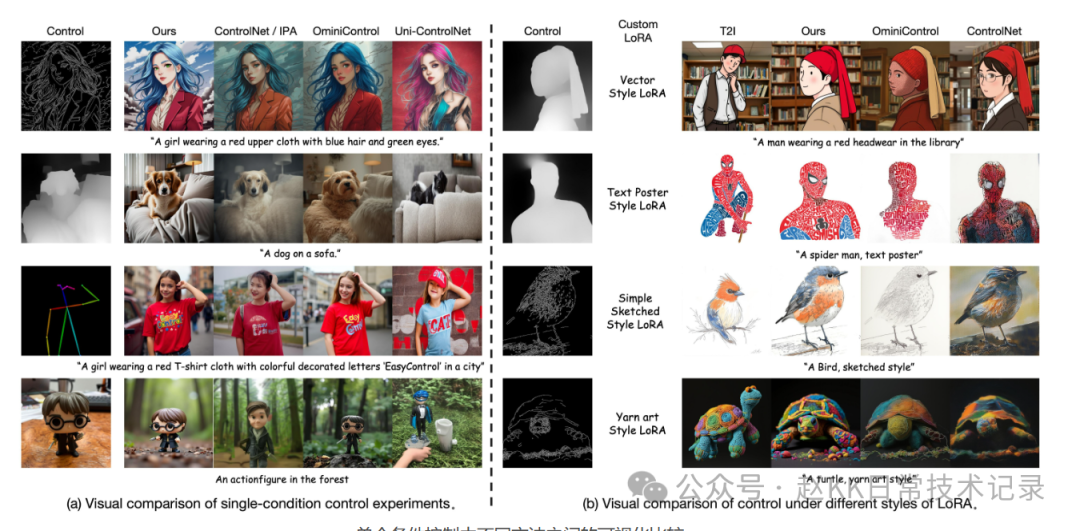

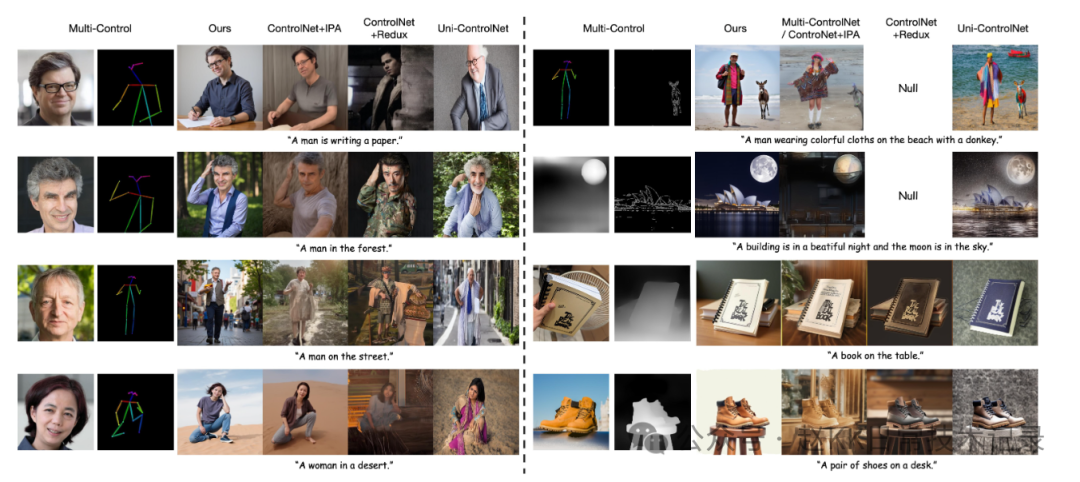

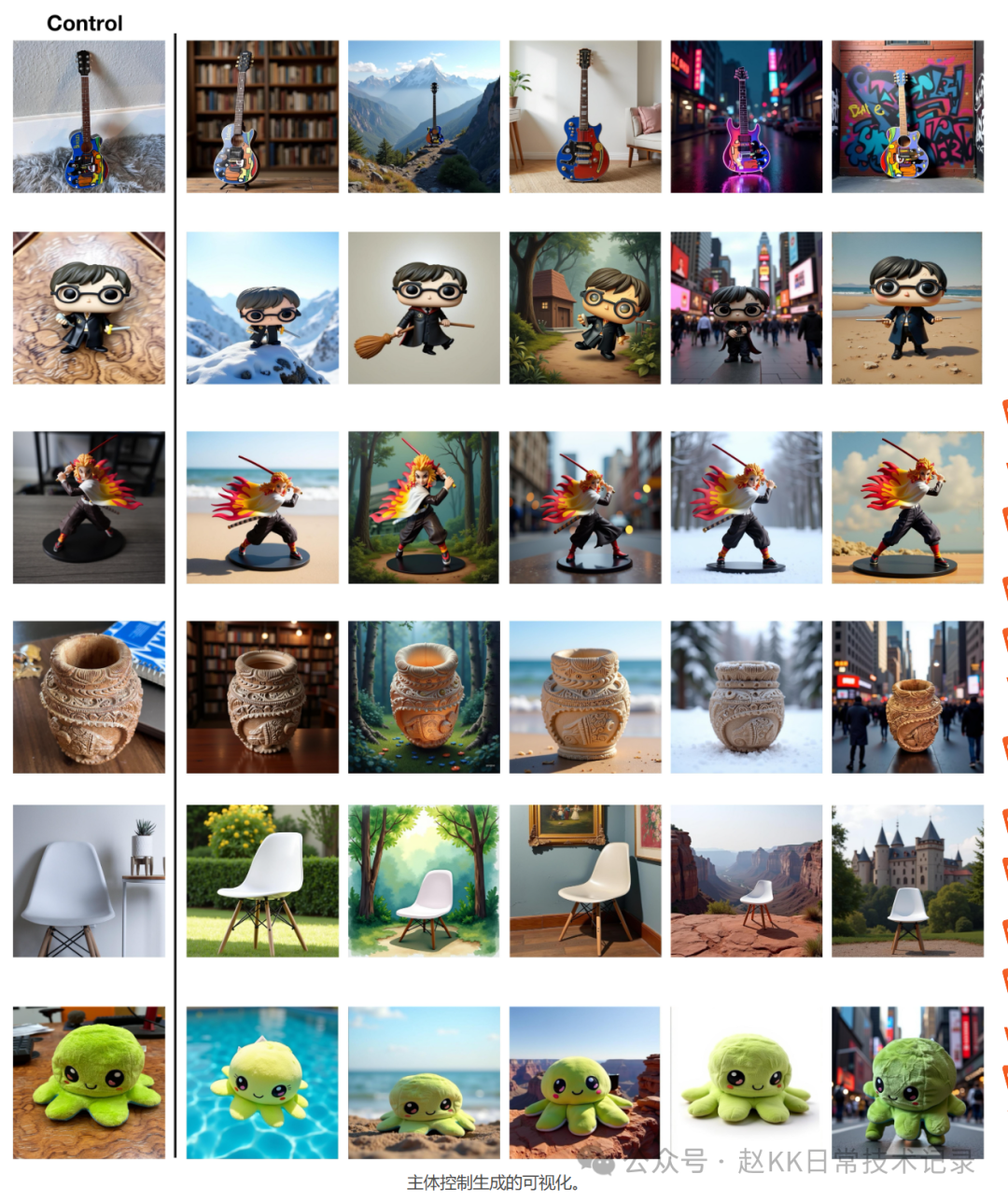

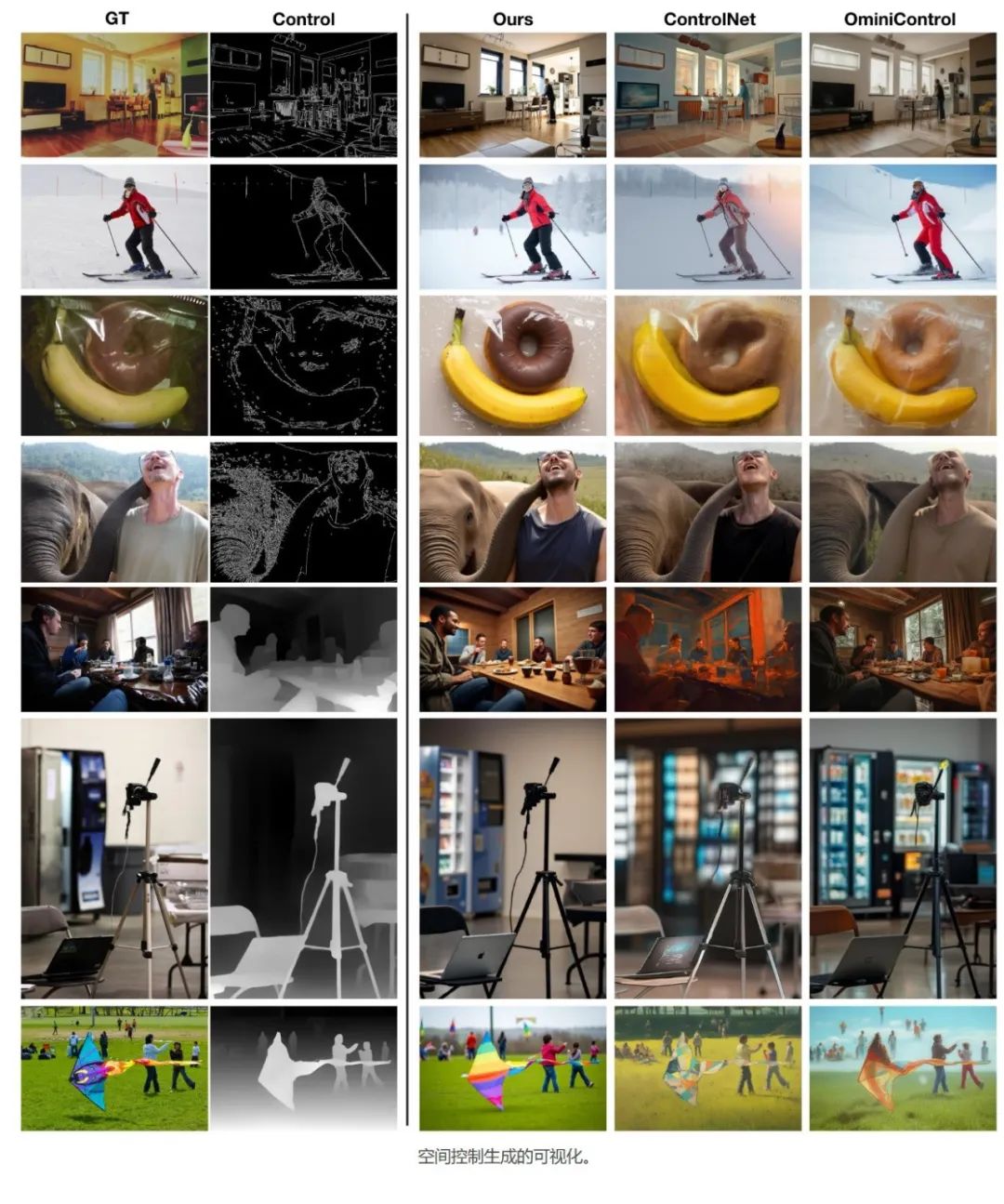

EasyControl 是一个基于 Diffusion Transformer 的创新框架,通过轻量级的条件注入模块、位置感知训练范式和因果注意力机制,实现高效灵活的多条件受控图像生成。

框架

LoRA 支持

openPose

目前来看,基本上把主流的Controlnet进行了整合,看起来真的容易,不过目前还没有量化版本,仍旧需要高显存,基本要来到24G,目前工作流已经上传, 免费的地址基本由于太过于火热不可用

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

这份完整版的AIGC全套学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1006

1006

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?