ps:机智流的github项目链接SmartFlowAI/Llama3-Tutorial: Llama3-Tutorial(XTuner、LMDeploy、OpenCompass) (github.com)

一、使用vscode远程连接开发机

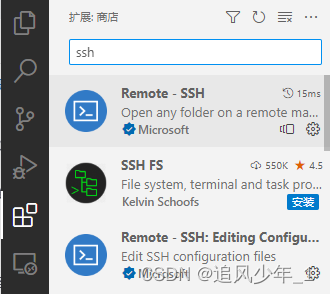

1. 安装 VSCode 插件

安装完 VSCode 之后,打开 VSCode 并点击左侧的扩展按钮,搜索并安装如下插件:

- Remote SSH

点击 Install ,安装 Remote SSH 的同时也会安装

- Remote - SSH: Editing Configurat

- Remote Explorer

2. 配置 VSCode 远程连接开发机

安装完插件之后,我们来到InternStudio,可以看到以下界面,然后我们点击"创建开发机",

接着我们配置开发机的名称,镜像以及GPU资源,

完成开发机创建以后,我们启动开发机,点击 SSH 连接。

复制登录命令

然后回到 VSCode 点击左侧的远程按钮,点击 SSH 的 + 号,在弹出的窗口中输入开发机的登录命令。

将 ssh 登录信息写入配置文件,我们刷新 ssh 列表就可以看到我们刚刚配置的 ssh 连接了。

点击连接,输入密码,就成功连接到开发机了。

3. 配置 VSCode 端口映射

下面会介绍两种端口映射的方法:

方法一:

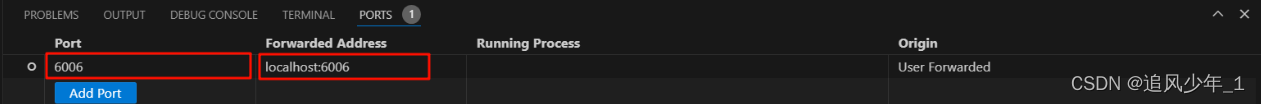

我们可以使用 Ctrl + Shift + ~ 快捷键打开 VSCode 终端,然后点击右边的 Ports 界面,接着点击 Foward a Port 按钮。

比如我们的端口为 6006 在这里我们就可以这样设置。

其中第一个 port 是映射在本机的端口,后面的Fowarded Address 是开发机的IP地址和端口。也就是将开发机的 6006 端口映射在了本机的 6006 这个端口,当然本机的端口是可以更改的。

但我们运行 streamlit 或者是 gradio 应用的时候,VSCode 会自动的帮我们进行端口映射,并不需要我们手动操作,所以我们介绍另一种端口映射方法,也是最常用的。

方法二:

我们打开本机的终端,我们使用 powershell,但是要确保你的本机是由 OpenSSH 服务的。

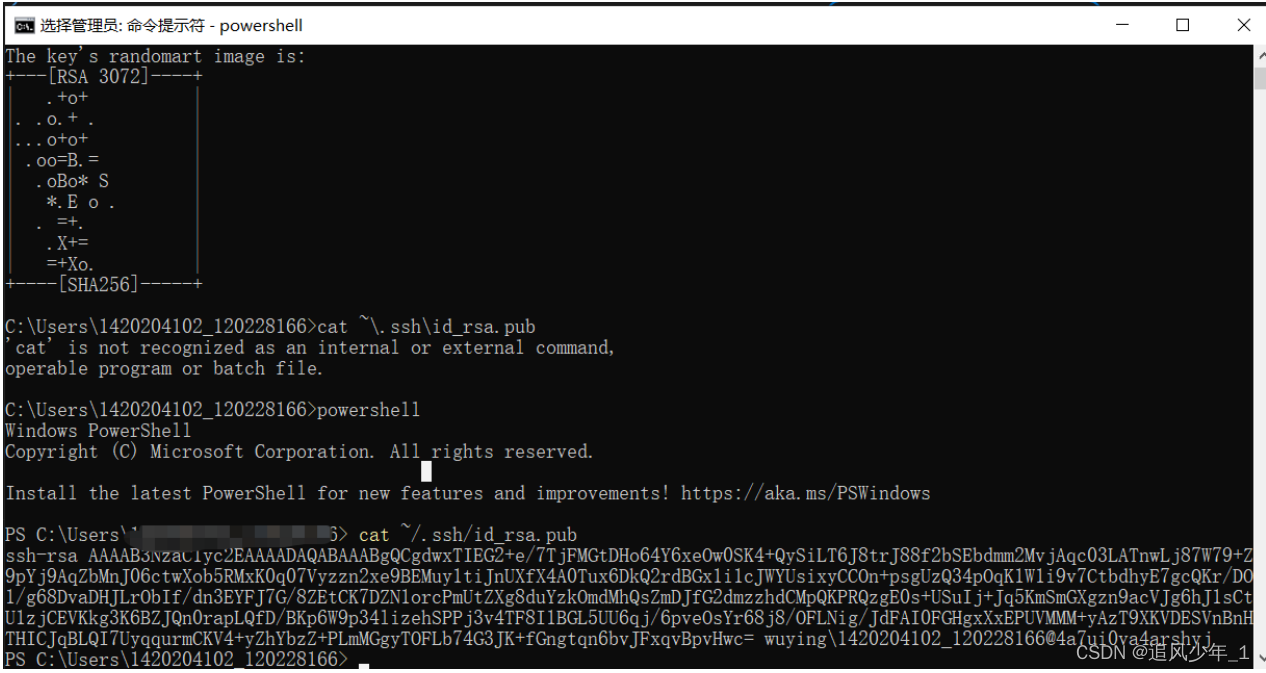

1. 配置 ssh 密钥

配置 ssh 密钥一方面是方便我们登录,这样我们不用每次连接都需要输入密码,另一方面是为了我们端口映射的安全。 首先我们需要配置 ssh 密钥, 在powershell 中输入以下命令;

ssh-keygen -t rsa公钥默认存储在 ~/.ssh/id_rsa.pub,可以通过系统自带的 cat 工具查看文件内容:

cat ~/.ssh/id_rsa.pub

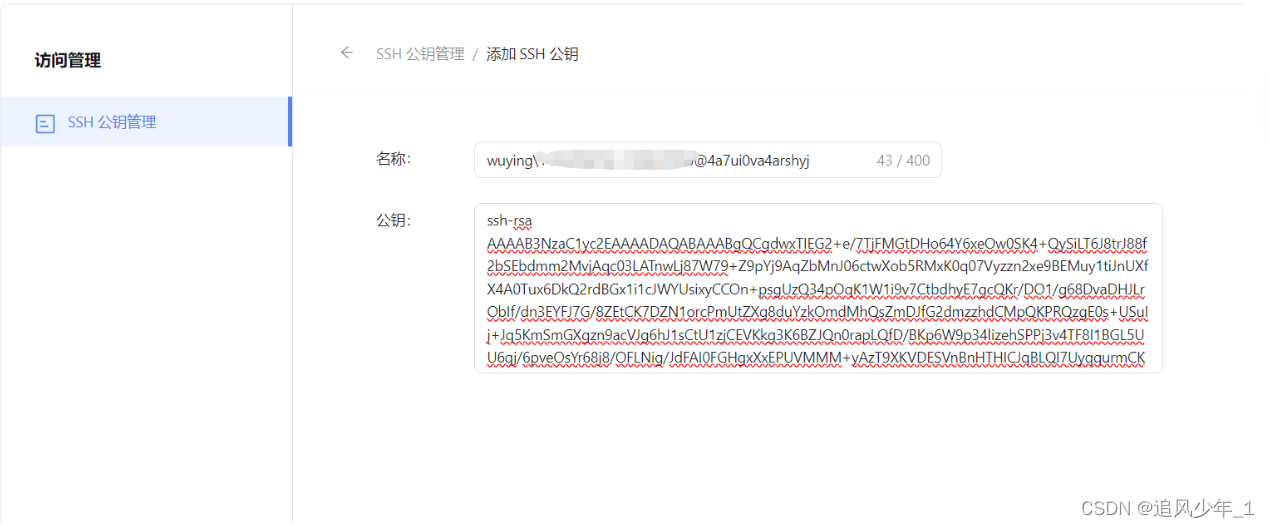

2. 将 ssh 密钥添加到 InternStudio中

我们回到 InternStudio,找到配置 SSH Key,将我们刚刚生成的 ssh 公钥添加到 InternStudio 中,它会自动识别主机名称。

3. 进行端口映射

接着我们来到开发机控制台,点击自定义服务,复制下面的命令:

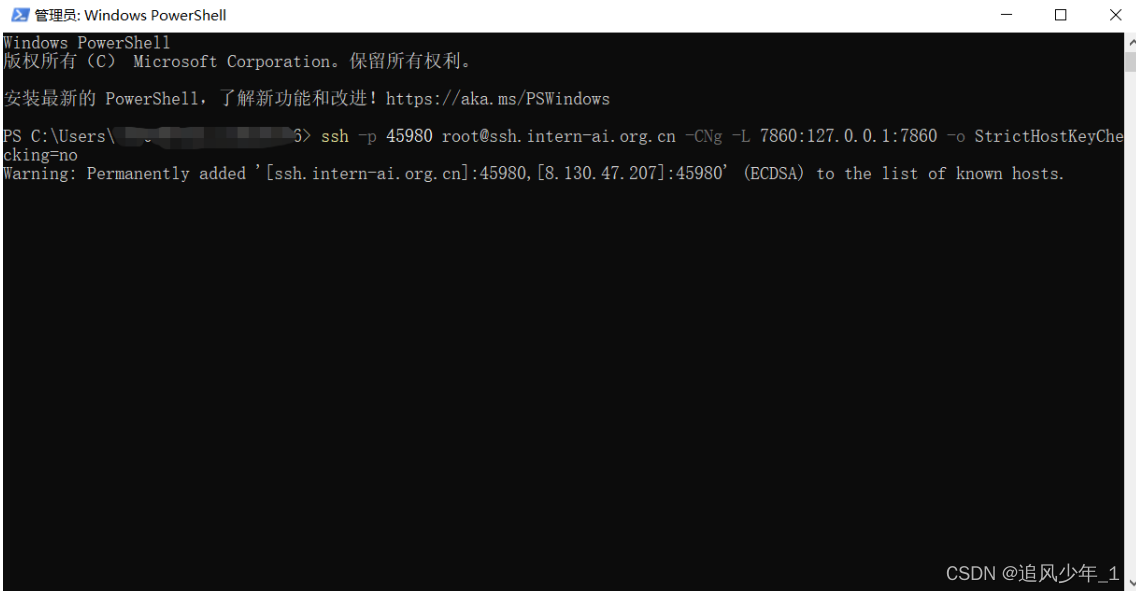

ssh -p 45980 root@ssh.intern-ai.org.cn -CNg -L 7860:127.0.0.1:7860 -o StrictHostKeyChecking=no其中 45980 是你当前运行的开发机的端口,7860 是我们要进行映射端口,这个端口要根据运行的应用程序的端口来自行修改。

将复制的命令粘贴到本机的 powershell 中,回车

如果出现如上图所示的情况,就说明已经成功进行了端口映射,它不输出任何信息是正常的,因为端口映射服务正在运行

二、实践教程

1. 创建虚拟环境

conda create -n llama3 python=3.10

conda activate llama3

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia2. 下载模型

新建文件夹

mkdir -p ~/model

cd ~/model从OpenXLab中获取权重(开发机中不需要使用此步)或者软链接 InternStudio 中的模型

ln -s /root/share/new_models/meta-llama/Meta-Llama-3-8B-Instruct ~/model/Meta-Llama-3-8B-Instruct3. Web Demo 部署

cd ~

git clone

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9474

9474

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?