✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,

代码获取、论文复现及科研仿真合作可私信。

🍎个人主页:Matlab科研工作室

🍊个人信条:格物致知。

更多Matlab完整代码及仿真定制内容点击👇

🔥 内容介绍

智能优化算法是一种通过模拟人类学习过程来解决复杂问题的方法。这些算法通过不断迭代和优化,能够找到问题的最优解或接近最优解。其中一种被广泛应用的智能优化算法是人类学习优化算法(Human Learning-based Optimization,简称HL)。

人类学习优化算法是基于人类学习过程的一种启发式算法。它模拟了人类在解决问题时的学习和调整过程,通过不断试错和优化来逐步接近最优解。这种算法的设计灵感来自于人类的智慧和经验,将其转化为计算机可执行的优化过程。

HL算法的流程可以分为以下几个步骤:

-

初始化种群:首先,需要随机生成一组个体作为初始种群。这些个体代表了问题的可能解,每个个体都有一组特征或参数。初始种群的大小可以根据问题的复杂性和规模来确定。

-

评估适应度:对于每个个体,需要计算其适应度值。适应度值代表了个体解决问题的优劣程度,可以根据问题的具体情况来定义。适应度值越高,个体的解决方案越优秀。

-

选择操作:在选择操作中,根据个体的适应度值来确定哪些个体将被选中作为下一代的父代。适应度值高的个体有更高的概率被选中,以保留其优秀的特征和解决方案。

-

交叉操作:在交叉操作中,选中的父代个体将进行基因交换,生成新的后代个体。交叉操作的目的是通过融合不同个体的优秀特征,产生更优秀的解决方案。

-

变异操作:在变异操作中,对新生成的后代个体进行基因突变。变异操作的目的是引入一定的随机性,以避免陷入局部最优解。通过变异操作,算法可以在解空间中进行更广泛的搜索。

-

更新种群:通过选择、交叉和变异操作生成的后代个体将用于更新种群。更新后的种群将成为下一代的父代,继续进行下一轮的迭代优化。

-

终止条件判断:在每一轮迭代中,都需要判断是否满足终止条件。终止条件可以是达到最大迭代次数、找到满意的解决方案或算法无法进一步改进等。一旦满足终止条件,算法将停止迭代并输出最终的解决方案。

人类学习优化算法HL的优点在于其能够通过模拟人类学习过程来解决复杂问题。它能够在搜索空间中进行全局搜索,并且具有较好的收敛性和鲁棒性。另外,HL算法还可以灵活地应用于不同类型的问题,包括函数优化、组合优化、路径规划等。

然而,HL算法也存在一些挑战和限制。首先,算法的性能高度依赖于问题的特性和参数的选择。不同的问题可能需要不同的参数设置,以获得较好的优化效果。其次,算法的计算复杂度较高,特别是在解决大规模问题时。因此,对于某些复杂问题,可能需要进行算法的改进和优化。

总的来说,人类学习优化算法HL是一种有潜力的智能优化算法。通过模拟人类学习过程,它能够解决各种复杂问题,并在实践中取得了一定的成功。随着对算法的进一步研究和改进,相信HL算法将在更多领域发挥重要作用,并为解决实际问题提供有效的解决方案。

📣 部分代码

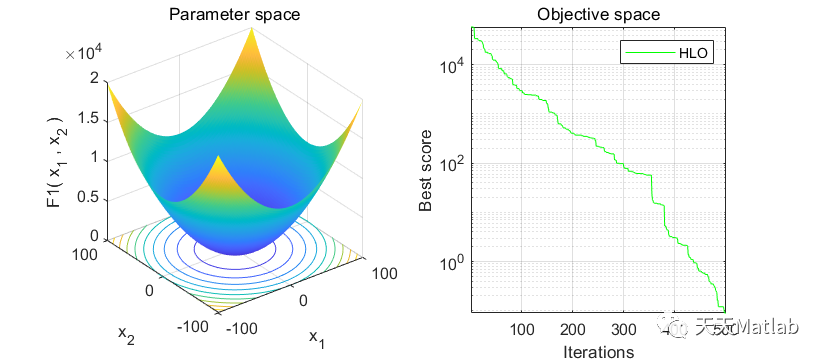

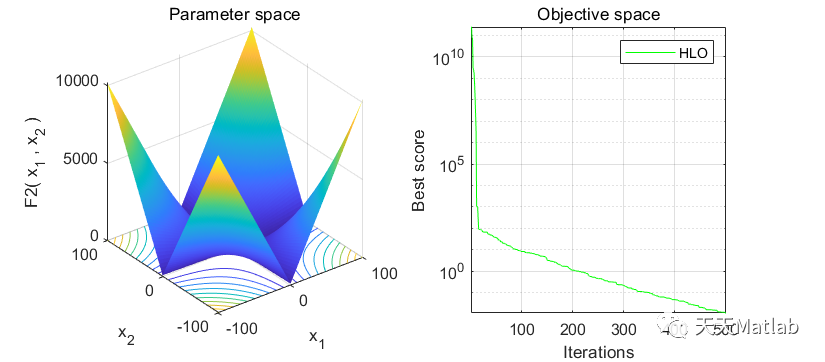

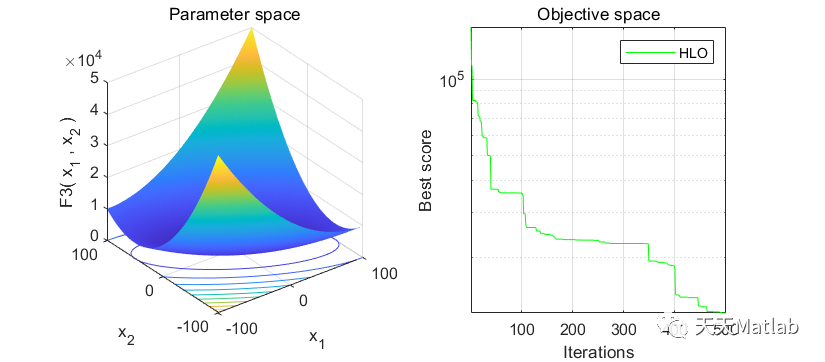

function fun_plot(fun_name)[lowerbound,upperbound,dimension,fitness]=fun_info(fun_name);switch fun_namecase 'F1'x=-100:2:100; y=x; %[-100,100]case 'F2'x=-100:2:100; y=x; %[-10,10]case 'F3'x=-100:2:100; y=x; %[-100,100]case 'F4'x=-100:2:100; y=x; %[-100,100]case 'F5'x=-200:2:200; y=x; %[-5,5]case 'F6'x=-100:2:100; y=x; %[-100,100]case 'F7'x=-1:0.03:1; y=x %[-1,1]case 'F8'x=-500:10:500;y=x; %[-500,500]case 'F9'x=-5:0.1:5; y=x; %[-5,5]case 'F10'x=-20:0.5:20; y=x;%[-500,500]case 'F11'x=-500:10:500; y=x;%[-0.5,0.5]case 'F12'x=-10:0.1:10; y=x;%[-pi,pi]case 'F13'x=-5:0.08:5; y=x;%[-3,1]case 'F14'x=-100:2:100; y=x;%[-100,100]case 'F15'x=-5:0.1:5; y=x;%[-5,5]case 'F16'x=-1:0.01:1; y=x;%[-5,5]case 'F17'x=-5:0.1:5; y=x;%[-5,5]case 'F18'x=-5:0.06:5; y=x;%[-5,5]case 'F19'x=-5:0.1:5; y=x;%[-5,5]case 'F20'x=-5:0.1:5; y=x;%[-5,5]case 'F21'x=-5:0.1:5; y=x;%[-5,5]case 'F22'x=-5:0.1:5; y=x;%[-5,5]case 'F23'x=-5:0.1:5; y=x;%[-5,5]endL=length(x);f=[];for i=1:Lfor j=1:Lif strcmp(fun_name,'F15')==0 && strcmp(fun_name,'F19')==0 && strcmp(fun_name,'F20')==0 && strcmp(fun_name,'F21')==0 && strcmp(fun_name,'F22')==0 && strcmp(fun_name,'F23')==0f(i,j)=fitness([x(i),y(j)]);endif strcmp(fun_name,'F15')==1f(i,j)=fitness([x(i),y(j),0,0]);endif strcmp(fun_name,'F19')==1f(i,j)=fitness([x(i),y(j),0]);endif strcmp(fun_name,'F20')==1f(i,j)=fitness([x(i),y(j),0,0,0,0]);endif strcmp(fun_name,'F21')==1 || strcmp(fun_name,'F22')==1 ||strcmp(fun_name,'F23')==1f(i,j)=fitness([x(i),y(j),0,0]);endendendsurfc(x,y,f,'LineStyle','none');end

⛳️ 运行结果

3444

3444

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?