先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Python全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Python知识点,真正体系化!

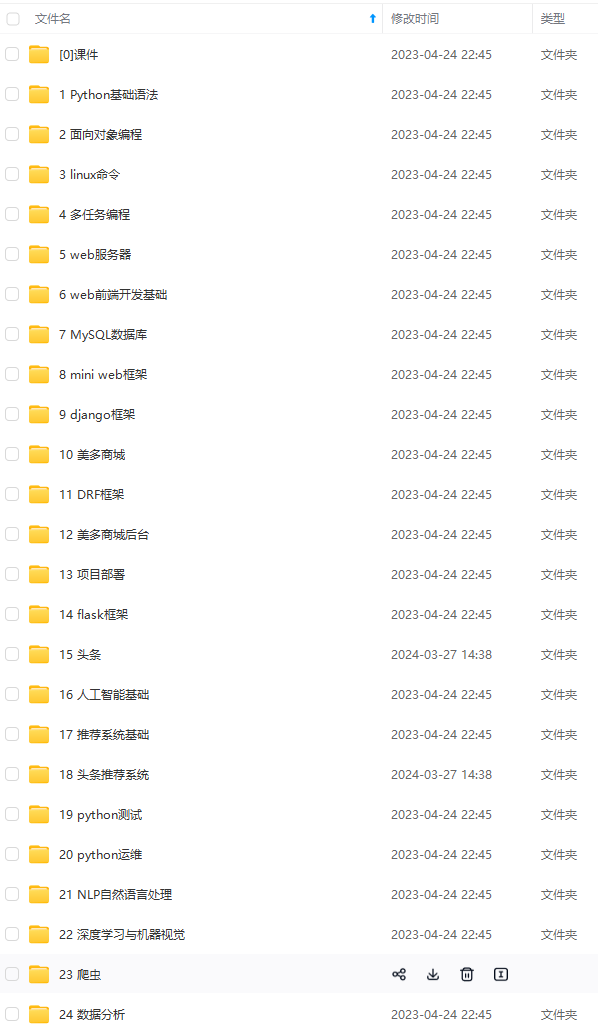

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024c (备注Python)

正文

class Adagrad():

def init(self, learning_rate=0.01):

self.learning_rate = learning_rate

self.G = None # Sum of squares of the gradients

self.eps = 1e-8

def update(self, w, grad_wrt_w):

If not initialized

if self.G is None:

self.G = np.zeros(np.shape(w))

Add the square of the gradient of the loss function at w

self.G += np.power(grad_wrt_w, 2)

Adaptive gradient with higher learning rate for sparse data

return w - self.learning_rate * grad_wrt_w / np.sqrt(self.G + self.eps)

class Adadelta():

def init(self, rho=0.95, eps=1e-6):

self.E_w_updt = None # Running average of squared parameter updates

self.E_grad = None # Running average of the squared gradient of w

self.w_updt = None # Parameter update

self.eps = eps

self.rho = rho

def update(self, w, grad_wrt_w):

If not initialized

if self.w_updt is None:

self.w_updt = np.zeros(np.shape(w))

self.E_w_updt = np.zeros(np.shape(w))

self.E_grad = np.zeros(np.shape(grad_wrt_w))

Update average of gradients at w

self.E_grad = self.rho * self.E_grad + (1 - self.rho) * np.power(grad_wrt_w, 2)

RMS_delta_w = np.sqrt(self.E_w_updt + self.eps)

RMS_grad = np.sqrt(self.E_grad + self.eps)

Adaptive learning rate

adaptive_lr = RMS_delta_w / RMS_grad

Calculate the update

self.w_updt = adaptive_lr * grad_wrt_w

Update the running average of w updates

self.E_w_updt = self.rho * self.E_w_updt + (1 - self.rho) * np.power(self.w_updt, 2)

return w - self.w_updt

class RMSprop():

def init(self, learning_rate=0.01, rho=0.9):

self.learning_rate = learning_rate

self.Eg = None # Running average of the square gradients at w

self.eps = 1e-8

self.rho = rho

def update(self, w, grad_wrt_w):

If not initialized

if self.Eg is None:

self.Eg = np.zeros(np.shape(grad_wrt_w))

self.Eg = self.rho * self.Eg + (1 - self.rho) * np.power(grad_wrt_w, 2)

Divide the learning rate for a weight by a running average of the magnitudes of recent

gradients for that weight

return w - self.learning_rate * grad_wrt_w / np.sqrt(self.Eg + self.eps)

class Adam():

def init(self, learning_rate=0.001, b1=0.9, b2=0.999):

self.learning_rate = learning_rate

self.eps = 1e-8

self.m = None

self.v = None

Decay rates

self.b1 = b1

self.b2 = b2

def update(self, w, grad_wrt_w):

If not initialized

if self.m is None:

self.m = np.zeros(np.shape(grad_wrt_w))

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

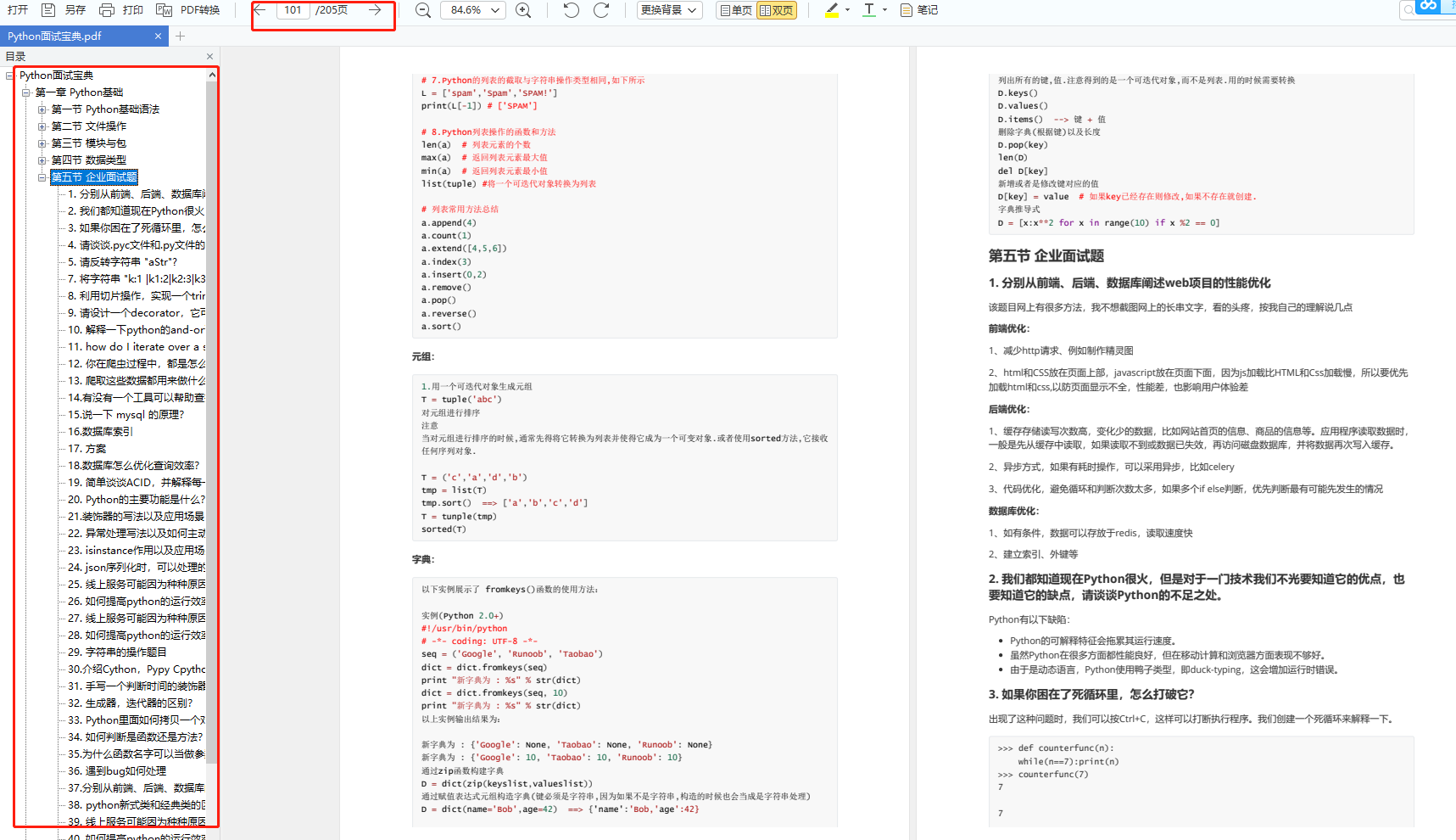

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

五、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

[外链图片转存中…(img-AyS6YZgL-1713329806032)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

3535

3535

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?