K近邻算法原理介绍

K近邻算法(K-Nearest-Neighbor, KNN)是一种用于分类和回归的非参数统计方法,它正是基于以上思想:要确定一个样本的类别,可以计算它与所有训练样本的距离,然后找出和该样本最接近的k个样本,统计出这些样本的类别并进行投票,票数最多的那个类就是分类的结果。KNN的三个基本要素:

1. K值,一个样本的分类是由K个邻居的“多数表决”确定的。K值越小,容易受噪声影响,反之,会使类别之间的界限变得模糊。

2. 距离度量,反映了特征空间中两个样本间的相似度,距离越小,越相似。常用的有Lp距离(p=2时,即为欧式距离)、曼哈顿距离、海明距离等。

3. 分类决策规则,通常是多数表决,或者基于距离加权的多数表决(权值与距离成反比)。

分类问题

1. 在训练样本集中找出距离待测样本x_test最近的k个样本,并保存至集合N中;

2. 统计集合N中每一类样本的个数:;

3. 最终的分类结果为

回归问题

假设离测试样本最近的k个训练样本的标签值为,则对样本的回归预测输出值为:

即为所有邻居的标签均值。

带样本权重的回归预测函数为:

其中为第i个样本的权重

距离的定义

KNN样本之间的距离常用欧氏距离,定义为:

需要特别注意的是,使用欧氏距离时,应将特征向量的每个分量归一化,以减少因为特征值的尺度范围不同所带来的干扰,否则数值小的特征分量会被数值大的特征分量淹没。

数据处理

数据准备

使用葡萄酒数据集,三种葡萄酒中每种所含13中成分的量,用于KNN的实现

from download import download

# 下载红酒数据集

url = "https://ascend-professional-construction-dataset.obs.cn-north-4.myhuaweicloud.com:443/MachineLearning/wine.zip"

path = download(url, "./", kind="zip", replace=True)数据读取与处理

import os

import csv

import numpy as np

import matplotlib.pyplot as plt

import mindspore as ms

from mindspore import nn, ops

ms.set_context(device_target="CPU")

with open('wine.data') as csv_file:

data = list(csv.reader(csv_file, delimiter=','))

print(data[56:62]+data[130:133])设置自变量X和因变量Y

X = np.array([[float(x) for x in s[1:]] for s in data[:178]], np.float32)

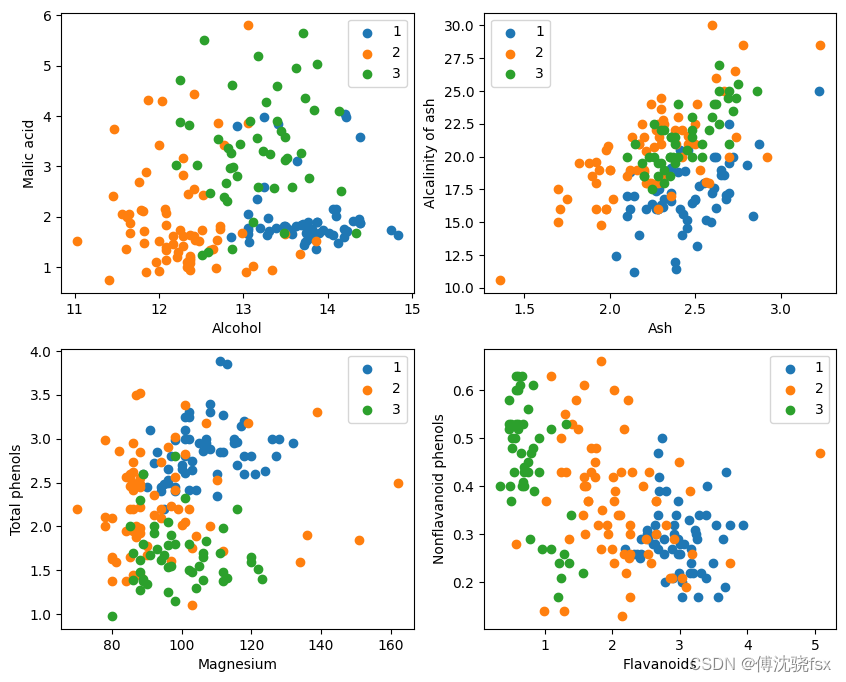

Y = np.array([s[0] for s in data[:178]], np.int32)进行数据二维可视化

attrs = ['Alcohol', 'Malic acid', 'Ash', 'Alcalinity of ash', 'Magnesium', 'Total phenols',

'Flavanoids', 'Nonflavanoid phenols', 'Proanthocyanins', 'Color intensity', 'Hue',

'OD280/OD315 of diluted wines', 'Proline']

plt.figure(figsize=(10, 8))

for i in range(0, 4):

plt.subplot(2, 2, i+1)

a1, a2 = 2 * i, 2 * i + 1

plt.scatter(X[:59, a1], X[:59, a2], label='1')

plt.scatter(X[59:130, a1], X[59:130, a2], label='2')

plt.scatter(X[130:, a1], X[130:, a2], label='3')

plt.xlabel(attrs[a1])

plt.ylabel(attrs[a2])

plt.legend()

plt.show()

将数据集划分为训练集和验证集

train_idx = np.random.choice(178, 128, replace=False)

test_idx = np.array(list(set(range(178)) - set(train_idx)))

X_train, Y_train = X[train_idx], Y[train_idx]

X_test, Y_test = X[test_idx], Y[test_idx]模型构建——计算距离

class KnnNet(nn.Cell):

def __init__(self, k):

super(KnnNet, self).__init__()

self.k = k

def construct(self, x, X_train):

#平铺输入x以匹配X_train中的样本数

x_tile = ops.tile(x, (128, 1))

square_diff = ops.square(x_tile - X_train)

square_dist = ops.sum(square_diff, 1)

dist = ops.sqrt(square_dist)

#-dist表示值越大,样本就越接近

values, indices = ops.topk(-dist, self.k)

return indices

def knn(knn_net, x, X_train, Y_train):

x, X_train = ms.Tensor(x), ms.Tensor(X_train)

indices = knn_net(x, X_train)

topk_cls = [0]*len(indices.asnumpy())

for idx in indices.asnumpy():

topk_cls[Y_train[idx]] += 1

cls = np.argmax(topk_cls)

return cls模型预测

acc = 0

knn_net = KnnNet(5)

for x, y in zip(X_test, Y_test):

pred = knn(knn_net, x, X_train, Y_train)

acc += (pred == y)

print('label: %d, prediction: %s' % (y, pred))

print('Validation accuracy is %f' % (acc/len(Y_test)))总结

KNN作为一种较为简单的网络模型,适用于多特征值对象分类问题,其中k值的选取往往能成为模型是否有效的重点。

893

893

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?