💡💡💡本文摘要:基于YOLOv9的智慧渔业捕捞检测,阐述了整个数据制作和训练可视化过程

博主简介

AI小怪兽,YOLO骨灰级玩家,1)YOLOv5、v7、v8、v9优化创新,轻松涨点和模型轻量化;2)目标检测、语义分割、OCR、分类等技术孵化,赋能智能制造,工业项目落地经验丰富;

原创自研系列, 2024年计算机视觉顶会创新点

23年最火系列,内涵80+优化改进篇,涨点小能手,助力科研,好评率极高

应用系列篇:

(一)项目背景

根据捕捞水域的不同,我国水产捕捞可划分为海洋捕捞、远洋捕捞以及淡水捕捞三大类型。其中,淡水渔业主要是指在淡水水域进行捕捞、养殖以获得淡水水产品并对这些水产品进行加工的社会生产领域。

近年来,随着人们经济水平的提升和淡水渔业的快速发展,捕捞业也不断壮大。渔业发展至今,已经从单纯的捕捞形成了系统性地养殖及捕捞作业管理,但简单粗放的传统渔业捕捞往往存在着种种弊端,已经难以满足市场的需求,渔业已开始趋向精细化,智慧渔业应运而生。智慧渔业解决方案可以结合现代互联网、移动互联网、物联网等新兴技术,帮助渔民及企业有效控制捕捞成本,通过多方数据分析对比进而提高水产的品质和产量。

1.YOLOv9原理介绍

论文: 2402.13616.pdf (arxiv.org)

代码:GitHub - WongKinYiu/yolov9: Implementation of paper - YOLOv9: Learning What You Want to Learn Using Programmable Gradient Information摘要: 如今的深度学习方法重点关注如何设计最合适的目标函数,从而使得模型的预测结果能够最接近真实情况。同时,必须设计一个适当的架构,可以帮助获取足够的信息进行预测。然而,现有方法忽略了一个事实,即当输入数据经过逐层特征提取和空间变换时,大量信息将会丢失。因此,YOLOv9 深入研究了数据通过深度网络传输时数据丢失的重要问题,即信息瓶颈和可逆函数。作者提出了可编程梯度信息(programmable gradient information,PGI)的概念,来应对深度网络实现多个目标所需要的各种变化。PGI 可以为目标任务计算目标函数提供完整的输入信息,从而获得可靠的梯度信息来更新网络权值。此外,研究者基于梯度路径规划设计了一种新的轻量级网络架构,即通用高效层聚合网络(Generalized Efficient Layer Aggregation Network,GELAN)。该架构证实了 PGI 可以在轻量级模型上取得优异的结果。研究者在基于 MS COCO 数据集的目标检测任务上验证所提出的 GELAN 和 PGI。结果表明,与其他 SOTA 方法相比,GELAN 仅使用传统卷积算子即可实现更好的参数利用率。对于 PGI 而言,它的适用性很强,可用于从轻型到大型的各种模型。我们可以用它来获取完整的信息,从而使从头开始训练的模型能够比使用大型数据集预训练的 SOTA 模型获得更好的结果。对比结果如图1所示。

1.1 YOLOv9框架介绍

YOLOv9各个模型介绍

models/detect/yolov9.yaml

ELAN models.common.RepNCSPELAN4:

从模块名字不难看出核心是Re-parameter + CSPNet + ELAN。

ELAN-SPP models.common.SPPELAN:

该模块与早前yolo版本中的SPPF结构基本一致,如下图。

ADown models.common.ADown:

该模块在yolov9-c.yaml与yolov9-e.yaml结构中出现,替代了模型中部分CBS模块。

来自:YOLOv9结构详解 - 知乎 (zhihu.com)

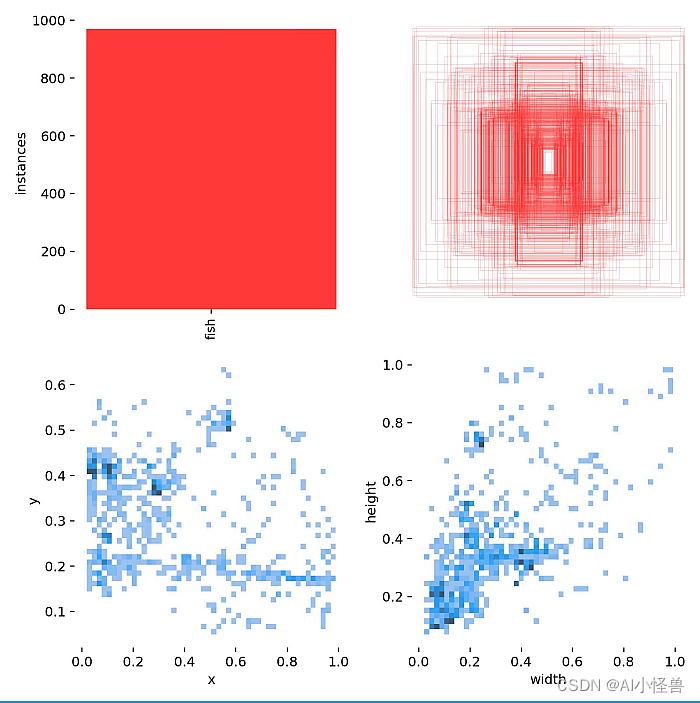

2.智慧渔业捕捞数据集介绍

智慧渔业捕捞一共355张,类别为:'fish'

2.1数据集划分

通过split_train_val.py得到trainval.txt、val.txt、test.txt

# coding:utf-8

import os

import random

import argparse

parser = argparse.ArgumentParser()

#xml文件的地址,根据自己的数据进行修改 xml一般存放在Annotations下

parser.add_argument('--xml_path', default='Annotations', type=str, help='input xml label path')

#数据集的划分,地址选择自己数据下的ImageSets/Main

parser.add_argument('--txt_path', default='ImageSets/Main', type=str, help='output txt label path')

opt = parser.parse_args()

trainval_percent = 0.9

train_percent = 0.8

xmlfilepath = opt.xml_path

txtsavepath = opt.txt_path

total_xml = os.listdir(xmlfilepath)

if not os.path.exists(txtsavepath):

os.makedirs(txtsavepath)

num = len(total_xml)

list_index = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list_index, tv)

train = random.sample(trainval, tr)

file_trainval = open(txtsavepath + '/trainval.txt', 'w')

file_test = open(txtsavepath + '/test.txt', 'w')

file_train = open(txtsavepath + '/train.txt', 'w')

file_val = open(txtsavepath + '/val.txt', 'w')

for i in list_index:

name = total_xml[i][:-4] + '\n'

if i in trainval:

file_trainval.write(name)

if i in train:

file_train.write(name)

else:

file_val.write(name)

else:

file_test.write(name)

file_trainval.close()

file_train.close()

file_val.close()

file_test.close()2.2 通过voc_label.py生成txt

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

import os

from os import getcwd

sets = ['train', 'val']

classes = ["fish"] # 改成自己的类别

abs_path = os.getcwd()

print(abs_path)

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

in_file = open('Annotations/%s.xml' % (image_id), encoding='UTF-8')

out_file = open('labels/%s.txt' % (image_id), 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

#difficult = obj.find('Difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('labels/'):

os.makedirs('labels/')

image_ids = open('ImageSets/Main/%s.txt' % (image_set)).read().strip().split()

list_file = open('%s.txt' % (image_set), 'w')

for image_id in image_ids:

list_file.write(abs_path + '/images/%s.png\n' % (image_id))

convert_annotation(image_id)

list_file.close()3.YOLOv9训练自己的数据集

3.1 修改fish.yaml

path推荐使用全路径

path: D:/YOLOv9/data/FishDataset # dataset root dir

train: train.txt # train images (relative to 'path') 118287 images

val: val.txt # val images (relative to 'path') 5000 images

# number of classes

nc: 1

# class names

names:

0: fish3.2 修改train_dual.py

def parse_opt(known=False):

parser = argparse.ArgumentParser()

# parser.add_argument('--weights', type=str, default=ROOT / 'yolo.pt', help='initial weights path')

# parser.add_argument('--cfg', type=str, default='', help='model.yaml path')

parser.add_argument('--weights', type=str, default='weights/yolov9-c.pt', help='initial weights path')

parser.add_argument('--cfg', type=str, default='models/detect/yolov9-c.yaml', help='model.yaml path')

parser.add_argument('--data', type=str, default=ROOT / 'data/fish.yaml', help='dataset.yaml path')

parser.add_argument('--hyp', type=str, default=ROOT / 'data/hyps/hyp.scratch-high.yaml', help='hyperparameters path')

parser.add_argument('--epochs', type=int, default=100, help='total training epochs')

parser.add_argument('--batch-size', type=int, default=8, help='total batch size for all GPUs, -1 for autobatch')

parser.add_argument('--imgsz', '--img', '--img-size', type=int, default=640, help='train, val image size (pixels)')3.3 开启训练

python train_dual.py3.4 训练可视化

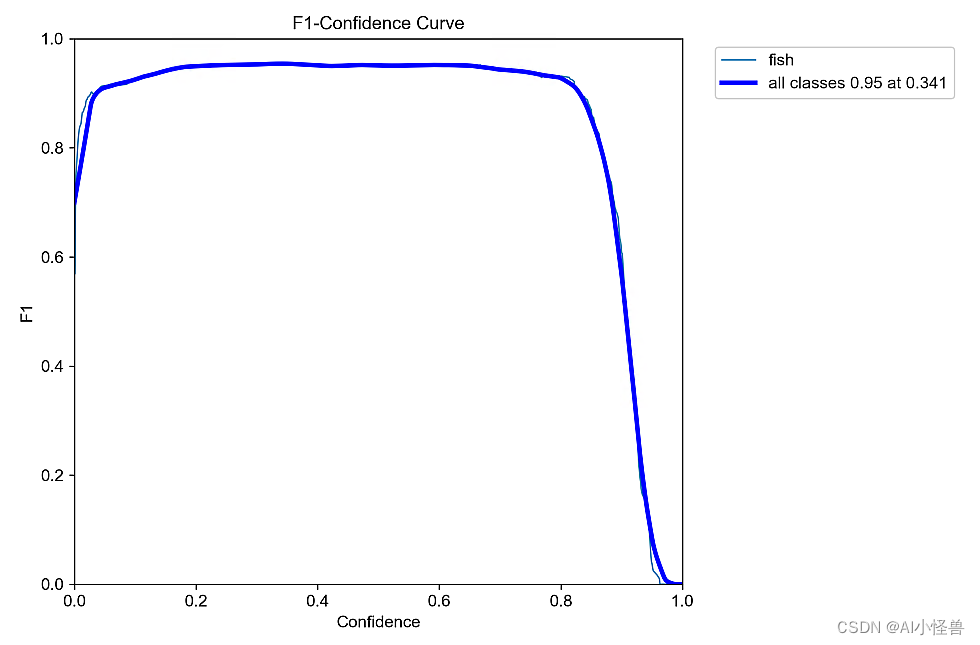

F1_curve.png:F1分数与置信度(x轴)之间的关系。F1分数是分类的一个衡量标准,是精确率和召回率的调和平均函数,介于0,1之间。越大越好。

TP:真实为真,预测为真;

FN:真实为真,预测为假;

FP:真实为假,预测为真;

TN:真实为假,预测为假;

精确率(precision)=TP/(TP+FP)

召回率(Recall)=TP/(TP+FN)

F1=2*(精确率*召回率)/(精确率+召回率)

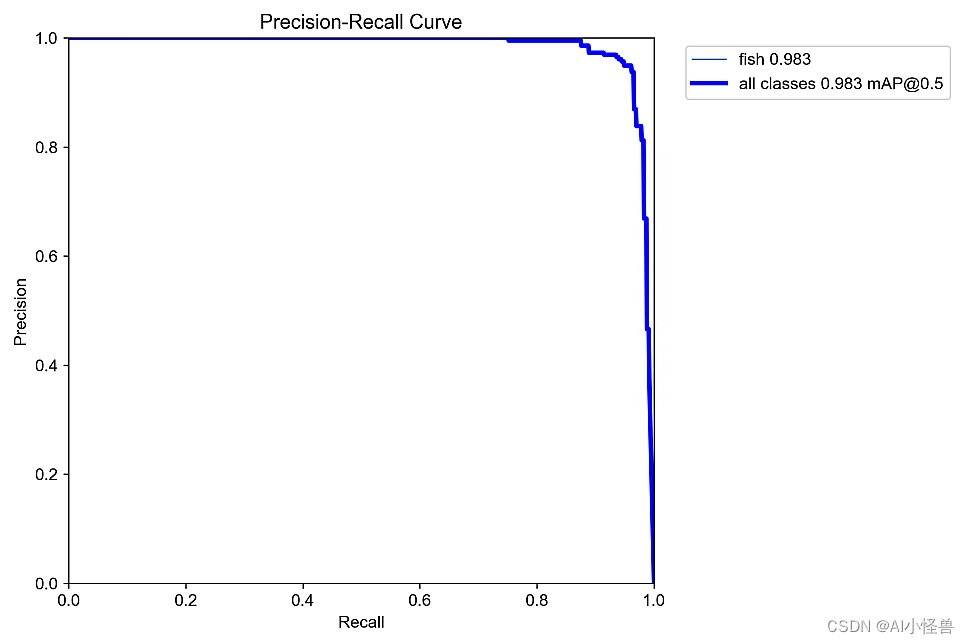

PR_curve.png :PR曲线中的P代表的是precision(精准率),R代表的是recall(召回率),其代表的是精准率与召回率的关系。

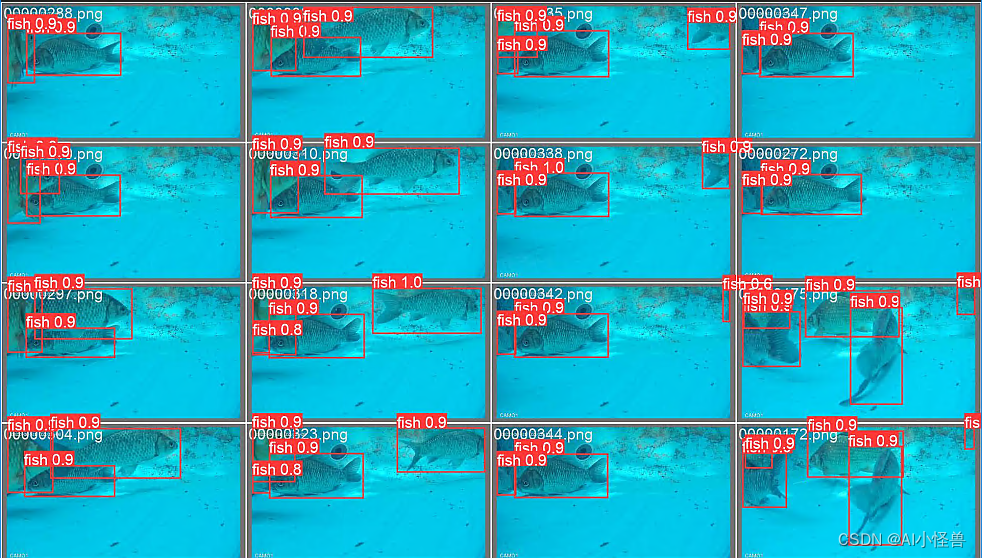

预测结果:

关注下方名片点击关注,即可源码获取途径。

本文介绍了基于YOLOv9的智慧渔业捕捞检测技术,详细阐述了数据集的制作、划分以及训练过程的可视化,包括YOLOv9原理、数据集介绍、模型配置和训练策略,展示了如何利用深度学习技术提升捕捞效率和精准度。

本文介绍了基于YOLOv9的智慧渔业捕捞检测技术,详细阐述了数据集的制作、划分以及训练过程的可视化,包括YOLOv9原理、数据集介绍、模型配置和训练策略,展示了如何利用深度学习技术提升捕捞效率和精准度。

3206

3206

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?