一、提出任务

(1)启动集群的HDFS与Spark

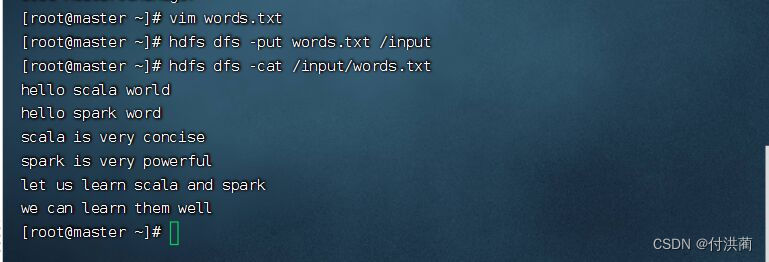

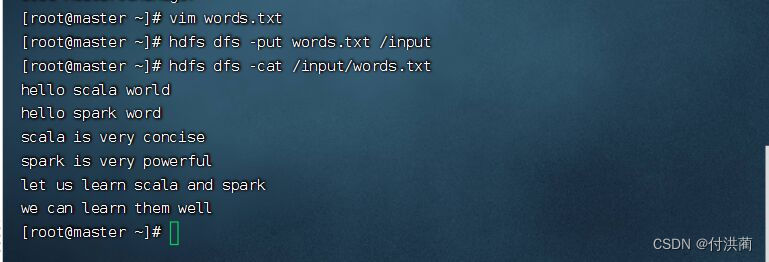

(2)创建文件

- 创建文件words.txt,在传到hdfs的input下

二、完成任务

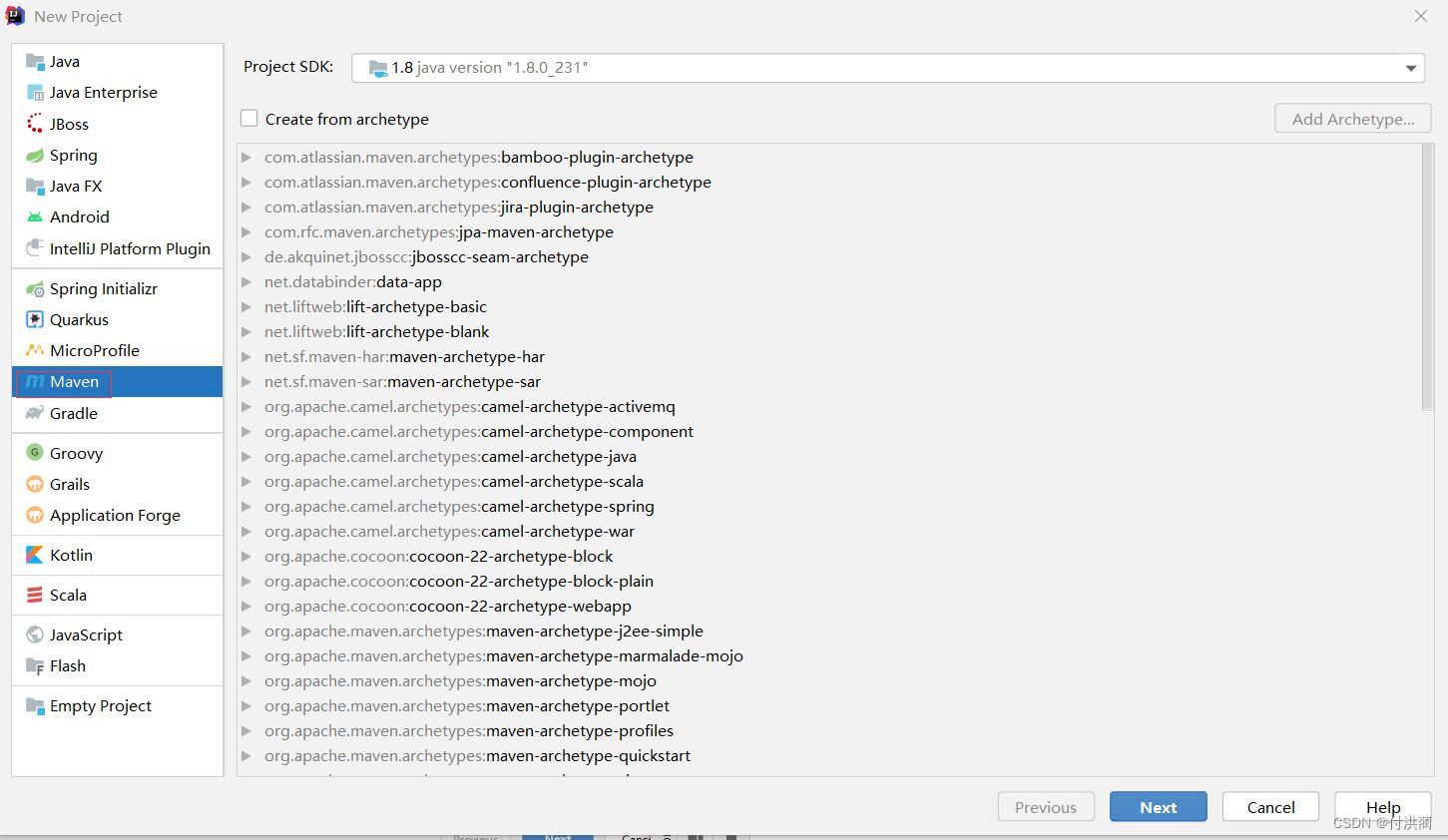

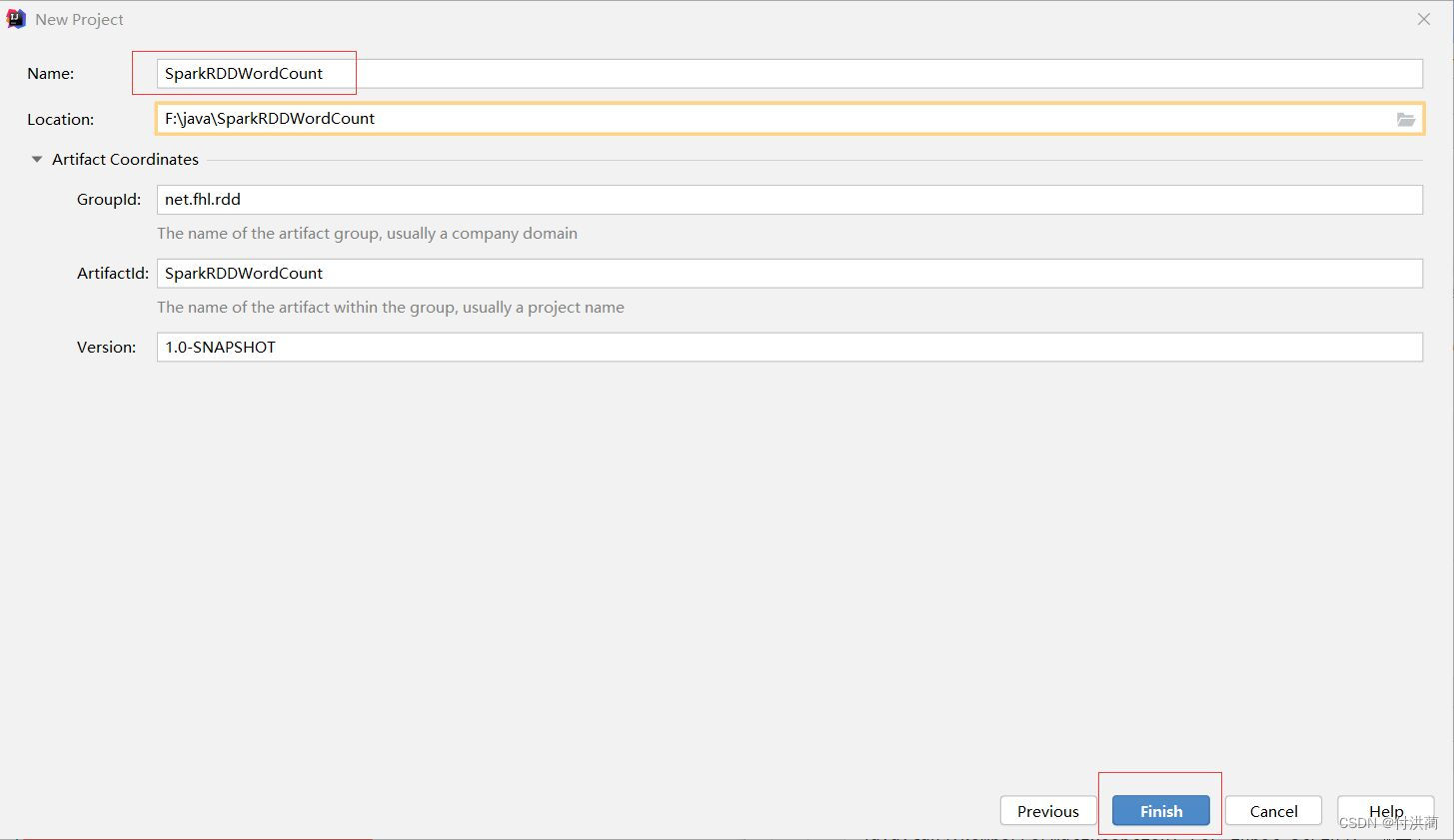

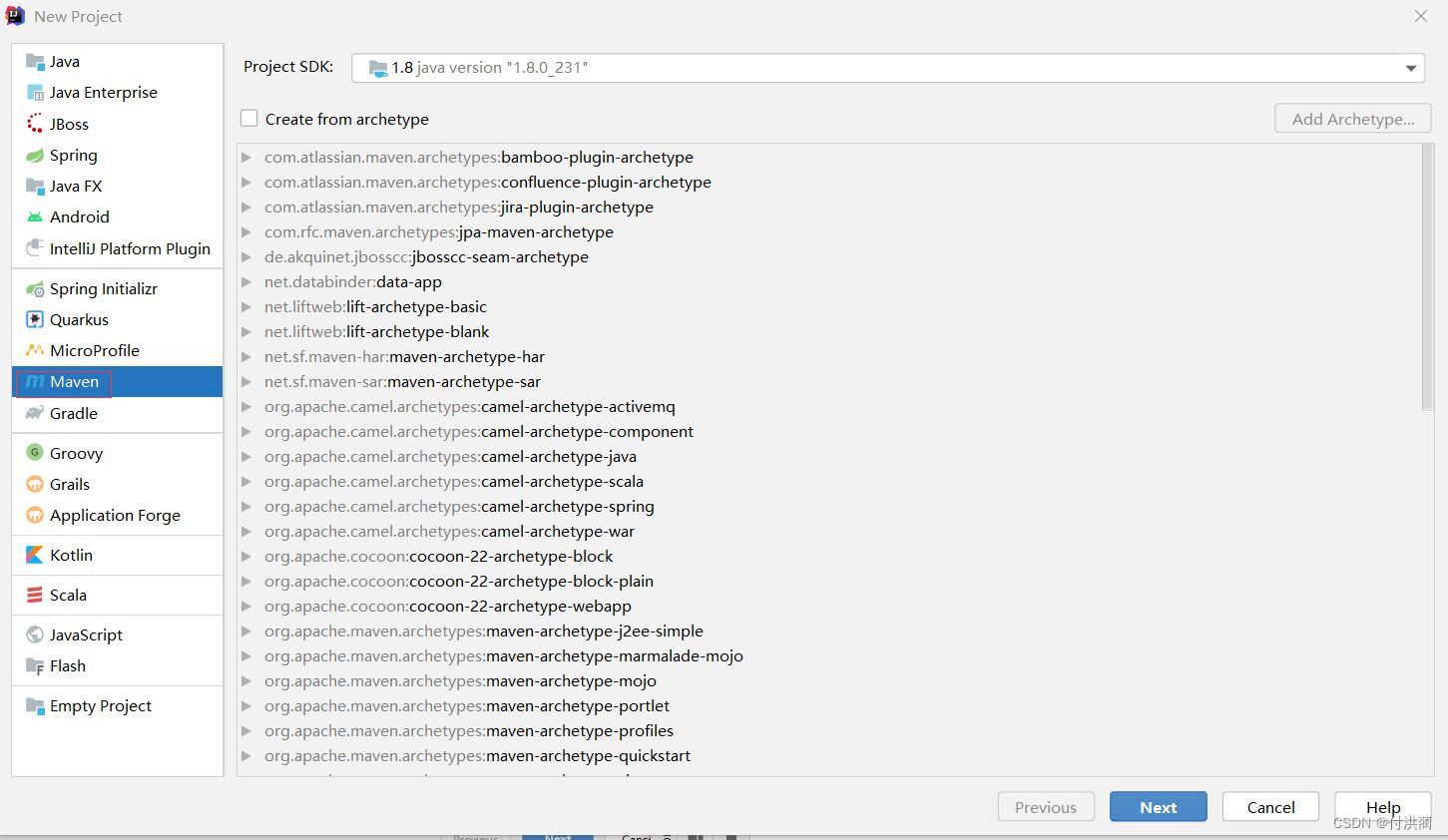

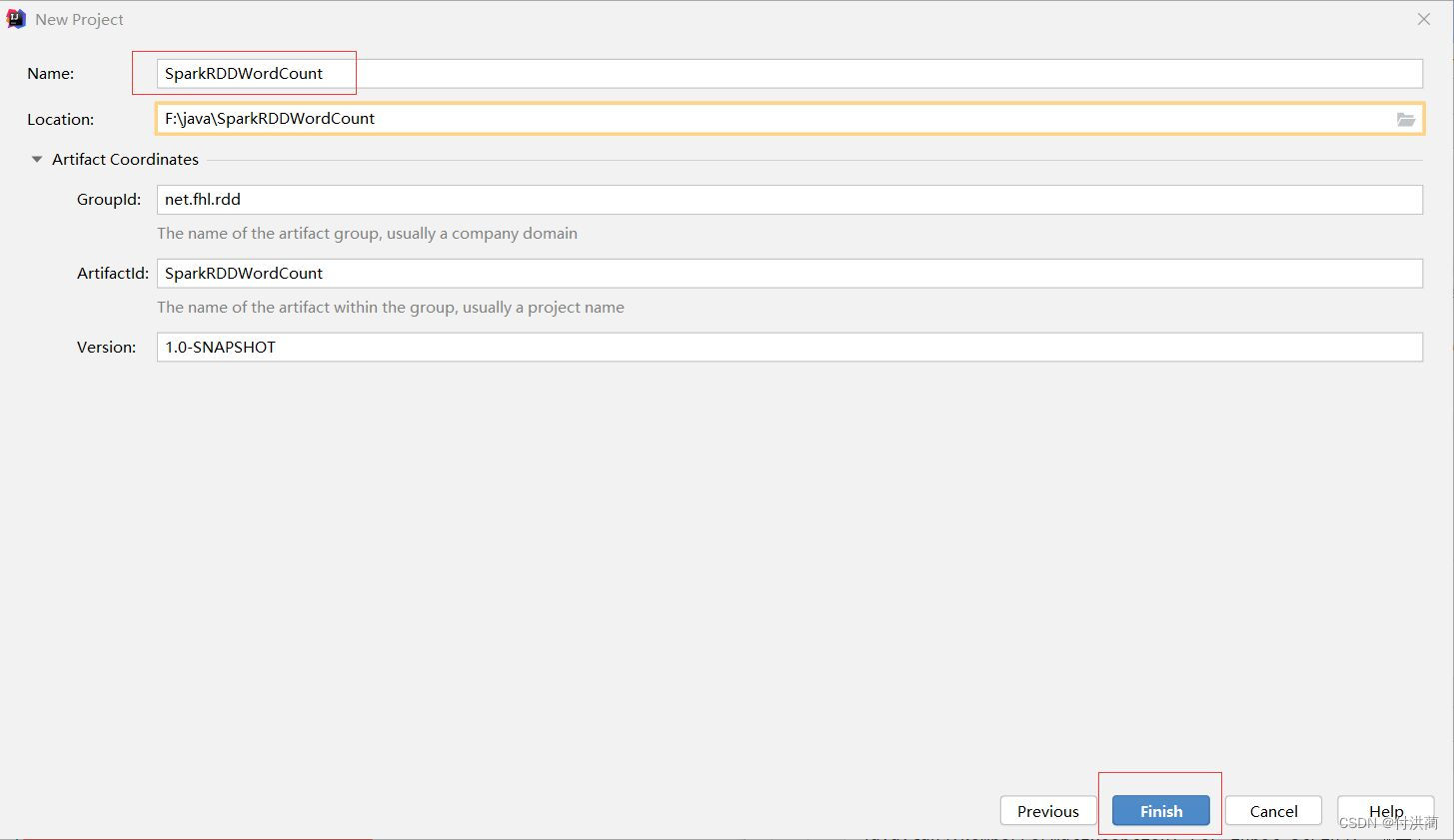

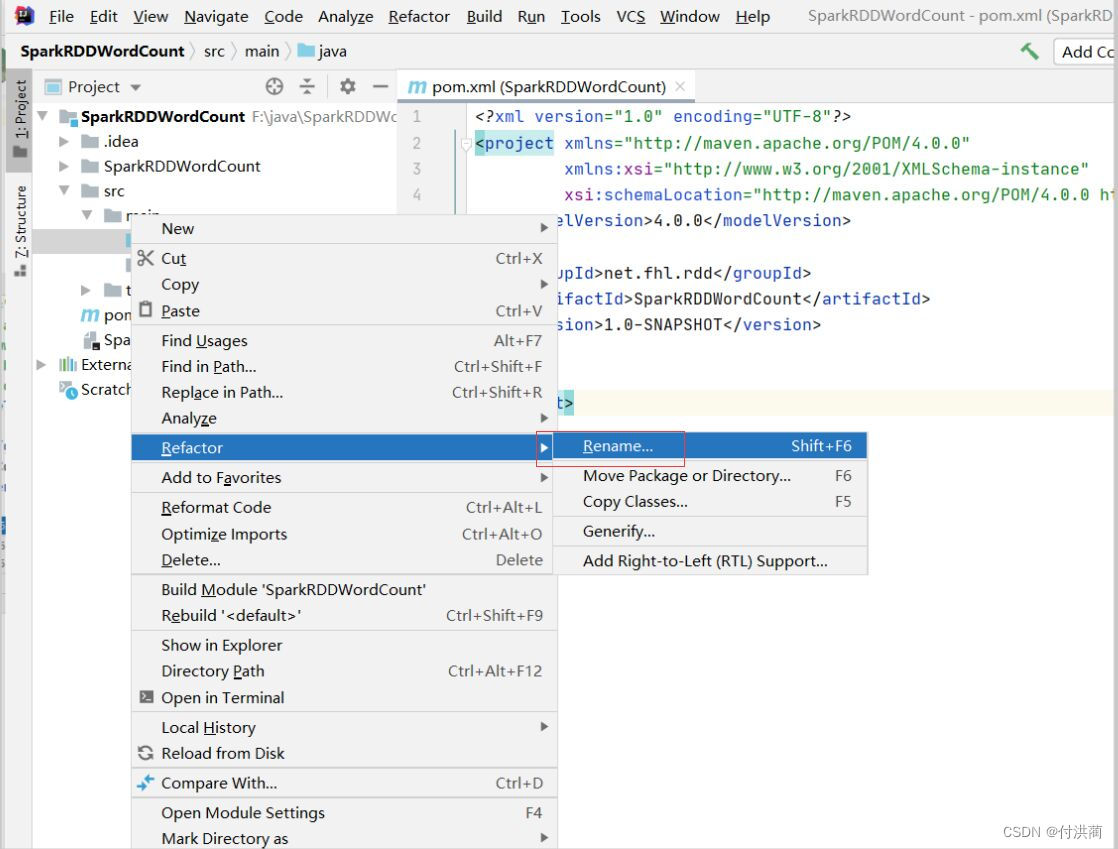

(一)新建Maven项目

- 新建Maven项目,选择JDK1.8、点击next

- 设置项目信息(项目名称、保存位置、组编号以及项目编号)

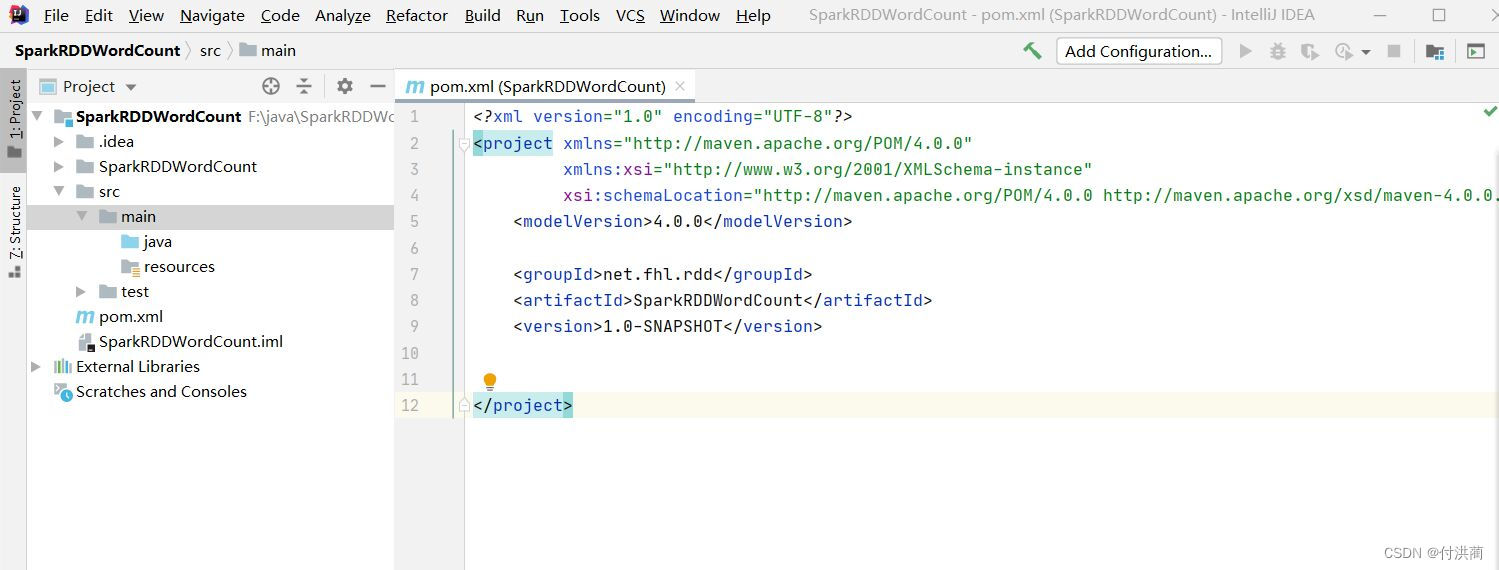

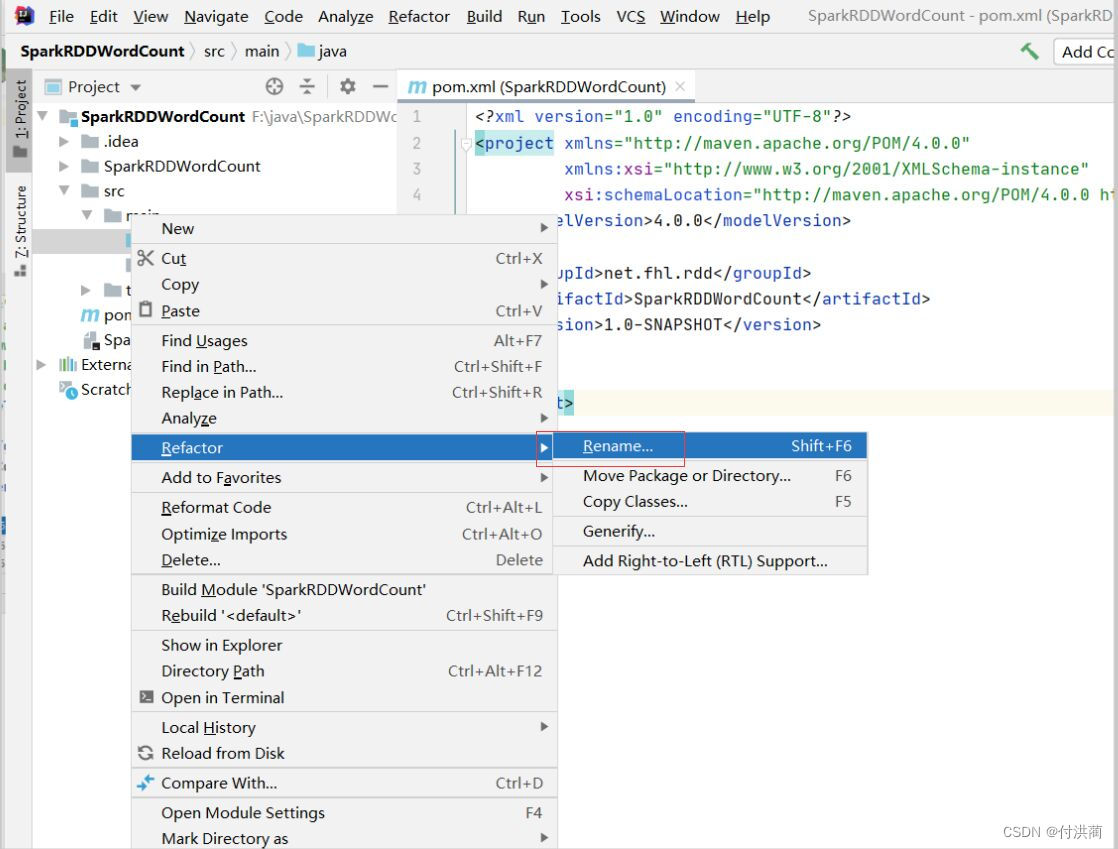

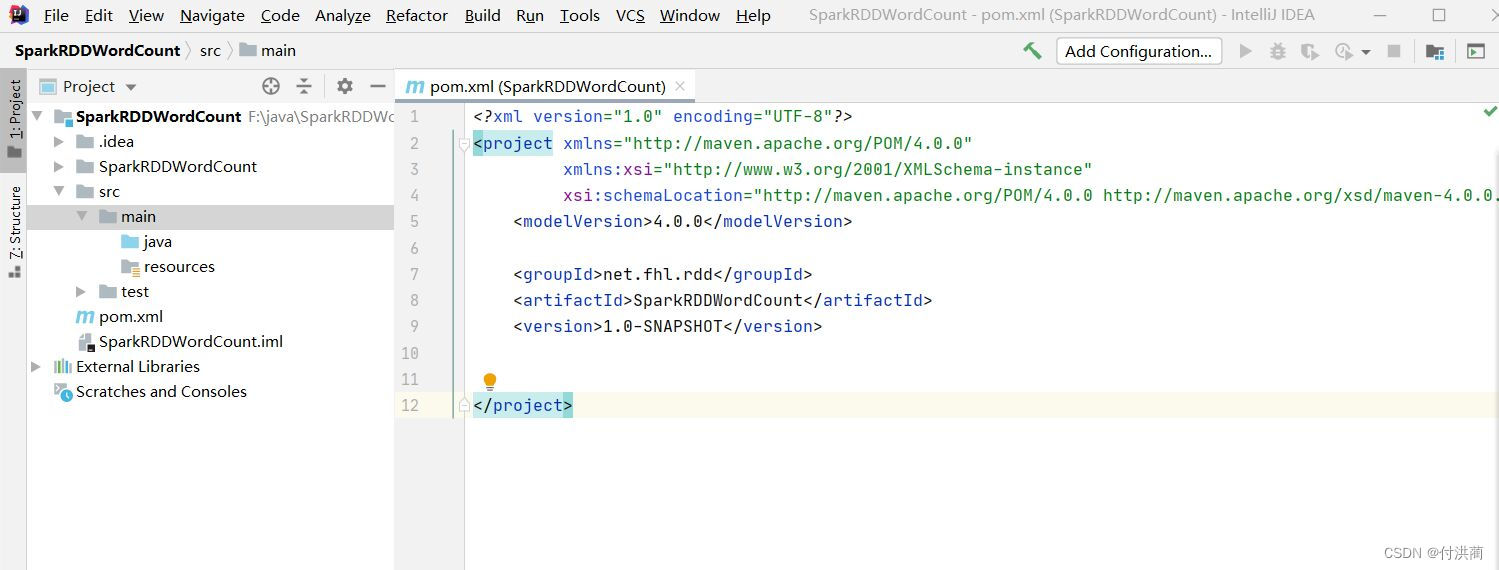

(二)添加相关依赖和构建插件

- 在pom.xml文件里添加依赖与Maven构建插件

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>net.fhl.rdd</groupId>

<artifactId>SparkRDDWordCount</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>2.12.15</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>2.4.4</version>

</dependency>

</dependencies>

<build>

<sourceDirectory>src/main/scala<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

936

936

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?