一、书生·浦语大模型全链路开源体系

视频来源:https://www.bilibili.com/video/BV1Vx421X72D/

1、技术背景

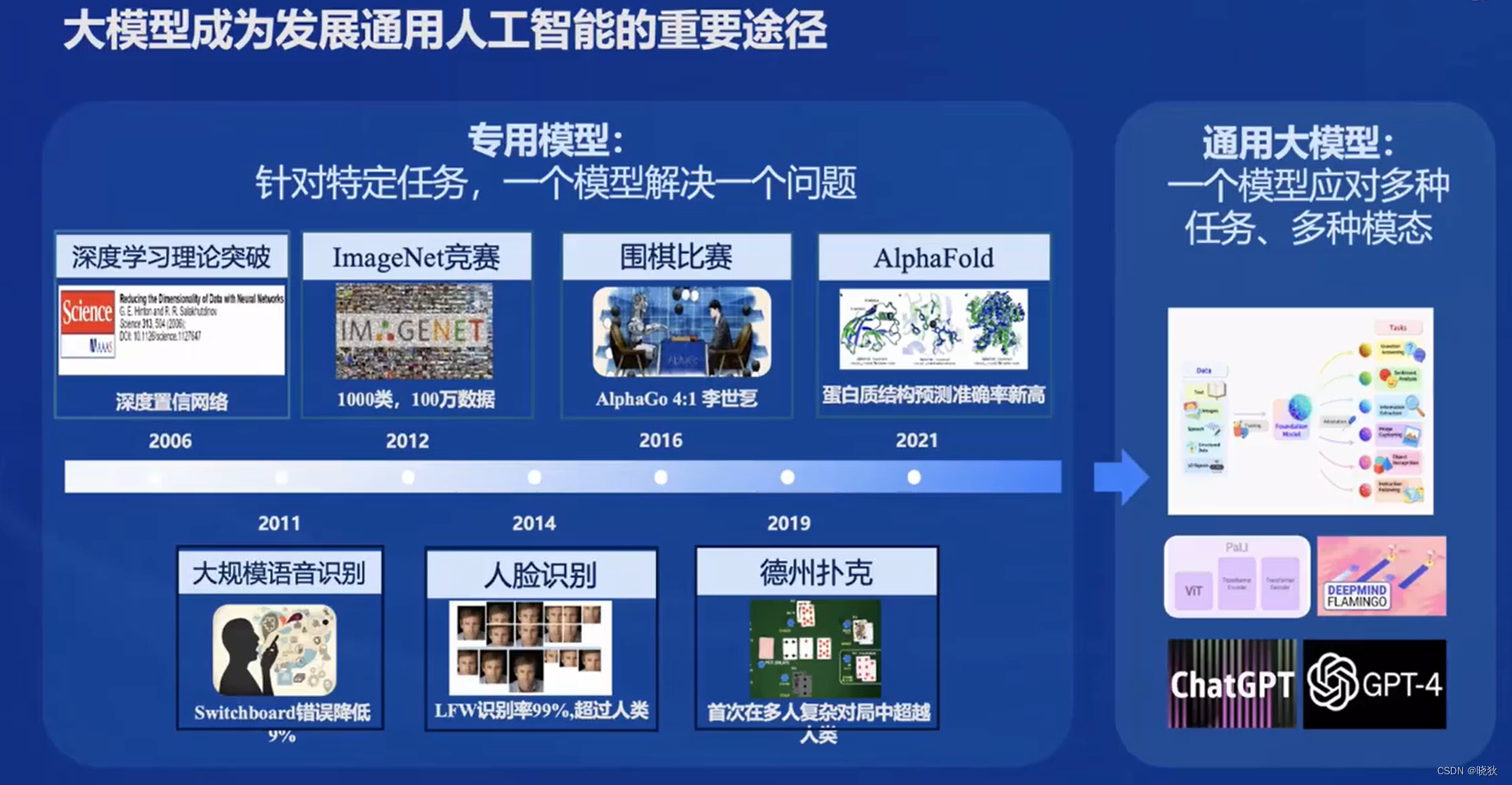

现如今,大模型已经成为了发展通用人工智能的重要途径,与其他专有模型相比通用大模型有更广阔的应用场景,成为了最近的主要发展方向。

2、发展历程

2、发展历程

3、InternLM2的体系

为了服务多样性的需求,InternLM2提供了多种模型版本来方便后续的开发。

4、InternLM2的主要亮点

InternLM2大模型在各项能力维度上都有着明显的进步,尤其是在推理、数学、代码等方面有着显著的提升,其综合性能已在同量级的开源中处于领先地位。

其中的InternLM2-Chat-20B在重点能力的评测上甚至与GPT-3.5的水平相当。

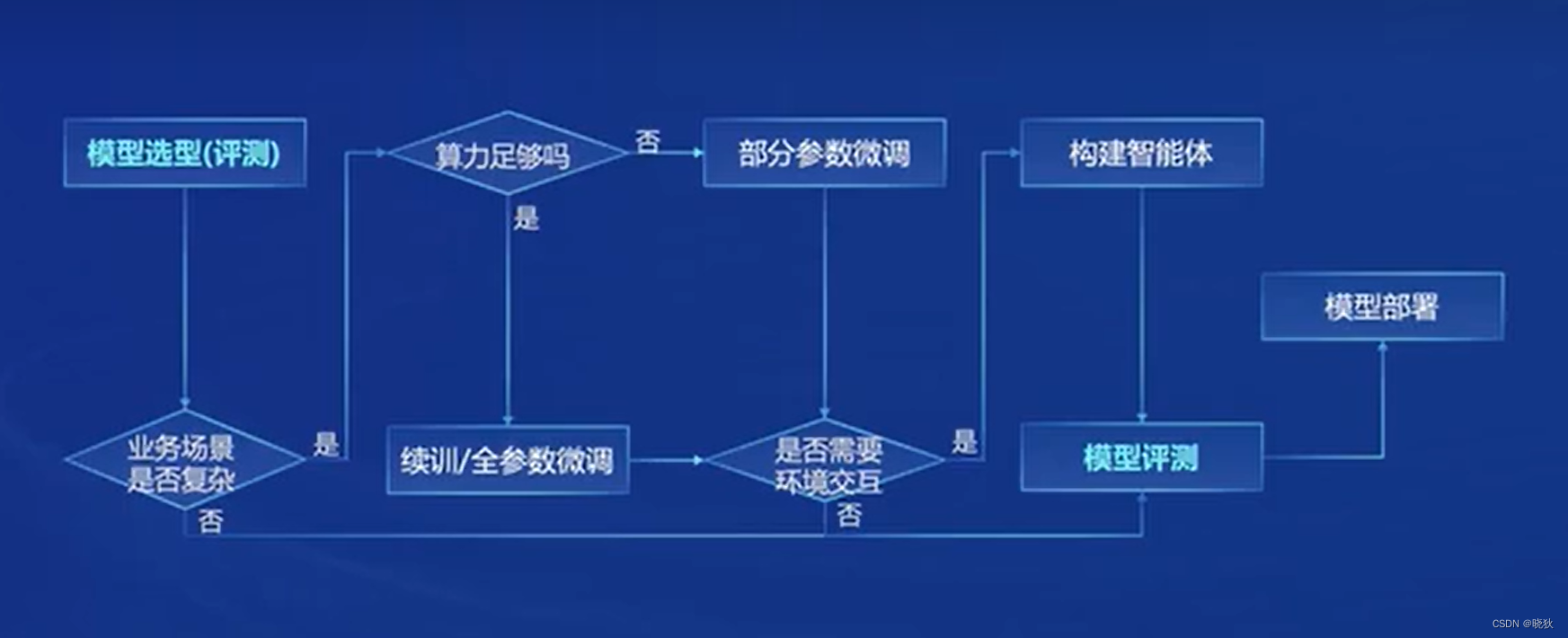

5、模型到应用的典型流程

6、全链路开源开放体系

(1)、工具体系

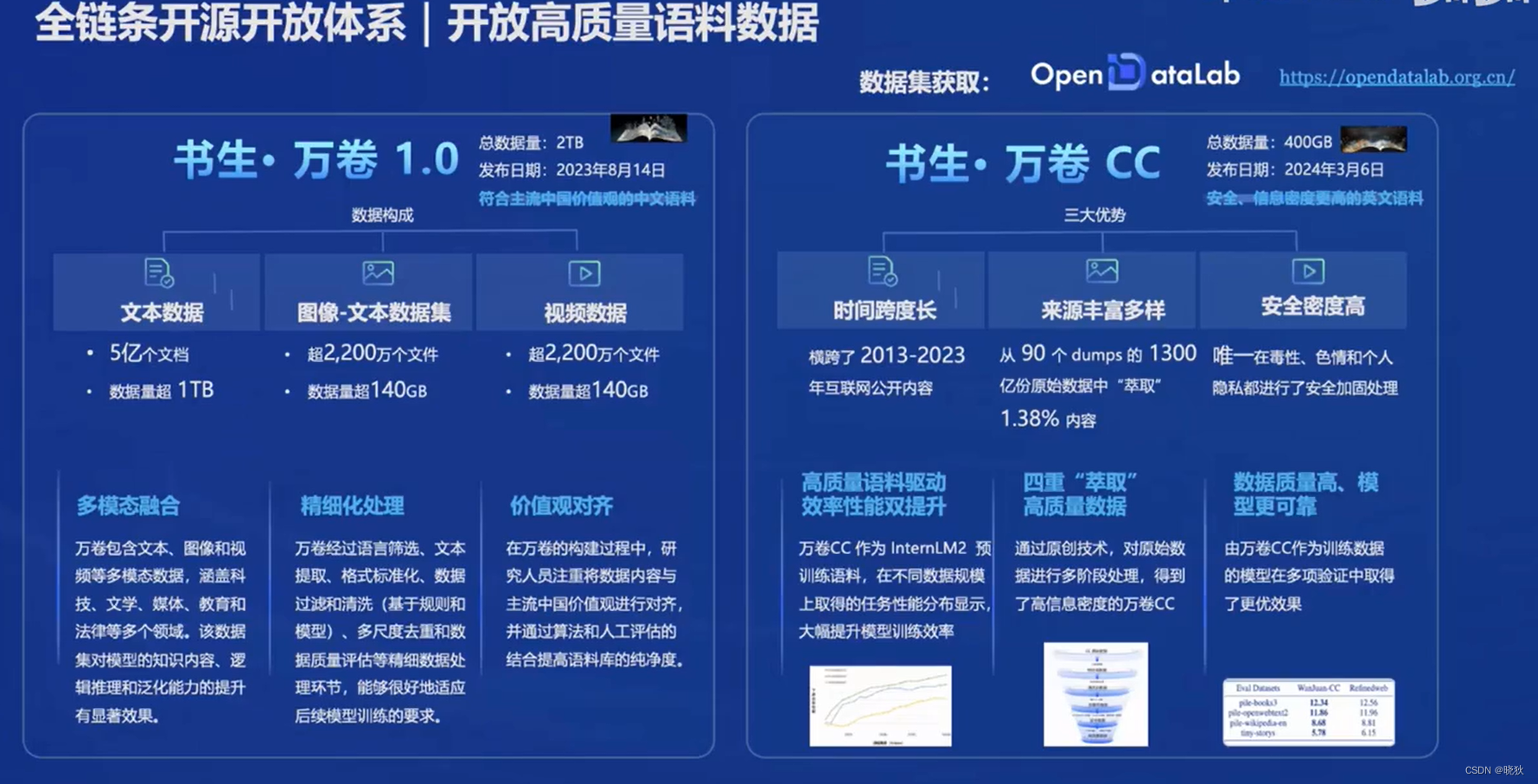

(2)、高质量数据

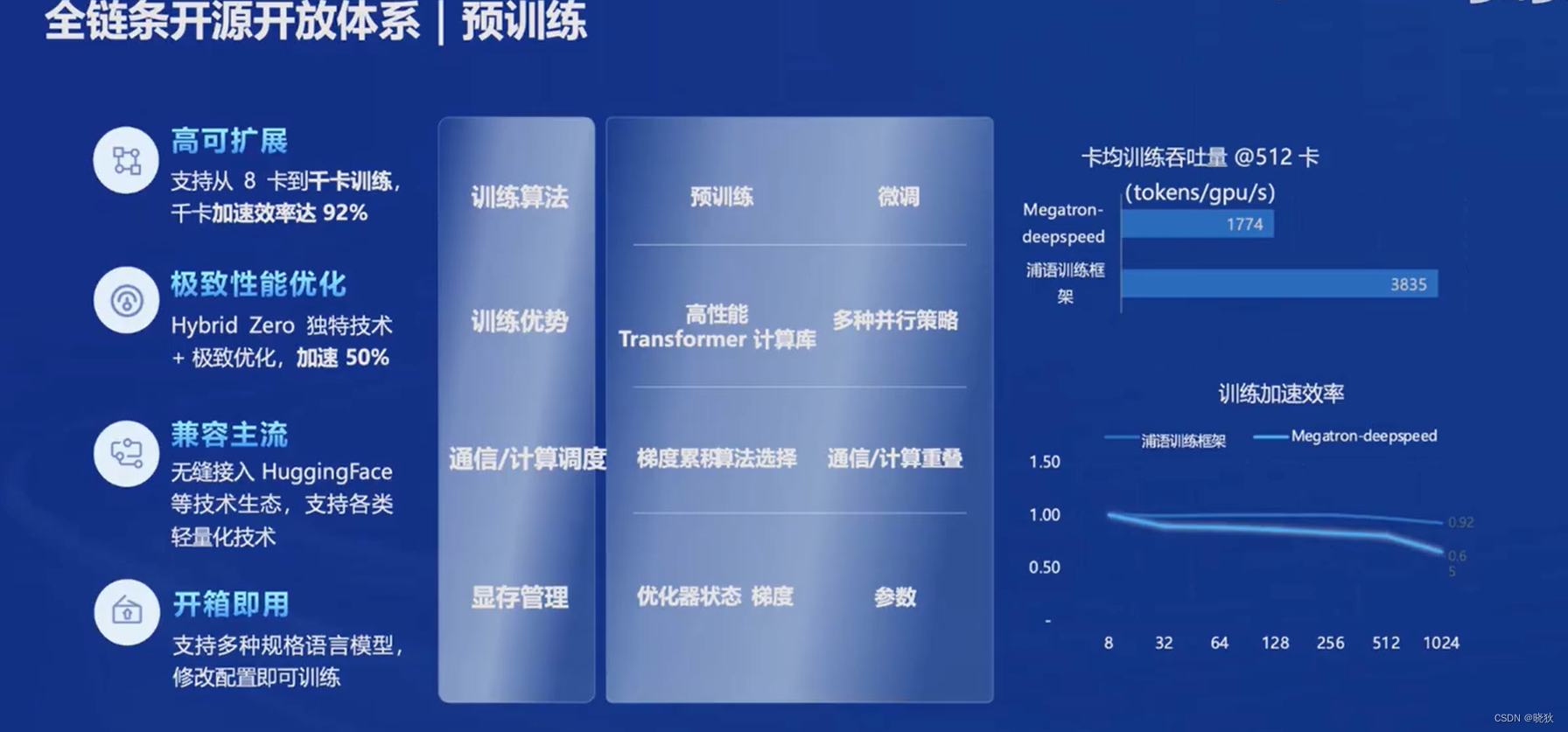

(3)、预训练框架

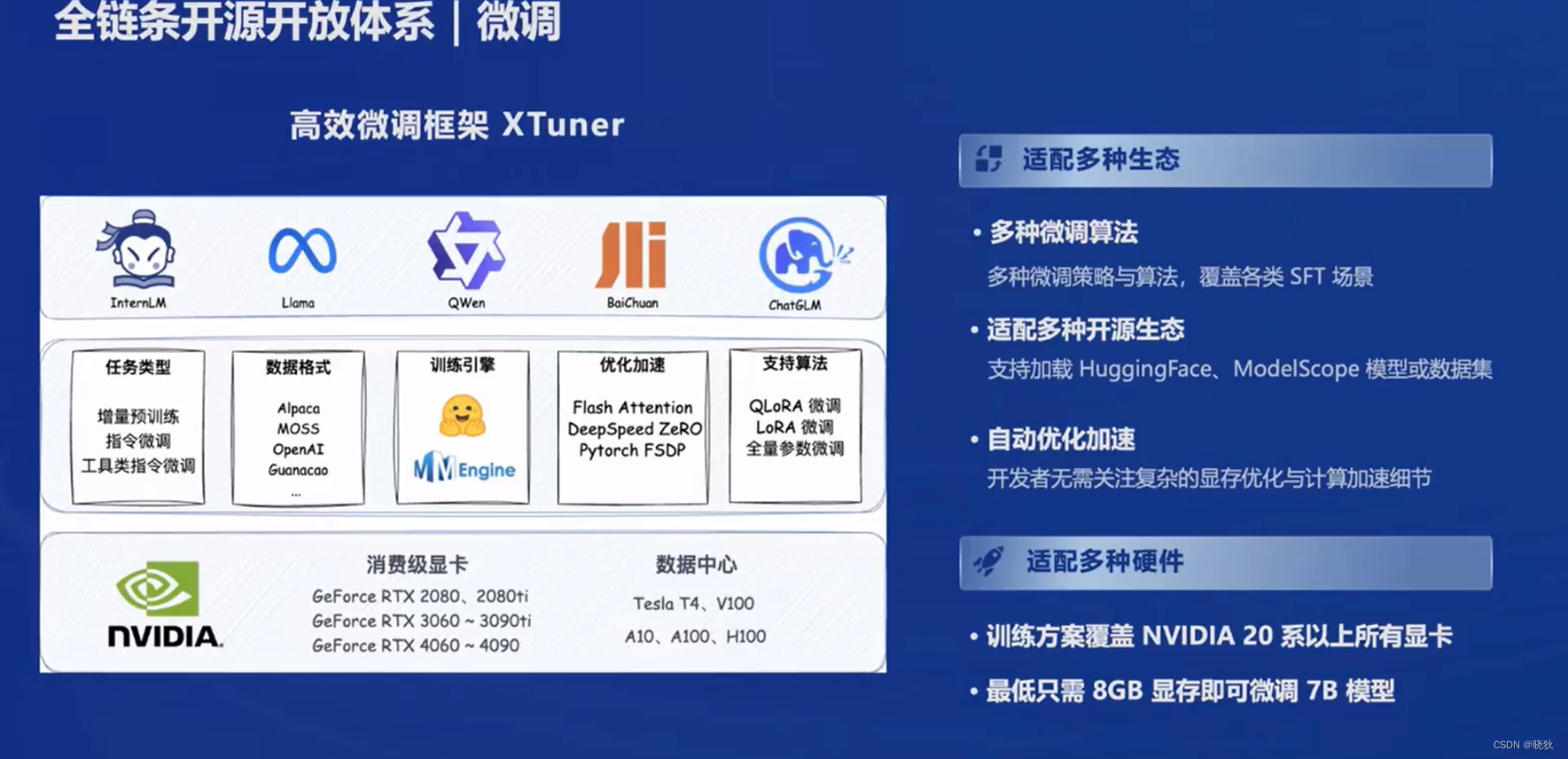

(4)、微调框架

(5)、评测体系

多样化的评测体系向使用者提供了更加全面更加客观的认识。

二、InternLM2技术报告

来源:https://arxiv.org/pdf/2403.17297.pdf

结论,本篇报告展示了开源大语言模型InternLM2,以及它在6个维度和30个基准的全面评估中的出色表现。InternLM2 的预训练过程非常详细,突出了各种数据类型的准备,包括文本、代码和长上下文数据。InternLM2在200k“大海捞针”测试中表现出出色的性能。InternLM2 使用 SFT 和 COOL RLHF 策略进一步调整,解决了人类偏好对齐和奖励剥削等问题。通过发布在不同的训练阶段的InternLM2 模型,提供了对模型演变的新理解。

1023

1023

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?