《机器学习与数据挖掘》实验二

实验题目: 使用梯度下降法训练多元线性回归模型

实验目的: 掌握线性回归的基本原理,以及梯度下降法

实验环境(硬件和软件) Anaconda/Jupyter notebook/Pycharm

实验内容:

(1)编码实现基于梯度下降的多元线性回归算法,包括梯度的计算与验证;

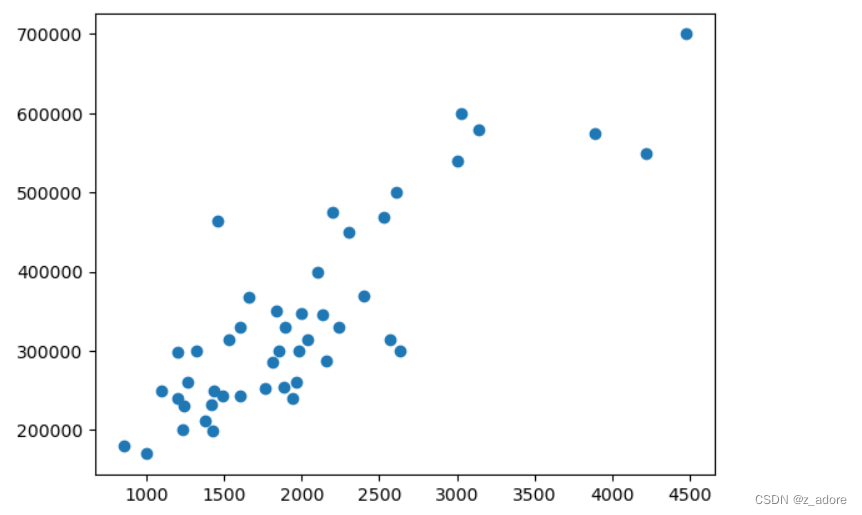

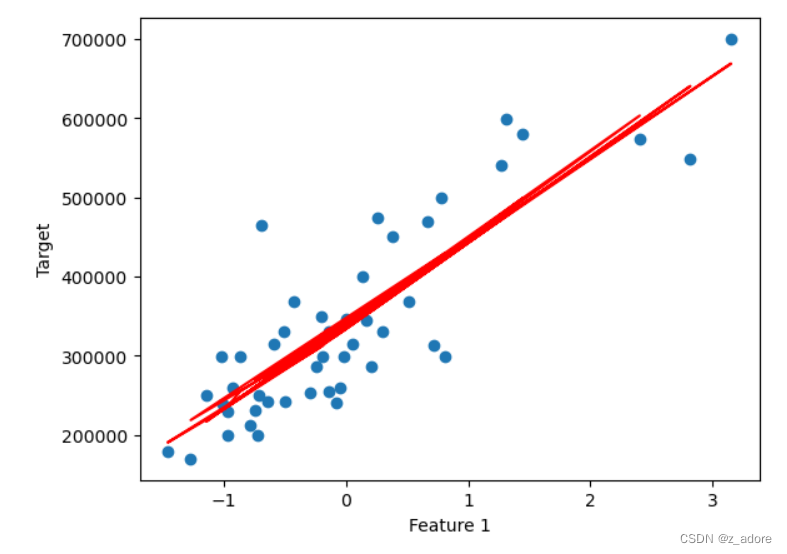

(2)画数据散点图,以及得到的直线;

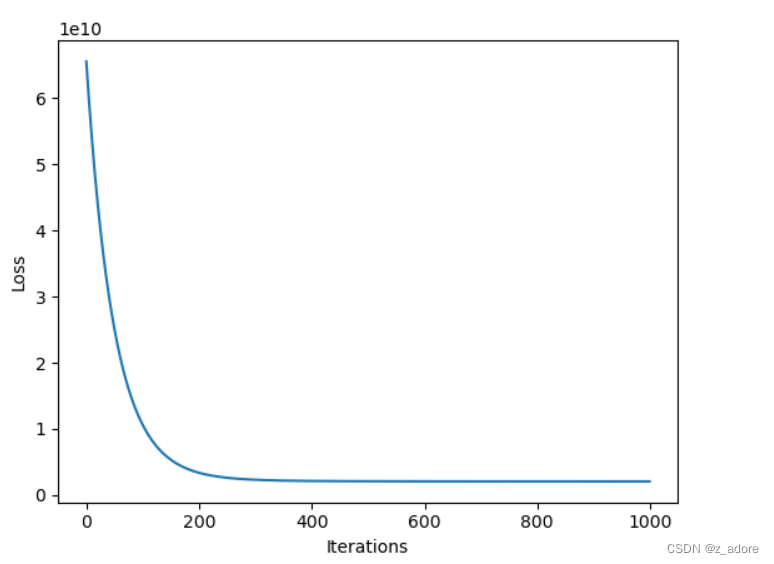

(3)画梯度下降过程中损失的变化图;

(4)基于训练得到的参数,输入新的样本数据,输出预测值;

实验步骤:

1.读取数据集,该数据集包括多个特征和一个目标变量;

2.对数据集进行预处理,包括特征标准化等操作;

3.实现基于梯度下降法的多元线性回归算法,包括梯度的计算和验证;

4.根据训练数据集和学习率、迭代次数等参数,使用梯度下降法训练模型,并记录损失函数的变化;

5.绘制数据散点图以及拟合出的直线;

6.绘制梯度下降过程中损失函数的变化图;

7.通过训练得到的参数,对新的样本数据进行预测。

![]() 实验结果:

实验结果:

实验心得:

在进行基于梯度下降的多元线性回归算法实验时,需要注意以下问题:

- 数据预处理:在使用多元线性回归模型进行拟合之前,需要对输入数据进行预处理,包括去除异常值、特征缩放(归一化)等操作。这有助于提高模型的鲁棒性和泛化能力。

- 学习率的选择:学习率是梯度下降算法中非常重要的参数,它控制了每次迭代参数更新的幅度。如果学习率太小,可能会导致收敛速度较慢;如果学习率太大,可能会导致损失函数在最小值周围震荡甚至无法收敛。通常可以通过尝试不同的学习率并观察损失函数值的变化来确定最佳的学习率。

- 迭代次数的选择:迭代次数也是一个非常重要的参数,它控制了梯度下降算法的训练轮数。如果迭代次数太少,可能无法达到最佳拟合效果;如果迭代次数太多,可能会浪费时间或者导致过拟合。通常可以通过观察损失函数值的变化来确定最佳的迭代次数。

- 梯度的计算与验证:在实现梯度下降算法时,需要对损失函数进行求导,并计算出每个参数的梯度。这个过程可以使用手工推导或者自动微分等多种方式实现,但需要保证计算结果正确有效。为了验证梯度计算的正确性,可以使用数值微分等方法进行验证。

- 结果的可视化:在实验结果展示时,需要绘制数据散点图、直线拟合图和损失函数值变化图等图表,以便于观察模型的拟合效果和训练过程。

- 避免过拟合:在训练过程中,需要注意避免过拟合问题,可以采用交叉验证、正则化等方法来解决。此外,在模型训练完成后,还需要对模型进行测试,并统计模型的评价指标,如均方根误差(RMSE)、平均绝对误差(MAE)等。

3622

3622

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?