说明:本文为本人学习本课程的笔记,课程链接为

【(强推|双字)2022吴恩达机器学习Deeplearning.ai课程】

https://www.bilibili.com/video/BV1Pa411X76sp=8&vd_source=1a7101e2cd4837c57a0824d2cc5a5e56

如需要更深层次地掌握知识,请自行学习视频课程。

第二章 逻辑回归的梯度下降法

2.1 逻辑回归的代价函数

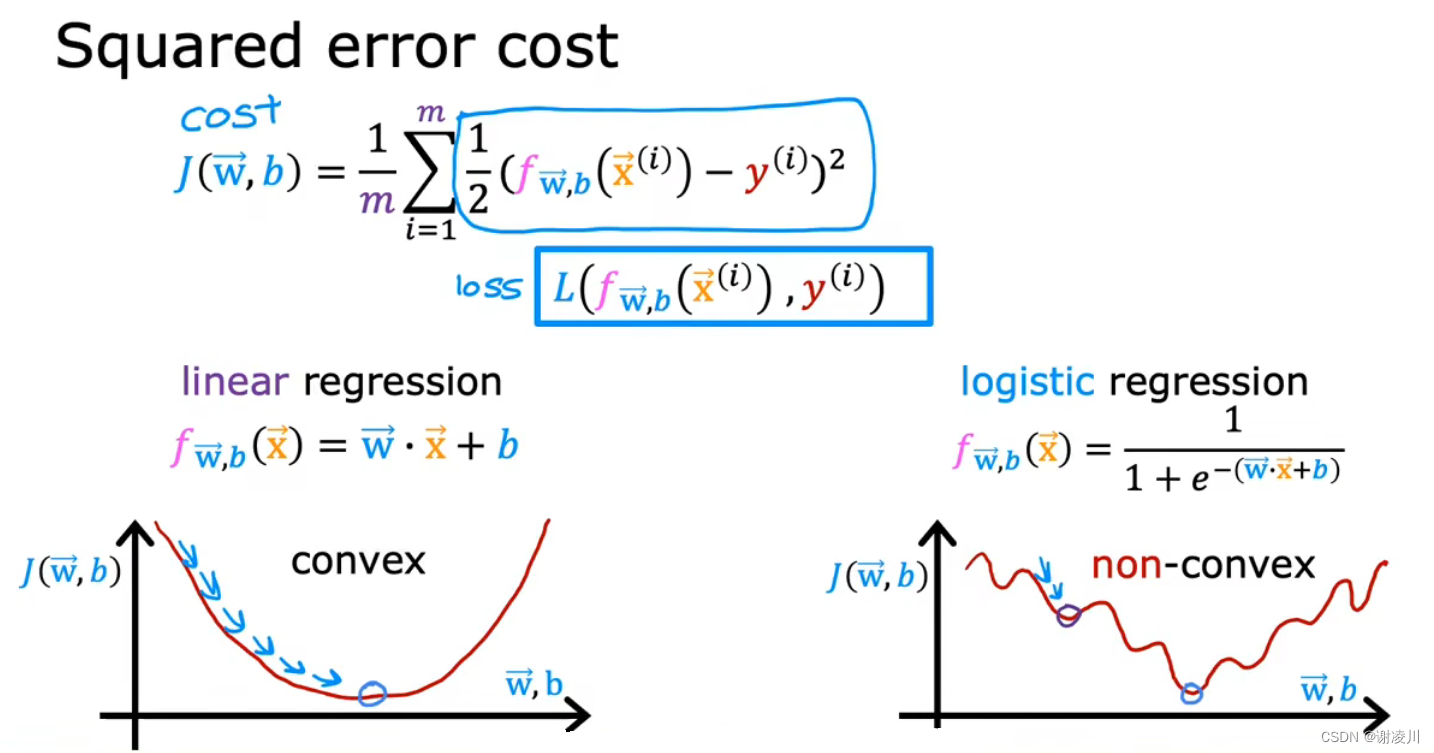

如图,线性回归的代价函数是一个二次函数,只有一个极值点。通过梯度下降法能够容易地找到极值点。

但如果按相同方法定义逻辑回归的代价函数,则该函数将具有多个极值点,从而难以使用梯度下降法。

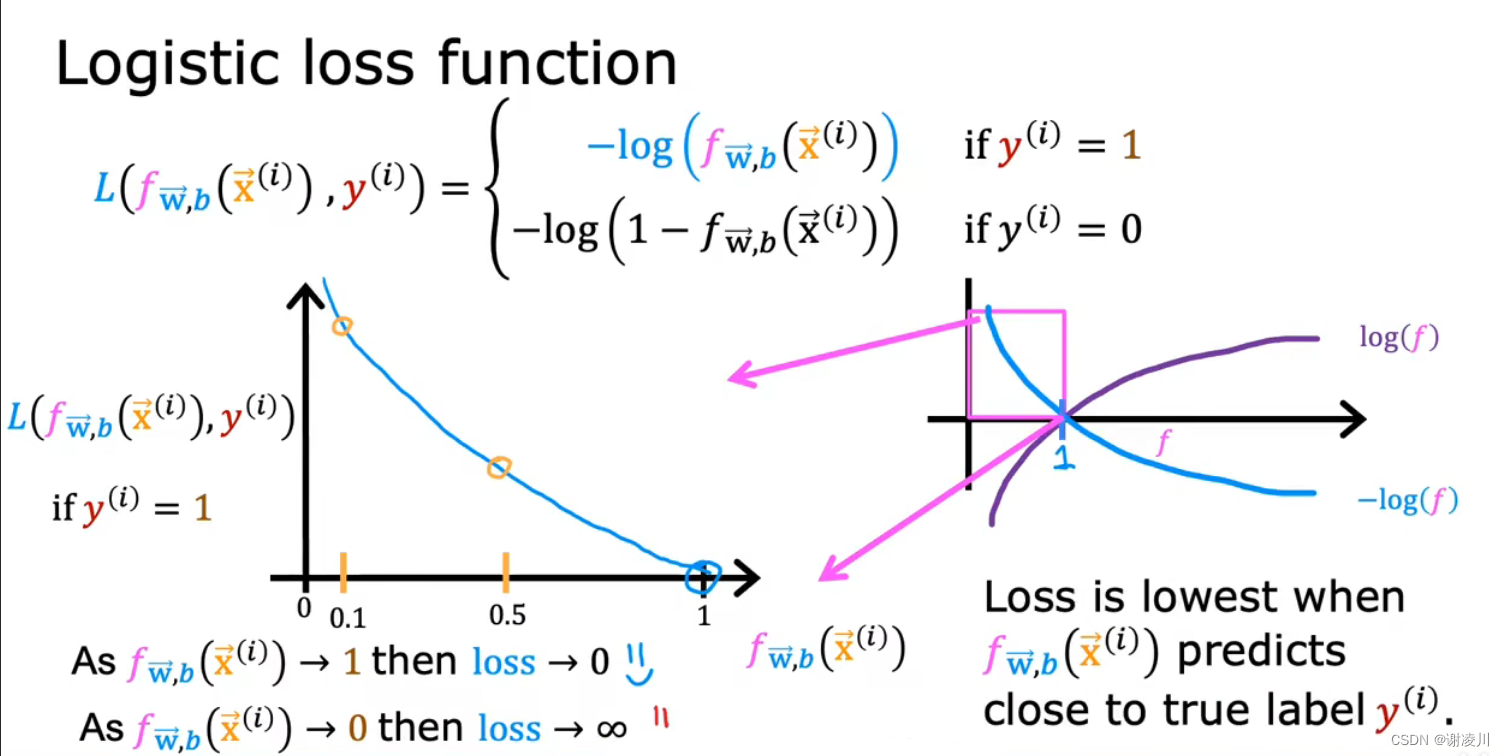

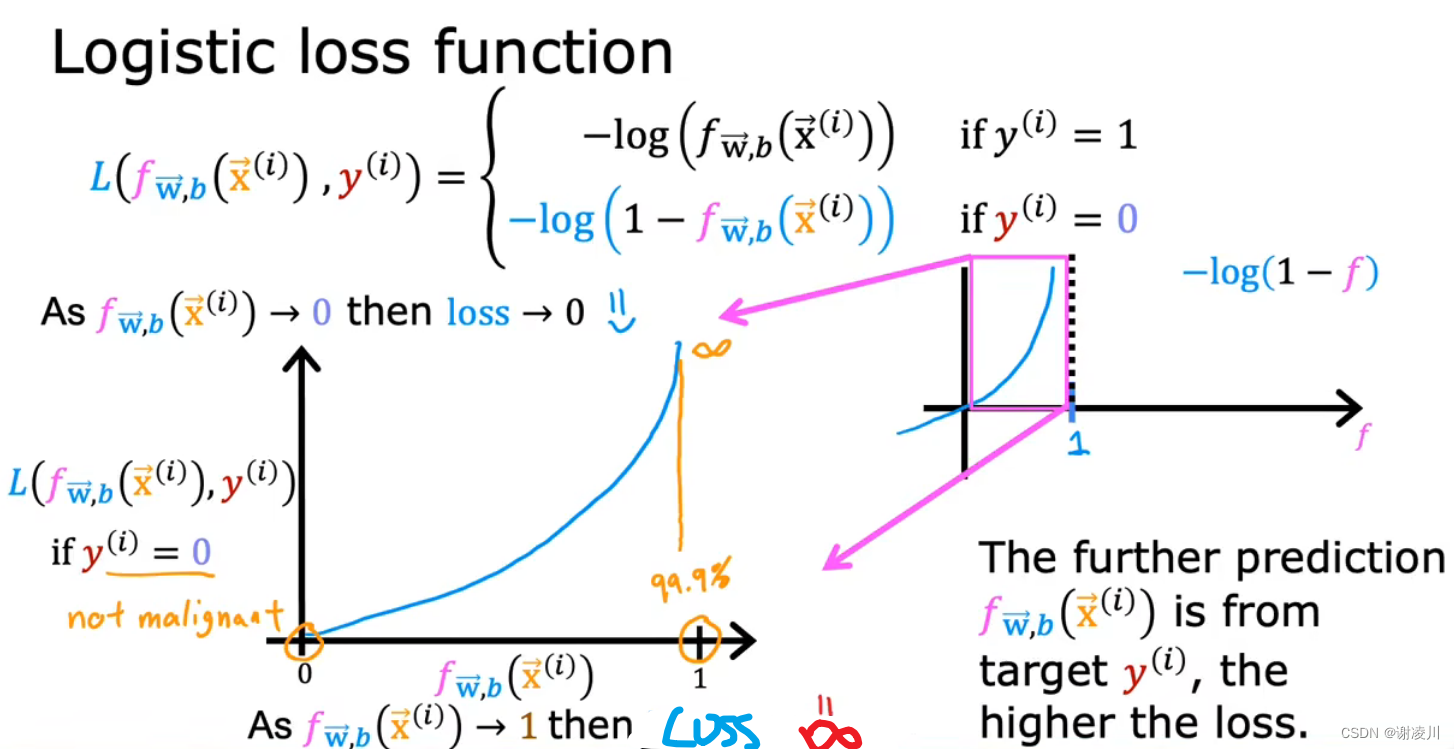

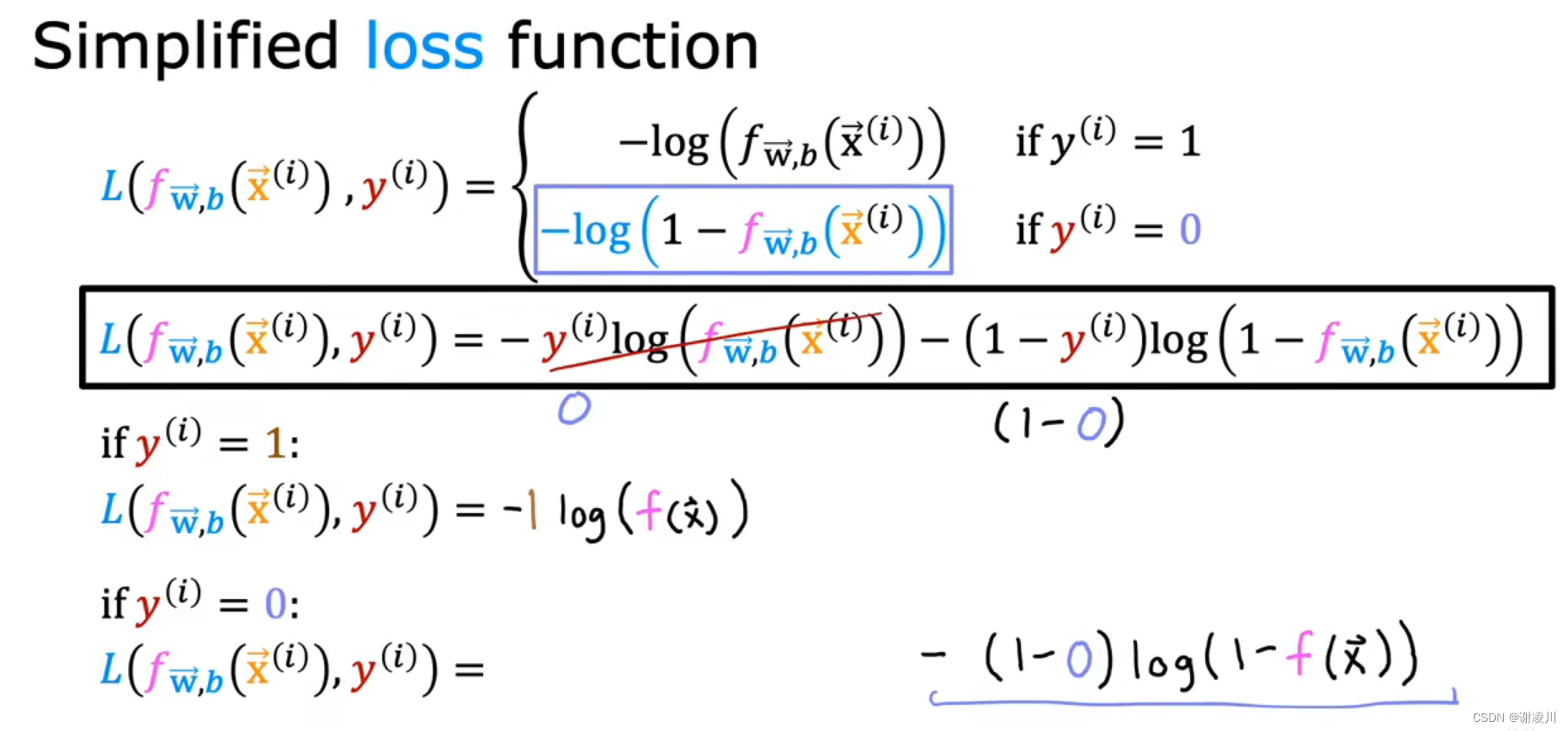

为解决该问题,定义逻辑回归的损失函数为:

如图所示,当yi为一个值(1或0),根据损失函数公式,当x接近这个值的时候,损失函数的值很小;反之,当x远离这个值的时候,损失函数的值就会变得非常大。这使得损失函数具有合理性。

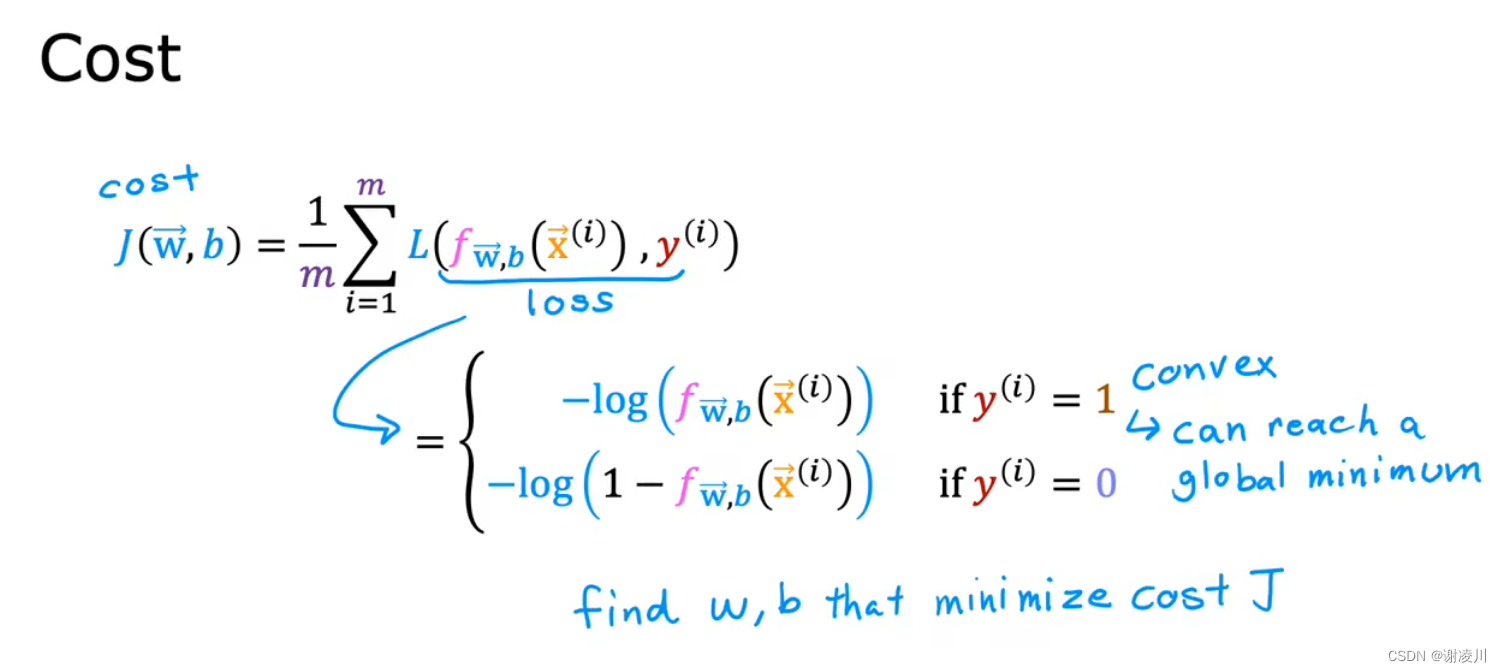

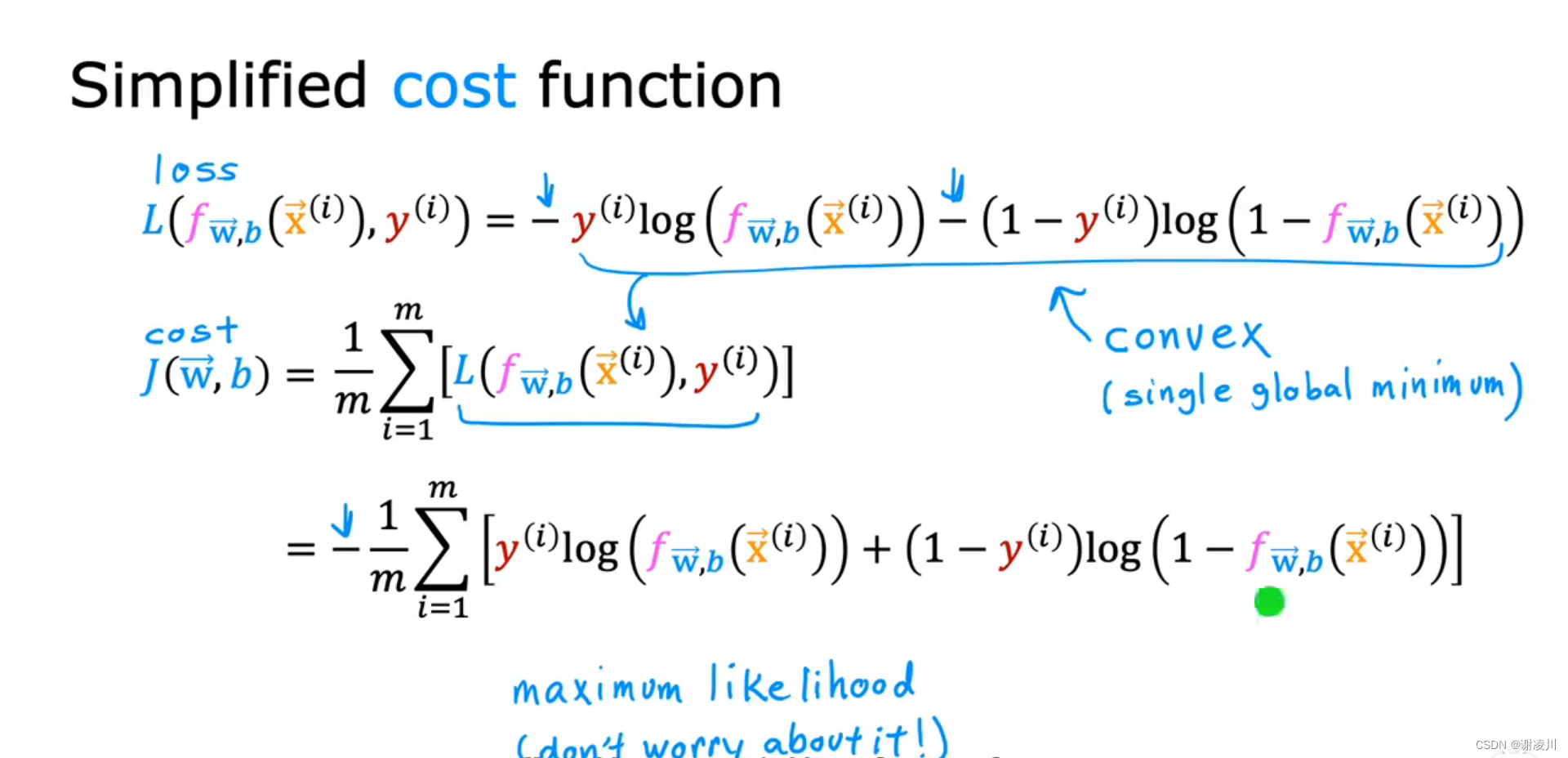

如图所示,得到损失函数后,定义代价函数为

接下来,就能够通过代价函数与梯度下降法,找到最合适的w和b了。

2.2 代价函数的简化

如图,将损失函数写成合并形式,即

当y取1或0时,上式等价于2.1中的损失函数公式。

带入代价函数公式,从而得到

上式即为代价函数的简化形式。

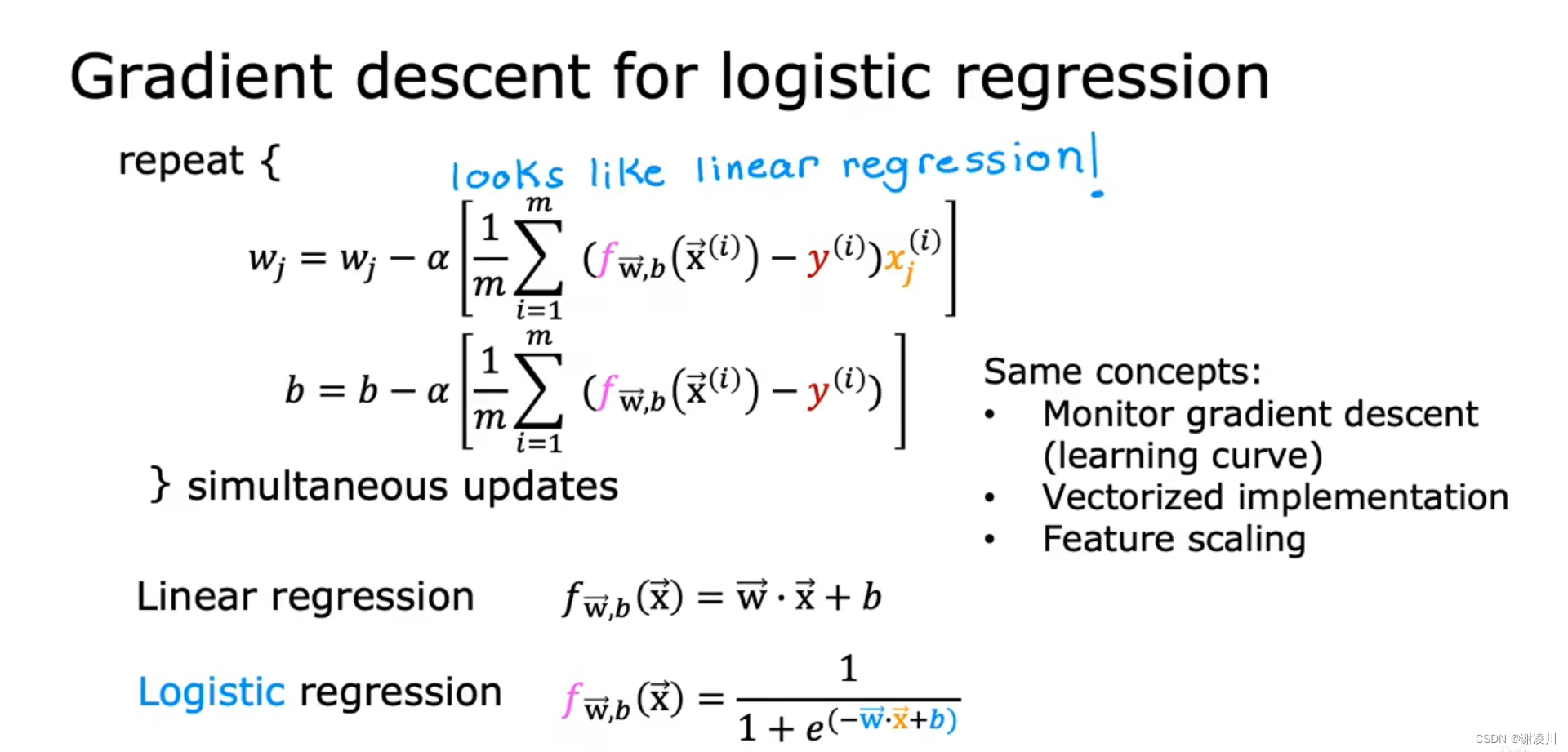

2.3 逻辑回归的梯度下降法

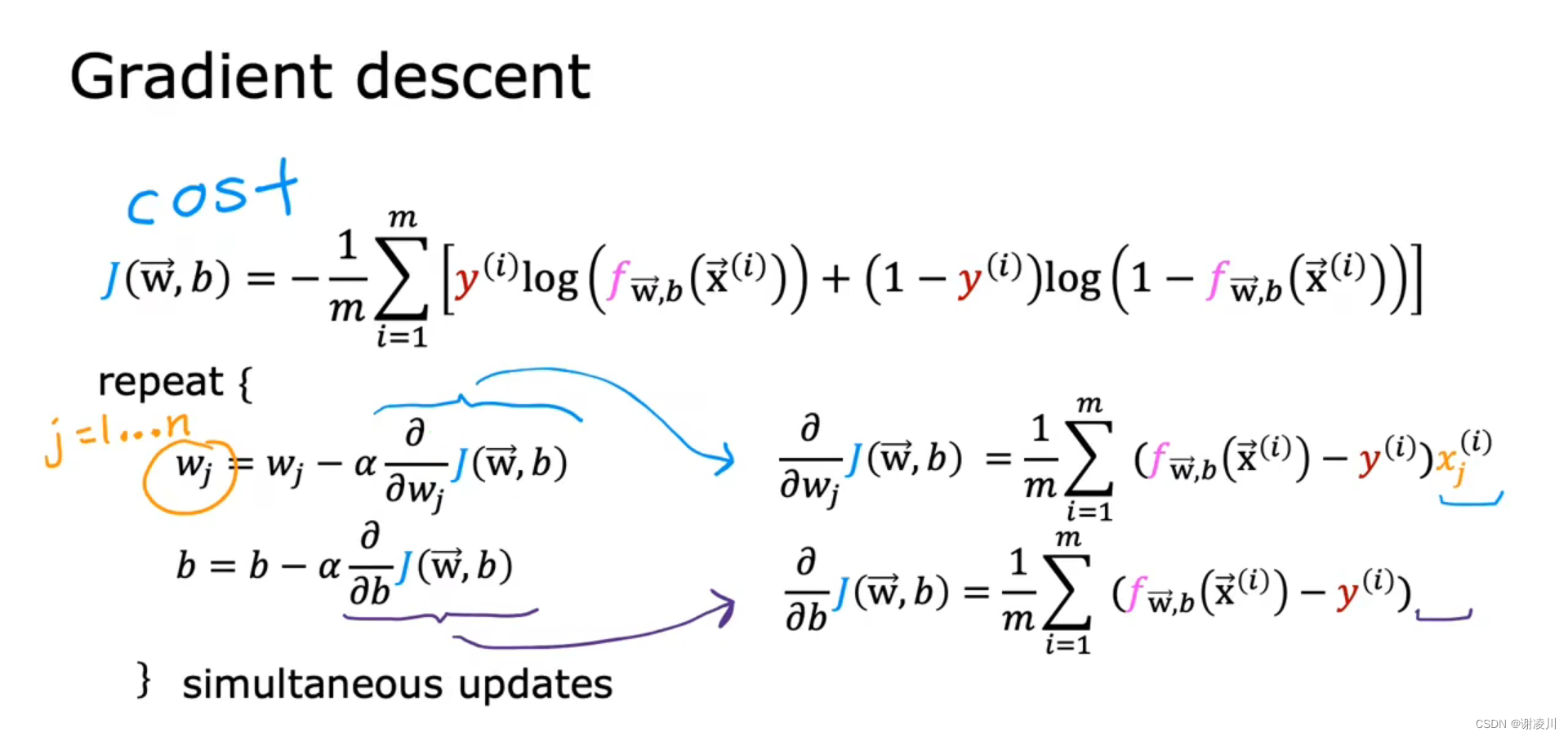

对于代价函数

对其应用梯度下降法,即

在这里,J对于w和b的偏导,与线性回归形式一致,但具有本质区别,需要特别注意。

10万+

10万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?