点击蓝字关注我吧!

在AI生成图像领域,一款新星模型横空出世——Flex.2-preview,由Ostris团队推出。这个拥有8亿参数的文本到图像扩散模型,不仅开源、轻量、强大,而且专为ComfyUI生态量身打造,一经亮相便引发了AI艺术社区的强烈关注。

今天这篇文章,就来带大家深扒这个模型到底有多“卷”,以及它在创作流程中能带来哪些实际提升。

详情入口:https://huggingface.co/ostris/Flex.2-preview

一、Flex.2是谁?它到底有多猛?

Flex.2-preview是Flex系列模型中的最新版本,其成长路线是这样的:

Flux.1 Schnell → OpenFlux.1 → Flex.1-alpha → Flex.2-preview

可以说,每一次迭代都让模型更灵活(flexible)、更可控、更实用,而这次的Flex.2,堪称是目前“最灵活”的文本转图像模型之一。

🔧 主要特性一览:

- ✅ 8亿参数,训练成本惊人,却完全开源

- ✅ 图像修补(Inpainting)原生支持

- ✅ 通用控制输入(Universal Control):支持姿态、线稿、深度图

- ✅ 支持ComfyUI节点化流程

- ✅ 文本输入长度支持512 token

- ✅ 开放许可(Apache 2.0),可商用

- ✅ 训练逻辑公开,LoRA微调友好

- ✅ 16通道潜空间,灵活构图逻辑更强

这不是“一个模型能干多事”,而是“一个模型集成了你需要的全部功能”。

二、ComfyUI 用户狂喜:一键集成无压力

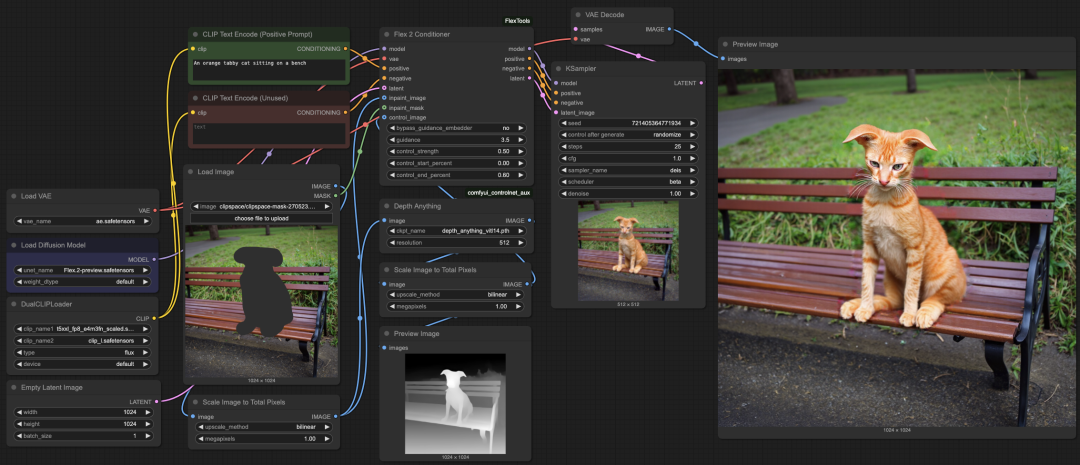

Flex.2最大的优势之一,就是与ComfyUI的深度集成。

你只需要安装 ComfyUI-FlexTools 插件,拿到 Flex2 Conditioner Node,再加上 comfyui_controlnet_aux 来生成控制图(如姿态图和深度图),就能轻松上手这款模型。

快速安装指南(简略版):

- 下载

Flex.2-preview.safetensors到ComfyUI/models/diffusion_models/ - 安装

ComfyUI-FlexTools插件(内含 Conditioner 节点) - 安装

comfyui_controlnet_aux以生成控制图 - 重启 ComfyUI,即可开始创作

从图像修补到深度控制,只需拖拽节点,复杂任务也能变得简单直观。

三、通用控制,让创作更自由

Flex.2不仅是文本生成图像的工具,它更像是一个创作辅助引擎。

🎯 Universal Control 输入三大类:

- 线稿(Line):用草图勾勒轮廓,让AI精准生成你想要的轮廓结构

- 姿态(Pose):通过人体姿态图控制人物动作,适合漫画、插画创作

- 深度图(Depth):控制景深和结构层次,场景构图更有空间感

一句Prompt + 一个线稿/深度图/姿态图,就能让AI按照你的“剧本”走,不再靠“拼运气”。

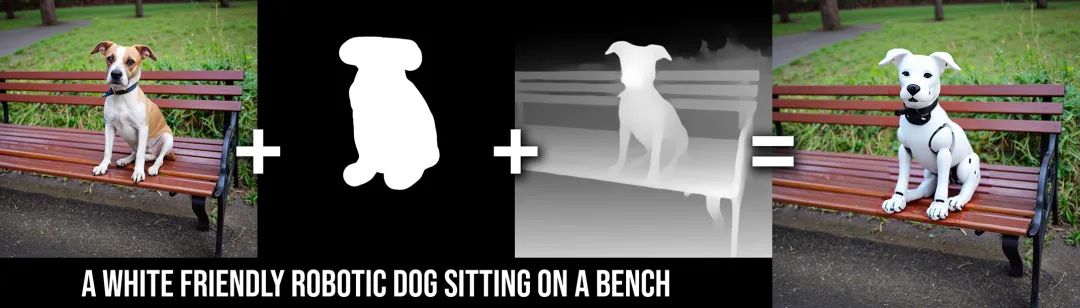

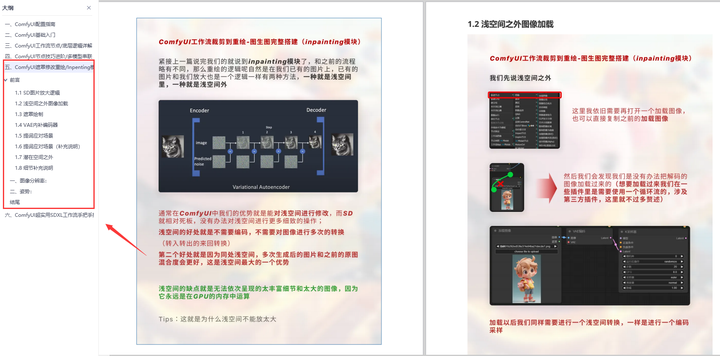

四、图像修补能力大升级

传统模型的inpainting功能往往依赖外部插件或后期处理,而Flex.2则把修补能力直接训练进模型本体。

只需要输入:

- 原图(如一只狗的照片)

- 掩码图(如抠掉狗的脑袋部分)

- 提示词(如“机器人狗”)

Flex.2就能在掩码区域内无缝生成新内容,而且和周围图像风格高度融合。真正做到了“只改想改的部分”。

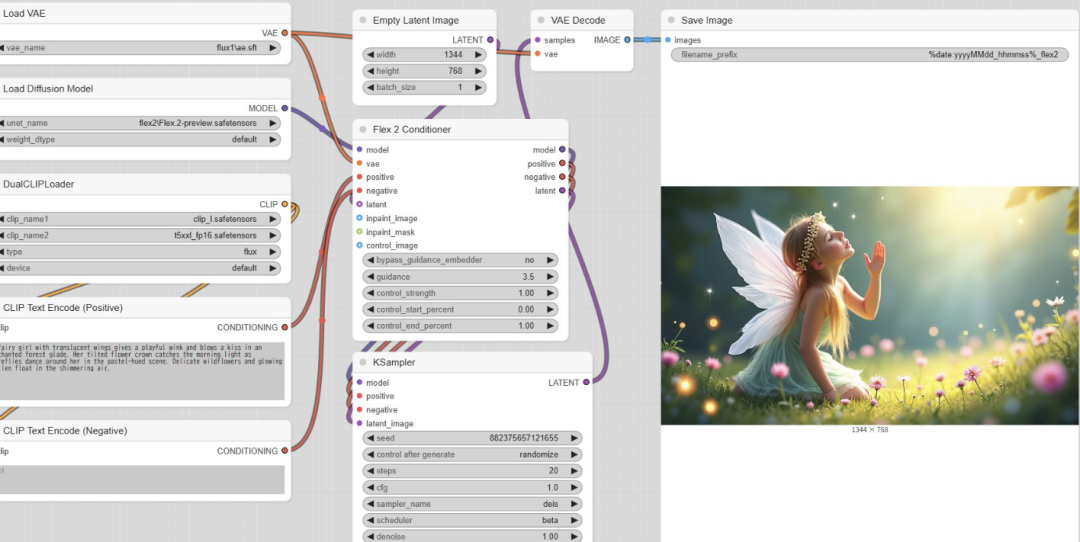

五、Diffusers 用户也有福了

对于非ComfyUI用户,Flex.2同样提供了兼容的接口。

只要安装diffusers、transformers、torch库,即可通过 AutoPipelineForText2Image 快速加载使用,并支持原生 inpainting + 控制图输入。

更贴心的是:即便你显卡小于24G,也能用 torchao 的量化加速方案流畅运行。

六、缺点也得说清楚

虽然Flex.2已经非常成熟,但它仍处于“Preview”阶段,仍存在以下问题:

- ❌ 在解剖学结构(如手指、肢体)上仍有不稳定情况

- ❌ 文字生成能力较弱,生成文字准确性不高

- ❌ 部分inpainting区域过渡仍显生硬

- ❌ 控制图如果质量较差,容易影响最终结果

不过好消息是,开发者正在积极优化训练逻辑,这些问题在后续版本中大概率会逐步解决。

七、面向创作者:LoRA支持来了

Flex.2不仅可用于生成图像,更是一个开放的训练平台。

你可以直接训练属于自己的LoRA微调模型,甚至还可以:

- 自动为你的数据集生成控制图

- 定制训练逻辑,教模型认识你自己的风格元素

- 使用 Flex.1-alpha 的 LoRA 与 Flex.2 通用

对于插画师、短视频作者、游戏原画师来说,这简直是一个AI风格养成的理想平台。

八、这是一次“功能整合”的创作革命

在Stable Diffusion百花齐放的今天,Flex.2-preview 的横空出世,不是一个新模型的简单发布,而是一次模型功能逻辑的整合式革命。

它不是单点能力突出,而是把“控制图+图像修复+节点化创作流程+LoRA训练”统统打包到一个模型中。

一句话总结:你只需要一个模型,就能实现AI图像创作全流程。

如果你是ComfyUI的老用户,那你一定得试试Flex.2;如果你是AI创作者新手,Flex.2就是你入门的“全能战士”。

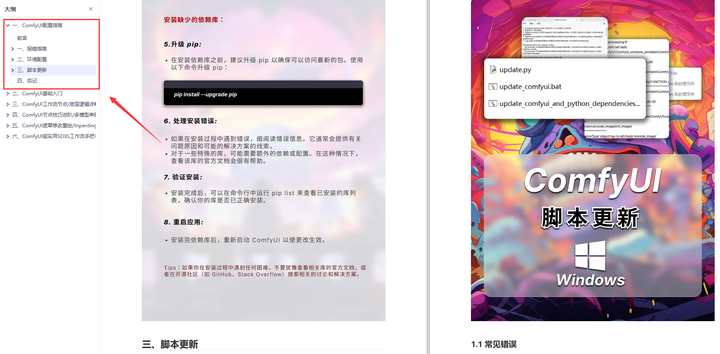

为了帮助大家更好地掌握 ComfyUI,我花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

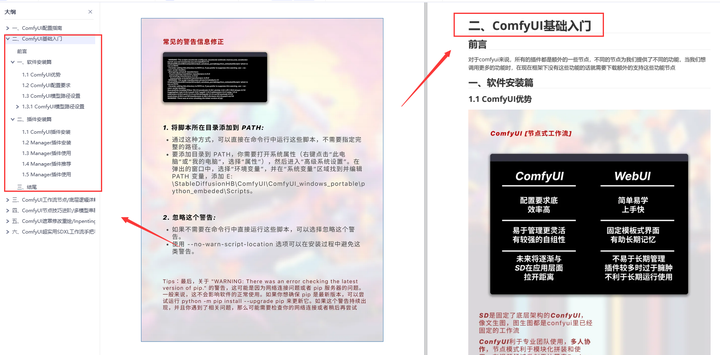

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

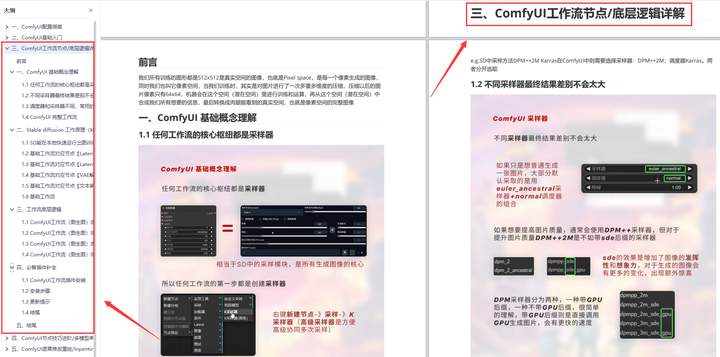

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

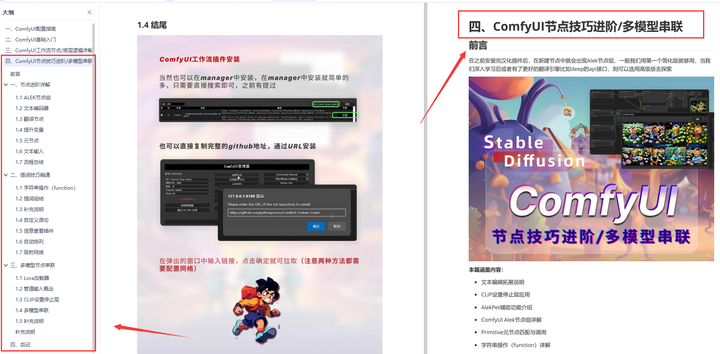

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

7500

7500

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?