目录

什么是HDR ?

当阳光破开云层,洒向大地时,从昏暗的阴影到光辉四溢的表面,自然界所呈现的色彩和亮度变化是如此丰富而微妙。HDR技术正是受此启发,通过拓宽亮度范围和增加色彩的层次,来重现现实世界的视觉盛宴。简而言之,HDR的精髓不仅在于调整画面的明暗度,更在于能够在极端明暗对比中保留更多细节,让图像显得更为立体和生动。

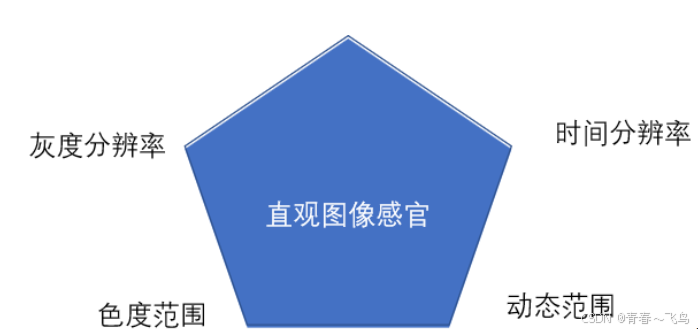

HDR技术的核心在于其能够记录并展示远超传统SDR的图像信息,包括每个像素点的亮度值。这意味着,在HDR显示下,即使是夜空中最微弱的星光或是正午阳光下最耀眼的反光,都能被精准捕捉并完美呈现。这一成就依赖于HDR图像在存储时对每个像素亮度信息的详细记录,以及在显示设备上的精确还原。

HDR的英文全称为High Dynamic Range Imaging,即高动态范围成像。与传统的SDR成像相比,HDR图像具有更高的动态范围,也就是明暗差别,这使得在表现亮度明暗时具有更佳的效果,特别是在极暗光和非常亮的场景下。HDR是用来实现比普通数位图像技术更大曝光动态范围的一组技术。HDR的目的是正确地表示真实世界中从太阳光直射到最暗的阴影的范围亮度,其可以提供更多的动态范围和图像细节。在计算机图形学中开创高动态范围成像的先驱是Paul Debevec,据说Debevec是第一个使用高动态范围成像图生成计算机图像以逼真地对计算机图形物体进行照明与动画处理。人们普遍认为Gregory Ward是高动态范围成像文件格式的奠基人。

与标准的RGB或YUV图像相比,HDR图像具有更大的动态范围,极大地丰富了图像记录的内容。高动态范围图像和低动态范围图像(Low Dynamic Range images,LDR images)是一对相对的概念。与LDR图像相比,HDR图像的位宽相对较大,能够记录更多的信息,但不能直接被普通的显示器所显示。

我们再从ISP处理的角度理解一下HDR图像和LDR图像的概念。在最为常见的图像格式中(如png, jpg等),使用RGB或YUV颜色空间,每个像素值用三个8bit整数表示。该颜色空间仅能存储可见色域的一小部分。

现在很多高端相机都可以输出12~16bit精度的RAW图,但是受限于各种限制(一般为显示器的限制),通常看到的图像基本都是经过ISP处理之后的8bit图像。在ISP对原始场景处理的过程中,原始RAW图的位宽被减小了,这导致了人眼可以感知到的不可挽回的信息损失。

这种传统成像技术输出的图像格式就是低动态范围(Low Dynamic Range, LDR)图像,也称为标准动态范围(Stand Dynamic Range,SDR)图像。需要指出的是,LDR图像并不总是低质量的。事实上,我们下文将要提到的HDR色调映射技术就是旨在将HDR图像映射为高质量的LDR图像用以显示。

高动态范围成像(英语:High Dynamic Range Imaging,简称HDRI或HDR),在计算机图形学与电影摄影术中,是用来实现比普通数位图像技术更大曝光动态范围(即更大的明暗差别)的一组技术。高动态范围成像的目的就是要正确地表示真实世界中从太阳光直射到最暗的阴影这样大的范围亮度。

高动态范围成像最初只用于纯粹由计算机生成的图像。后来,人们开发出了一些从不同曝光范围照片中生成高动态范围图像的方法。随着数码相机的日渐流行以及桌面软件变得易于使用,许多业余摄影师使用高动态范围成像的方法生成高动态范围场景的照片,但是,不要将这作为它唯一的用途,实际上高动态范围还有许多其它的应用。

当用于显示的时候,高动态范围图像经常要进行色调映射,并且要与其它几种全屏显示效果(full screen effect)一起使用。

在1997年的SIGGRAPH上,Paul Debevec提交了题为“从照片中恢复高动态范围辐射图”的论文。这篇论文描述了按照不同的曝光设置对同一个场景进行拍照,然后将这些采用不同曝光的照片组合成高动态范围图像。这种高动态范围图像可以捕捉从黑暗的阴影到亮光源或者高反光的更大动态范围的场景。

在SIGGRAPH 98一年之后,Debevec又提交了一篇论文“将人造物体渲染成真实场景:沟通基于图像的传统图形与全局照明以及高动态范围照片”。在这篇论文中,他使用以前的技术对光滑的铬球照相以生成他所称作的“light probe”,即本质上的高动态范围环境图。然后将这个light probe用于合成场景的渲染。与普通的环境图简单地提供反射或者折射信息不同,light probe还提供了场景中的照明,实际上,这是唯一的光源。这种方法实现了一种前所未有的真实感效果,为整体照明模型提供了真实世界的照明数据。

一些数码相机的生产商近年来不断地研发HDR技术,在相机中内置能够拍摄出高动态范围的硬件与软件。日本的富士公司早在2004年就推出了高动态范围的SuperCCD SR,这款影像传感器使用一半像素来记录正常亮度,另一半用来记录画面的暗部,使画面获得更多的细节,这项技术也应用于富士旗下的数码单反。随后其他品牌的数码单反也都各自推出自己的提高影像动态范围的技术,例如佳能公司的高光优先模式、尼康公司的Active D-Lighting技术、索尼公司的D-Range Optimizer、宾得公司的动态范围扩大功能等。现在各厂家的很多小型数码相机也开始置入了这项功能。

从2016年开始,许多电视厂商开始在电视机上加入HDR功能。但早期,这些电视更多的是“支持HDR”,而非真正能够完美显示HDR图像。我们知道,HDR图像具有极高的动态范围和色彩。要完美显示HDR图像,显示器必须具备超高对比度和高色域。而早年的一些电视虽然芯片或面板支持HDR,但并不能正确显示HDR图像的效果,这就是俗称的“假HDR”。在那一年,假HDR电视成为了一个负面代名词,因为它们比传统SDR电视贵很多,效果却不尽人意。

2022年01月30日,中国国家广播电视总局发布《高动态范围电视系统显示适配元数据技术要求》(GY/T 358—2022)行业标准。HDR作为高新视频领域的一项关键基础技术,过去只有少数国外企业能够提供。国家广播电视总局组织国内产学研用机构开展科技攻关,实现技术突破,填补了国内空白。

HDR图像存储了每个位置的亮度数值,而传统背光无法精确控制每个区域的部分亮度,这就是早年假HDR电视的一个问题——没有分区背光。分区背光技术允许显示器单独控制一个区域的灯珠亮度,从而获得更高的亮度和对比度。理论上,分区背光的区域越多越好,但这需要算法的支持。

说到这里,你可能会想到另一个技术:OLED。确实,理论上OLED才是HDR的最佳搭档。与传统的LED不同,OLED可以单独控制每个像素点的开关和亮度大小,拥有近乎无限的对比度和超高的色彩范围。然而,即便到了今天,OLED电视的价格依旧不是普通人可以接受的,其普及还需要时间。

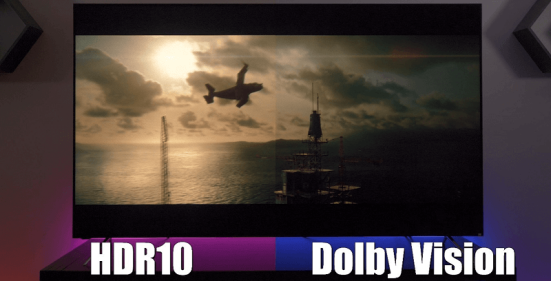

言归正传,下面我们来深入探讨一下HDR认证。在选购显示器时,切莫以为只要具备HDR认证就万事大吉,这种想法很容易让我们陷入早年市场上那些虚假HDR电视所设下的陷阱。目前,电视领域主流的HDR认证主要包括四种:HDR10、HDR10+以及杜比视界。而在显示器领域,最为广泛采用的则是Display HDR认证。

HDR10是由蓝光协会、UHD联盟、HDMI共同制定的标准。然而,该标准在技术要求上相对较低,因为它所涵盖的图像均为静态,这意味着理论上无需支持动态范围即可获得认证。这一特性使得HDR10成为了早年HDR电视机最为广泛采用的认证之一。

在此基础上,HDR10+技术的诞生,旨在与杜比视界相媲美。相较于HDR10,HDR10+在显示画面亮度上实现了动态调节,使得每一场景都能呈现出独特的HDR效果,为观众带来更为细腻且富有层次感的视觉盛宴。

杜比视界的全称为Dolby Vision,相较于前两种HDR标准,杜比视界HDR的要求更为严格。使用杜比视界视频和电视均需通过杜比公司的认证,且认证过程需要支付费用。因此,杜比视界通常只在售价较高的设备上出现。该技术由杜比实验室开发,能够针对每个场景甚至是每一帧进行调整,从而让用户看到更丰富的色彩和细节。与HDR10相比,杜比视界的亮度上限为10000nit,远高于HDR10的1000nit,色深也从10bit提升到了12bit。然而,由于授权费用高昂,市场上出现了HDR10+。

Display HDR是VESA制定的HDR标准,是目前业内首个公开的标准,已有超过270家公司参与。VESA协会制定这一标准的目的是解决业界标准混乱的问题。目前主要有Display HDR400、600、1000、1400等几种认证。获得这些认证的要求如下:Display HDR400要求白点亮度≥400nit,边角黑亮度≤0.4nit,色域至少为95%的sRGB。驱动板需支持10bit处理,显示面板不能低于8bit。Display HDR600的要求则分别为600nit、0.1nit、色域增加到99%的sRGB,并增加对90%的DCI-P3的支持。至于1000和1400档位与600档位大致相同,主要区别在于亮度和边角黑亮度的要求。需要注意的是,Display HDR400的显示器虽然支持HDR,但效果可能并不理想。另外,一些电视声称「支持 HDR 输入」,实际上是指可以播放HDR视频,但无法以HDR模式显示。

由此可见,HDR技术无疑是显示领域的一大进步,它正引领着我们的视觉体验迈向全新的境界。透过深入探究HDR的工作原理、认证标准,以及其未来发展,我们得以更加明智地挑选合适的显示设备。这一技术的进步,无疑为我们的日常生活增添了一抹璀璨的光彩。

HDR范围

对于合成一张HDR照片需要拍摄多少张照片并没有一定的规则,因为这主要由场景的动态范围决定:动态范围越大,拍摄者就需要拍摄更多的照片来使曝光覆盖这个范围。同样的,对于每张照片的曝光间隔也没有规定。这里的例子以1档为曝光增量,这便保证了照片序列有一个较大的曝光范围以覆盖场景总的动态范围。然而,拍摄者也可以使拍摄的照片曝光以2档为增量,这样拍摄较少的照片就可以覆盖最亮至最暗部的曝光范围。

动态范围 (dynamic range)一般指的是可变化信号(例如声音或光)最大值和最小值的比值。例如在真实世界中,某个场景的动态范围就可以定义为场景中最亮部分的亮度值与最暗部分的亮度值之比。在数字图像中,动态范围常常定义为:

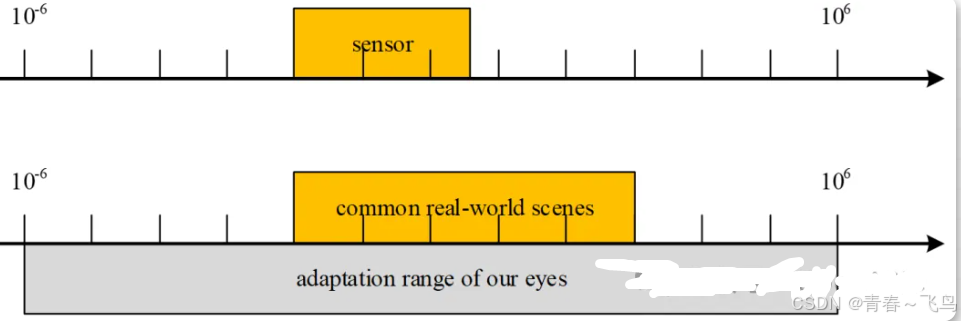

动态范围越广,图像中所能记录的信息就越丰富。然而,数码相机成像的动态范围都只是典型自然场景动态范围的很小一部分。现实世界的场景不仅比数字图像更明亮、更丰富多彩,而且对比度更高。人类视觉系统已经进化到能处理真实世界中如此高的动态范围,但传统的数字成像技术无法表现如此高的动态范围(如下图示意),易出现亮部和暗部细节丢失的问题。例如,在高对比度环境下拍摄得到的照片,过亮的景象可能只呈现为一片纯白,而暗处的细节则可能淹没在阴影之中。

色调映射

在查看高动态范围图像的时候经总是会遇到一个问题,CRT、LCD、打印机以及其它图像显示方法只能显示有限动态范围的图像。因此,人们开发了各种将高动态范围图像“转换”成可以查看的图像的方法,这些方法统称为“色调映射”。

早期的色调映射非常简单,这些方法设置一个动态范围窗口,按照最大值、最小值对图像进行裁剪。最近出现的方法试图显示更大的动态范围,一些更加复杂的方法已经在研究人眼及视神经感知场景的机制,并且争取在保持真实的颜色与对比度前提下显示全部的动态范围。

应用领域

HDR的特点是:

画面信息含量大光影细节丰富;包含前期拍摄和后处理两部分;合成后的照片效果与次成像、直接输出的数码照片有很的不同;对摄影者有一定的技术要求HDR的这些特点,决定了它只适拍摄一些特定的题材。

例如:

(1)光摄影。由于风光摄影常面对大光比画面,很适合HDR技术。

(2)花草等静态摄影。这类题材于色彩变化和光影丰富,同时又相静止,利于前期拍摄。

(3)日落日出和夜景都是拍摄HDR的好题材。此类题材画面中天空和面景物明暗反差很大,数码相机的动态范围满足不了如此大的动态范围是HDR最适合的应用题材。尤其是拍夜景,HDR可以很好地展现一般夜景无法记录下的天空微弱光线与地面源所产生的对比效果。

(4)室内拍摄时,画面中包括室较暗的场景和室外十分明亮的景物HDR可以使室内场景和室外景物在张照片中都得到很好地展现总之,只要是那些画面相对稳定而又存在较大明暗反差的场景,都以用HDR的手法来拍摄并通过HDR后期处理来合成。

相关比较

通常保存在高动态范围图像中的信息对应于真实世界可以观察到的亮度(luminance)或者radiance值,这与传统的数字图像保存的在显示器或者打印纸上显示的颜色不同。所以,高动态范围图像格式也经常成为“与场景相关”,以区别于传统的“与设备相关”或者“与输出相关”的数字图像。另外,传统图像通常经常针对人类视觉系统进行编码(最大化保存在固定数据位中的可视信息),这些编码通常称作“伽玛编码”或者“gamma校正”。保存在高动态范围图像中的数据经常是线性的,这就意味着它们表示亮度或者radiance的相对或者绝对值(gamma 1.0)。

高动态范围图像每个颜色通道需要比传统图像更多的数据位,这是因为它的线性编码以及需要表示从10^-4到10^8人眼可见亮度范围甚至是更大范围的数值。经常使用16位“half precision”或者32位浮点数表示高动态范围像素。但是,如果使用合适的传递函数进行变换,一些应用中的高动态范围像素可以用10-12位表示亮度,用8位表示色度,并且不会带来任何可见的量化误差。

在当今这个科技飞速更新的时代,HDR作为一种革新性的显示技术,已不知不觉间渗透进我们的日常生活。尽管HDR这一概念早已与我们的日常产生了交集,但对于大多数人而言,HDR依旧很陌生。因为厂商一直在科普HDR的时候做的很含糊,只告诉你图像表现比传统SDR要好,但是却没有再做更多说明,包括各种HDR认证也一样。因此,本文旨在为大家详尽解析HDR的相关知识,以及不同标准的HDR都有什么区别。

HDR技术

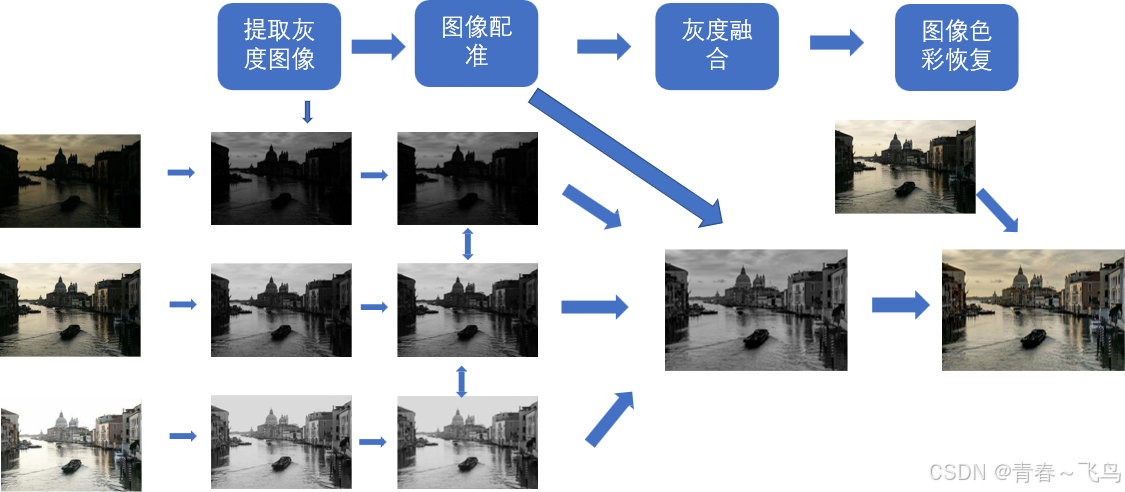

HDR技术涵盖的范围很宽,包括HDR传感器(即HDR图像的采集)、 多曝光融合、HDR图像色调映射、HDR显示器等。经过HDR技术处理的图像相较LDR图像更加真实、自然,细节更加丰富。如下图所示,前三张是传统技术在不同曝光参数下得到的LDR图像,最后一张是HDR技术得到的图像,它能更好地呈现不同亮度区域的细节。研究HDR成像技术对提高图像质量、还原真实场景有着至关重要的作用。在HDR技术中,与我们ISP最相关的是多曝光融合技术和HDR图像色调映射技术。

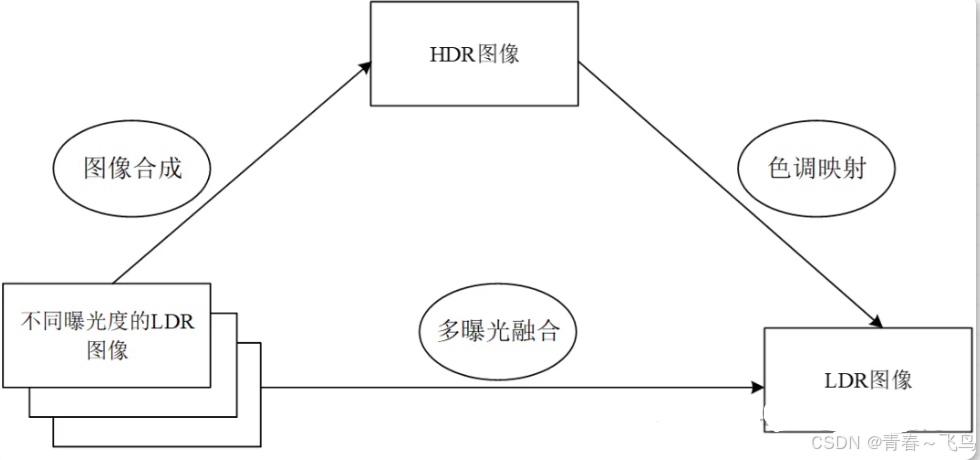

为了较好地呈现出高动态范围的场景,可以先用多个不同的曝光水平拍摄同一个场景,得到多张LDR图像,其中的每张LDR图像都只能清晰地捕捉到某个亮度范围内的信息,例如长曝光负责捕获暗区细节,短曝光负责捕获亮区细节。在工程实践中,通常将这三种曝光的图像融合起来,实现互补的图像信息融合。根据技术路径的不同,这些算法通常分为两种主要类型,如下图所示。

第一种是基于拍摄到的多张不同曝光水平的LDR图像,先合成HDR图像,然后进行色调映射,压缩HDR图像的位宽,以生成和原图相比更高质量的LDR图像;第二种则是直接逐像素加权融合这些低质量的LDR图像以产生高质量的LDR图像,省略了生成HDR图像和色调映射的步骤。

HDR原理

HDR算法可以通过三帧不同ev融合,达到提升暗处亮度、压制亮区亮度,扩展动态范围的目的。

当你开启HDR后,手机会自动拍摄三张不同曝光度的照片,整个过程就是三张照片的“曝光融合”:

1. 标准曝光:按照相机测光的结果,拍摄一张正常曝光的照片。

2. 曝光不足:拍摄一张比标准曝光更暗的照片,用来捕捉高光部分的细节。

3. 曝光过度:拍摄一张比标准曝光更亮的照片,用来捕捉暗部的细节。

拍摄完成后,手机会自动将这三张照片合成一张,利用算法将不同曝光照片中的细节进行融合,最终得到一张动态范围更宽、细节更丰富的HDR照片。

常见HDR的处理方法

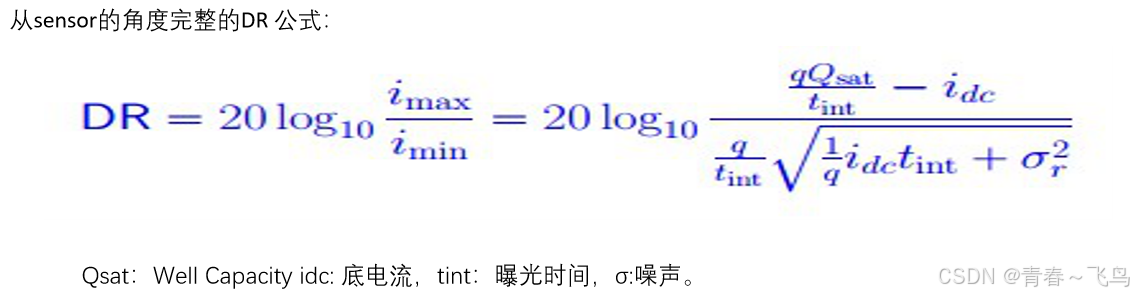

目前图像设备中最常见的HDR方法主要分为下面两种:(1)Sensor HDR(2)后处理 HDR

方法一:

提高 Qsat --Well capacity 。就是提高感光井的能力,这就涉及到 sensor 的构造,简单说,sensor 的每个像素就像一口井,光子射到井里产生光电转换效应,井的容量如果比较大,容纳的电荷就比较多,这样 i_max 的值就更大。普通的 sensor well 只 reset 一次,但是为了提高动态范围,就产生了多次 reset 的方法。

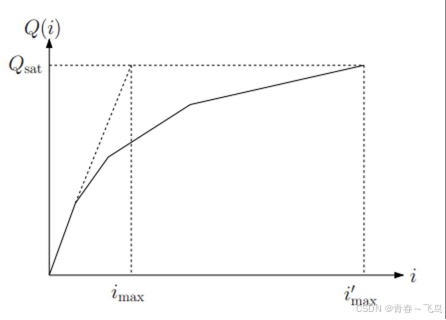

通过多次 reset,imax增加到 i‘max,上图就是 current to charge 的转换曲线。 但这种方法的缺点是增加 FPN,而且 sensor 的响 应变成非线性,后边的处理会增 加难度。

方法二:

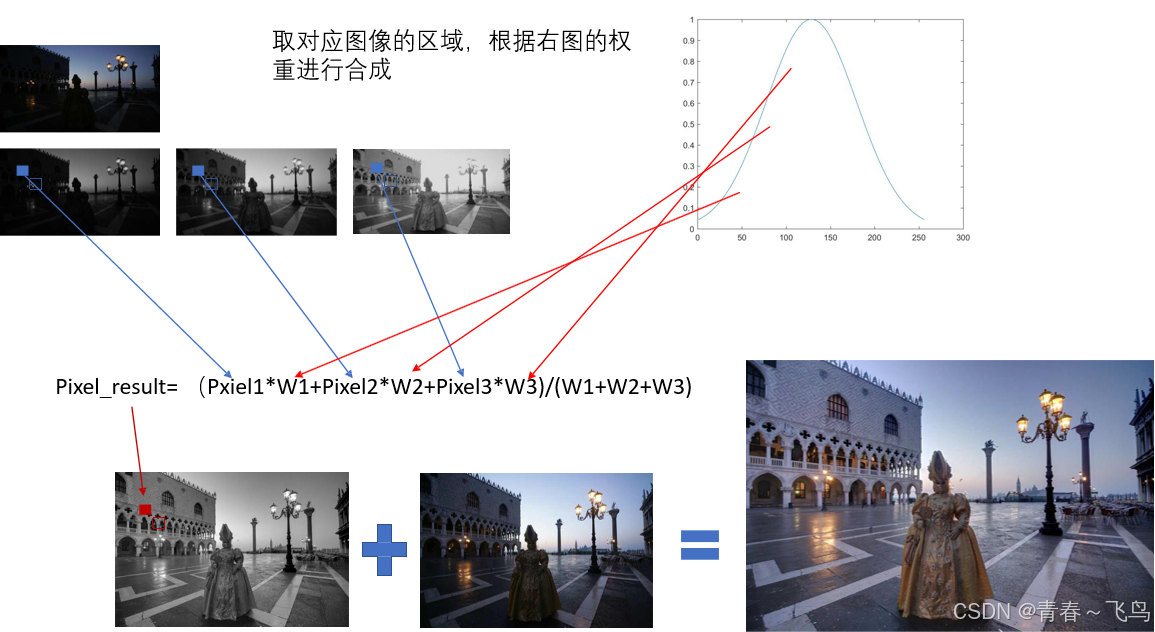

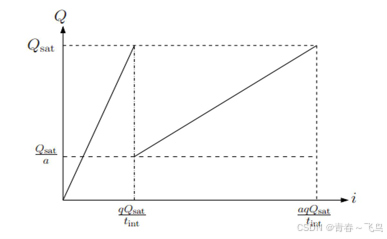

多曝光合成。本质上这种方法就是用短曝光获取高光处的图像,用长曝光获取阴暗处的图像。有的厂家用前后两帧长短曝光图像,或者前后三针长、中、短曝光图像进行融合If (Intensity > a) intensity = short_exposure_frame;

If (Intensity < b) intensity = long_exposure_frame;

If (b<Intensity <a) intensity = long_exposure_frame x p + short_exposure_frame x q;

这段code就是说当该像素值大于一个门限时,这个像素的数值就是来自于短曝光,小于一个数值,该像素值就来自于长曝光,在中间的话,就用长短曝光融合。这是个比较简化的方法,实际上还要考虑噪声等的影响。 |

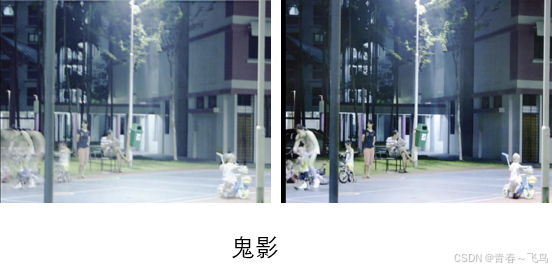

Current to charge 曲线显示:imax增加 a 倍。 这种多帧融合的方法需要非常快的 readout time,而且即使 readout 时间再快,多帧图像也会有时间差,所以很难避免在图像融合时产生的鬼影问题。尤其在 video HDR 的时候,由于运算时间有限,无法进行复杂的去鬼影的运算,会有比较明显的问题。于是就出现了单帧的多曝光技术。

方法三:

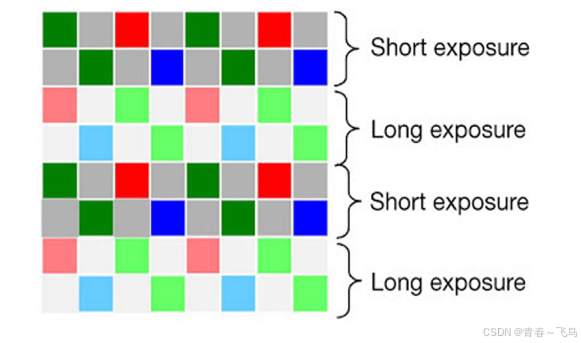

单帧空间域多曝光。最开始的方法是在 sensor 的一些像素上加 ND filter,让这些像素获得的光强度变弱,所以当其他正常像素饱和的时候,这些像素仍然没有饱和,不过这样做生产成本比较高,同时给后边的处理增加很多麻烦。所以下面的这种隔行多曝光方法更好些。

如图所示,两行短曝光,再两行长曝光,然后做图像融合,这样可以较好的避免多帧融合的问题,从而有效的在 video 中实现 HDR。同时由于 video 的分辨率比 still要低很多,所以这个方法所产生的分辨率降低也不是问题。这个方法是现在 video hdr sensor 的主流技术

其他方法:

logarithmic sensor实际是一种数学方法,把图像从线性域压缩到log域,从而压缩了动态范围, 在数字通信里也用类似的技术使用不同的函数进行压缩,在isp端用反函数 再恢复到线性,再做信号处理。缺点一方面是信号不是线性的,另一方面会 增加FPN,同时由于压缩精度要求对硬件设计要求高。局部适应 local adaption这是种仿人眼的设计,人眼会针对局部的图像特点进行自适应,既能够增加 局部的对比度,同时保留大动态范围。这种算法比较复杂,有很多论文单独 讨论。目前在sensor 端还没有使用这种技术,在ISP和后处理这种方法已经 得到了非常好的应用

多重曝光的HDR流程

最简单的图片融合过程

HDR常见的图像问题

鬼影造成的原因是因为在拍摄运动物体时,多张图像的物理位置不同,合成后导致拖影(俗称ghost)

高动态场景曝光时间选择如果不合适,会导致输入图像的信息丢失,导致不能有效地进行图像融合。(例如左边图片整体过曝)

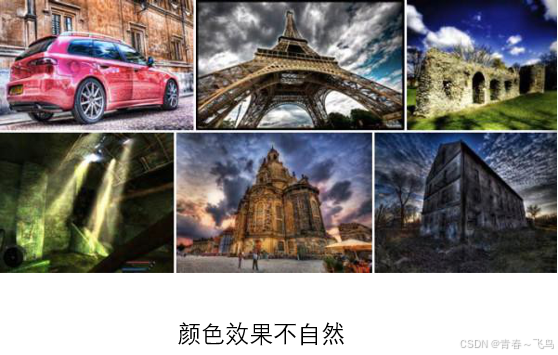

不同亮度下的颜色还原程度不一样,合成后的颜色会有差异(尤其在蓝色与红色上)

虹软HDR

4帧HDR:前摄四帧ev0.25, -2, -3, -4 || 后摄四帧ev0.25, 1, -2, -4

8帧LLHDR:前后摄ev均是0 -2 0 -5 0 0 0 0

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?