之前在做Yolo系列项目的时候使用TensorRT加速,在安装困惑了好长时间,所以在安装好之后总结了一下,以下就是具体详细步骤,帮助避坑:

首先要注意的是我的cudnn的版本是11.6的,这里下载的最新的TensorRT

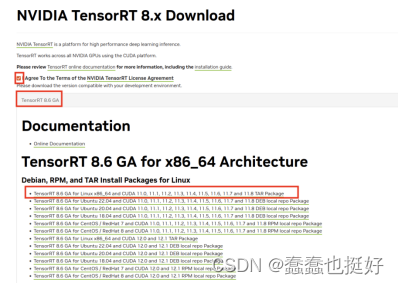

1.先在NVIDIA上面找到对应版本位置并下载TensorRT

下载路径:Log in | NVIDIA Developer 具体下载看下面这幅图。

2. 下载完成之后打开这个文件所在路径并解压,命令为:tar -zxvf TensorRT-8.6.1.6.Linux.x86_64-gnu.cuda-11.8.tar.gz,本人建议新建一个存放的文件夹,或者和粗大放在一起。

3.解压完成之后配置环境变量,命令为: vim ~/.bashrc 并在最后一行输入下图两行代码:

![]()

注意:等于号之后的路径是解压后Tensorrt所在的文件夹路径,保存并退出 wq!,至此环境变量配置完毕。

4.配置完成之后返回tensorrt路径下进入sample,在进入cd sampleOnnxMNIST/,使用make编译

5.编译完成之后先重新启动终端再次返回tensorrt路径下检查是否安装成功,进入bin里面,运行./sample_onnx_mnist,如果运行成功到此Tensorrt安装成功

常见问题:

如果在编译时出现上述问题,先检查bashrc文件里面的环境变量配置是否有误,接着就是cudnn出现问题,找到cudnn文件所在位置,将cudnn中的lib.tar文件解压到cuda文件的lib64文件夹里面(如果没有lib.tar文件请运行命令:tar czvf ../lib64.tar *,将lib重新打包在解压),重新解压 sudo tar -xvf lib64.tar -C /usr/local/cuda/lib64/ 解压完成之后就可以重新编译了

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?