目录

习题7-1 在小批量梯度下降中,试分析为什么学习率要和批量大小成正比

习题7-2 在Adam算法中,说明指数加权平均的偏差修正的合理性

习题7-9 证明在标准的随机梯度下降中,权重衰减正则化和编辑正则化的效果相同.并分析这一结论在动量法和Adam算法中是否依然成立

习题7-1 在小批量梯度下降中,试分析为什么学习率要和批量大小成正比

在小批量梯度下降中:

令,则:

因此要使得参数最优,则为参数最优的时候的常数,故学习率和批量大小成正比。

批量大小越大,随机梯度的方差越小,引入的噪声也越小,训练也越稳定,因此可以设置较大的学习率;而批量大小较小时,需要设置较小的学习率,否则模型会不收敛,因此学习率通常随批量大小的增加而相应德增大,即成正比关系。

习题7-2 在Adam算法中,说明指数加权平均的偏差修正的合理性

在Adam算法中:

因此当的时候:

因此可以发现此时梯度消失,因此需要进行偏差修正。

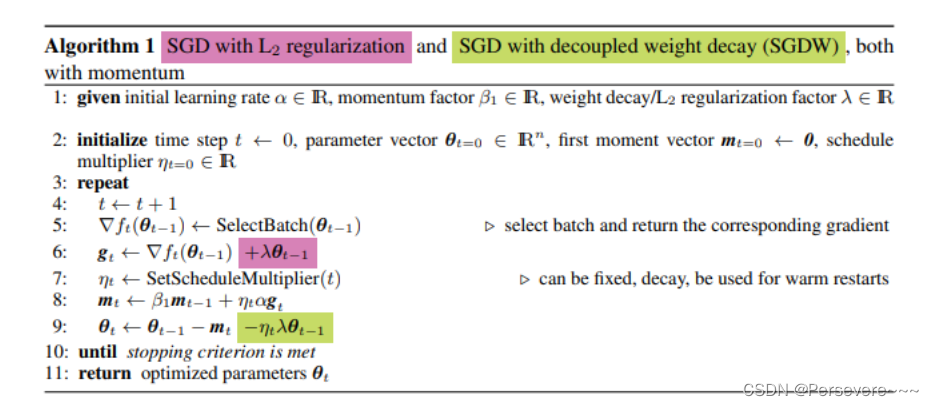

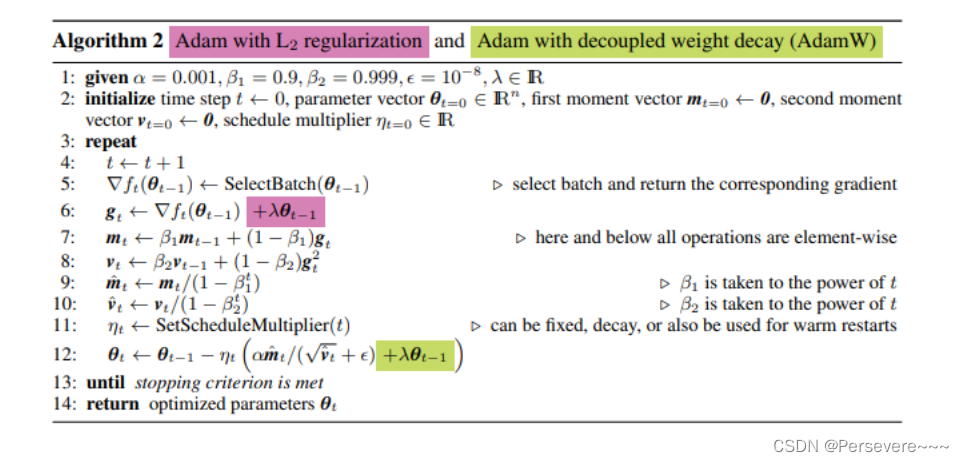

习题7-9 证明在标准的随机梯度下降中,权重衰减正则化和编辑正则化的效果相同.并分析这一结论在动量法和Adam算法中是否依然成立

在标准的随机梯度下降中,权重衰减正则化和 ℓ2 正则化的效果相同,因此,在一些深度学习框架中通过 ℓ2 正则化来实现,但是,在较为复杂的优化方法(比如 Adam)中,权重衰减正则化和 ℓ2 正则化并不等价。

L2正则化梯度更新的方向取决于最近一段时间内梯度的加权平均值。

当与自适应梯度相结合时(动量法和Adam算法),L2正则化导致导致具有较大历史参数 (和/或) 梯度振幅的权重被正则化的程度小于使用权值衰减时的情况。

总结

本此作业完成了部分课后题,对本章的内容学习是很好的补充和答疑解惑,也总结了本章的思维导图,能帮助自己更好的掌握本章的知识。

参考:

NNDL 作业12:第七章课后题_HBU_David的博客-CSDN博客

2710

2710

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?