GPT-3分词器:解锁自然语言处理的新境界

在人工智能和自然语言处理(NLP)领域,GPT-3(Generative Pre-trained Transformer 3)模型的出现无疑是一个里程碑。而在这个强大模型的背后,分词器扮演着至关重要的角色。今天,我们将深入探讨一个专为GPT-3设计的分词器——GPT-3 Tokenizer。

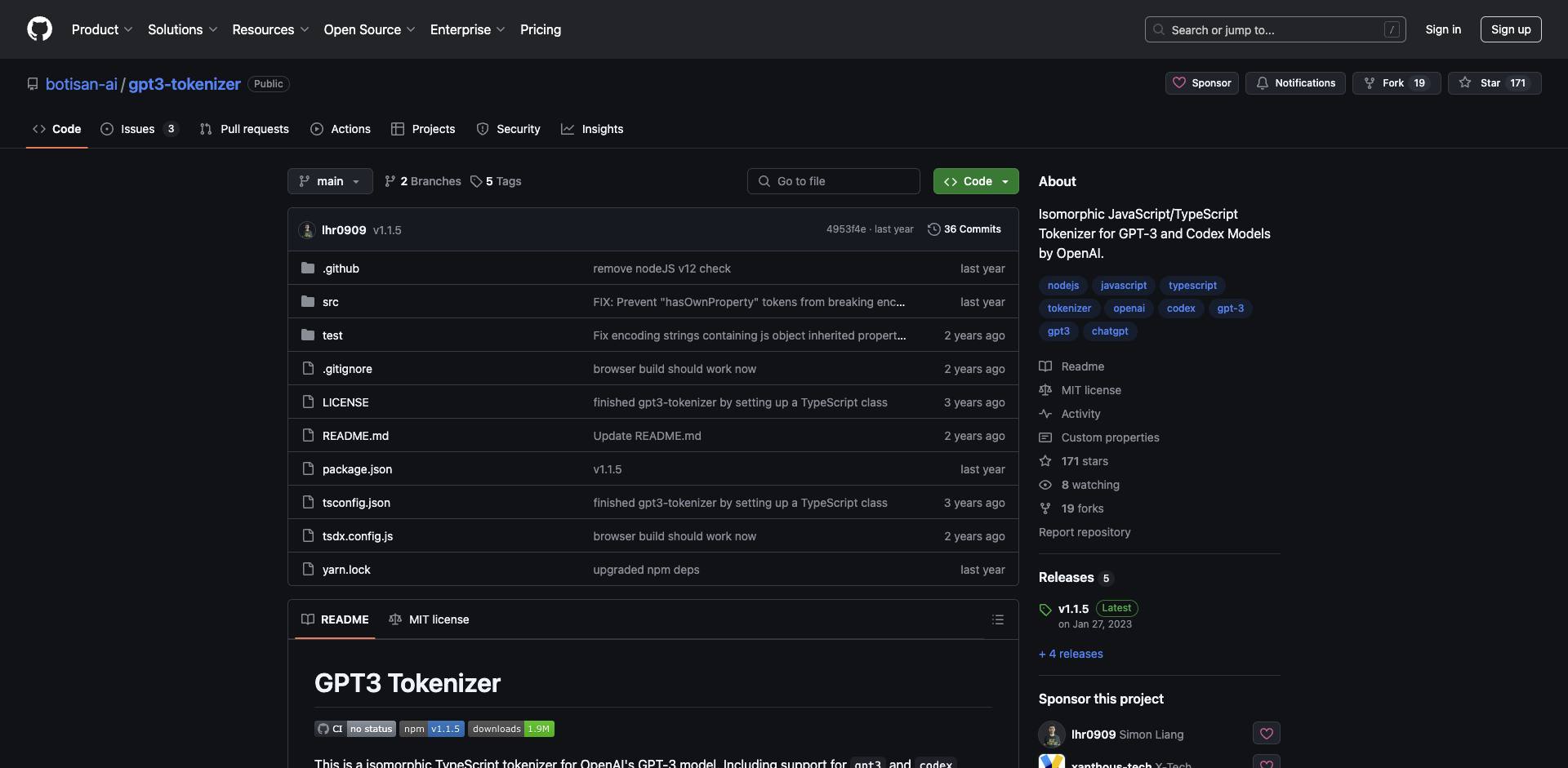

什么是GPT-3 Tokenizer?

GPT-3 Tokenizer是一个同构的JavaScript/TypeScript分词器,专门为OpenAI的GPT-3模型设计。它不仅支持GPT-3的分词,还支持Codex模型的分词。这个工具的主要特点是可以在NodeJS和浏览器环境中无缝运行,为开发者提供了极大的灵活性。

为什么需要分词器?

在自然语言处理中,分词是将文本分解为最小语义单位的过程。对于GPT-3这样的大型语言模型来说,高效准确的分词是保证模型性能的关键。GPT-3 Tokenizer正是为此而生,它能够将输入文本转换为GPT-3模型可以理解的标记(tokens)。

GPT-3 Tokenizer的核心功能

- 编码(Encoding):将文本转换为数字标记序列。

- 解码(Decoding):将数字标记序列转回原始文本。

- 支持多种模型:不仅支持GPT-3,还支持Codex模型。

- 跨平台兼容:可在Node.js和浏览器中使用。

如何使用GPT-3 Tokenizer?

使用GPT-3 Tokenizer非常简单。首先,你需要通过npm或yarn安装这个包:

yarn add gpt3-tokenizer

然后,在你的代码中引入并使用:

import GPT3Tokenizer from 'gpt3-tokenizer';

const tokenizer = new GPT3Tokenizer({ type: 'gpt3' }); // 或 'codex'

const str = "hello 👋 world 🌍";

const encoded = tokenizer.encode(str);

const decoded = tokenizer.decode(encoded.bpe);

console.log(encoded); // 输出编码后的标记

console.log(decoded); // 输出解码后的原文本

GPT-3 Tokenizer的技术亮点

- 性能优化:使用Map API代替JavaScript对象,特别是在处理

bpeRanks对象时,显著提升了性能。 - 准确性:直接使用OpenAI的词典,确保分词结果与OpenAI Playground保持一致。

- 灵活性:支持both

gpt3和codex分词,适应不同场景需求。 - 易于集成:设计为同构库,可以轻松集成到各种JavaScript/TypeScript项目中。

GPT-3 Tokenizer vs 其他分词器

与其他分词器相比,GPT-3 Tokenizer的主要优势在于:

- 专为GPT-3优化:考虑到GPT-3模型的特殊需求,提供最佳的分词效果。

- 支持Emoji和特殊字符:能够正确处理现代通讯中常见的表情符号和特殊字符。

- 开源和社区支持:作为开源项目,持续得到社区的改进和支持。

实际应用场景

GPT-3 Tokenizer在多个领域都有广泛应用:

- 聊天机器人开发:提供准确的文本分析,改善人机交互质量。

- 内容生成:辅助AI写作工具,生成更加连贯和自然的文本。

- 语言翻译:为多语言NLP任务提供基础支持。

- 情感分析:帮助更精确地识别和分类文本情感。

未来展望

随着NLP技术的不断发展,GPT-3 Tokenizer也在持续进化。未来可能的发展方向包括:

- 支持更多语言和方言的分词。

- 进一步优化性能,以处理更大规模的文本数据。

- 增加对新兴AI模型的支持。

结语

GPT-3 Tokenizer作为一个强大而灵活的工具,为GPT-3和Codex模型的应用开发铺平了道路。无论你是NLP研究者、AI开发者,还是对语言处理感兴趣的技术爱好者,GPT-3 Tokenizer都值得你深入探索和使用。

随着人工智能和自然语言处理技术的不断进步,像GPT-3 Tokenizer这样的工具将继续发挥关键作用,推动整个行业向前发展。让我们期待它在未来带来更多令人兴奋的可能性!

项目链接:www.dongaigc.com/a/gpt-3-tokenizer-key-tool

https://www.dongaigc.com/a/gpt-3-tokenizer-key-tool

7655

7655

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?