✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,matlab项目合作可私信。

🍎个人主页:Matlab科研工作室

🍊个人信条:格物致知。

更多Matlab完整代码及仿真定制内容点击👇

🔥 内容介绍

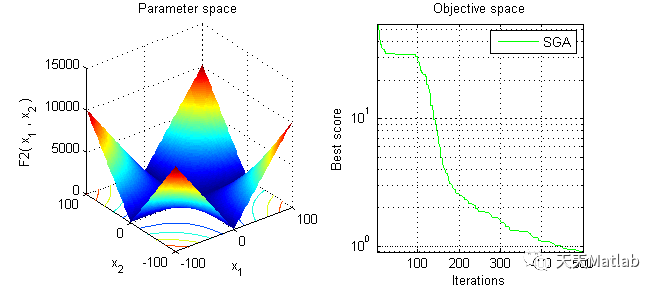

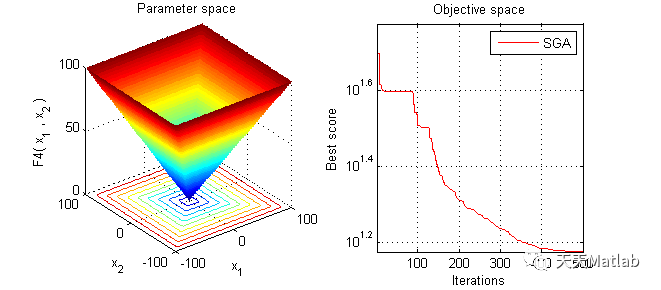

智能优化算法是一种基于计算机智能技术的优化方法,通过模拟自然界的进化和生物学原理,以提高解决问题的效率和准确性。在智能优化算法中,搜索组算法(Search Group Algorithm,简称SGA)是一种常用的算法,它通过模拟生物群体的搜索行为,来寻找问题的最优解。

SGA算法的步骤可以分为以下几个部分:

-

初始化种群:首先,需要确定问题的解空间和适应度函数。解空间是指问题的所有可能解构成的空间,适应度函数用于评估每个解的优劣程度。然后,随机生成一定数量的个体作为初始种群。

-

个体评估:对于每个个体,使用适应度函数计算其适应度值。适应度值越高,表示个体的解越优秀。

-

群体行为:在SGA算法中,个体之间会进行信息交流和相互影响,以模拟生物群体的搜索行为。具体而言,可以通过选择、交叉和变异等操作来更新种群。

-

选择:根据个体的适应度值,选择一部分优秀的个体作为父代,并将其复制到下一代种群中。较差的个体则被淘汰。

-

交叉:从父代中选择两个个体,并通过交叉操作生成两个子代。交叉操作可以是单点交叉、多点交叉或均匀交叉等。

-

变异:对于生成的子代,以一定的概率进行变异操作。变异操作可以是位变异、插入变异或交换变异等。

-

-

终止条件判断:在每一代种群更新之后,需要判断是否满足终止条件。终止条件可以是达到预定的迭代次数,或者找到了满足要求的解。

-

结果输出:当SGA算法终止时,输出找到的最优解。最优解是种群中适应度值最高的个体对应的解。

SGA算法作为一种智能优化算法,具有以下优点:

-

并行性强:SGA算法可以通过并行计算来提高搜索效率,加速问题求解过程。

-

全局搜索能力:SGA算法通过模拟生物群体的搜索行为,具有较强的全局搜索能力,可以找到问题的全局最优解。

-

鲁棒性强:SGA算法对问题的初始条件和参数设置相对不敏感,具有较强的鲁棒性。

然而,SGA算法也存在一些不足之处:

-

收敛速度较慢:由于SGA算法需要模拟生物群体的搜索行为,收敛速度相对较慢,可能需要较多的迭代次数才能找到最优解。

-

参数选择困难:SGA算法中的参数设置对算法的性能和结果有较大影响,但如何选择合适的参数仍然是一个挑战。

综上所述,SGA算法是一种常用的智能优化算法,通过模拟生物群体的搜索行为,来寻找问题的最优解。虽然SGA算法具有一定的局限性,但在许多实际问题中仍然具有较好的应用效果。随着智能优化算法的不断发展和改进,相信SGA算法在未来会有更广泛的应用。

📣 部分代码

%% 清空环境变量afunction fun_plot(fun_name)[lowerbound,upperbound,dimension,fitness]=fun_info(fun_name);switch fun_namecase 'F1'x=-100:2:100; y=x; %[-100,100]case 'F2'x=-100:2:100; y=x; %[-10,10]case 'F3'x=-100:2:100; y=x; %[-100,100]case 'F4'x=-100:2:100; y=x; %[-100,100]case 'F5'x=-200:2:200; y=x; %[-5,5]case 'F6'x=-100:2:100; y=x; %[-100,100]case 'F7'x=-1:0.03:1; y=x %[-1,1]case 'F8'x=-500:10:500;y=x; %[-500,500]case 'F9'x=-5:0.1:5; y=x; %[-5,5]case 'F10'x=-20:0.5:20; y=x;%[-500,500]case 'F11'x=-500:10:500; y=x;%[-0.5,0.5]case 'F12'x=-10:0.1:10; y=x;%[-pi,pi]case 'F13'x=-5:0.08:5; y=x;%[-3,1]case 'F14'x=-100:2:100; y=x;%[-100,100]case 'F15'x=-5:0.1:5; y=x;%[-5,5]case 'F16'x=-1:0.01:1; y=x;%[-5,5]case 'F17'x=-5:0.1:5; y=x;%[-5,5]case 'F18'x=-5:0.06:5; y=x;%[-5,5]case 'F19'x=-5:0.1:5; y=x;%[-5,5]case 'F20'x=-5:0.1:5; y=x;%[-5,5]case 'F21'x=-5:0.1:5; y=x;%[-5,5]case 'F22'x=-5:0.1:5; y=x;%[-5,5]case 'F23'x=-5:0.1:5; y=x;%[-5,5]endL=length(x);f=[];for i=1:Lfor j=1:Lif strcmp(fun_name,'F15')==0 && strcmp(fun_name,'F19')==0 && strcmp(fun_name,'F20')==0 && strcmp(fun_name,'F21')==0 && strcmp(fun_name,'F22')==0 && strcmp(fun_name,'F23')==0f(i,j)=fitness([x(i),y(j)]);endif strcmp(fun_name,'F15')==1f(i,j)=fitness([x(i),y(j),0,0]);endif strcmp(fun_name,'F19')==1f(i,j)=fitness([x(i),y(j),0]);endif strcmp(fun_name,'F20')==1f(i,j)=fitness([x(i),y(j),0,0,0,0]);endif strcmp(fun_name,'F21')==1 || strcmp(fun_name,'F22')==1 ||strcmp(fun_name,'F23')==1f(i,j)=fitness([x(i),y(j),0,0]);endendendsurfc(x,y,f,'LineStyle','none');endwarning off % 关闭报警信息close all % 关闭开启的图窗clear % 清空变量clc % 清空命令行%% 导入数据res = xlsread('数据集.xlsx');%% 划分训练集和测试集temp = randperm(357);P_train = res(temp(1: 240), 1: 12)';T_train = res(temp(1: 240), 13)';M = size(P_train, 2);P_test = res(temp(241: end), 1: 12)';T_test = res(temp(241: end), 13)';N = size(P_test, 2);%% 数据归一化[p_train, ps_input] = mapminmax(P_train, 0, 1);p_test = mapminmax('apply', P_test, ps_input);t_train = ind2vec(T_train);t_test = ind2vec(T_test );

⛳️ 运行结果

520

520

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?