6.1 使用文本数据

文本是常用的序列化数据类型之一。文本数据可以看作是一个字符序列或词的序列。对大多数问题,我们都将文本看作词序列。深度学习序列模型(如RNN及其变体)能够从文本数据中学习重要的模式。这些模式可以解决类似以下领域中的问题:

- 自然语言理解;

- 文献分类;

- 情感分类。

这些序列模型还可以作为各种系统的重要构建块,例如问答(Question and Answering,OA)系统。

虽然这些模型在构建这些应用时非常有用,但由于语言固有的复杂性,模型并不能真正理解人类的语言。这些序列模型能够成功地找到可执行不同任务的有用模式。将深度学习应用于文本是一个快速发展的领域,每月都会有许多新技术出现。我们将会介绍为大多数现代深度学习应用提供支持的基本组件。

与其他机器学习模型一样,深度学习模型并不能理解文本,因此需要将文本转换为数值的表示形式。将文本转换为数值表示形式的过程称为向量化过程,可以用不同的方式来完成,概括如下:

- 将文本转换为词并将每个词表示为向量;

- 将文本转换为字符并将每个字符表示为向量;

- 创建词的 n-gram 并将其表示为向量。

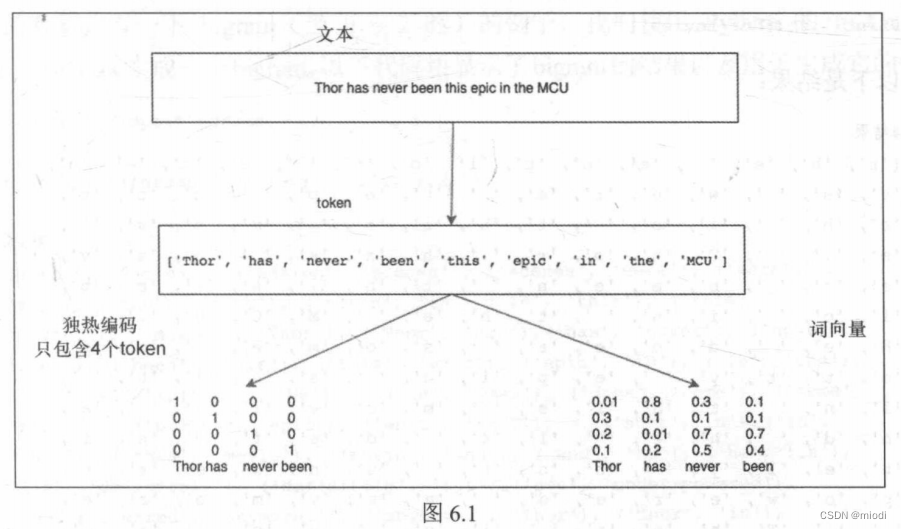

文本数据可以分解成上述的这些表示。每个较小的文本单元称为token,将文本分解成 token 的过程称为分词(tokenization)。在Python 中有很多强大的库可以用来进行分词一旦将文本数据转换为 token序列,那么就需要将每个 token 映射到向量。one-hot(独热)编码和词向量是将 token 映射到向量最流行的两种方法。图6.1总结了将文本转换为向量表示的步骤。

下面介绍分词、n-gram 表示法和向量化的更多细节。

6.1.1 分词

将给定的一个句子分为字符或词的过程称为分词。诸如spaCy等一些库,它们为分词提供了复杂的解决方案。让我们使用简单的Python函数(如split和list)将文本转换为 token。

为了演示分词如何作用于字符和词,让我们看一段关于电影Thor:Ragnarok 的小评论。我们将对这段文本进行分词处理:

The action scenes were top notch in this movie. Thor has never been this epic in the MCUHe does some pretty epic sh*t in this movie and he is definitely not under-powered anymore.Thor in unleashed in this, I love that.

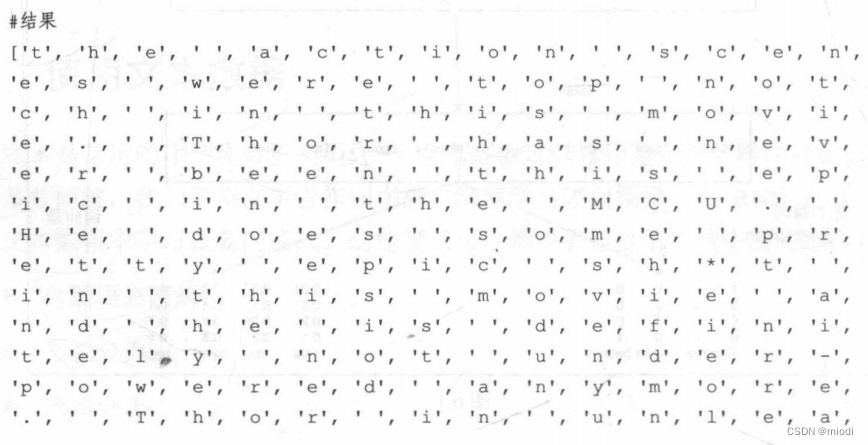

1. 将文本转换为字符

Python的list函数接受一个字符串并将其转换为单个字符的列表。这样做就将文本转换为了字符。下面是使用的代码和结果:

thor review="the action scenes were top notch in this movie.

Thor hasnever been this epic in the McU.

He does some pretty epic sh*t in thismovie and

he is definitely not under-powered anymore.

Thor in unleashed inthis,I love that."

Print(list(thor_review))以下是结果:

结果展示了简单的 Python 函数如何将文本转换为token。

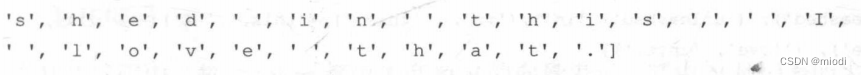

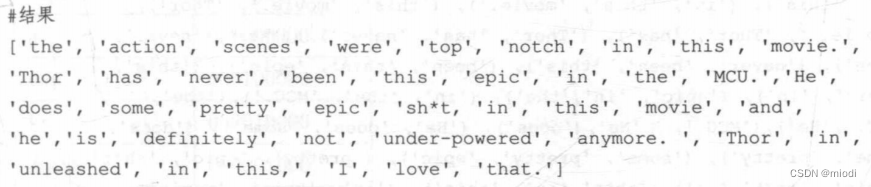

2. 将文本转换为词

我们将使用 Python 字符串对象函数中的 split 函数将文本分解为词。split 函数接受一个参数,并根据该参数将文本拆分为 token。在我们的示例中将使用空格作为分隔符。以下代码段演示了如何使用 Python 的 split 函数将文本转换为词:

print(Thor_review.split())

在前面的代码中,我们没有使用任何的分隔符,默认情况下,split 函数使用空格来分隔。

3. n-gram表示法

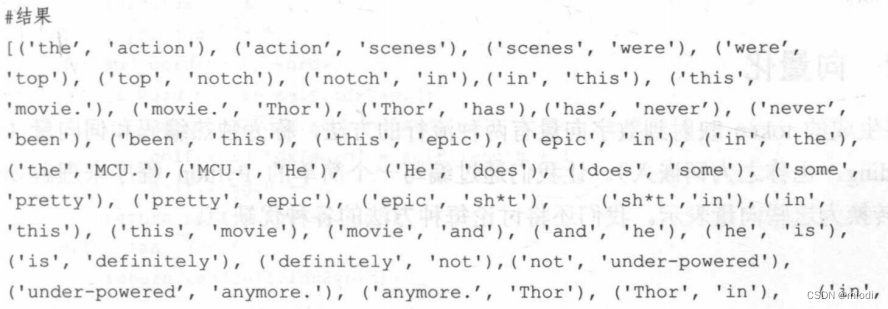

我们已经看到文本是如何表示为字符和词的。有时一起查看两个、三个或更多的单词非常有用。n-gram是从给定文本中提取的一组词。在n-gram中,n表示可以一起使用的词的数量。看一下bigram(当n=2时)的例子,我们使用 Python 的 nltk 包为 thor_review 生成一个 bigram ,以下代码块显示了 bigram 的结果以及用于生成它的代码:

from nltk import ngrams

print(list(ngrams(thor_review.split(),2)))

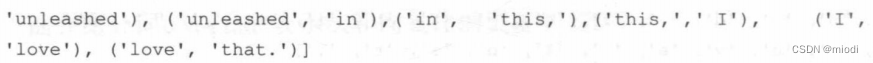

ngrams 函数接受一个词序列作为第一个参数,并将组中词的个数作为第二个参数。以下代码块显示了 trigram 表示的结果以及用于实现它的代码:

print(list(ngrams(thor_review.split(),3)))

在上述代码中唯一改变的只有函数的第二个参数n的值。

许多有监督的机器学习模型,例如朴素贝叶斯(NaiveBayes),都是使用n-gram来改善它的特征空间。n-gram同样也可用于拼写校正和文本摘要的任务。

n-gram 表示法的一个问题在于它失去了文本的顺序性。通常它是和浅层机器学习模型一起使用的。这种技术很少用于深度学习,因为 RNN 和 Conv1D 等架构会自动学习这些表示法。

6.1.2 向量化

将生成的 token 映射到数字向量有两种流行的方法,称为独热编码和词向(wordembedding,也称之为词嵌入)。让我们通过编写一个简单的Python 程序来理解如何将 token 转换为这些向量表示。我们还将讨论每种方法的各种优缺点。

1. 独热编码

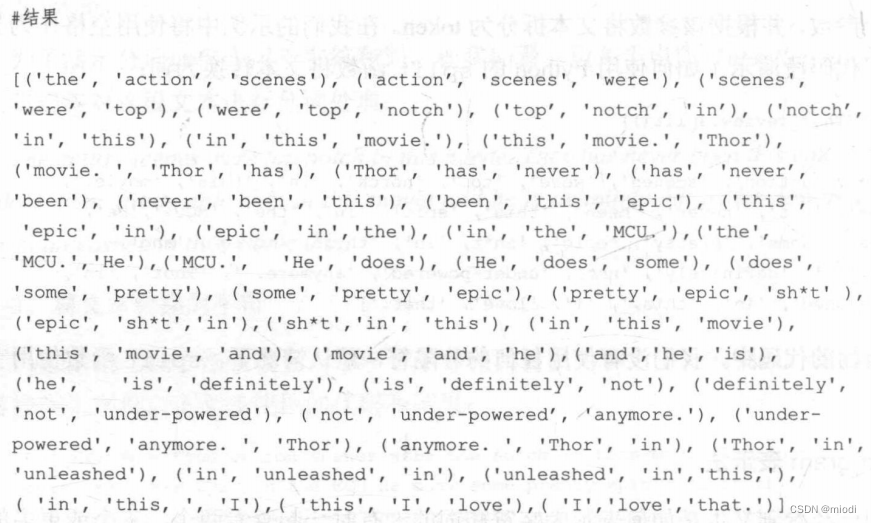

在独热编码中,每个 token 都由长度为N的向量表示,其中N是词表的大小。词表是文档中唯一词的总数。让我们用一个简单的句子来观察每个 token 是如何表示为独热编码的向量的。下面是句子及其相关的 token 表示:

An apple a day keeps doctor away said the doctor.

上面句子的独热编码可以用表格形式进行表示,如下所示。

该表描述了 token 及其独热编码的表示。因为句子中有9个唯一的单词,所以这里的向量长度为9。许多机器学习库已经简化了创建独热编码变量的过程。我们将编写自己的代码来实现这个过程以便更易于理解,并且我们可以使用相同的实现来构建后续示例所需的其他功能。以下代码包含 Dictionary类,这个类包含了创建唯一词词表的功能,以及为特定词返回其独热编码向量的函数。让我们来看代码,然后详解每个功能:

class Dictionary(object):

def _init_(self):

self.word2idx={}

self.idx2word =[]

self.length=0

def add_word(self, word):

if word not in self.idx2word:

self.idx2word.append(word)

self.word2idx[word]=self.length + 1

self.length +=1

return self.word2idx[word]

def _len_(self):

return len(self.idx2word)

def onehot_encoded(self,word):

vec =np.zeros(self.length)

vec[self.word2idx[word]] = 1

return vec上述代码提供了3个功能。

- 初始化函数_init_创建一个 word2idx 字典,它将所有唯一词与索引一起存储。idx2word 列表存储的是所有唯一词,而 length 变量则是文档中唯一词的总数。

- 在词是唯一的前提下,add_word 函数接受一个单词,并将它添加到 word2idx 和 idx2word 中,同时增加词表的长度。

- onehot_encoded函数接受一个词并返回一个长度为N,除当前词的索引外其余位置全为0的向量。比如传如的单词的索引是2,那么向量在索引2处的值是1,其他索引处的值全为0。

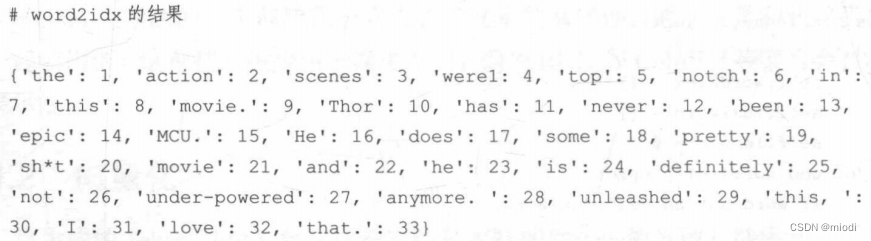

在定义好了 Dictionary 类后,准备在 thor_review 数据上使用它。以下代码演示了如何构建 word2idx 以及如何调用 onehot_encoded 函数:

die = Dictionary()

for tok in thor_review.split():

dic.add_word(tok)

print(dic.word2idx)上述代码的输出如下:

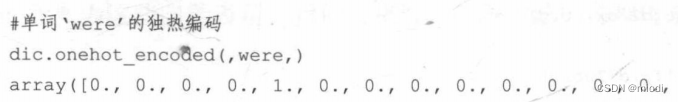

单词were的独热编码如下所示:

独热表示的问题之一就是数据太稀疏了,并且随着词表中唯一词数量的增加,向量的大小迅速增加,这也是它的一种限制,因此独热很少在深度学习中使用。

2. 词向量

词向量是在深度学习算法所解决的问题中,一种非常流行的用于表示文本数据的方式。词向量提供了一种用浮点数填充的词的密集表示。向量的维度根据词表的大小而变化。通常使用维度大小为50、100、256、300,有时为 1000 的词向量。这里的维度大小是在训练阶段需要使用的超参数。

如果试图用独热表示法来表示大小为 20000 的词表,那么将得到 20000 x 20000 个数字,并且其中大部分都为0。同样的词表可以用词向量表示为 20000 x 维度大小,其中维度的大小可以是 10、50、300等。

一种方法是为每个包含随机数字的 token 从密集向量开始创建词向量,然后训练诸如文档分类器或情感分类器的模型。表示 token 的浮点数以一种可以使语义上更接近的单词具有相似表示的方式进行调整。为了理解这一点,我们来看看图6.2,它画出了基于 5 部电影的二维点图的词向量。

图6.2显示了如何调整密集向量,以使其在语义上相似的单词具有较小的距离。由于Superman、Thor 和 Batman 等电影都是基于漫画的动作电影,所以这些电影的向量更为接近,而电影 Titanic 的向量离动作电影较远,离电影Notebook 更近,因为它们都是浪漫型电影。

在数据太少时学习词向量可能是行不通的,在这种情况下,可以使用由其他机器学习算法训练好的词向量。由另一个任务生成的向量称为预训练词向量。下面将学习如何构建自己的词向量以及使用预训练词向量。

1347

1347

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?