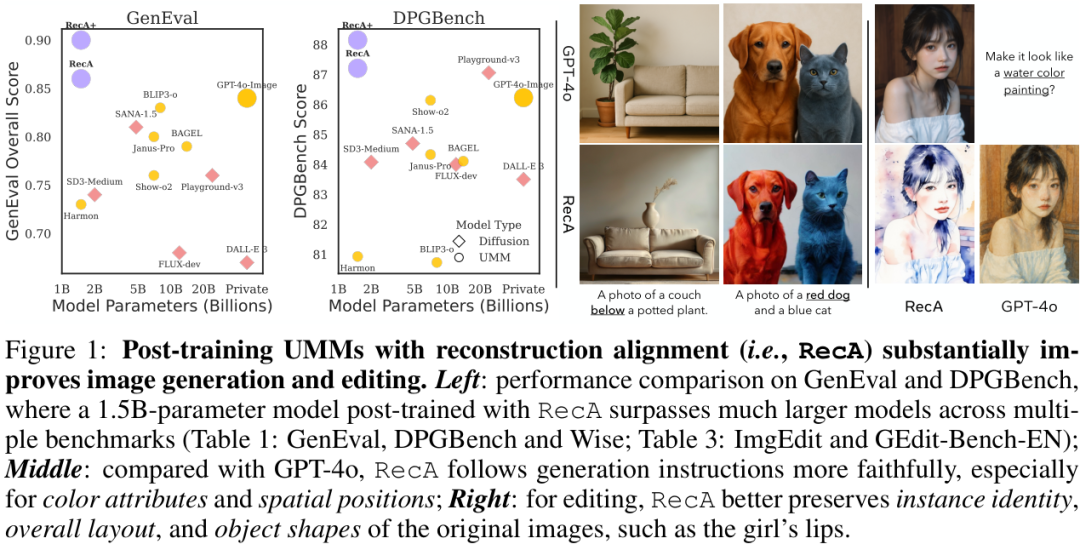

统一多模态模型(Unified Multimodal Models, UMMs)致力于在单一模型内实现“理解”与“生成”两大核心AI能力。然而,一个普遍存在的痛点是,模型常常能“理解”一个概念,却无法准确地“生成”它。例如,模型知道什么是“黄色的西兰花”,但在生成图像时却依然画出绿色的。这种“知行不一”的现象,根源在于传统训练所依赖的图像-文本对监督信号过于稀疏,无法捕捉图像中丰富的细粒度细节。

为了解决这一“理解-生成”不对齐的难题,来自加州大学伯克利分校和华盛顿大学的研究者们,提出了一种极为巧妙且资源高效的后训练对齐方法——**RecA (Reconstruction Alignment)**。该方法的核心思想是让模型进行“自我重构”,从而实现理解能力与生成能力的重新对齐。RecA作为一个通用的后训练策略,仅需 27个GPU小时,就能显著提升各类UMM的图像生成和编辑效果。

-

论文标题: Reconstruction Alignment Improves Unified Multimodal Models

-

作者: Ji Xie, Trevor Darrell, Luke Zettlemoyer, XuDong Wang

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

35

35

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?